이 섹션의 다중 페이지 출력 화면임. 여기를 클릭하여 프린트.

GPU Server

- 1: Overview

- 1.1: 서버 타입

- 1.2: 모니터링 지표

- 1.3: ServiceWatch 지표

- 2: How-to guides

- 2.1: Image 관리하기

- 2.2: Keypair 관리하기

- 2.3: GPU Server에서 Multi-instance GPU 사용하기

- 2.4: GPU Server에서 NVSwitch 사용하기

- 2.5: ServiceWatch Agent 설치하기

- 3: API Reference

- 4: CLI Reference

- 5: Release Note

1 - Overview

서비스 개요

GPU Server는 CPU, GPU, 메모리 등 서버에서 제공하는 인프라 자원을 개별 구매할 필요 없이, 필요한 시점에 필요한 만큼 자유롭게 할당 받아 사용할 수 있는 가상화 컴퓨팅 서비스 입니다. 클라우드 환경에서 AI모델 실험, 예측, 추론 등 빠른 연산 속도를 필요로 하는 업무에 적합하며, 업무 유형 및 규모에 따라 최적화 된 성능의 자원을 유연하게 선택하여 이용할 수 있습니다. GPU Server는 다음과 같은 기능을 제공하고 있습니다.

제공 기능

- GPU Server 관리: 웹 기반 Console을 통해 GPU Server 프로비저닝부터 모니터링, 빌링까지 사용자가 직접 Self Service로 생성, 삭제 및 변경을 관리할 수 있습니다.

- GPU 수량별 상품 제공: 프로젝트 용도 및 규모 등에 따라 H100/A100 GPU의 수량을 자유롭게 선택하여 가상 서버를 구성할 수 있습니다.

- 고성능 GPU 제공: Pass-through 방식을 사용하여 물리서버 수준의 고성능 GPU 서버를 제공합니다.

- 스토리지 연결: OS 디스크 외 추가 연결 스토리지를 제공 합니다. Block Storage, File Storage, Object Storage 를 연결하여 사용할 수 있습니다.

- 강력한 보안적용: Security Group 서비스를 통해 외부 인터넷이나 다른 VPC(Virtual Private Cloud)와 주고받는 Inbound/Outbound 트래픽을 제어하여 서버를 안전하게 보호합니다.

- 모니터링: 컴퓨텅 자원에 해당하는 CPU, Memory, Disk 및 GPU의 현황 등의 모니터링 정보를 Cloud Monitoring 서비스를 통해 확인할 수 있습니다.

- 네트워크 설정 관리: 서버의 서브넷/IP는 최초 생성시 설정된 값을 간편하게 변경 가능합니다. NAT IP는 필요에 따라 사용/해지를 설정할 수 있는 관리기능을 제공하고 있습니다.

- Key Pair 방식: 안전한 OS접속 방식을 위해 ID/PW의 접속이 아니라 Key Pair 방식을 제공합니다.

- Image 관리: Custom Image를 생성 및 관리할 수 있고, 프로젝트간 공유 기능을 제공합니다.

- ServiceWatch 서비스 연계 제공: ServiceWatch 서비스를 통해 데이터를 모니터링할 수 있습니다.

구성 요소

GPU Server는 가상화 컴퓨팅 자원 위에 GPU와 NVSwitch 및 NVLink가 제공됩니다.

- NVSwitch는 단일 GPU Server에 8개의 GPU를 할당한 인스턴스 타입의 경우에만 활성화하여 사용 가능합니다.

GPU(A100/H100)

GPU(Graphic Processing Unit)는 컴퓨터 화면을 구성 이미지를 만들기 위해 필요한 계산을 수행하는 역할로 병렬 처리에 특화되어있어 많은 양의 데이터를 빠르게 처리할 수 있어 인공지능(AI), 데이터 분석 등 대규모 병렬 연산을 처리합니다. 다음은 GPU Server 서비스에서 제공하는 GPU Type의 사양입니다.

| 구분 | A100 Type | H100 Type |

|---|---|---|

| 서비스 제공 방식 | Pass-through | Pass-through |

| GPU Architecture | NVIDIA Ampere | NVIDIA Hopper |

| GPU Memory | 80GB | 80GB |

| GPU Transistors | 54 billion 7N TSMC | 80 billion 4N TSMC |

| GPU Tensor Performance (FP16 기준, *: With Sparsity) | 312 TFLOPs, 624* TFLOPs | 989.4 TFLOPs, 1,978.9* TFLOPs |

| GPU Memory Bandwidth | 2,039 GB/sec HBM2e | 3,352 GB/sec HBM3 |

| GPU CUDA Cores | 6,912 Cores | 16,896 Cores |

| GPU Tensor Cores | 432 (3rd Generation) | 528 (4th Generation) |

| NVLink 성능 | NVLink 3 | NVLink 4 |

| 총 NVLink 대역폭 | 600 GB/s | 900 GB/s |

| NVLink Signaling Rate (단방향) | 25 GB/s (x12) | 25 GB/s (x18) |

| NVSwitch 성능 | NVSwitch 2 | NVSwitch 3 |

| NVSwitch GPU간 대역폭 | 600 GB/s | 900 GB/s |

| 총 NVSwitch 집계 대역폭 | 4.8 TB/s | 7.2 TB/s |

| 연계 스토리지 | Block Storage - SSD | Block Storage - SSD |

서버 타입

GPU Server에서 제공하는 서버 타입은 다음과 같습니다. GPU Server에서 제공하는 서버 타입에 대한 자세한 설명은 GPU Server 서버 타입을 참고하세요.

| 구분 | 서버 타입 | CPU vCore | Memory(GB) | GPU수량 |

|---|---|---|---|---|

| GPU-A100-1 | g1v16a1 | 16 | 234 | 1 |

| GPU-A100-1 | g1v32a2 | 32 | 468 | 2 |

| GPU-A100-1 | g1v64a4 | 64 | 936 | 4 |

| GPU-A100-1 | g1v128a8 | 128 | 1872 | 8 |

| GPU-H100-2 | g2v12h1 | 12 | 234 | 1 |

| GPU-H100-2 | g2v24h2 | 24 | 468 | 2 |

| GPU-H100-2 | g2v48h4 | 48 | 936 | 4 |

| GPU-H100-2 | g2v96h8 | 96 | 1872 | 8 |

OS 및 GPU 드라이버 버전

GPU Server에서 지원하는 운영체제(OS)는 다음과 같습니다.

| OS | OS 버전 | GPU 드라이버버전 |

|---|---|---|

| Ubuntu | 22.04 | 535.183.06 |

| RHEL | 8.10 | +ND 535.183.06 |

선행 서비스

본 서비스를 생성하기 전에 미리 설치가 되어야 하는 서비스입니다. 사전에 안내된 사용자 가이드를 참고하여 준비해주세요.

| 서비스 카테고리 | 서비스 | 상세 설명 |

|---|---|---|

| Networking | VPC | 클라우드 환경에서 독립된 가상 네트워크를 제공하는 서비스 |

| Networking | Security Group | 서버의 트래픽을 제어하는 가상 방화벽 |

1.1 - 서버 타입

GPU Server 서버 타입

GPU Server는 제공하는 GPU Type에 따라 구분되며, GPU Server를 생성할 때 선택하는 서버 타입에 따라 GPU Server에 사용되는 GPU가 결정됩니다. GPU Server에서 실행하려는 애플리케이션의 사양에 따라 서버 타입을 선택해주세요.

GPU Server에서 지원하는 서버 타입은 다음 형식과 같습니다.

GPU-H100-2 g2v12h1

구분 | 예시 | 상세 설명 |

|---|---|---|

| 서버 타입 | GPU-H100-2 | 제공되는 서버 타입 구분

|

| 서버 사양 | g2 | 제공되는 서버 타입 구분 및 세대

|

| 서버 사양 | v12 | vCore 개수

|

| 서버 사양 | h1 | GPU 종류와 수량

|

g1 서버 타입

g1 서버 타입은 NVIDIA A100 Tensor Core GPU를 사용하는 GPU Server로 고성능 애플리케이션에 적합합니다.

- 최대 8개의 NVIDIA A100 Tensor Core GPU 제공

- GPU 당 6,912개의 CUDA 코어와 432 Tensor 코어 탑재

- 최대 128개의 vCPU 및 1,920 GB의 메모리를 지원

- 최대 40 Gbps의 네트워킹 속도

- 600GB/s GPU와 NVIDIA NVSwitch P2P 통신

| 구분 | 서버 타입 | GPU | CPU | Memory | GPU Memory | Network Bandwidth |

|---|---|---|---|---|---|---|

| GPU-A100-1 | g1v16a1 | 1 | 16 vCore | 234 GB | 80 GB | 최대 20 Gbps |

| GPU-A100-1 | g1v32a2 | 2 | 32 vCore | 468 GB | 160 GB | 최대 20 Gbps |

| GPU-A100-1 | g1v64a4 | 4 | 64 vCore | 936 GB | 320 GB | 최대 40 Gbps |

| GPU-A100-1 | g1v128a8 | 8 | 128 vCore | 1872 GB | 640 GB | 최대 40 Gbps |

g2 서버 타입

g2 서버 타입은 NVIDIA H100 Tensor Core GPU를 사용하는 GPU Server로 고성능 애플리케이션에 적합합니다.

- 최대 8개의 NVIDIA H100 Tensor Core GPU 제공

- GPU 당 16,896개의 CUDA 코어와 528 Tensor 코어 탑재

- 최대 96개의 vCPU 및 1,920 GB의 메모리를 지원

- 최대 40Gbps의 네트워킹 속도

- 900GB/s GPU와 NVIDIA NVSwitch P2P 통신

| 구분 | 서버 타입 | GPU | CPU | Memory | GPU Memory | Network Bandwidth |

|---|---|---|---|---|---|---|

| GPU-H100-2 | g2v12h1 | 1 | 12 vCore | 234 GB | 80 GB | 최대 20 Gbps |

| GPU-H100-2 | g2v24h2 | 2 | 24 vCore | 468 GB | 160 GB | 최대 20 Gbps |

| GPU-H100-2 | g2v48h4 | 4 | 48 vCore | 936 GB | 320 GB | 최대 40 Gbps |

| GPU-H100-2 | g2v96h8 | 8 | 96 vCore | 1872 GB | 640 GB | 최대 40 Gbps |

1.2 - 모니터링 지표

GPU Server 모니터링 지표

아래 표는 Cloud Monitoring을 통해 확인할 수 있는 GPU Server의 모니터링 지표를 나타냅니다.

Agent를 설치하지 않아도 기본적인 모니터링 지표를 제공하며 아래 표. GPU Server 모니터링 지표(기본 제공) 에서 확인해주세요. 추가로 Agent 설치를 통해 조회 가능한 지표는 아래 표. GPU Server 추가 모니터링 지표 (Agent 설치 필요) 에서 참고하세요.

자세한 Cloud Monitoring 사용 방법은 Cloud Monitoring 가이드를 참고하세요.

| 성능 항목명 | 설명 | 단위 |

|---|---|---|

| Memory Total [Basic] | 사용할 수 있는 메모리의 bytes | bytes |

| Memory Used [Basic] | 현재 사용되는 메모리의 bytes | bytes |

| Memory Swap In [Basic] | 교체된 메모리의 bytes | bytes |

| Memory Swap Out [Basic] | 교체된 메모리의 bytes | bytes |

| Memory Free [Basic] | 사용하지 않은 메모리의 bytes | bytes |

| Disk Read Bytes [Basic] | 읽기 bytes | bytes |

| Disk Read Requests [Basic] | 읽기 요청 수 | cnt |

| Disk Write Bytes [Basic] | 쓰기bytes | bytes |

| Disk Write Requests [Basic] | 쓰기 요청 수 | cnt |

| CPU Usage [Basic] | 1분간 평균 시스템 CPU 사용률 | % |

| Instance State [Basic] | Instance 상태 | state |

| Network In Bytes [Basic] | 수신 bytes | bytes |

| Network In Dropped [Basic] | 수신 패킷 드롭 | cnt |

| Network In Packets [Basic] | 수신 패킷 수 | cnt |

| Network Out Bytes [Basic] | 송신 bytes | bytes |

| Network Out Dropped [Basic] | 송신 패킷 드롭 | cnt |

| Network Out Packets [Basic] | 송신 패킷 수 | cnt |

| 성능항목명 | 설명 | 단위 |

|---|---|---|

| GPU Count | gpu 개수 | cnt |

| GPU Memory Usage | 메모리 사용율 | % |

| GPU Memory Used | 메모리 사용량 | MB |

| GPU Temperature | gpu 온도 | ℃ |

| GPU Usage | utilization | % |

| GPU Usage [Avg] | GPU 전체 평균 사용율(%) | % |

| GPU Power Cap | GPU의 최대 전력 용량 | W |

| GPU Power Usage | GPU의 현재 전력 사용량 | W |

| GPU Memory Usage [Avg] | GPU Memory Uti. AVG | % |

| GPU Count in use | Node 내 Job이 수행중인 GPU 수 | cnt |

| Execution Status for nvidia-smi | nvidia-smi 명령어 실행결과 | status |

| Core Usage [IO Wait] | 대기 상태로 소요된 CPU 시간의 비율(디스크 대기) | % |

| Core Usage [System] | 커널 공간에서 소요된 CPU 시간의 비율 | % |

| Core Usage [User] | 사용자 공간에서 소요된 CPU 시간의 비율 | % |

| CPU Cores | 호스트에 있는 CPU 코어의 수 | cnt |

| CPU Usage [Active] | Idle 및 IOWait 상태 이외에 사용된 CPU 시간의 백분율 | % |

| CPU Usage [Idle] | 유휴 상태로 소요된 CPU 시간의 비율입니다. | % |

| CPU Usage [IO Wait] | 대기 상태로 소요된 CPU 시간의 비율(디스크 대기)입니다. | % |

| CPU Usage [System] | 커널에서 사용한 CPU 시간의 백분율 | % |

| CPU Usage [User] | 사용자 영역에서 사용한 CPU 시간의 백분율. | % |

| CPU Usage/Core [Active] | Idle 및 IOWait 상태 이외에 사용된 CPU 시간의 백분율 | % |

| CPU Usage/Core [Idle] | 유휴 상태로 소요된 CPU 시간의 비율입니다. | % |

| CPU Usage/Core [IO Wait] | 대기 상태로 소요된 CPU 시간의 비율(디스크 대기)입니다. | % |

| CPU Usage/Core [System] | 커널에서 사용한 CPU 시간의 백분율 | % |

| CPU Usage/Core [User] | 사용자 영역에서 사용한 CPU 시간의 백분율. | % |

| Disk CPU Usage [IO Request] | 장치에 대한 입출력 요청이 실행된 CPU 시간의 비율 | % |

| Disk Queue Size [Avg] | 장치에 대해 실행된 요청의 평균 대기열 길이입니다. | num |

| Disk Read Bytes | 장치에서 읽는 초당 바이트 수입니다. | bytes |

| Disk Read Bytes [Delta Avg] | 개별 disk들의 system.diskio.read.bytes_delta의 평균 | bytes |

| Disk Read Bytes [Delta Max] | 개별 disk들의 system.diskio.read.bytes_delta의 최대 | bytes |

| Disk Read Bytes [Delta Min] | 개별 disk들의 system.diskio.read.bytes_delta의 최소 | bytes |

| Disk Read Bytes [Delta Sum] | 개별 disk들의 system.diskio.read.bytes_delta의 합 | bytes |

| Disk Read Bytes [Delta] | 개별 disk의 system.diskio.read.bytes 값의 delta | bytes |

| Disk Read Bytes [Success] | 성공적으로 읽은 총 바이트 수. | bytes |

| Disk Read Requests | 1초동안 디스크 디바이스의 읽기 요청 수 | cnt |

| Disk Read Requests [Delta Avg] | 개별 disk들의 system.diskio.read.count_delta의 평균 | cnt |

| Disk Read Requests [Delta Max] | 개별 disk들의 system.diskio.read.count_delta의 최대 | cnt |

| Disk Read Requests [Delta Min] | 개별 disk들의 system.diskio.read.count_delta의 최소 | cnt |

| Disk Read Requests [Delta Sum] | 개별 disk들의 system.diskio.read.count_delta의 합 | cnt |

| Disk Read Requests [Success Delta] | 개별 disk의 system.diskio.read.count 의 delta | cnt |

| Disk Read Requests [Success] | 성공적으로 완료된 총 읽기 수 | cnt |

| Disk Request Size [Avg] | 장치에 대해 실행된 요청의 평균 크기(단위: 섹터)입니다. | num |

| Disk Service Time [Avg] | 장치에 대해 실행된 입력 요청의 평균 서비스 시간(밀리초)입니다. | ms |

| Disk Wait Time [Avg] | 지원할 장치에 대해 실행된 요청에 소요된 평균 시간입니다. | ms |

| Disk Wait Time [Read] | 디스크 평균 대기 시간 | ms |

| Disk Wait Time [Write] | 디스크 평균 대기 시간 | ms |

| Disk Write Bytes [Delta Avg] | 개별 disk들의 system.diskio.write.bytes_delta의 평균 | bytes |

| Disk Write Bytes [Delta Max] | 개별 disk들의 system.diskio.write.bytes_delta의 최대 | bytes |

| Disk Write Bytes [Delta Min] | 개별 disk들의 system.diskio.write.bytes_delta의 최소 | bytes |

| Disk Write Bytes [Delta Sum] | 개별 disk들의 system.diskio.write.bytes_delta의 합 | bytes |

| Disk Write Bytes [Delta] | 개별 disk의 system.diskio.write.bytes 값의 delta | bytes |

| Disk Write Bytes [Success] | 성공적으로 쓰여진 총 바이트 수. | bytes |

| Disk Write Requests | 1초동안 디스크 디바이스의 쓰기 요청 수 | cnt |

| Disk Write Requests [Delta Avg] | 개별 disk들의 system.diskio.write.count_delta의 평균 | cnt |

| Disk Write Requests [Delta Max] | 개별 disk들의 system.diskio.write.count_delta의 최대 | cnt |

| Disk Write Requests [Delta Min] | 개별 disk들의 system.diskio.write.count_delta의 최소 | cnt |

| Disk Write Requests [Delta Sum] | 개별 disk들의 system.diskio.write.count_delta의 합 | cnt |

| Disk Write Requests [Success Delta] | 개별 disk의 system.diskio.write.count 의 delta | cnt |

| Disk Write Requests [Success] | 성공적으로 완료된 총 쓰기 수 | cnt |

| Disk Writes Bytes | 장치에 쓰는 초당 바이트 수입니다. | bytes |

| Filesystem Hang Check | filesystem(local/NFS) hang 체크 (정상:1, 비정상:0) | status |

| Filesystem Nodes | 파일 시스템의 총 파일 노드 수입니다. | cnt |

| Filesystem Nodes [Free] | 파일 시스템의 총 가용 파일 노드 수입니다. | cnt |

| Filesystem Size [Available] | 권한 없는 사용자가 사용할 수 있는 디스크 공간(바이트) | bytes |

| Filesystem Size [Free] | 사용 가능한 디스크 공간 (bytes) | bytes |

| Filesystem Size [Total] | 총 디스크 공간 (bytes) | bytes |

| Filesystem Usage | 사용한 디스크 공간 백분율 | % |

| Filesystem Usage [Avg] | 개별 filesystem.used.pct들의 평균 | % |

| Filesystem Usage [Inode] | inode 사용률 | % |

| Filesystem Usage [Max] | 개별 filesystem.used.pct 중에 max | % |

| Filesystem Usage [Min] | 개별 filesystem.used.pct 중에 min | % |

| Filesystem Usage [Total] | - | % |

| Filesystem Used | 사용한 디스크 공간 (bytes) | bytes |

| Filesystem Used [Inode] | inode 사용량 | bytes |

| Memory Free | 사용 가능한 총 메모리 양 (bytes). | bytes |

| Memory Free [Actual] | 실제 사용가능한 memory (bytes). | bytes |

| Memory Free [Swap] | 사용가능한 swap memory. | bytes |

| Memory Total | 총 memory | bytes |

| Memory Total [Swap] | 총 swap memory. | bytes |

| Memory Usage | 사용한 memory의 백분율 | % |

| Memory Usage [Actual] | 실제 사용된 memory의 백분율 | % |

| Memory Usage [Cache Swap] | cache 된 swap 사용률 | % |

| Memory Usage [Swap] | 사용한 swap memory의 백분율 | % |

| Memory Used | 사용한 memory | bytes |

| Memory Used [Actual] | 실제 사용된 memory (bytes). | bytes |

| Memory Used [Swap] | 사용한 swap memory. | bytes |

| Collisions | 네트워크 충돌 | cnt |

| Network In Bytes | 수신된 byte 수 | bytes |

| Network In Bytes [Delta Avg] | 개별 network들의 system.network.in.bytes_delta의 평균 | bytes |

| Network In Bytes [Delta Max] | 개별 network들의 system.network.in.bytes_delta의 최대 | bytes |

| Network In Bytes [Delta Min] | 개별 network들의 system.network.in.bytes_delta의 최소 | bytes |

| Network In Bytes [Delta Sum] | 개별 network 들의 system.network.in.bytes_delta의 합 | bytes |

| Network In Bytes [Delta] | 수신된 byte 수의 delta | bytes |

| Network In Dropped | 들어온 packet 중 삭제된 패킷의 수 | cnt |

| Network In Errors | 수신 중의 error 수 | cnt |

| Network In Packets | 수신된 packet 수 | cnt |

| Network In Packets [Delta Avg] | 개별 network들의 system.network.in.packets_delta의 평균 | cnt |

| Network In Packets [Delta Max] | 개별 network들의 system.network.in.packets_delta의 최대 | cnt |

| Network In Packets [Delta Min] | 개별 network들의 system.network.in.packets_delta의 최소 | cnt |

| Network In Packets [Delta Sum] | 개별 network들의 system.network.in.packets_delta의 합 | cnt |

| Network In Packets [Delta] | 수신된 packet 수의 delta | cnt |

| Network Out Bytes | 송신된 byte 수 | bytes |

| Network Out Bytes [Delta Avg] | 개별 network들의 system.network.out.bytes_delta의 평균 | bytes |

| Network Out Bytes [Delta Max] | 개별 network들의 system.network.out.bytes_delta의 최대 | bytes |

| Network Out Bytes [Delta Min] | 개별 network들의 system.network.out.bytes_delta의 최소 | bytes |

| Network Out Bytes [Delta Sum] | 개별 network들의 system.network.out.bytes_delta의 합 | bytes |

| Network Out Bytes [Delta] | 송신된 byte 수의 delta | bytes |

| Network Out Dropped | 나가는 packet 중 삭제된 packet 수. | cnt |

| Network Out Errors | 송신 중의 error 수 | cnt |

| Network Out Packets | 송신된 packet 수 | cnt |

| Network Out Packets [Delta Avg] | 개별 network들의 system.network.out.packets_delta의 평균 | cnt |

| Network Out Packets [Delta Max] | 개별 network들의 system.network.out.packets_delta의 최대 | cnt |

| Network Out Packets [Delta Min] | 개별 network들의 system.network.out.packets_delta의 최소 | cnt |

| Network Out Packets [Delta Sum] | 개별 network들의 system.network.out.packets_delta의 합 | cnt |

| Network Out Packets [Delta] | 송신된 packet 수의 delta | cnt |

| Open Connections [TCP] | 열려 있는 모든 TCP 연결 | cnt |

| Open Connections [UDP] | 열려 있는 모든 UDP 연결 | cnt |

| Port Usage | 접속가능한 port 사용률 | % |

| SYN Sent Sockets | SYN_SENT 상태의 소켓 수 (로컬에서 원격 접속시) | cnt |

| Kernel PID Max | kernel.pid_max 값 | cnt |

| Kernel Thread Max | kernel.threads-max 값 | cnt |

| Process CPU Usage | 마지막 업데이트 후 프로세스에서 소비한 CPU 시간의 백분율. | % |

| Process CPU Usage/Core | 마지막 이벤트 이후 프로세스에서 사용한 CPU 시간의 백분율. | % |

| Process Memory Usage | main memory (RAM) 에서 프로세스가 차지하는 비율 | % |

| Process Memory Used | Resident Set 사이즈. 프로세스가 RAM 에서 차지한 메모리 양. | bytes |

| Process PID | 프로세스 pid | PID |

| Process PPID | 부모 프로세스의 pid | PID |

| Processes [Dead] | dead processes 수 | cnt |

| Processes [Idle] | idle processes 수 | cnt |

| Processes [Running] | running processes 수 | cnt |

| Processes [Sleeping] | sleeping processes 수 | cnt |

| Processes [Stopped] | stopped processes 수 | cnt |

| Processes [Total] | 총 processes 수 | cnt |

| Processes [Unknown] | 상태를 검색할 수 없거나 알 수 없는 processes 수 | cnt |

| Processes [Zombie] | 좀비 processes 수 | cnt |

| Running Process Usage | process 사용률 | % |

| Running Processes | running processes 수 | cnt |

| Running Thread Usage | thread 사용률 | % |

| Running Threads | running processes 에서 실행중인 thread 수 총합 | cnt |

| Context Switches | context switch 수 (초당) | cnt |

| Load/Core [1 min] | 마지막 1 분 동안의 로드를 코어 수로 나눈 값 | cnt |

| Load/Core [15 min] | 마지막 15 분 동안의 로드를 코어 수로 나눈 값 | cnt |

| Load/Core [5 min] | 마지막 5 분 동안의 로드를 코어 수로 나눈 값 | cnt |

| Multipaths [Active] | 외장 스토리지 연결 path status = active 카운트 | cnt |

| Multipaths [Failed] | 외장 스토리지 연결 path status = failed 카운트 | cnt |

| Multipaths [Faulty] | 외장 스토리지 연결 path status = faulty 카운트 | cnt |

| NTP Offset | last sample의 measured offset (NTP 서버와 로컬환경 간의 시간 차이) | num |

| Run Queue Length | 실행 대기열 길이 | num |

| Uptime | OS 가동시간(uptime). (milliseconds) | ms |

| Context Switchies | CPU context switch 수 (초당) | cnt |

| Disk Read Bytes [Sec] | windows logical 디스크에서 1초동안 읽어들인 바이트 수 | cnt |

| Disk Read Time [Avg] | 데이터 읽기 평균 시간 (초) | sec |

| Disk Transfer Time [Avg] | 디스크 average wait time | sec |

| Disk Usage | 디스크 사용률 | % |

| Disk Write Bytes [Sec] | windows logical 디스크에서 1초동안 쓰여진 바이트 수 | cnt |

| Disk Write Time [Avg] | 데이터 쓰기 평균 시간 (초) | sec |

| Pagingfile Usage | paging file 사용률 | % |

| Pool Used [Non Paged] | 커널 메모리 중 Nonpaged Pool 사용량 | bytes |

| Pool Used [Paged] | 커널 메모리 중 Paged Pool 사용량 | bytes |

| Process [Running] | 현재 동작 중인 프로세스 수 | cnt |

| Threads [Running] | 현재 동작 중인 thread 수 | cnt |

| Threads [Waiting] | 프로세서 시간을 기다리는 thread 수 | cnt |

1.3 - ServiceWatch 지표

GPU Server는 ServiceWatch로 지표를 전송합니다. 기본 모니터링으로 제공되는 지표는 5분 주기로 수집된 데이터입니다. 세부 모니터링을 활성화하면, 1분 주기로 수집된 데이터를 확인할 수 있습니다.

- GPU Server의 기본 모니터링과 세부 모니터링은 Virtual Server와 동일한 지표로 제공되며, 네임스페이스도 Virtual Server로 제공됩니다.

- GPU 관련 지표는 ServiceWatch Agent를 통해 제공되며, ServiceWatch Agent를 사용하여 지표를 수집하는 방법은 ServiceWatch Agent 가이드를 참고하세요.

GPU Server의 세부 모니터링 활성화하는 방법은 How-to guides > ServiceWatch 세부 모니터링 활성화하기를 참고하세요.

기본 지표

다음은 네임스페이스 Virtual Server에 대한 기본 지표입니다.

| 성능 항목 | 상세 설명 | 단위 | 의미있는 통계 |

|---|---|---|---|

| Instance State | 인스턴스 상태 표시 | - | - |

| CPU Usage | CPU 사용률 | % |

|

| Disk Read Bytes | 블록 장치에서 읽은 용량(바이트) | Bytes |

|

| Disk Read Requests | 블록 장치에서의 읽기 요청 수 | Count |

|

| Disk Write Bytes | 블록 장치에서 쓰기 용량(바이트) | Bytes |

|

| Disk Write Requests | 블록 장치에서의 쓰기 요청 수 | Count |

|

| Network In Bytes | 네트워크 인터페이스에서 수신된 용량(바이트) | Bytes |

|

| Network In Dropped | 네트워크 인터페이스에서 수신된 패킷 드롭 수 | Count |

|

| Network In Packets | 네트워크 인터페이스에서 수신된 패킷 수 | Count |

|

| Network Out Bytes | 네트워크 인터페이스에서 전송된 용량(바이트) | Bytes |

|

| Network Out Dropped | 네트워크 인터페이스에서 전송된 패킷 드롭 수 | Count |

|

| Network Out Packets | 네트워크 인터페이스에서 전송된 패킷 수 | Count |

|

2 - How-to guides

사용자는 Samsung Cloud Platform Console을 통해 GPU Server의 필수 정보를 입력하고, 상세 옵션을 선택하여 해당 서비스를 생성할 수 있습니다.

GPU Server 생성하기

Samsung Cloud Platform Console에서 GPU Server 서비스를 생성하여 사용할 수 있습니다.

GPU Server 생성하려면 다음 절차를 따르세요.

- 모든 서비스 > Compute > GPU Server 메뉴를 클릭하세요. GPU Server의 Service Home 페이지로 이동합니다.

- Service Home 페이지에서 GPU Server 생성 버튼을 클릭하세요. GPU Server 생성 페이지로 이동합니다.

- GPU Server 생성 페이지에서 서비스 생성에 필요한 정보들을 입력하고, 상세 옵션을 선택하세요.

- 이미지 및 버전 선택 영역에서 필요한 정보를 선택하세요.

구분 필수 여부상세 설명 이미지 필수 제공하는 이미지 종류 선택 - RHEL, Ubuntu

이미지 버전 필수 선택한 이미지의 버전 선택 - 제공하는 서버 이미지의 버전 리스트 제공

- 제공 서버 이미지에 대한 자세한 정보는 OS 및 GPU 드라이버 버전 참고

표. GPU Server 이미지 및 버전 선택 입력 항목 - 서비스 정보 입력 영역에서 필요한 정보를 입력 또는 선택하세요.

구분 필수 여부상세 설명 서버 수 필수 동시 생성할 GPU Server 서버 수 - 숫자만 입력 가능하며 1~100 사이의 값을 입력

서비스 유형 > 서버 타입 필수 GPU Server 서버 타입 - GPU 타입의 서버 사양을 나타내며 GPU 1장, 2장, 4장, 8장을 포함한 서버를 선택

- GPU Server에서 제공하는 서버 타입에 대한 자세한 내용은 GPU Server 서버 타입을 참고

서비스 유형 > Planned Compute 선택 Planned Compute가 설정된 자원 현황 - 사용중: Planned Compute가 설정된 자원 중 사용 중인 개수

- 설정: Planned Compute가 설정된 자원의 개수

- Coverage 미리보기: 자원별 Planned Compute로 적용된 금액

- Planned Compute 서비스 신청: Planned Compute 서비스 신청 페이지로 이동

- 자세한 내용은 Planned Compute 신청하기를 참고

Block Storage 필수 용도에 따라 GPU Server가 사용하는 Block Storage를 설정 - 기본: OS가 설치되어 사용되는 영역

- 용량은 Unit 단위로 입력 가능(OS 이미지의 종류에 따라 최소 용량이 다름)

- RHEL: 3 ~ 1,536 사이의 값 입력 가능

- Ubuntu: 3 ~ 1,536 사이의 값 입력 가능

- SSD: 고성능 일반 볼륨

- HDD: 일반 볼륨

- SSD/HDD_KMS: Samsung Cloud Platform KMS (Key Management System) 암호화 키를 사용하는 추가 암호화 볼륨

- 암호화 적용은 최초 생성 시에만 가능(생성 후, 변경 불가)

- SSD_KMS 디스크 유형 사용 시 성능 저하 발생

- 용량은 Unit 단위로 입력 가능(OS 이미지의 종류에 따라 최소 용량이 다름)

- 추가: OS 영역 외 사용자 추가 공간 필요 시 사용

- 사용을 선택한 후, Storage의 유형과 용량 입력

- Storage를 추가하려면 + 버튼을 클릭(최대 25개까지 추가 가능), 삭제하려면 x 버튼 클릭

- 용량은 Unit 단위로 1 ~ 1,536 사이의 값을 입력 가능

- 1 Unit이 8 GB이므로 8 ~ 12,288 GB가 생성

- SSD: 고성능 일반 볼륨

- HDD: 일반 볼륨

- SSD/HDD_KMS: Samsung Cloud Platform KMS (Key Management System) 암호화 키를 사용하는 추가 암호화 볼륨

- 암호화 적용은 최초 생성 시에만 가능(생성 후, 변경 불가)

- SSD_KMS 디스크 유형 사용 시 성능 저하가 발생할 있음

- Block Storage 유형별 자세한 내용은 Block Storage 생성하기를 참고

- Delete on termination: Delete on Termination을 사용으로 선택한 경우, 서버를 해지할 때 해당 볼륨을 함께 해지

- 스냅샷이 존재하는 볼륨은 Delete on termination을 사용으로 선택한 경우에도 삭제되지 않음

- Multi attach 볼륨은 삭제하려는 서버가 볼륨에 연결된 마지막 남은 서버일 때만 삭제

표. GPU Server 서비스 구성 항목 - 필수 정보 입력 영역에서 필요한 정보를 입력 또는 선택하세요.

구분 필수 여부상세 설명 서버명 필수 선택한 서버 수가 1인 경우에 서버 구별을 위한 이름 입력 - 입력한 서버 이름으로 hostname을 설정

- 영문,숫자,공백과 특수문자(

-_)를 사용하여 63자 이내로 입력

서버명 Prefix 필수 선택한 서버 수가 2이상인 경우에 생성되는 각각의 서버 구별을 위한 Prefix 입력 - 사용자 입력값(prefix) + ‘

-#’ 형태로 자동 생성

- 영문, 숫자, 공백과 특수문자(

-,_)를 사용하여 59자 이내로 입력

네트워크 설정 > 신규 네트워크 포트 생성 필수 GPU Server가 설치될 네트워크를 설정 - 미리 생성한 VPC를 선택합니다.

- 일반 Subnet: 미리 생성한 일반 Subnet을 선택

- IP는 자동 생성과 사용자 입력을 선택할 수 있으며, 입력을 선택하면 사용자가 IP를 직접 입력

- NAT: 서버 수가 1대이고 VPC에 Internet Gateway가 연결되어 있어야 사용 가능. 사용을 체크하면 NAT IP를 선택 가능

- NAT IP: NAT IP를 선택

- 선택할 NAT IP가 없는 경우, 신규 생성 버튼을 클릭하여 Public IP를 생성해야 함

- 새로고침 버튼을 클릭하여, 생성한 Public IP를 확인하고 선택

- Public IP를 생성하면 Public IP 요금 기준에 따라 요금이 부과

- 로컬 Subnet(선택): 로컬 Subnet 사용을 선택

- 서비스를 생성하는데 필수 요소는 아님

- 미리 생성한 로컬 Subnet을 선택해야 함

- IP는 자동 생성과 사용자 입력을 선택할 수 있으며, 입력을 선택하면 사용자가 IP를 직접 입력 가능

- Security Group: 서버에 접속하기 위해 필요한 설정

- 선택: 미리 생성한 Security Group을 선택

- 신규 생성: 적용할 Security Group이 없는 경우 Security Group 서비스에서 별도로 생성 가능

- 최대 5개까지 선택 가능

- Security Group을 설정하지 않으면 기본적으로 모든 접속을 차단함

- 필요한 접속을 허용하기 위해서 Security Group을 설정해야 함

네트워크 설정 > 기존 네트워크 포트 지정 필수 GPU Server가 설치될 네트워크를 설정 - 미리 생성한 VPC를 선택

- 일반 Subnet: 미리 생성한 일반 Subnet과 Port를 선택

- NAT: 서버 수가 1대이고 VPC에 Internet Gateway가 연결되어 있어야 사용 가능 사용을 체크하면 NAT IP를 선택할 수 있습니다.

- NAT IP: NAT IP를 선택

- 선택할 NAT IP가 없는 경우, 신규 생성 버튼을 클릭하여 Public IP를 생성

- 새로고침 버튼을 클릭하여, 생성한 Public IP를 확인하고 선택

- 로컬 Subnet(선택): 로컬 Subnet의 사용 을 선택

- 미리 생성한 로컬 Subnet과 Port를 선택

Keypair 필수 서버에 연결할 때 사용할 사용자 증명 방법 - 신규 생성: 새로운 Keypair가 필요한 경우 신규 생성

- 신규 Keypair 생성 방법은 Keypair 생성하기 를 참고

- OS별 기본 접속 계정 리스트

- RHEL: cloud-user

- Ubuntu: ubuntu

표. GPU Server 필수 정보 입력 항목 - 추가 정보 입력 영역에서 필요한 정보를 입력 또는 선택하세요.

구분 필수 여부상세 설명 Lock 선택 Lock 사용 여부 설정 - Lock을 사용하면 서버 해지, 시작, 중지 등의 동작을 실행할 수 없도록 하여 실수로 인한 오동작을 방지

Init script 선택 서버 시작 시, 실행하는 스크립트 - Init script는 이미지 종류에 따라 Windows의 경우 Batch script, Linux의 경우 Shell script 또는 cloud-init로 작성되어야 함.

- 최대 45,000 bytes까지 입력 가능

태그 선택 태그 추가 - 자원 당 최대 50개까지 추가 가능

- 태그 추가 버튼을 클릭한 후 Key, Value 값을 입력 또는 선택

표. GPU Server 추가 정보 입력 항목

- 이미지 및 버전 선택 영역에서 필요한 정보를 선택하세요.

- 요약 패널에서 생성한 상세 정보와 예상 청구 금액을 확인하고, 완료 버튼을 클릭하세요.

- 생성이 완료되면, GPU Server 목록 페이지에서 생성한 자원을 확인하세요.

GPU Server 상세 정보 확인하기

GPU Server 서비스는 전체 자원 목록과 상세 정보를 확인하고 수정할 수 있습니다. GPU Server 상세 페이지에서는 상세 정보, 태그, 작업 이력 탭으로 구성되어 있습니다.

GPU Server 서비스의 상세 정보를 확인하려면 다음 절차를 따르세요.

- 모든 서비스 > Compute > GPU Server 메뉴를 클릭하세요. GPU Server의 Service Home 페이지로 이동합니다.

- Service Home 페이지에서 GPU Server 메뉴를 클릭하세요. GPU Server 목록 페이지로 이동합니다.

- GPU Server 목록 페이지에서 상세 정보를 확인할 자원을 클릭하세요. GPU Server 상세 페이지로 이동합니다.

- GPU Server 상세 페이지에는 상태 정보 및 부가 기능 정보가 표시되며, 상세 정보, 태그, 작업 이력 탭으로 구성됩니다.

- GPU Server 부가 기능에 대한 자세한 내용은 GPU Server 관리 부가 기능을 참고하세요.

구분 상세 설명 GPU Server 상태 사용자가 생성한 GPU Server의 상태 - Build: Build 명령이 전달된 상태

- Building: Build 진행중

- Networking: 서버 생성 진행중 프로세스

- Scheduling: 서버 생성 진행중 프로세스

- Block_Device_Mapping: 서버 생성시 Block Storage 연결 중

- Spawning: 서버 생성 프로세스가 진행 중인 상태

- Active: 사용 가능한 상태

- Powering_off: 중지 요청시 상태

- Deleting: 서버 삭제 진행 중

- Reboot_Started: Reboot 진행중 상태

- Error: 에러 상태

- Migrating: 다른 호스트로 서버 Migration 되는 상태

- Reboot: Reboot 명령이 전달된 상태

- Rebooting: 재시작 진행 중

- Rebuild: Rebuild 명령이 전달된 상태

- Rebuilding: Rebuild 요청 시 상태

- Rebuild_Spawning: Rebuild 프로세스가 진행중인 상태

- Resize: Resize 명령이 전달된 상태

- Resizing: Resize 진행 중

- Resize_Prep: 서버 타입 수정 요청 시 상태

- Resize_Migrating: 서버가 Resize 진행 동시에 다른 호스토로 이동 중인 상태

- Resize_Migrated: 서버가 Resize 진행 동시에 다른 호스트로 이동 완료된 상태

- Resize_Finish: Resize가 완료

- Revert_Resize: 어떤 이유로 서버의 Resize 또는 마이그레이션 실패. 대상 서버가 정리되고 원래 원본 서버가 다시 시작

- Shutoff: Powering off 완료 시 상태

- Verity_Resize: 서버 타입 수정 요청에 따라 Resize_Prep 진행 이후, 서버 타입 확정/서버 타입 원복 선택 가능 상태

- Resize_Reverting: 서버 타입 원복 요청 시 상태

- Resize_Confirming: 서버의 Resize 요청을 확인 중인 상태

서버 제어 서버 상태를 변경할 수 있는 버튼 - 시작: 중지된 서버를 시작

- 중지: 가동 중인 서버를 중지

- 재시작: 가동 중인 서버를 재시작

이미지 생성 현재 서버의 이미지로 사용자 Custom 이미지 생성 콘솔 로그 현재 서버의 콘솔 로그 조회 - 현재 서버에서 출력되는 콘솔 로그를 확인할 수 있음. 자세한 내용은 콘솔 로그 확인하기를 참고하세요.

Dump 생성 현재 서버의 Dump를 생성 - Dump 파일은 GPU Server 안에 생성됨

- 자세한 Dump 생성 방법은 Dump 생성하기를 참고

Rebuild 기존 서버의 모든 데이터와 설정이 삭제되고, 새로운 서버를 구성 - 자세한 내용은 Rebuild 수행하기를 참고하세요.

서비스 해지 서비스를 해지하는 버튼 표. GPU Server 상태 정보 및 부가 기능

상세 정보

GPU Server 목록 페이지에서 선택한 자원의 상세 정보를 확인하고, 필요한 경우 정보를 수정할 수 있습니다.

| 구분 | 상세 설명 |

|---|---|

| 서비스 | 서비스명 |

| 자원 유형 | 자원 유형 |

| SRN | Samsung Cloud Platform에서의 고유 자원 ID

|

| 자원명 | 자원 이름

|

| 자원 ID | 서비스에서의 고유 자원 ID |

| 생성자 | 서비스를 생성한 사용자 |

| 생성 일시 | 서비스를 생성한 일시 |

| 수정자 | 서비스 정보를 수정한 사용자 |

| 수정 일시 | 서비스 정보를 수정한 일시 |

| 서버명 | 서버 이름 |

| 서버 타입 | vCPU, 메모리, GPU정보 표시

|

| 이미지명 | 서비스의 OS 이미지 및 버전 |

| Lock | Lock 사용/미사용 여부 표시

|

| Keypair명 | 사용자가 설정한 서버 인증 정보 |

| Planned Compute | Planned Compute가 설정된 자원 현황

|

| LLM Endpoint | LLM 이용을 위한 URL

|

| ServiceWatch 세부 모니터링 | 활성화 시 ServiceWatch 서비스에서 데이터 모니터링 가능

|

| 네트워크 | GPU Server의 네트워크 정보

|

| 로컬 Subnet | GPU Server의 로컬 Subnet 정보

|

| Block Storage | 서버에 연결된 Block Storage의 정보

|

태그

GPU Server 목록 페이지에서 선택한 자원의 태그 정보를 확인하고, 추가하거나 변경 또는 삭제할 수 있습니다.

| 구분 | 상세 설명 |

|---|---|

| 태그 목록 | 태그 목록

|

작업 이력

GPU Server 목록 페이지에서 선택한 자원의 작업 이력을 확인할 수 있습니다.

| 구분 | 상세 설명 |

|---|---|

| 작업 이력 목록 | 자원 변경 이력

|

GPU Server 가동 제어하기

생성된 GPU Server 자원의 가동 제어가 필요한 경우, GPU Server 목록 또는 GPU Server 상세 페이지에서 작업을 수행할 수 있습니다. 가동 중인 서버의 시작, 중지, 재시작을 할 수 있습니다.

GPU Server 시작하기

중지(Shutoff)된 GPU Server를 시작할 수 있습니다. GPU Server를 시작하려면 다음 절차를 따르세요.

- 모든 서비스 > Compute > GPU Server 메뉴를 클릭하세요. GPU Server의 Service Home 페이지로 이동합니다.

- Service Home 페이지에서 GPU Server 메뉴를 클릭하세요. GPU Server 목록 페이지로 이동합니다.

- GPU Server 목록 페이지에서 중지(Shutoff)된 서버 중 시작할 자원을 클릭하여, GPU Server 상세 페이지로 이동합니다.

- GPU Server 목록 페이지에서 각 자원 별로 오른쪽 더보기 버튼을 통해 시작할 수 있습니다.

- 여러 대 서버를 체크 박스 선택한 후, 상단의 시작 버튼을 통해 여러 대 서버를 동시에 제어할 수 있습니다.

- GPU Server 상세 페이지에서 상단의 시작 버튼을 클릭하여, 서버를 시작합니다. 상태 표시 항목에서 변경된 서버의 상태를 확인하세요.

- GPU Server 시작이 완료되면 서버 상태가 Shutoff에서 Active로 변경됩니다.

- GPU Server 상태에 대한 자세한 내용은 GPU Server 상세 정보 확인하기를 참고하세요.

GPU Server 중지하기

가동(Active)중인 GPU Server를 중지할 수 있습니다. GPU Server를 중지하려면 다음 절차를 따르세요.

- 모든 서비스 > Compute > GPU Server 메뉴를 클릭하세요. GPU Server의 Service Home 페이지로 이동합니다.

- Service Home 페이지에서 GPU Server 메뉴를 클릭하세요. GPU Server 목록 페이지로 이동합니다.

- GPU Server 목록 페이지에서 가동(Active) 중인 서버 중 중지할 자원을 클릭하여, GPU Server 상세 페이지로 이동합니다.

- GPU Server 목록 페이지에서 각 자원 별로 오른쪽 더보기 버튼을 통해 중지할 수 있습니다.

- 여러 대 서버를 체크 박스 선택한 후, 상단의 중지 버튼을 통해 여러 대 서버를 동시에 제어할 수 있습니다.

- GPU Server 상세 페이지에서 상단의 중지 버튼을 클릭하여, 서버를 시작합니다. 상태 표시 항목에서 변경된 서버의 상태를 확인하세요.

- GPU Server 중지가 완료되면 서버 상태가 Active에서 Shutoff로 변경됩니다.

- GPU Server 상태에 대한 자세한 내용은 GPU Server 상세 정보 확인하기를 참고하세요.

GPU Server 재시작하기

생성된 GPU Server를 재시작할 수 있습니다. GPU Server를 재시작하려면 다음 절차를 따르세요.

- 모든 서비스 > Compute > GPU Server 메뉴를 클릭하세요. GPU Server의 Service Home 페이지로 이동합니다.

- Service Home 페이지에서 GPU Server 메뉴를 클릭하세요. GPU Server 목록 페이지로 이동합니다.

- GPU Server 목록 페이지에서 재시작할 자원을 클릭하여, GPU Server 상세 페이지로 이동합니다.

- GPU Server 목록 페이지에서 각 자원 별로 오른쪽 더보기 버튼을 통해 재시작할 수 있습니다.

- 여러 대 서버를 체크 박스 선택한 후, 상단의 재시작 버튼을 통해 여러 대 서버를 동시에 제어할 수 있습니다.

- GPU Server 상세 페이지에서 상단의 재시작 버튼을 클릭하여, 서버를 시작합니다. 상태 표시 항목에서 변경된 서버의 상태를 확인하세요.

- GPU Server 재시작 중에는 서버 상태가 Rebooting을 거쳐 최종 Active로 변경됩니다.

- GPU Server 상태에 대한 자세한 내용은 GPU Server 상세 정보 확인하기를 참고하세요.

GPU Server 자원 관리하기

생성된 GPU Server 자원의 서버 제어 및 관리 기능이 필요한 경우, GPU Server 자원목록 또는 GPU Server 상세 페이지에서 작업을 수행할 수 있습니다.

Image 생성하기

가동 중인 GPU Server의 Image를 생성할 수 있습니다.

해당 내용은 가동 중인 GPU Server의 Image로 사용자 Custom Image를 생성하는 방법을 안내하고 있습니다.

- GPU Server 목록 또는 GPU Server 상세 페이지에서 이미지 생성 버튼을 클릭하여 사용자 Custom Image를 생성합니다.

GPU Server의 Image를 생성하려면 다음 절차를 따르세요.

모든 서비스 > Compute > GPU Server 메뉴를 클릭하세요. GPU Server의 Service Home 페이지로 이동합니다.

Service Home 페이지에서 GPU Server 메뉴를 클릭하세요. GPU Server 목록 페이지로 이동합니다.

GPU Server 목록 페이지에서 Image 생성할 자원을 클릭하세요. GPU Server 상세 페이지로 이동합니다.

GPU Server 상세 페이지에서 이미지 생성 버튼을 클릭하세요. Image 생성 페이지로 이동합니다.

- 서비스 정보 입력 영역에서 필요한 정보를 입력하세요.

구분 필수 여부상세 설명 이미지명 필수 생성할 이미지의 이름 - 영문, 숫자, 공백과 특수문자(

-_)를 사용하여 200자 이내로 입력

표. Image 서비스 정보 입력 항목 - 영문, 숫자, 공백과 특수문자(

- 서비스 정보 입력 영역에서 필요한 정보를 입력하세요.

입력 정보를 확인하고, 완료 버튼을 클릭하세요.

- 생성이 완료되면, 모든 서비스 > Compute > GPU Server > Image 목록 페이지에서 생성한 자원을 확인하세요.

- Image를 생성하면 생성된 Image를 내부 저장소로 사용되는 Object Storage에 저장하게됩니다. 따라서 Image 저장에 대한 Object Storage 사용 요금이 부과 됩니다.

- Active 상태인 GPU Server로부터 생성된 이미지의 파일 시스템은 무결성을 보장할 수 없으므로 서버 정지 후 이미지 생성을 권장합니다.

ServiceWatch 세부 모니터링 활성화하기

기본적으로 GPU Server는 ServiceWatch와 Virtual Server 네임스페이스의 기본 모니터링으로 연계되어 있습니다. 필요에 따라 세부 모니터링을 활성화하여 운영 문제를 보다 신속하게 식별하고 조치를 취할 수 있습니다. ServiceWatch에 대한 자세한 내용은 ServiceWatch 개요를 참조하세요.

GPU Server의 ServiceWatch 세부 모니터링 활성화하려면 다음 절차를 따르세요.

- 모든 서비스 > Compute > GPU Server 메뉴를 클릭하세요. GPU Server의 Service Home 페이지로 이동합니다.

- Service Home 페이지에서 GPU Server 메뉴를 클릭하세요. GPU Server 목록 페이지로 이동합니다.

- GPU Server 목록 페이지에서 ServiceWatch 세부 모니터링 활성화할 자원을 클릭하세요. GPU Server 상세 페이지로 이동합니다.

- GPU Server 상세 페이지에서 ServiceWatch 세부 모니터링 수정 버튼을 클릭하세요. ServiceWatch 세부 모니터링 수정 팝업창으로 이동합니다.

- ServiceWatch 세부 모니터링 수정 팝업창에서 활성화 선택한 후, 안내 문구를 확인하고 확인 버튼을 클릭하세요.

- GPU Server 상세 페이지에서 ServiceWatch 세부 모니터링 항목을 확인하세요.

ServiceWatch 세부 모니터링 비활성화 하기

GPU Server의 ServiceWatch 세부 모니터링 비활성화하려면 다음 절차를 따르세요.

- 모든 서비스 > Compute > GPU Server 메뉴를 클릭하세요. GPU Server의 Service Home 페이지로 이동합니다.

- Service Home 페이지에서 GPU Server 메뉴를 클릭하세요. GPU Server 목록 페이지로 이동합니다.

- GPU Server 목록 페이지에서 ServiceWatch 세부 모니터링 비활성화할 자원을 클릭하세요. GPU Server 상세 페이지로 이동합니다.

- GPU Server 상세 페이지에서 ServiceWatch 세부 모니터링 수정 버튼을 클릭하세요. ServiceWatch 세부 모니터링 수정 팝업창으로 이동합니다.

- ServiceWatch 세부 모니터링 수정 팝업창에서 활성화 선택 해제한 후, 안내 문구를 확인하고 확인 버튼을 클릭하세요.

- GPU Server 상세 페이지에서 ServiceWatch 세부 모니터링 항목을 확인하세요.

GPU Server 관리 부가 기능

GPU Server 서버 관리를 위해 Console 로그 조회, Dump 생성, Rebuild를 할 수 있습니다. GPU Server의 Console 로그 조회, Dump 생성, Rebuild를 하려면 다음 절차를 따르세요.

콘솔 로그 확인하기

GPU Server의 현재 콘솔 로그를 확인할 수 있습니다.

GPU Server의 콘솔 로그 확인하려면 다음 절차를 따르세요.

- 모든 서비스 > Compute > GPU Server 메뉴를 클릭하세요. GPU Server의 Service Home 페이지로 이동합니다.

- Service Home 페이지에서 GPU Server 메뉴를 클릭하세요. GPU Server 목록 페이지로 이동합니다.

- GPU Server 목록 페이지에서 콘솔 로그를 확인할 자원을 클릭하세요. GPU Server 상세 페이지로 이동합니다.

- GPU Server 상세 페이지에서 콘솔 로그 버튼을 클릭하세요. 콘솔 로그 팝업창으로 이동합니다.

- 콘솔 로그 팝업창에서 출력된 콘솔 로그를 확인합니다.

Dump 생성하기

GPU Server의 Dump 파일을 생성하려면 다음 절차를 따르세요.

- 모든 서비스 > Compute > GPU Server 메뉴를 클릭하세요. GPU Server의 Service Home 페이지로 이동합니다.

- Service Home 페이지에서 GPU Server 메뉴를 클릭하세요. GPU Server 목록 페이지로 이동합니다.

- GPU Server 목록 페이지에서 상세 정보를 확인할 자원을 클릭하세요. GPU Server 상세 페이지로 이동합니다.

- GPU Server 상세 페이지에서 Dump 생성 버튼을 클릭하세요.

- Dump 파일은 GPU Server 안에 생성됩니다.

Rebuild 수행하기

기존 GPU Server 서버의 모든 데이터와 설정을 삭제하고, 새로운 서버로 Rebuild하여 구성할 수 있습니다.

GPU Server의 Rebuild를 수행하려면 다음 절차를 따르세요.

- 모든 서비스 > Compute > GPU Server 메뉴를 클릭하세요. GPU Server의 Service Home 페이지로 이동합니다.

- Service Home 페이지에서 GPU Server 메뉴를 클릭하세요. GPU Server 목록 페이지로 이동합니다.

- GPU Server 목록 페이지에서 Rebuild를 수행할 자원을 클릭하세요. GPU Server 상세 페이지로 이동합니다.

- GPU Server 상세 페이지에서 Rebuild 버튼을 클릭하세요.

- GPU Server Rebuild 중에는 서버 상태가 Rebuilding로 변경되었다가 Rebuild가 완료되면 Rebuild 수행 전 상태로 돌아옵니다.

- GPU Server 상태에 대한 자세한 내용은 GPU Server 상세 정보 확인하기를 참고하세요.

GPU Server 해지하기

사용하지 않는 GPU Server를 해지하면 운영 비용을 절감할 수 있습니다. 단, GPU Server를 해지하면 운영 중인 서비스가 즉시 중단될 수 있으므로 서비스 중단 시 발생하는 영향을 충분히 고려한 후 해지 작업을 진행해야 합니다.

GPU Server를 해지하려면 다음 절차를 따르세요.

- 모든 서비스 > Compute > GPU Server 메뉴를 클릭하세요. GPU Server의 Service Home 페이지로 이동합니다.

- Service Home 페이지에서 GPU Server 메뉴를 클릭하세요. GPU Server 목록 페이지로 이동합니다.

- GPU Server 목록 페이지에서 해지할 자원을 선택하고, 서비스 해지 버튼을 클릭하세요.

- 연결된 스토리지의 해지는 Delete on termination 설정에 따라 다르오니, 해지 제약 사항을 참고하세요.

- 해지가 완료되면, GPU Server 목록 페이지에서 자원이 해지되었는지 확인하세요.

해지 제약 사항

GPU Server 해지 요청 시 해지가 불가한 경우에는 팝업창으로 안내합니다. 아래 케이스를 참고하세요.

- File Storage가 연결된 경우는 File Storage 연결을 먼저 해지해주세요.

- LB Pool이 연결된 경우는 LB Pool 연결을 먼저 해지해 주세요.

- Lock이 설정된 경우는 Lock 설정을 미사용으로 변경 후 재시도 해주세요.

연결된 스토리지의 해지는 Delete on termination 설정에 따라 달라집니다.

- Delete on termination 설정 여부에 따라 볼륨 삭제 여부도 달라집니다.

- Delete on termination 미설정 시: GPU Server를 해지해도 해당 볼륨이 삭제되지 않습니다.

- Delete on termination 설정 시: GPU Server를 해지하면 해당 볼륨이 삭제됩니다.

- Snapshot이 존재하는 볼륨은 Delete on termination이 설정되어도 삭제되지 않습니다.

- Multi attach 볼륨은 삭제하려는 서버가 볼륨에 연결된 마지막 남은 서버일 때만 삭제됩니다.

2.1 - Image 관리하기

사용자는 Samsung Cloud Platform Console을 통해 GPU Server 서비스 내 Image 서비스의 필수 정보를 입력하고, 상세 옵션을 선택하여 해당 해당 서비스를 생성할 수 있습니다.

Image 생성하기

가동 중인 GPU Server 서버의 Image를 생성할 수 있습니다. GPU Server의 Image를 생성하려면 Image 생성하기를 참고해주세요.

Image 상세 정보 확인하기

Image 서비스는 전체 자원 목록과 상세 정보를 확인하고 수정할 수 있습니다. Image 상세 페이지에서는 상세 정보, 태그, 작업 이력 탭으로 구성되어 있습니다.

Image 서비스의 상세 정보를 확인하려면 다음 절차를 따르세요.

- 모든 서비스 > Compute > GPU Server 메뉴를 클릭하세요. GPU Server의 Service Home 페이지로 이동합니다.

- Service Home 페이지에서 Image 메뉴를 클릭하세요. Image 목록 페이지로 이동합니다.

- Image 목록 페이지에서 상세 정보를 확인할 자원을 클릭하세요. Image 상세 페이지로 이동합니다.

- Image 상세 페이지에는 상태 정보 및 부가 기능 정보가 표시되며, 상세 정보, 태그, 작업 이력 탭으로 구성됩니다.

구분 상세 설명 이미지 상태 사용자가 생성한 Image의 상태 - Active: 사용 가능한 상태

- Queued: Image 생성 생성 시, Image가 업로드 되어 처리 대기 중인 상태

- Importing: Image 생성 생성 시, Image가 업로드 되어 처리 중인 상태

다른 Account로 공유 Image를 다른 Account로 공유 가능 - Image의 Visibility가 Shared 상태이어야만 다른 Account로 공유 가능

이미지 삭제 Image를 삭제하는 버튼 - Image를 삭제하면 복구 불가

표. GPU Server Image 상태 정보 및 부가 기능

- Image 상세 페이지에는 상태 정보 및 부가 기능 정보가 표시되며, 상세 정보, 태그, 작업 이력 탭으로 구성됩니다.

상세 정보

Image 목록 페이지에서 선택한 자원의 상세 정보를 확인하고, 필요한 경우 정보를 수정할 수 있습니다.

| 구분 | 상세 설명 |

|---|---|

| 서비스 | 서비스명 |

| 자원 유형 | 자원 유형 |

| SRN | Samsung Cloud Platform에서의 고유 자원 ID

|

| 자원명 | Image 이름 |

| 자원 ID | Image ID |

| 생성자 | Image를 생성한 사용자 |

| 생성 일시 | Image를 생성한 일시 |

| 수정자 | Image를 수정한 사용자 |

| 수정 일시 | Image를 수정한 일시 |

| 이미지명 | Image 이름 |

| 최소 디스크 | Image의 최소 디스크 용량(GB)

|

| 최소 RAM | Image의 최소 RAM 용량(GB) |

| OS 타입 | Image의 OS 타입 |

| OS hash algorithm | OS hash algorithm 방식 |

| Visibility | 이미지에 대한 접근 권한을 표시

|

| Protected | 이미지 삭제 불가 여부를 선택

|

| 이미지 파일 URL | 이미지 생성 시 업로드 한 이미지 파일 URL

|

| 공유 현황 | 다른 Account로 이미지를 공유하고 있는 현황

|

태그

Image 목록 페이지에서 선택한 자원의 태그 정보를 확인하고, 추가하거나 변경 또는 삭제할 수 있습니다.

| 구분 | 상세 설명 |

|---|---|

| 태그 목록 | 태그 목록

|

작업 이력

Image 목록 페이지에서 선택한 자원의 작업 이력을 확인할 수 있습니다.

| 구분 | 상세 설명 |

|---|---|

| 작업 이력 목록 | 자원 변경 이력

|

Image 자원 관리하기

생성된 Image 의 제어 및 관리 기능을 설명합니다.

다른 Account로 공유하기

Image를 다른 Account로 공유하려면 다음 절차를 따르세요.

- 공유할 Account에 접속하여 모든 서비스 > Compute > GPU Server 메뉴를 클릭하세요. GPU Server의 Service Home 페이지로 이동합니다.

- Service Home 페이지에서 Image 메뉴를 클릭하세요. Image 목록 페이지로 이동합니다.

- Image 목록 페이지에서 제어할 Image를 클릭하세요. Image 상세 페이지로 이동합니다.

- 다른 Account로 공유 버튼을 클릭하세요. 다른 Account로 이미지 공유 페이지로 이동합니다.

- 다른 Account로 공유 기능을 통해 Image를 다른 Account로 공유할 수 있습니다. Image를 다른 Account로 공유하려면 Image의 Visibility가 Shared이어야 합니다.

- 다른 Account로 이미지 공유 페이지에서 필요한 정보를 입력하고 완료 버튼을 클릭하세요.

구분 필수 여부상세 설명 이미지명 - 공유할 이미지의 이름 - 입력 불가

이미지 ID - 공유할 이미지 ID - 입력 불가

공유 Account ID 필수 공유할 다른 Account ID 입력 - 영문, 숫자, 특수문자

-를 사용하여 64자 이내로 입력

표. 다른 Account로 이미지 공유 필수 입력 항목 - Image 상세 페이지의 공유 현황에서 정보를 확인할 수 있습니다.

- 최초 요청 시에는 상태가 Pending 이고, 공유 받을 Account에서 승인이 완료되면 Accepted로 변경됩니다.

다른 Account로부터 공유받기

Image를 다른 Account로부터 공유받으려면 다음 절차를 따르세요.

- 공유 받을 Account에 접속하여 모든 서비스 > Compute > GPU Server 메뉴를 클릭하세요. GPU Server의 Service Home 페이지로 이동합니다.

- Service Home 페이지에서 Image 메뉴를 클릭하세요. Image 목록 페이지로 이동합니다.

- Image 목록 페이지에서 이미지 공유 받기 버튼을 클릭하세요. 이미지 공유 받기 팝업창으로 이동합니다.

- 이미지 공유 받기 팝업창에서 공유 받고자 하는 Image의 자원 ID를 입력하고, 확인 버튼을 클릭하세요.

- 이미지 공유 받기가 완료되면 Image 목록에서 공유받은 Image를 확인할 수 있습니다.

Image 삭제하기

사용하지 않는 Image를 삭제할 수 있습니다. 단, Image를 삭제하면 복구할 수 없으므로 Image 삭제 시에는 발생하는 영향을 충분히 고려한 후 삭제 작업을 진행해야 합니다.

Image를 삭제하려면 다음 절차를 따르세요.

- 모든 서비스 > Compute > GPU Server 메뉴를 클릭하세요. GPU Server의 Service Home 페이지로 이동합니다.

- Service Home 페이지에서 Image 메뉴를 클릭하세요. Image 목록 페이지로 이동합니다.

- Image 목록 페이지에서 삭제할 자원을 선택하고, 삭제 버튼을 클릭하세요.

- Image 목록 페이지에서 다수의 Image 체크 박스를 선택하고, 자원 목록 상단의 삭제 버튼을 클릭하세요.

- 삭제가 완료되면 Image 목록 페이지에서 자원이 삭제되었는지 확인하세요.

2.2 - Keypair 관리하기

사용자는 Samsung Cloud Platform Console을 통해 GPU Server 서비스 내 Keypair의 필수 정보를 입력하고, 상세 옵션을 선택하여 해당 서비스를 생성할 수 있습니다.

Keypair 생성하기

Samsung Cloud Platform Console에서 GPU Server 서비스를 사용하면서 Keypair 서비스를 생성하여 사용할 수 있습니다.

Keypair 생성하려면 다음 절차를 따르세요.

- 모든 서비스 > Compute > GPU Server 메뉴를 클릭하세요. GPU Server의 Service Home 페이지로 이동합니다.

- Service Home 페이지에서 Keypair 메뉴를 클릭하세요. Keypair 목록 페이지로 이동합니다.

- Keypair 목록 페이지에서 Keypair 생성 버튼을 클릭하세요. Keypair 생성 페이지로 이동합니다.

- 서비스 정보 입력 영역에서 필요한 정보를 입력하세요.

구분 필수 여부상세 설명 Keypair명 필수 생성할 Keypair의 이름 - 영문, 숫자, 공백과 특수문자(

-,_)를 사용하여 255자 이내로 입력

Keypair 유형 필수 ssh 표. Keypair 서비스 정보 입력 항목 - 영문, 숫자, 공백과 특수문자(

- 추가 정보 입력 영역에서 필요한 정보를 입력 또는 선택하세요.

구분 필수 여부상세 설명 태그 선택 태그 추가 - 자원 당 최대 50개까지 추가 가능

- 태그 추가 버튼을 클릭한 후 Key, Value 값을 입력 또는 선택

표. Keypair 추가 정보 입력 항목주의- 생성 완료 후 최초 1회에 한해서 Key를 다운로드할 수 있습니다. 재발급이 불가능하므로, 다운로드 되었는지 확인하세요.

- 다운로드 받은 Private Key는 안전한 곳에 저장하세요.

- 서비스 정보 입력 영역에서 필요한 정보를 입력하세요.

- 입력 정보를 확인하고, 완료 버튼을 클릭하세요.

- 생성이 완료되면, Keypair 목록 페이지에서 생성한 자원을 확인하세요.

Keypair 상세 정보 확인하기

Keypair 서비스는 전체 자원 목록과 상세 정보를 확인하고 수정할 수 있습니다. Keypair 상세 페이지에서는 상세 정보, 태그, 작업 이력 탭으로 구성되어 있습니다.

Keypair 상세 정보를 확인하려면 다음 절차를 따르세요.

- 모든 서비스 > Compute > GPU Server 메뉴를 클릭하세요. GPU Server의 Service Home 페이지로 이동합니다.

- Service Home 페이지에서 Keypair 메뉴를 클릭하세요. Keypair 목록 페이지로 이동합니다.

- Keypair 목록 페이지에서 상세 정보를 확인할 자원을 클릭하세요. Keypair 상세 페이지로 이동합니다.

- Keypair 상세 페이지에는 상태 정보 및 부가 기능 정보가 표시되며, 상세 정보, 태그, 작업 이력 탭으로 구성됩니다.

상세 정보

Keypair 목록 페이지에서 선택한 자원의 상세 정보를 확인하고, 필요한 경우 정보를 수정할 수 있습니다.

| 구분 | 상세 설명 |

|---|---|

| 서비스 | 서비스명 |

| 자원 유형 | 자원 유형 |

| SRN | Samsung Cloud Platform에서의 고유 자원 ID

|

| 자원명 | Keypair 이름 |

| 자원 ID | Keypair의 고유 자원 ID |

| 생성자 | Keypair를 생성한 사용자 |

| 생성 일시 | Keypair를 생성한 일시 |

| 수정자 | Keypair 정보를 수정한 사용자 |

| 수정 일시 | Keypair정보를 수정한 일시 |

| Keypair명 | Keypair 이름 |

| Fingerprint | Key를 식별하기 위한 고유한 값 |

| 사용자 ID | Keypair 생성한 사용자 ID |

| 공개 키 | 공개 키 정보 |

태그

Keypair 목록 페이지에서 선택한 자원의 태그 정보를 확인하고, 추가하거나 변경 또는 삭제할 수 있습니다.

| 구분 | 상세 설명 |

|---|---|

| 태그 목록 | 태그 목록

|

작업 이력

Keypair 목록 페이지에서 선택한 자원의 작업 이력을 확인할 수 있습니다.

| 구분 | 상세 설명 |

|---|---|

| 작업 이력 목록 | 자원 변경 이력

|

Keypair 자원 관리하기

Keypair의 제어 및 관리 기능을 설명합니다.

공개 키 가져오기

공개 키 가져오기를 하려면 다음 절차를 따르세요.

모든 서비스 > Compute > GPU Server 메뉴를 클릭하세요. GPU Server의 Service Home 페이지로 이동합니다.

Service Home 페이지에서 Keypair 메뉴를 클릭하세요. Keypair 목록 페이지로 이동합니다.

Keypair 목록 페이지에서 상단의 더보기 버튼을 클릭하여 공개 키 가져오기 버튼을 클릭하세요. 공개 키 가져오기 페이지로 이동합니다.

- 필수 정보 입력 영역에 필요한 정보를 입력 또는 선택하세요.

구분 필수 여부상세 설명 Keypair명 필수 생성할 Keypair 이름 Keypair 유형 필수 ssh 공개 키 필수 공개 키 입력 - 파일 불러오기: 파일 첨부 버튼을 선택하여 공개 키 파일을 첨부

- 첨부 파일은 다음의 확장자 파일(.pem)만 가능

- 공개 키 입력: 복사한 공개 키 값을 붙여넣기

- Keypair 상세 페이지에서 공개 키 값을 복사 가능

표. 공개 키 가져오기 필수 입력 항목 - 파일 불러오기: 파일 첨부 버튼을 선택하여 공개 키 파일을 첨부

- 필수 정보 입력 영역에 필요한 정보를 입력 또는 선택하세요.

입력한 정보를 확인하고, 완료 버튼을 클릭하세요.

- 생성이 완료되면, Keypair 목록 페이지에서 생성한 자원을 확인하세요.

Keypair 삭제하기

사용하지 않는 Keypair를 삭제할 수 있습니다. 단, Keypair를 삭제하면 복구할 수 없으므로 사전에 충분한 영향도 검토 후 삭제를 진행하시기 바랍니다.

Keypair를 삭제하려면 다음 절차를 따르세요.

- 모든 서비스 > Compute > GPU Server 메뉴를 클릭하세요. GPU Server의 Service Home 페이지로 이동합니다.

- Service Home 페이지에서 Keypair 메뉴를 클릭하세요. Keypair 목록 페이지로 이동합니다.

- Keypair 목록 페이지에서 삭제할 자원을 선택하고, 삭제 버튼을 클릭하세요.

- Keypair 목록 페이지에서 다수의 Keypair 체크 박스를 선택하고, 자원 목록 상단의 삭제 버튼을 클릭하세요.

- 삭제가 완료되면 Keypair 목록 페이지에서 자원이 삭제되었는지 확인하세요.

2.3 - GPU Server에서 Multi-instance GPU 사용하기

GPU Server를 생성한 후 GPU Server의 VM(Guest OS)에서 MIG (Multi-instance GPU) 기능을 활성화하고 Instance를 생성해 사용할 수 있습니다.

Multi-instance GPU (NVIDIA A100) 살펴보기

NVIDIA A100은 NVIDIA 암페어(Ampere) 아키텍처를 기반으로 하는 Multi-instance GPU(MIG)로, 최대 7개의 독립된 GPU Instance로 안전하게 분할되어 CUDA (Compute Unified Device Architecture, 연산통합 장치설계) Application을 운용할 수 있습니다. NVIDIA A100은 고대역폭 메모리(HBM: high bandwidth memory)와 캐시를 활용하는 동시에 GPU 사용에 최적화된 방식으로 컴퓨팅 자원을 할당함으로써 다수의 사용자들에게 독립적인 GPU 자원을 제공할 수 있습니다. 사용자는 각 워크로드의 병렬 실행을 통해 GPU 최대 연산 용량에 도달하지 않은 워크로드를 활용할 수 있으므로, GPU 사용율을 극대화할 수 있습니다.

Multi-instance GPU 기능 사용하기

Multi-instance GPU 기능을 사용하려면 Samsung Cloud Platform에서 GPU Server 서비스를 생성한 후 A100 GPU가 할당된 VM Instance(GuestOS)를 생성해야 합니다. GPU Server 생성 완료 후, 아래의 MIG 적용 순서와 MIG 해제 순서를 따라 적용해볼 수 있습니다.

- MIG 기능을 사용하기 위한 시스템 요구사항은 다음과 같습니다(NVIDIA - Supported GPUs 참고).

- CUDA toolkit 11, NVIDIA driver 450.80.02 또는 이후 버전

- CUDA toolkit 11을 지원하는 리눅스 배포 운영체제

- 컨테이너 또는 쿠버네티스 서비스 운용 시 MIG 기능을 사용하기 위한 요구사항은 다음과 같습니다.

- NVIDIA Container Toolkit(nvidia-docker2) v 2.5.0 또는 이후 버전

- NVIDIA K8s Device Plugin v 0.7.0 또는 이후 버전

- NVIDIA gpu-feature-discovery v 0.2.0 또는 이후 버전

MIG 적용 및 사용하기

MIG를 활성화하고 Instance를 생성해 작업을 할당하려면 다음 절차를 따르세요.

MIG 활성화

MIG를 적용하기 전 VM Instance(GuestOS)에서 GPU 상태를 확인하세요.

- MIG mode가 Disabled 상태인지 확인하세요.배경색 변경

$ nvidia-smi Mon Sep 27 08:37:08 2021 +-----------------------------------------------------------------------------+ | NVIDIA-SMI 470.57.02 Driver Version: 470.57.02 CUDA Version: 11.4 | |-------------------------------+----------------------+----------------------| | GPU Name Persistence-M| Bus-Id Disp.A | Volatile Uncorr. ECC | | Fan Temp Perf Pwr:Usage/Cap| Memory-Usage | GPU-Util Compute M. | | | | MIG M. | |===============================+======================+======================| | 0 NVDIA A100-SXM... Off | 00000000:05:00.0 Off | 0 | | N/A 32C P0 59W / 400W | 0MiB / 81251MiB | 0% Default | | | | Disabled | +-------------------------------+----------------------+----------------------+ +-----------------------------------------------------------------------------+ | Processes: | | GPU GI CI PID Type Process name GPU Memory | | ID ID Usage | |=============================================================================| | No running processes found | +-----------------------------------------------------------------------------+$ nvidia-smi Mon Sep 27 08:37:08 2021 +-----------------------------------------------------------------------------+ | NVIDIA-SMI 470.57.02 Driver Version: 470.57.02 CUDA Version: 11.4 | |-------------------------------+----------------------+----------------------| | GPU Name Persistence-M| Bus-Id Disp.A | Volatile Uncorr. ECC | | Fan Temp Perf Pwr:Usage/Cap| Memory-Usage | GPU-Util Compute M. | | | | MIG M. | |===============================+======================+======================| | 0 NVDIA A100-SXM... Off | 00000000:05:00.0 Off | 0 | | N/A 32C P0 59W / 400W | 0MiB / 81251MiB | 0% Default | | | | Disabled | +-------------------------------+----------------------+----------------------+ +-----------------------------------------------------------------------------+ | Processes: | | GPU GI CI PID Type Process name GPU Memory | | ID ID Usage | |=============================================================================| | No running processes found | +-----------------------------------------------------------------------------+코드블록. nvidia-smi 명령어 - GPU 비활성화 상태 확인 (1) 배경색 변경$ nvidia-smi –L GPU 0: NVIDIA A100-SXM-80GB (UUID: GPU-c956838f-494a-92b2-6818-56eb28fe25e0)$ nvidia-smi –L GPU 0: NVIDIA A100-SXM-80GB (UUID: GPU-c956838f-494a-92b2-6818-56eb28fe25e0)코드블록. nvidia-smi 명령어 - GPU 비활성화 상태 확인 (2)

- MIG mode가 Disabled 상태인지 확인하세요.

VM Instance(GuestOS)에서 GPU별로 MIG를 활성화(Enable)하고 VM Instance를 재부팅하세요.

배경색 변경$ nvidia-smi –I 0 –mig 1 Enabled MIG mode for GPU 00000000:05:00.0 All done. # reboot$ nvidia-smi –I 0 –mig 1 Enabled MIG mode for GPU 00000000:05:00.0 All done. # reboot코드블록. nvidia-smi 명령어 - MIG 활성화

GPU 모니터링 에이전트가 다음과 같은 경고 메시지를 표시하는 경우, MIG를 활성화하기 전에 nvsm 및 dcgm 서비스를 중단하세요.

Warning: MIG mode is in pending enable state for GPU 00000000:05:00.0: In use by another client. 00000000:05:00.0 is currently being used by one or more other processes (e.g. CUDA application or a monitoring application such as another instance of nvidia-smi).

# systemctl stop nvsm

# systemctl stop dcgm

- MIG 작업을 마친 후 nvsm 및 dcgm 서비스를 다시 시작하세요.

- VM Instance(GuestOS)에서 MIG를 적용한 후 GPU 상태를 확인하세요.

- MIG mode가 Enabled 상태인지 확인하세요.배경색 변경

$ nvidia-smi Mon Sep 27 09:44:33 2021 +-----------------------------------------------------------------------------+ | NVIDIA-SMI 470.57.02 Driver Version: 470.57.02 CUDA Version: 11.4 | |-------------------------------+----------------------+----------------------| | GPU Name Persistence-M| Bus-Id Disp.A | Volatile Uncorr. ECC | | Fan Temp Perf Pwr:Usage/Cap| Memory-Usage | GPU-Util Compute M. | | | | MIG M. | |===============================+======================+======================| | 0 NVDIA A100-SXM... Off | 00000000:05:00.0 Off | On | | N/A 32C P0 59W / 400W | 0MiB / 81251MiB | 0% Default | | | | Enabled | +-------------------------------+----------------------+----------------------+ +-----------------------------------------------------------------------------+ | MIG devices: | +-----------------------------------------------------------------------------+ | GPU GI CI MIG | Memory-Usage | Vol| Shared | | ID ID Dev | BAR1-Usage | SM Unc| CE ENC DEC OFA JPG| | | | ECC| | |=============================================================================| | No MIG devices found | +-----------------------------------------------------------------------------+ +-----------------------------------------------------------------------------+ | Processes: | | GPU GI CI PID Type Process name GPU Memory | | ID ID Usage | |=============================================================================| | No running processes found | +-----------------------------------------------------------------------------+$ nvidia-smi Mon Sep 27 09:44:33 2021 +-----------------------------------------------------------------------------+ | NVIDIA-SMI 470.57.02 Driver Version: 470.57.02 CUDA Version: 11.4 | |-------------------------------+----------------------+----------------------| | GPU Name Persistence-M| Bus-Id Disp.A | Volatile Uncorr. ECC | | Fan Temp Perf Pwr:Usage/Cap| Memory-Usage | GPU-Util Compute M. | | | | MIG M. | |===============================+======================+======================| | 0 NVDIA A100-SXM... Off | 00000000:05:00.0 Off | On | | N/A 32C P0 59W / 400W | 0MiB / 81251MiB | 0% Default | | | | Enabled | +-------------------------------+----------------------+----------------------+ +-----------------------------------------------------------------------------+ | MIG devices: | +-----------------------------------------------------------------------------+ | GPU GI CI MIG | Memory-Usage | Vol| Shared | | ID ID Dev | BAR1-Usage | SM Unc| CE ENC DEC OFA JPG| | | | ECC| | |=============================================================================| | No MIG devices found | +-----------------------------------------------------------------------------+ +-----------------------------------------------------------------------------+ | Processes: | | GPU GI CI PID Type Process name GPU Memory | | ID ID Usage | |=============================================================================| | No running processes found | +-----------------------------------------------------------------------------+코드블록. nvidia-smi 명령어 - GPU 활성화 상태 확인 (1) 배경색 변경$ nvidia-smi –L GPU 0: NVIDIA A100-SXM-80GB (UUID: GPU-c956838f-494a-92b2-6818-56eb28fe25e0)$ nvidia-smi –L GPU 0: NVIDIA A100-SXM-80GB (UUID: GPU-c956838f-494a-92b2-6818-56eb28fe25e0)코드블록. nvidia-smi 명령어 - GPU 활성화 상태 확인 (2)

- MIG mode가 Enabled 상태인지 확인하세요.

GPU Instance 생성

MIG 활성화하고 상태를 확인하였다면, GPU Instance를 생성할 수 있습니다.

생성할 수 있는 MIG GPU Instance 프로파일 목록을 확인하세요.

배경색 변경$ nvidia-smi mig -i [GPU ID] -lgip$ nvidia-smi mig -i [GPU ID] -lgip코드블록. nvidia-smi 명령어 - MIG GPU Instance 프로파일 목록 확인 배경색 변경$ nvidia-smi mig -i 0 -lgip +-----------------------------------------------------------------------------+ | GPU instance profiles: | | GPU Name ID Instances Memory P2P SM DEC ENC | | Free/Total GiB CE JPEG OFA | |=============================================================================| | 0 MIG 1g.10gb 19 7/7 9.50 No 14 0 0 | | 1 0 0 | +-----------------------------------------------------------------------------+ | 0 MIG 1g.10gb+me 20 1/1 9.50 No 14 0 0 | | 1 1 1 | +-----------------------------------------------------------------------------+ | 0 MIG 2g.20gb 14 3/3 19.50 No 28 1 0 | | 2 0 0 | +-----------------------------------------------------------------------------+ | 0 MIG 3g.40gb 9 2/2 39.50 No 42 2 0 | | 3 0 0 | +-----------------------------------------------------------------------------+ | 0 MIG 4g.40gb 5 1/1 39.50 No 56 2 0 | | 4 0 0 | +-----------------------------------------------------------------------------+ | 0 MIG 7g.80gb 0 1/1 79.25 No 98 0 0 | | 7 1 1 | +-----------------------------------------------------------------------------+$ nvidia-smi mig -i 0 -lgip +-----------------------------------------------------------------------------+ | GPU instance profiles: | | GPU Name ID Instances Memory P2P SM DEC ENC | | Free/Total GiB CE JPEG OFA | |=============================================================================| | 0 MIG 1g.10gb 19 7/7 9.50 No 14 0 0 | | 1 0 0 | +-----------------------------------------------------------------------------+ | 0 MIG 1g.10gb+me 20 1/1 9.50 No 14 0 0 | | 1 1 1 | +-----------------------------------------------------------------------------+ | 0 MIG 2g.20gb 14 3/3 19.50 No 28 1 0 | | 2 0 0 | +-----------------------------------------------------------------------------+ | 0 MIG 3g.40gb 9 2/2 39.50 No 42 2 0 | | 3 0 0 | +-----------------------------------------------------------------------------+ | 0 MIG 4g.40gb 5 1/1 39.50 No 56 2 0 | | 4 0 0 | +-----------------------------------------------------------------------------+ | 0 MIG 7g.80gb 0 1/1 79.25 No 98 0 0 | | 7 1 1 | +-----------------------------------------------------------------------------+코드블록. MIG GPU Instance 프로파일 목록

| Profile Name | Fraction of Memory | Fraction of SMs | Hardware Units | L2 Cache Size | Number of Instances Available |

|---|---|---|---|---|---|

| MIG 1g.10gb | 1/8 | 1/7 | 0 NVDECs /0 JPEG /0 OFA | 1/8 | 7 |

| MIG 1g.10gb+me | 1/8 | 1/7 | 1 NVDEC /1 JPEG /1 OFA | 1/8 | 1 (A single 1g profile can include media extensions) |

| MIG 2g.20gb | 2/8 | 2/7 | 1 NVDECs /0 JPEG /0 OFA | 2/8 | 3 |

| MIG 3g.40gb | 4/8 | 3/7 | 2 NVDECs /0 JPEG /0 OFA | 4/8 | 2 |

| MIG 4g.40gb | 4/8 | 4/7 | 2 NVDECs /0 JPEG /0 OFA | 4/8 | 1 |

| MIG 7g.80gb | Full | 7/7 | 5 NVDECs /1 JPEG /1 OFA | Full | 1 |

- MIG GPU Instance를 생성한 후 확인하세요.

GPU Instance 생성

배경색 변경$ nvidia-smi mig -i [GPU ID] -cgi [Profile ID]$ nvidia-smi mig -i [GPU ID] -cgi [Profile ID]코드블록. nvidia-smi 명령어 - GPU Instance 생성 배경색 변경$ nvidia-smi mig -i 0 -cgi 0 Successfully created GPU instance ID 0 on GPU 0 using profile MIG 7g.80gb (ID 0)$ nvidia-smi mig -i 0 -cgi 0 Successfully created GPU instance ID 0 on GPU 0 using profile MIG 7g.80gb (ID 0)코드블록. nvidia-smi 명령어 - GPU Instance 생성 예시 GPU Instance 확인

배경색 변경$ nvidia-smi mig -i [GPU ID] -lgi$ nvidia-smi mig -i [GPU ID] -lgi코드블록. nvidia-smi 명령어 - GPU Instance 확인 배경색 변경$ nvidia-smi mig -i 0 -lgi +--------------------------------------------------------+ | GPU instances: | | GPU Name Profile Instance Placement | | ID ID Start:Size | |========================================================| | 0 MIG 7g.80gb 0 0 0:8 | +--------------------------------------------------------+$ nvidia-smi mig -i 0 -lgi +--------------------------------------------------------+ | GPU instances: | | GPU Name Profile Instance Placement | | ID ID Start:Size | |========================================================| | 0 MIG 7g.80gb 0 0 0:8 | +--------------------------------------------------------+코드블록. nvidia-smi 명령어 - GPU Instance 확인 예시

Compute Instance 생성

GPU Instance를 생성하였다면, Compute Instance를 생성할 수 있습니다.

생성할 수 있는 MIG Compute Instance 프로파일을 확인하세요.

배경색 변경$ nvidia-smi mig -i [GPU ID] -gi [GPU Instance ID] -lcip$ nvidia-smi mig -i [GPU ID] -gi [GPU Instance ID] -lcip코드블록. nvidia-smi 명령어 - MIG Compute Instance 프로파일 확인 배경색 변경$ nvidia-smi mig -i 0 -gi 0 -lcip +---------------------------------------------------------------------------------+ | Compute instance profiles: | | GPU GPU Name Profile Instances Exclusive Shared | | GPU Instance ID Free/Total SM DEC ENC OFA | | ID CE JPEG | |=================================================================================| | 0 0 MIG 1c.7g.80gb 0 7/7 14 5 0 1 | | 7 1 | +---------------------------------------------------------------------------------+ | 0 0 MIG 2c.7g.80gb 1 3/3 28 5 0 1 | | 7 1 | +---------------------------------------------------------------------------------+ | 0 0 MIG 3c.7g.80gb 2 2/2 42 5 0 1 | | 7 1 | +---------------------------------------------------------------------------------+ | 0 0 MIG 4c.7g.80gb 3 1/1 56 5 0 1 | | 7 1 | +---------------------------------------------------------------------------------+ | 0 0 MIG 7g.80gb 4* 1/1 98 5 0 1 | | 7 1 | +---------------------------------------------------------------------------------+$ nvidia-smi mig -i 0 -gi 0 -lcip +---------------------------------------------------------------------------------+ | Compute instance profiles: | | GPU GPU Name Profile Instances Exclusive Shared | | GPU Instance ID Free/Total SM DEC ENC OFA | | ID CE JPEG | |=================================================================================| | 0 0 MIG 1c.7g.80gb 0 7/7 14 5 0 1 | | 7 1 | +---------------------------------------------------------------------------------+ | 0 0 MIG 2c.7g.80gb 1 3/3 28 5 0 1 | | 7 1 | +---------------------------------------------------------------------------------+ | 0 0 MIG 3c.7g.80gb 2 2/2 42 5 0 1 | | 7 1 | +---------------------------------------------------------------------------------+ | 0 0 MIG 4c.7g.80gb 3 1/1 56 5 0 1 | | 7 1 | +---------------------------------------------------------------------------------+ | 0 0 MIG 7g.80gb 4* 1/1 98 5 0 1 | | 7 1 | +---------------------------------------------------------------------------------+코드블록. MIG Compute Instance 프로파일 목록 예시 MIG Compute Instance를 생성하고 확인하세요.

- MIG Compute Instance 생성배경색 변경

$ nvidia-smi mig -i [GPU ID] -gi [GPU Instance ID] -cci [Compute Profile ID]$ nvidia-smi mig -i [GPU ID] -gi [GPU Instance ID] -cci [Compute Profile ID]코드블록. nvidia-smi 명령어 - MIG Compute Instance 생성 배경색 변경$ nvidia-smi mig -i 0 -gi 0 -cci 4 Successfully created compute instance ID 0 on GPU instance ID 0 using profile MIG 7g.80gb(ID 4)$ nvidia-smi mig -i 0 -gi 0 -cci 4 Successfully created compute instance ID 0 on GPU instance ID 0 using profile MIG 7g.80gb(ID 4)코드블록. nvidia-smi 명령어 - MIG Compute Instance 생성 예시 - MIG Compute Instance 확인배경색 변경

$ nvidia-smi mig -i [GPU ID] -gi [GPU Instance ID] –lci$ nvidia-smi mig -i [GPU ID] -gi [GPU Instance ID] –lci코드블록. nvidia-smi 명령어 - MIG Compute Instance 확인 배경색 변경$ nvidia-smi mig -i 0 -gi 0 –lci +-----------------------------------------------------------------+ | Compute instance profiles: | | GPU GPU Name Profile Instances Placement | | GPU Instance ID ID Start:Size | | ID | |=================================================================| | 0 0 MIG 7g.80gb 4 0 0:7 | +-----------------------------------------------------------------+$ nvidia-smi mig -i 0 -gi 0 –lci +-----------------------------------------------------------------+ | Compute instance profiles: | | GPU GPU Name Profile Instances Placement | | GPU Instance ID ID Start:Size | | ID | |=================================================================| | 0 0 MIG 7g.80gb 4 0 0:7 | +-----------------------------------------------------------------+코드블록. MIG Compute Instance 확인 예시 배경색 변경$ nvidia-smi –L GPU 0: NVIDIA A100-SXM-80GB (UUID: GPU-c956838f-494a-92b2-6818-56eb28fe25e0) MIG 7g.80gb Device 0: (UUID: MIG-53e20040-758b-5ecb-948e-c626d03a9a32)$ nvidia-smi –L GPU 0: NVIDIA A100-SXM-80GB (UUID: GPU-c956838f-494a-92b2-6818-56eb28fe25e0) MIG 7g.80gb Device 0: (UUID: MIG-53e20040-758b-5ecb-948e-c626d03a9a32)코드블록. nvidia-smi 명령어 - GPU 상태 확인 (1) 배경색 변경$ nvidia-smi Mon Sep 27 09:52:17 2021 +-----------------------------------------------------------------------------+ | NVIDIA-SMI 470.57.02 Driver Version: 470.57.02 CUDA Version: 11.4 | |-------------------------------+----------------------+----------------------| | GPU Name Persistence-M| Bus-Id Disp.A | Volatile Uncorr. ECC | | Fan Temp Perf Pwr:Usage/Cap| Memory-Usage | GPU-Util Compute M. | | | | MIG M. | |===============================+======================+======================| | 0 NVDIA A100-SXM... Off | 00000000:05:00.0 Off | On | | N/A 32C P0 49W / 400W | 0MiB / 81251MiB | N/A Default | | | | Enabled | +-------------------------------+----------------------+----------------------+ +-----------------------------------------------------------------------------+ | MIG devices: | +-----------------------------------------------------------------------------+ | GPU GI CI MIG | Memory-Usage | Vol| Shared | | ID ID Dev | BAR1-Usage | SM Unc| CE ENC DEC OFA JPG| | | | ECC| | |=============================================================================| | 0 0 0 0 | 0MiB / 81251MiB | 98 0 | 7 0 5 1 1 | | | 1MiB / 13107... | | | +-----------------------------------------------------------------------------+ +-----------------------------------------------------------------------------+ | Processes: | | GPU GI CI PID Type Process name GPU Memory | | ID ID Usage | |=============================================================================| | No running processes found | +-----------------------------------------------------------------------------+$ nvidia-smi Mon Sep 27 09:52:17 2021 +-----------------------------------------------------------------------------+ | NVIDIA-SMI 470.57.02 Driver Version: 470.57.02 CUDA Version: 11.4 | |-------------------------------+----------------------+----------------------| | GPU Name Persistence-M| Bus-Id Disp.A | Volatile Uncorr. ECC | | Fan Temp Perf Pwr:Usage/Cap| Memory-Usage | GPU-Util Compute M. | | | | MIG M. | |===============================+======================+======================| | 0 NVDIA A100-SXM... Off | 00000000:05:00.0 Off | On | | N/A 32C P0 49W / 400W | 0MiB / 81251MiB | N/A Default | | | | Enabled | +-------------------------------+----------------------+----------------------+ +-----------------------------------------------------------------------------+ | MIG devices: | +-----------------------------------------------------------------------------+ | GPU GI CI MIG | Memory-Usage | Vol| Shared | | ID ID Dev | BAR1-Usage | SM Unc| CE ENC DEC OFA JPG| | | | ECC| | |=============================================================================| | 0 0 0 0 | 0MiB / 81251MiB | 98 0 | 7 0 5 1 1 | | | 1MiB / 13107... | | | +-----------------------------------------------------------------------------+ +-----------------------------------------------------------------------------+ | Processes: | | GPU GI CI PID Type Process name GPU Memory | | ID ID Usage | |=============================================================================| | No running processes found | +-----------------------------------------------------------------------------+코드블록. nvidia-smi 명령어 - GPU 상태 확인 (2)

- MIG Compute Instance 생성

MIG 사용

- MIG Instance를 사용해 Job을 수행하세요.

- 작업 수행 예시배경색 변경

$ docker run --gpus '"device=[GPU ID]:[MIG ID]"' -rm nvcr.io/nvidia/cuda nvidia-smi$ docker run --gpus '"device=[GPU ID]:[MIG ID]"' -rm nvcr.io/nvidia/cuda nvidia-smi코드블록. 작업 수행 예시 - 아래와 같이 작업을 수행한 예시를 확인해볼 수 있습니다.배경색 변경

$ docker run --gpus '"device=0:0"' -rm -it --network=host --shm-size=1g --ipc=host -v /root/.ssh/:/root/.ssh ================ == TensorFlow == ================ NVIDIA Release 21.08-tf1 (build 26012104) TensorFlow Version 1.15.5 Container image Copyright (c) 2021, NVIDIA CORPORATION. All right reserved. ... # Python 프로세스 실행 root@d622a93c9281:/workspace# python /workspace/nvidia-examples/cnn/resnet.py --num_iter 100 ... PY 3.8.10 (default, Jun 2 2021, 10:49:15) [GCC 9.4.0] TF 1.15.5 ...$ docker run --gpus '"device=0:0"' -rm -it --network=host --shm-size=1g --ipc=host -v /root/.ssh/:/root/.ssh ================ == TensorFlow == ================ NVIDIA Release 21.08-tf1 (build 26012104) TensorFlow Version 1.15.5 Container image Copyright (c) 2021, NVIDIA CORPORATION. All right reserved. ... # Python 프로세스 실행 root@d622a93c9281:/workspace# python /workspace/nvidia-examples/cnn/resnet.py --num_iter 100 ... PY 3.8.10 (default, Jun 2 2021, 10:49:15) [GCC 9.4.0] TF 1.15.5 ...코드블록. 작업 수행 결과

- 작업 수행 예시

- GPU 사용률을 확인하세요. (JOB 프로세스 생성)

- Job이 구동될 때 MIG 디바이스에 프로세스가 할당되고 사용률이 증가하는 것을 확인할 수 있습니다.배경색 변경

$ nvidia-smi mig -i [GPU ID] -gi [GPU Instance ID] -lcip$ nvidia-smi mig -i [GPU ID] -gi [GPU Instance ID] -lcip코드블록. nvidia-smi 명령어 - GPU 사용률 확인 - 아래와 같이 GPU 사용률을 확인할 수 있습니다.배경색 변경

+-----------------------------------------------------------------------------+ | MIG devices: | +-----------------------------------------------------------------------------+ | GPU GI CI MIG | Memory-Usage | Vol| Shared | | ID ID Dev | BAR1-Usage | SM Unc| CE ENC DEC OFA JPG| | | | ECC| | |=============================================================================| | 0 0 0 0 | 66562MiB / 81251MiB | 98 0 | 7 0 5 1 1 | | | 5MiB / 13107... | | | +-----------------------------------------------------------------------------+ +-----------------------------------------------------------------------------+ | Processes: | | GPU GI CI PID Type Process name GPU Memory | | ID ID Usage | |=============================================================================| | 0 0 0 17483 C python 66559MiB | +-----------------------------------------------------------------------------++-----------------------------------------------------------------------------+ | MIG devices: | +-----------------------------------------------------------------------------+ | GPU GI CI MIG | Memory-Usage | Vol| Shared | | ID ID Dev | BAR1-Usage | SM Unc| CE ENC DEC OFA JPG| | | | ECC| | |=============================================================================| | 0 0 0 0 | 66562MiB / 81251MiB | 98 0 | 7 0 5 1 1 | | | 5MiB / 13107... | | | +-----------------------------------------------------------------------------+ +-----------------------------------------------------------------------------+ | Processes: | | GPU GI CI PID Type Process name GPU Memory | | ID ID Usage | |=============================================================================| | 0 0 0 17483 C python 66559MiB | +-----------------------------------------------------------------------------+코드블록. GPU 사용률 확인 예시

- Job이 구동될 때 MIG 디바이스에 프로세스가 할당되고 사용률이 증가하는 것을 확인할 수 있습니다.

MIG Instance 삭제 및 해제하기

MIG Instance를 삭제하고 MIG를 해제하려면 다음 절차를 따르세요.

Compute Instance 삭제

- Compute Instance를 삭제하세요.배경색 변경

$ nvidia-smi mig -i [GPU ID] -gi [GPU Instance ID] –dci $ nvidia-smi mig -i [GPU ID] -gi [GPU Instance ID] -ci [Compute Instance] –dci$ nvidia-smi mig -i [GPU ID] -gi [GPU Instance ID] –dci $ nvidia-smi mig -i [GPU ID] -gi [GPU Instance ID] -ci [Compute Instance] –dci코드블록. nvidia-smi 명령어 - Compute Instance 삭제 배경색 변경$ nvidia-smi mig -i 0 -gi 0 –lci +-----------------------------------------------------------------+ | Compute instance profiles: | | GPU GPU Name Profile Instances Placement | | GPU Instance ID ID Start:Size | | ID | |=================================================================| | 0 0 MIG 7g.80gb 4 0 0:7 | +-----------------------------------------------------------------+$ nvidia-smi mig -i 0 -gi 0 –lci +-----------------------------------------------------------------+ | Compute instance profiles: | | GPU GPU Name Profile Instances Placement | | GPU Instance ID ID Start:Size | | ID | |=================================================================| | 0 0 MIG 7g.80gb 4 0 0:7 | +-----------------------------------------------------------------+코드블록. MIG Compute Instance 확인 예시 배경색 변경$ nvidia-smi mig -i 0 -gi 0 –dci Successfully destroyed compute instance ID 0 from GPU instance ID 0$ nvidia-smi mig -i 0 -gi 0 –dci Successfully destroyed compute instance ID 0 from GPU instance ID 0코드블록. Compute Instance 삭제 예시 배경색 변경$ nvidia-smi mig -i 0 -gi 0 –lci No compute instances found: Not found$ nvidia-smi mig -i 0 -gi 0 –lci No compute instances found: Not found코드블록. Compute Instance 삭제 확인

GPU Instance 삭제

- GPU Instance를 삭제하세요.배경색 변경

$ nvidia-smi mig -i [GPU ID] –dgi $ nvidia-smi mig -i [GPU ID] -gi [GPU Instance ID] –dgi$ nvidia-smi mig -i [GPU ID] –dgi $ nvidia-smi mig -i [GPU ID] -gi [GPU Instance ID] –dgi코드블록. nvidia-smi 명령어 - GPU Instance 삭제 배경색 변경$ nvidia-smi mig -i 0 -lgi +--------------------------------------------------------+ | GPU instances: | | GPU Name Profile Instance Placement | | ID ID Start:Size | |========================================================| | 0 MIG 7g.80gb 0 0 0:8 | +--------------------------------------------------------+$ nvidia-smi mig -i 0 -lgi +--------------------------------------------------------+ | GPU instances: | | GPU Name Profile Instance Placement | | ID ID Start:Size | |========================================================| | 0 MIG 7g.80gb 0 0 0:8 | +--------------------------------------------------------+코드블록. nvidia-smi 명령어 - GPU Instance 확인 예시 배경색 변경$ nvidia-smi mig -i 0 -dgi Successfully destroyed GPU instance ID 0 from GPU 0$ nvidia-smi mig -i 0 -dgi Successfully destroyed GPU instance ID 0 from GPU 0코드블록. nvidia-smi 명령어 - GPU Instance 삭제 예시 배경색 변경$ nvidia-smi mig -i 0 -lgi No GPU instances found: Not found$ nvidia-smi mig -i 0 -lgi No GPU instances found: Not found코드블록. nvidia-smi 명령어 - GPU Instance 삭제 예시

MIG 기능 해제(비활성화)

- MIG를 비활성화(Disable)한 후 재부팅하세요.배경색 변경

$ nvidia-smi -mig 0 Disabled MIG Mode for GPU 00000000:05:00.0 All done.$ nvidia-smi -mig 0 Disabled MIG Mode for GPU 00000000:05:00.0 All done.코드블록. nvidia-smi 명령어 - MIG 비활성화 배경색 변경$ nvidia-smi Mon Sep 30 05:18:28 2021 +-----------------------------------------------------------------------------+ | NVIDIA-SMI 470.57.02 Driver Version: 470.57.02 CUDA Version: 11.4 | |-------------------------------+----------------------+----------------------| | GPU Name Persistence-M| Bus-Id Disp.A | Volatile Uncorr. ECC | | Fan Temp Perf Pwr:Usage/Cap| Memory-Usage | GPU-Util Compute M. | | | | MIG M. | |===============================+======================+======================| | 0 NVDIA A100-SXM... Off | 00000000:05:00.0 Off | 0 | | N/A 33C P0 60W / 400W | 0MiB / 81251MiB | 0% Default | | | | Disabled | +-------------------------------+----------------------+----------------------+ +-----------------------------------------------------------------------------+ | MIG devices: | +-----------------------------------------------------------------------------+ | GPU GI CI MIG | Memory-Usage | Vol| Shared | | ID ID Dev | BAR1-Usage | SM Unc| CE ENC DEC OFA JPG| | | | ECC| | |=============================================================================| | No MIG devices found | +-----------------------------------------------------------------------------+ +-----------------------------------------------------------------------------+ | Processes: | | GPU GI CI PID Type Process name GPU Memory | | ID ID Usage | |=============================================================================| | No running processes found | +-----------------------------------------------------------------------------+$ nvidia-smi Mon Sep 30 05:18:28 2021 +-----------------------------------------------------------------------------+ | NVIDIA-SMI 470.57.02 Driver Version: 470.57.02 CUDA Version: 11.4 | |-------------------------------+----------------------+----------------------| | GPU Name Persistence-M| Bus-Id Disp.A | Volatile Uncorr. ECC | | Fan Temp Perf Pwr:Usage/Cap| Memory-Usage | GPU-Util Compute M. | | | | MIG M. | |===============================+======================+======================| | 0 NVDIA A100-SXM... Off | 00000000:05:00.0 Off | 0 | | N/A 33C P0 60W / 400W | 0MiB / 81251MiB | 0% Default | | | | Disabled | +-------------------------------+----------------------+----------------------+ +-----------------------------------------------------------------------------+ | MIG devices: | +-----------------------------------------------------------------------------+ | GPU GI CI MIG | Memory-Usage | Vol| Shared | | ID ID Dev | BAR1-Usage | SM Unc| CE ENC DEC OFA JPG| | | | ECC| | |=============================================================================| | No MIG devices found | +-----------------------------------------------------------------------------+ +-----------------------------------------------------------------------------+ | Processes: | | GPU GI CI PID Type Process name GPU Memory | | ID ID Usage | |=============================================================================| | No running processes found | +-----------------------------------------------------------------------------+코드블록. nvidia-smi 명령어 - GPU 상태 확인

2.4 - GPU Server에서 NVSwitch 사용하기

GPU Server를 생성한 후 GPU Server의 VM(Guest OS)에서 NVSwitch 기능을 활성화하고 GPU 간 P2P(GPU to GPU)통신을 빠르게 사용할 수 있습니다.

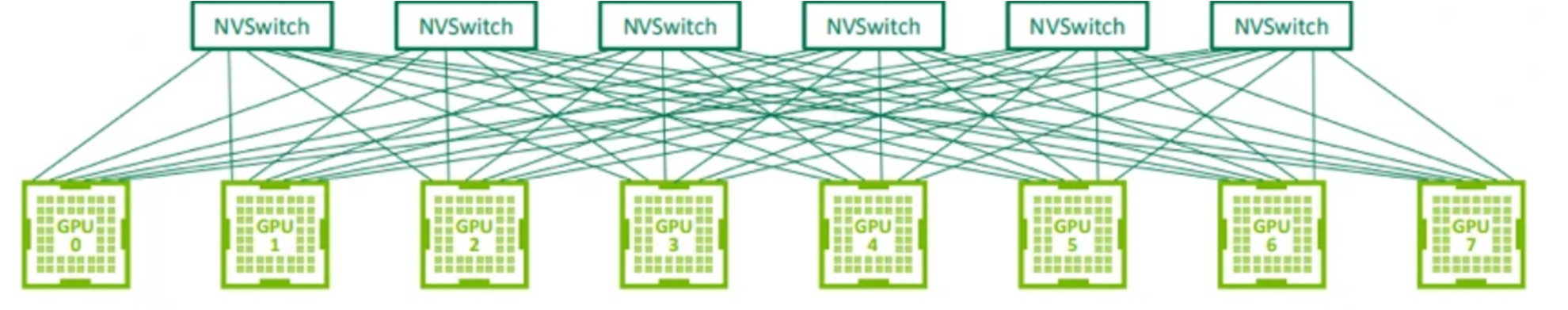

Multi GPU를 위한 NVIDIA NVSwitch 살펴보기

NVIDIA A100 GPU서버는 NVIDIA 암페어(Ampere) 아키텍처를 기반으로 하는 멀티 GPU로, 베이스보드에는 8개의 Ampere 80 GB GPU가 장착되어 있습니다. 베이스보드에 장착된 GPU들은 NVLink 포트를 통해 6개의 NVSwitch와 연결됩니다. 베이스보드에 있는 GPU 간 통신은 600 GBps 대역폭 전체를 활용해 이루어집니다. 이런 이유로 A100 GPU 서버에 장착된 8개의 GPU가 마치 하나처럼 연결되어 동작 할 수 있으므로, GPU to GPU 사용률을 극대화 할 수 있습니다.

- NVLink(25 GBps) 12개 Lane 8 GPU 구성도

- NVSwitch(600 GBps) 6개 8 GPU 구성도

GPU NVSwitch 생성하기

GPU NVSwitch 기능을 사용하려면 Samsung Cloud Platform에서 GPU Server 서비스를 생성한 후, A100 GPU 8개가 할당된 VM Instance(GuestOS)를 생성하고 Fabricmanager를 활성화합니다.

- NVSwitch는 단일 GPU Server에 8개의 A100 GPU를 할당한 상품(g1v128a8 (vCPU 128 | Memory 1920G | A100(80GB)*8))의 경우에만 Fabricmanager를 활성화하여 사용할 수 있습니다.

- 현재 Windows OS로 생성된 GPU Server에서는 NVSwitch (Fabricmanager)를 지원하지 않습니다.

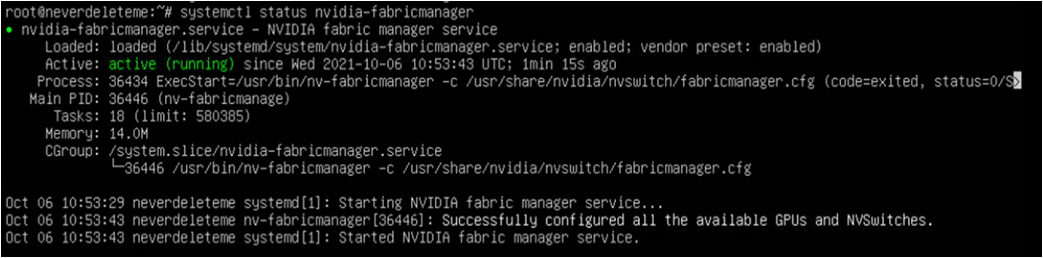

NVSwitch 설치 및 동작 확인하기(Fabricmanager 활성화)

NVSwitch를 구동하려면 GPU Instance에서 Fabricmanager를 설치하고 다음 절차를 따르세요.

GPU 서버에 NVIDIA GPU Driver (470.52.02 Version)를 설치하세요.

배경색 변경$ add-apt-repository ppa:graphics-drivers/ppa $ apt-get update $ apt-get install nvidia-driver-470-server$ add-apt-repository ppa:graphics-drivers/ppa $ apt-get update $ apt-get install nvidia-driver-470-server코드블록. NVIDIA GPU Driver 설치 GPU 서버에 NVIDIA Fabric Manager (470 Version)를 설치하고 구동하세요(For NVSwitch).

배경색 변경$ apt-get install cuda-drivers-fabricmanager-470 $ systemctl enable nvidia-fabricmanager $ systemctl start nvidia-fabricmanager$ apt-get install cuda-drivers-fabricmanager-470 $ systemctl enable nvidia-fabricmanager $ systemctl start nvidia-fabricmanager코드블록. NVIDIA Fabric Manager 설치 및 구동 GPU 서버에 NVIDIA Fabric Manager 구동 상태를 확인하세요.

- 정상 구동 시 active (running) 표시배경색 변경

$ systemctl status nvidia-fabricmanager$ systemctl status nvidia-fabricmanager코드블록. NVIDIA Fabric Manager 구동 상태 확인

- 정상 구동 시 active (running) 표시

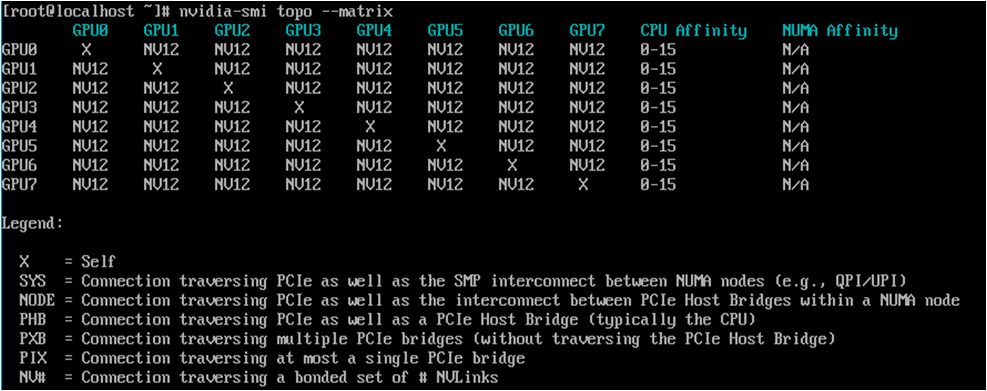

- GPU 서버에 NVSwitch 구동 상태를 확인하세요.

- 정상 구동 시 NV12 표시배경색 변경

$ nvidia-smi topo --matrix$ nvidia-smi topo --matrix코드블록. NVSwitch 구동 상태 확인

- 정상 구동 시 NV12 표시

2.5 - ServiceWatch Agent 설치하기

사용자는 GPU Server에 ServiceWatch Agent를 설치하여 사용자 정의 지표와 로그를 수집할 수 있습니다.

ServiceWatch Agent

GPU Server에 ServiceWatch의 사용자 정의 지표 및 로그 수집을 위해 설치해야 하는 Agent는 크게 2가지로 나눌 수 있습니다. Prometheus Exporter와 Open Telemetry Collector 입니다.

| 구분 | 상세 설명 | |

|---|---|---|

| Prometheus Exporter | 특정 애플리케이션이나 서비스의 메트릭을 Prometheus가 스크랩(scrape)할 수 있는 형식으로 제공

| |

| Open Telemetry Collector | 분산 시스템의 메트릭, 로그와 같은 텔레메트리 데이터를 수집하고, 처리(필터링, 샘플링 등)한 후, 여러 백엔드(예: Prometheus, Jaeger, Elasticsearch 등)로 내보내는 중앙 집중식 수집기 역할

|

GPU Server에 Kubernetes Engine을 구성한 경우, Kubernetes Engine에서 제공되는 지표를 통해 GPU 지표를 확인하기 바랍니다.

- Kubernetes Engine이 구성되어 있는 GPU Server에 DCGM Exporter를 설치하게 되면 정상 동작하지 않을 수 있습니다.

GPU 지표를 위한 Prometheus Exporter 설치 (for Ubuntu)

GPU Server의 지표를 수집하기 위한 Prometheus Exporter를 아래의 순서에 따라 설치합니다.

NVDIA Driver 설치 확인

- 설치되어 있는 NVDIA Driver를 확인합니다.배경색 변경

nvidia-smi --query-gpu driver_version --format csvnvidia-smi --query-gpu driver_version --format csv코드블록. NVDIA Driver 버전 확인 명령어 배경색 변경driver_version 535.183.06 ... 535.183.06driver_version 535.183.06 ... 535.183.06코드블록. NVDIA Driver 버전 확인 예시

NVSwitch Configuration and Query (NSCQ) Library 설치

cuda-keyring를 설치합니다.

배경색 변경wget https://developer.download.nvidia.com/compute/cuda/repos/<distro>/<arch>/cuda-keyring_1.1-1_all.debwget https://developer.download.nvidia.com/compute/cuda/repos/<distro>/<arch>/cuda-keyring_1.1-1_all.deb코드블록. NSCQ library 다운로드 명령어 배경색 변경sudo dpkg -i cuda-keyring_1.1-1_all.deb apt updatesudo dpkg -i cuda-keyring_1.1-1_all.deb apt update코드블록. NSCQ library 설치 명령어 배경색 변경nvidia-smi --query-gpu driver_version --format csvnvidia-smi --query-gpu driver_version --format csv코드블록. NVDIA Driver 버전 확인 명령어 배경색 변경driver_version 535.183.06 ... 535.183.06driver_version 535.183.06 ... 535.183.06코드블록. NVDIA Driver 버전 확인 예시 libnvidia-nscq를 설치합니다.

배경색 변경apt-cache policy libnvidia-nscq-535apt-cache policy libnvidia-nscq-535코드블록. NSCQ library apt-cache 명령어 배경색 변경libnvidia-nscq-535: Installed: (none) Candidate: 535.247.01-1 Version table: 535.247.01-1 600 600 https://developer.download.nvidia.com/compute/cuda/repos/ubuntu2204/x86_64 Packages ... 600 https://developer.download.nvidia.com/compute/cuda/repos/ubuntu2204/x86_64 Packages 535.216.01-1 600 600 https://developer.download.nvidia.com/compute/cuda/repos/ubuntu2204/x86_64 Packages 535.183.06-1 600 # Driver 와 일치 하는 버전으로 설치 600 https://developer.download.nvidia.com/compute/cuda/repos/ubuntu2204/x86_64 Packages 535.183.01-1 600 ... 600 https://developer.download.nvidia.com/compute/cuda/repos/ubuntu2204/x86_64 Packages 535.54.03-1 600 600 https://developer.download.nvidia.com/compute/cuda/repos/ubuntu2204/x86_64 Packageslibnvidia-nscq-535: Installed: (none) Candidate: 535.247.01-1 Version table: 535.247.01-1 600 600 https://developer.download.nvidia.com/compute/cuda/repos/ubuntu2204/x86_64 Packages ... 600 https://developer.download.nvidia.com/compute/cuda/repos/ubuntu2204/x86_64 Packages 535.216.01-1 600 600 https://developer.download.nvidia.com/compute/cuda/repos/ubuntu2204/x86_64 Packages 535.183.06-1 600 # Driver 와 일치 하는 버전으로 설치 600 https://developer.download.nvidia.com/compute/cuda/repos/ubuntu2204/x86_64 Packages 535.183.01-1 600 ... 600 https://developer.download.nvidia.com/compute/cuda/repos/ubuntu2204/x86_64 Packages 535.54.03-1 600 600 https://developer.download.nvidia.com/compute/cuda/repos/ubuntu2204/x86_64 Packages코드블록. NSCQ library apt-cache 명령어 결과 배경색 변경apt install libnvidia-nscq-535=535.183.06-1apt install libnvidia-nscq-535=535.183.06-1코드블록. NSCQ library 설치 명령어

NVDIA Driver의 버전과 같은 버전으로 설치해야 합니다.

- 예시) driver version: 535.183.06, libnvdia-nscq version: 535.183.06-1

NVSwitch Device Monitoring API(NVSDM) Library 설치

- NVSDM library 설치합니다.배경색 변경