국내 최고의 안정성을 기반으로 사용 목적에 따라 최적의 컴퓨팅 자원을 편리하고 탄력적으로 제공합니다.

이 섹션의 다중 페이지 출력 화면임. 여기를 클릭하여 프린트.

Compute

- 1: Virtual Server

- 1.1: Overview

- 1.1.1: 서버 타입

- 1.1.2: 모니터링 지표

- 1.1.3: ServiceWatch 지표

- 1.2: How-to guides

- 1.2.1: Image

- 1.2.2: Keypair

- 1.2.3: Server Group

- 1.2.4: IP 변경하기

- 1.2.5: Linux NTP 설정하기

- 1.2.6: RHEL Repo 및 WKMS 설정하기

- 1.2.7: ServiceWatch Agent 설치하기

- 1.3: API Reference

- 1.4: CLI Reference

- 1.5: Release Note

- 2: Virtual Server Auto-Scaling

- 2.1: Overview

- 2.1.1: 모니터링 지표

- 2.2: How-to guides

- 2.2.1: Launch Configuration

- 2.2.2: 정책 관리하기

- 2.2.3: 스케줄 관리하기

- 2.2.4: 알림 관리하기

- 2.3: API Reference

- 2.4: CLI Reference

- 2.5: Release Note

- 3: GPU Server

- 3.1: Overview

- 3.1.1: 서버 타입

- 3.1.2: 모니터링 지표

- 3.1.3: ServiceWatch 지표

- 3.2: How-to guides

- 3.2.1: Image 관리하기

- 3.2.2: Keypair 관리하기

- 3.2.3: GPU Server에서 Multi-instance GPU 사용하기

- 3.2.4: GPU Server에서 NVSwitch 사용하기

- 3.2.5: ServiceWatch Agent 설치하기

- 3.3: API Reference

- 3.4: CLI Reference

- 3.5: Release Note

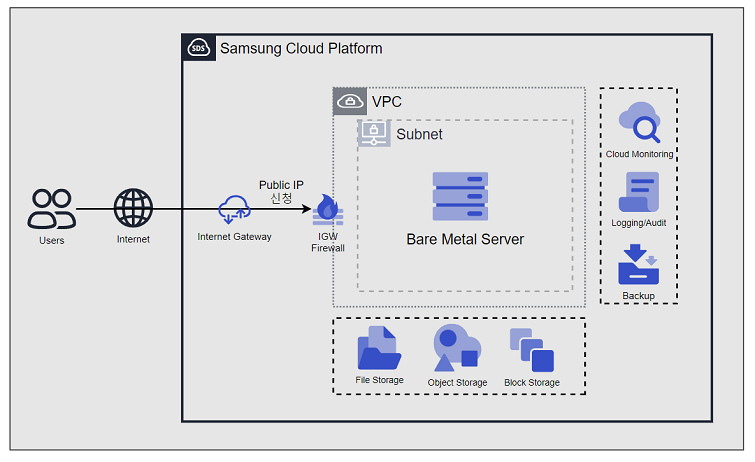

- 4: Bare Metal Server

- 4.1: Overview

- 4.2: How-to guides

- 4.2.1: ServiceWatch Agent 설치하기

- 4.3: API Reference

- 4.4: CLI Reference

- 4.5: Release Note

- 5: Multi-node GPU Cluster

- 5.1: Overview

- 5.2: How-to guides

- 5.2.1: Cluster Fabric 관리

- 5.2.2: ServiceWatch Agent 설치하기

- 5.2.3: Multi-node GPU Cluster 서비스 범위 및 점검 가이드

- 5.3: Release Note

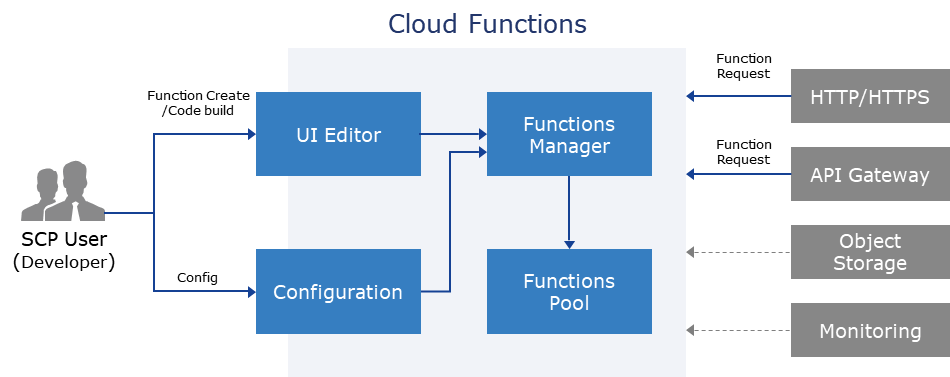

- 6: Cloud Functions

- 6.1: Overview

- 6.2: How-to guides

- 6.2.1: 트리거 설정하기

- 6.2.2: AIOS 연계하기

- 6.2.3: Blueprint 상세 가이드

- 6.2.4: PrivateLink 서비스 연계하기

- 6.3: API Reference

- 6.4: CLI Reference

- 6.5: Release Note

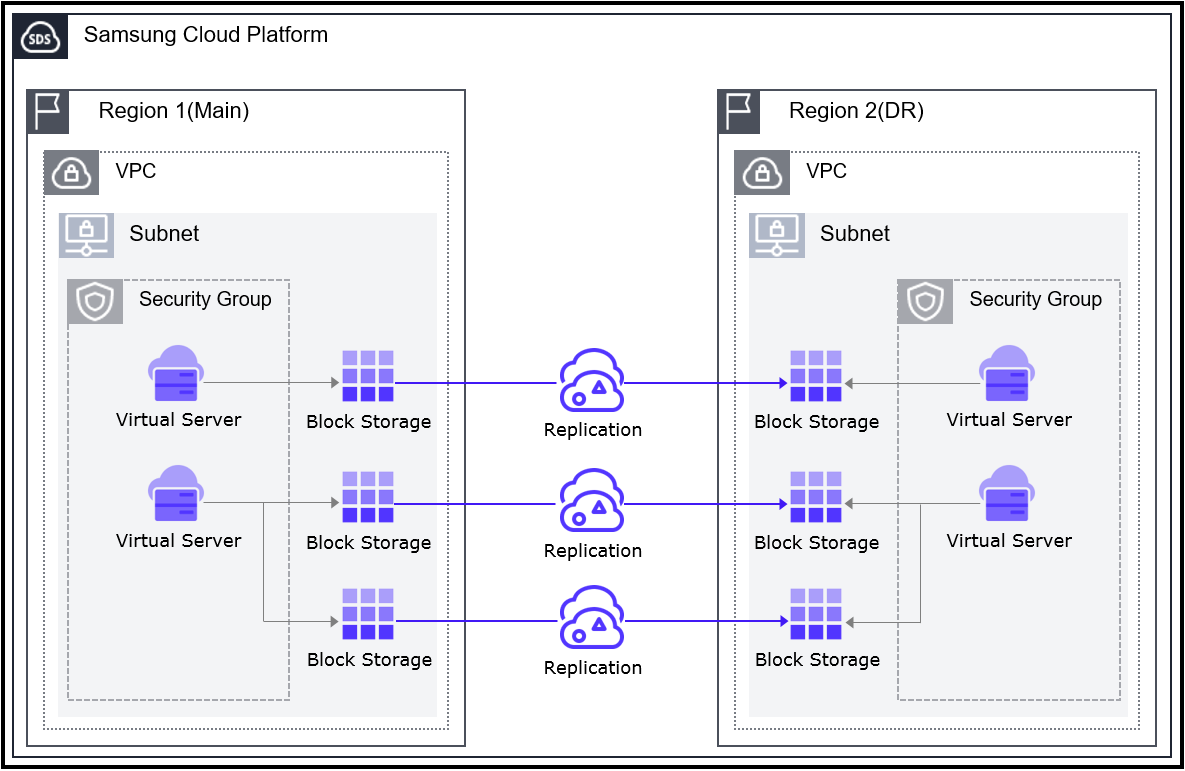

- 7: Virtual Server DR

- 7.1: Overview

- 7.2: Release Note

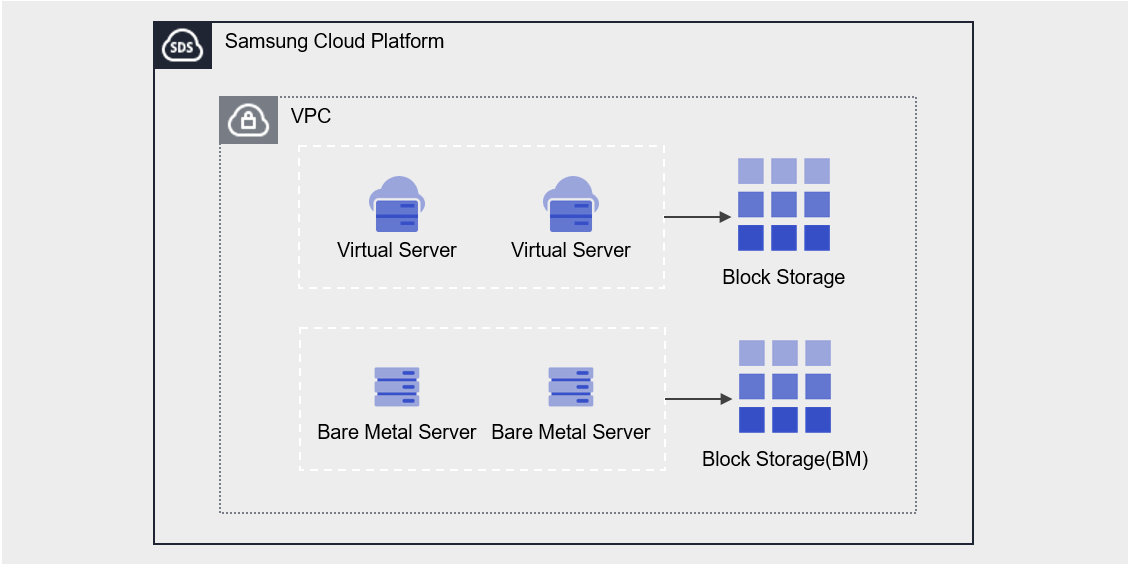

- 8: Block Storage

- 8.1: Overview

- 8.1.1: 모니터링 지표

- 8.2: How-to guides

- 8.3: API Reference

- 8.4: CLI Reference

- 8.5: Release Note

1 - Virtual Server

1.1 - Overview

서비스 개요

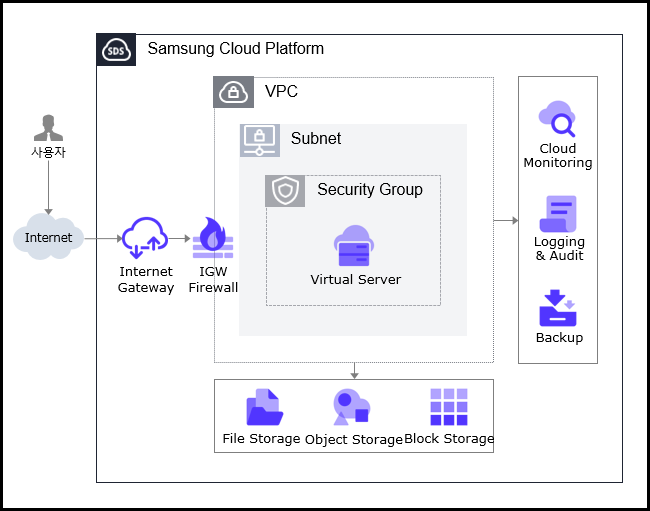

Virtual Server는 CPU, Memory 등 서버에서 제공하는 인프라 자원을 개별 구매할 필요 없이, 필요한 시점에 필요한 만큼 자유롭게 할당 받아 사용할 수 있는 클라우드 컴퓨팅에 최적화된 가상 서버입니다. 클라우드 환경에서 개발, 테스트, 응용 프로그램 실행 등 사용자의 컴퓨팅 활용 목적에 따라 최적화된 성능의 자원을 이용할 수 있습니다.

특장점

쉽고 편리한 컴퓨팅 환경 구성: 웹 기반 Console을 통해 Virtual Server 프로비저닝부터 자원 관리, 비용 관리까지 사용자가 직접 Self Service로 손쉽게 사용 가능합니다. Virtual Server 사용 중 CPU나 Memory 등 주요 자원의 용량 변경이 필요할 경우 운영자의 개입 없이도 손쉽게 증설, 축소가 가능합니다.

다양한 유형의 서비스 제공: 사전 정의된 서버 타입(1~128 vCore)에 따라 가상화 된 vCore/Memory 자원을 제공합니다.

- 일반 Virtual Server: 일반적으로 사용되는 Computing Spec 제공 (최대 16vCore, 256GB)

- 대용량 Virtual Server: 일반 Virtual Server Spec 이상의 대용량 자원 필요 시 제공

강력한 보안 적용: Security Group 서비스를 통해 외부 인터넷이나 다른 VPC(Virtual Private Cloud)와 통신하는 Inbound/Outbound 트래픽을 제어하여 서버를 안전하게 보호합니다. 또한 실시간 모니터링을 통해 컴퓨팅 자원을 안정적으로 운영할 수 있습니다.

서비스 구성도

제공 기능

Virtual Server는 다음과 같은 기능을 제공하고 있습니다.

- 자동 프로비저닝(Auto Provisioning) 및 관리: 웹 기반 Console을 통해 Virtual Server 프로비저닝부터 자원 관리, 비용 관리 기능을 제공합니다. Virtual Server 사용 중 CPU나 Memory 등 주요 자원의 용량 변경이 필요할 경우 서버 타입 수정 기능을 이용해 즉시 변경할 수 있습니다.

- 표준 서버 타입 및 Image 제공: 표준 서버 타입에 따라 가상화 된 vCore/Memory 자원을 제공하며, 표준 OS Image를 제공합니다.

- 스토리지 연결: OS 디스크 외 추가 연결 스토리지를 제공 합니다. Block Storage, File Storage, Object Storage 를 추가 연결하여 사용할 수 있습니다.

- 네트워크 연결: Virtual Server의 일반 서브넷/IP 설정 및 Public NAT IP를 연결할 수 있습니다. 서버 간 통신을 위한 로컬 서브넷 연결을 제공합니다. 해당 작업은 상세 페이지에서 수정할 수 있습니다.

- Security Group 적용: Security Group 서비스를 통해 외부 인터넷이나 다른 VPC와 통신하는 Inbound/Outbound 트래픽을 제어하여 서버를 안전하게 보호합니다.

- 모니터링: 컴퓨팅 자원에 해당하는 CPU, Memory, Disk 등의 모니터링 정보를 Cloud Monitoring 서비스를 통해 확인할 수 있습니다.

- 백업 및 복구: Backup 서비스를 통해 Virtual Server Image를 백업 및 복구할 수 있습니다.

- 비용 관리: 필요에 따라 서버를 생성, 중지, 해지할 수 있으며, 실제 사용 시간에 따라 과금되므로 사용량에 따른 비용을 확인할 수 있습니다.

- ServiceWatch 서비스 연계 제공: ServiceWatch 서비스를 통해 데이터를 모니터링할 수 있습니다.

구성 요소

Virtual Server은 표준 서버 타입 및 표준 OS Image를 제공하고 있습니다. 사용자는 원하는 서비스 규모에 따라 이를 선택하여 사용할 수 있습니다.

Image

Image를 생성 및 관리할 수 있습니다. 주요 기능은 다음과 같습니다.

- Image 생성: 사용 중인 Virtual Server의 구성을 Image로 생성할 수 있으며, 사용자의 Image 파일을 Object Storage에 업로드하여 Image를 생성할 수 있습니다.

- 공유용 Image 생성: Visibility가 Private인 Image를 공유가 가능한 Shared Image로 생성할 수 있습니다.

- 다른 Account로 공유: Image를 다른 Account로 공유할 수 있습니다.

- Image 생성 및 활용 방법은 How-to guides > Image문서를 참고하세요.

Keypair

보다 안전한 OS 접속을 위해 ID/Password 입력 방식이 아닌, Key Pair 를 제공하여 보안을 강화합니다. 주요 기능은 다음과 같습니다.

- Keypair 생성: Virtual Server에 연결하기 위한 사용자 증명을 생성합니다.

- 공개 키 가져오기: 파일 불러오기 또는 공개 키를 직접 입력하여 공개 키를 가져올 수 있습니다.

- Keypair 생성 및 활용 방법은 How-to guides > Keypair문서를 참고하세요.

Server Group

Server Group 설정을 통해 Virtual Server 및 Virtual Server 생성 시 추가한 Block Storage를 랙(Rack) 및 호스트에 근접 또는 분산 배치 가능합니다. 주요 기능은 다음과 같습니다.

- Server Group 생성: 동일 Server Group에 소속된 Virtual Server를 Anti-Affinity(분산배치), Affinity(근접배치), Partition(Virtual Server와 Block Storage 분산배치)로 설정할 수 있습니다.

- Server Group 생성 및 활용 방법은 How-to guides > Server Group문서를 참고하세요.

OS Image 제공 버전

Virtual Server에서 제공하는 OS Image는 다음과 같습니다

| OS Image 버전 | EoS Date |

|---|---|

| Alma Linux 8.10 | 2029-05-31 |

| Alma Linux 9.6 | 2025-11-17 |

| Oracle Linux 8.10 | 2029-07-31 |

| Oracle Linux 9.6 | 2025-11-25 |

| RHEL 8.10 | 2029-05-31 |

| RHEL 9.4 | 2026-04-30 |

| RHEL 9.6 | 2027-05-31 |

| Rocky Linux 8.10 | 2029-05-31 |

| Rocky Linux 9.6 | 2025-11-30 |

| Ubuntu 22.04 | 2027-06-30 |

| Ubuntu 24.04 | 2029-06-30 |

| Windows 2019 | 2029-01-09 |

| Windows 2022 | 2031-10-14 |

- Alma Linux 및 Rocky Linux와 같은 Linux 운영체제는 Major 버전의 가장 마지막 릴리스 버전을 제외하고, 짝수 Minor 버전만 제공합니다. 이는 SCP 시스템의 안정성과 일관성을 보장하기 위한 정책입니다. 해당 운영체제의 EOS(End of Support) 및 EOL(End of Life) 날짜를 확인하시어, 필요 시 신규 또는 추가 개별 패키지를 적용하여 안정적인 환경을 유지하시길 권장드립니다.

서버 타입

Virtual Server에서 지원하는 서버 타입은 다음 형식과 같습니다. 서버 타입에 대한 자세한 내용은 Virtual Server 서버 타입을 참고하세요.

Standard s1v2m4

구분 | 예시 | 상세 설명 |

|---|---|---|

| 서버 타입 | Standard | 제공되는 서버 타입 구분

|

| 서버 사양 | s1 | 제공되는 서버 타입 구분 및 세대

|

| 서버 사양 | v2 | vCore 개수

|

| 서버 사양 | m4 | Memory 용량

|

제약 사항

- Rocky Linux, Oracle Linux로 Virtual Server를 생성한 경우 시간 동기화(NTP:Network Time Protocol)를 위해 추가 설정이 필요합니다. 다른 Image로 생성한 경우에는 자동 설정되어 별도 설정이 필요없습니다.

자세한 내용은 Linux NTP 설정하기를 참고하세요. - 2025년 8월 이전 RHEL 및 Windows Server를 생성한 경우 RHEL Repository 및 WKMS(Windows Key Management Service) 설정 수정이 필요합니다.

자세한 내용은 RHEL Repo 및 WKMS 설정하기를 참고하세요.

선행 서비스

해당 서비스를 생성하기 전에 미리 구성이 필요한 서비스 목록입니다. 자세한 내용은 각 서비스 별로 제공되는 가이드를 참고하여 사전에 준비해주세요.

| 서비스 카테고리 | 서비스 | 상세 설명 |

|---|---|---|

| Networking | VPC | 클라우드 환경에서 독립된 가상 네트워크를 제공하는 서비스 |

| Networking | Security Group | 서버의 트래픽을 제어하는 가상 방화벽 |

1.1.1 - 서버 타입

Virtual Server 서버 타입

Virtual Server는 사용 목적에 맞게 서버 타입을 제공합니다. 서버 타입은 CPU, Memory, Network Bandwidth 등 다양한 조합으로 구성됩니다. Virtual Server를 생성할 때 선택하는 서버 타입에 따라 Virtual Server에 사용되는 호스트 서버가 결정됩니다. Virtual Server에서 실행하려는 애플리케이션의 사양에 따라 서버 타입을 선택해주세요.

Virtual Server에서 지원하는 서버 타입은 다음 형식과 같습니다.

Standard s1v2m4

구분 | 예시 | 상세 설명 |

|---|---|---|

| 서버 타입 | Standard | 제공되는 서버 타입 구분

|

| 서버 사양 | s1 | 제공되는 서버 타입 구분 및 세대

|

| 서버 사양 | v2 | vCore 개수

|

| 서버 사양 | m4 | 메모리 용량

|

s1 서버 타입

Virtual Server의 s1 서버 타입은 표준 사양(vCPU, Memory)으로 제공하며 다양한 애플리케이션에 적합합니다.

- Samsung Cloud Platform v2의 1세대: 최대 3.3Ghz의 Intel 3세대(Ice Lake) Xeon Gold 6342 Processor

- 최대 16개의 vCPU 및 256 GB의 메모리를 지원

- 최대 12.5 Gbps의 네트워킹 속도

| 구분 | 서버 타입 | vCPU | Memory | Network Bandwidth |

|---|---|---|---|---|

| Standard | s1v1m2 | 1 vCore | 2 GB | 최대 10 Gbps |

| Standard | s1v2m4 | 2 vCore | 4 GB | 최대 10 Gbps |

| Standard | s1v2m8 | 2 vCore | 8 GB | 최대 10 Gbps |

| Standard | s1v2m16 | 2 vCore | 16 GB | 최대 10 Gbps |

| Standard | s1v2m24 | 2 vCore | 24 GB | 최대 10 Gbps |

| Standard | s1v2m32 | 2 vCore | 32 GB | 최대 10 Gbps |

| Standard | s1v4m8 | 4 vCore | 8 GB | 최대 10 Gbps |

| Standard | s1v4m16 | 4 vCore | 16 GB | 최대 10 Gbps |

| Standard | s1v4m32 | 4 vCore | 32 GB | 최대 10 Gbps |

| Standard | s1v4m48 | 4 vCore | 48 GB | 최대 10 Gbps |

| Standard | s1v4m64 | 4 vCore | 64 GB | 최대 10 Gbps |

| Standard | s1v6m12 | 6 vCore | 12 GB | 최대 10 Gbps |

| Standard | s1v6m24 | 6 vCore | 24 GB | 최대 10 Gbps |

| Standard | s1v6m48 | 6 vCore | 48 GB | 최대 10 Gbps |

| Standard | s1v6m72 | 6 vCore | 72 GB | 최대 10 Gbps |

| Standard | s1v6m96 | 6 vCore | 96 GB | 최대 10 Gbps |

| Standard | s1v8m16 | 8 vCore | 16 GB | 최대 10 Gbps |

| Standard | s1v8m32 | 8 vCore | 32 GB | 최대 10 Gbps |

| Standard | s1v8m64 | 8 vCore | 64 GB | 최대 10 Gbps |

| Standard | s1v8m96 | 8 vCore | 96 GB | 최대 10 Gbps |

| Standard | s1v8m128 | 8 vCore | 128 GB | 최대 10 Gbps |

| Standard | s1v10m20 | 10 vCore | 20 GB | 최대 10 Gbps |

| Standard | s1v10m40 | 10 vCore | 40 GB | 최대 10 Gbps |

| Standard | s1v10m80 | 10 vCore | 80 GB | 최대 10 Gbps |

| Standard | s1v10m120 | 10 vCore | 120 GB | 최대 10 Gbps |

| Standard | s1v10m160 | 10 vCore | 160 GB | 최대 10 Gbps |

| Standard | s1v12m24 | 12 vCore | 24 GB | 최대 12.5 Gbps |

| Standard | s1v12m48 | 12 vCore | 48 GB | 최대 12.5 Gbps |

| Standard | s1v12m96 | 12 vCore | 96 GB | 최대 12.5 Gbps |

| Standard | s1v12m144 | 12 vCore | 144 GB | 최대 12.5 Gbps |

| Standard | s1v12m192 | 12 vCore | 192 GB | 최대 12.5 Gbps |

| Standard | s1v14m28 | 14 vCore | 28 GB | 최대 12.5 Gbps |

| Standard | s1v14m56 | 14 vCore | 56 GB | 최대 12.5 Gbps |

| Standard | s1v14m112 | 14 vCore | 112 GB | 최대 12.5 Gbps |

| Standard | s1v14m168 | 14 vCore | 168 GB | 최대 12.5 Gbps |

| Standard | s1v14m224 | 14 vCore | 224 GB | 최대 12.5 Gbps |

| Standard | s1v16m32 | 16 vCore | 32 GB | 최대 12.5 Gbps |

| Standard | s1v16m64 | 16 vCore | 64 GB | 최대 12.5 Gbps |

| Standard | s1v16m128 | 16 vCore | 128 GB | 최대 12.5 Gbps |

| Standard | s1v16m192 | 16 vCore | 192 GB | 최대 12.5 Gbps |

| Standard | s1v16m256 | 16 vCore | 256 GB | 최대 12.5 Gbps |

s2 서버 타입

Virtual Server s2 서버 타입은 표준 사양(vCPU, Memory)으로 제공하며 다양한 애플리케이션에 적합합니다.

- Samsung Cloud Platform v2의 2세대: 최대 3.2GHz의 Intel 4세대(Sapphire Rapids) Xeon Gold 6448H Processor

- 최대 16개의 vCPU 및 256 GB의 메모리를 지원

- 최대 12.5 Gbps의 네트워킹 속도

| 구분 | 서버 타입 | CPU vCore | Memory | Network Bandwidth(Gbps) |

|---|---|---|---|---|

| Standard | s2v1m2 | 1 vCore | 2 GB | 최대 10 Gbps |

| Standard | s2v2m4 | 2 vCore | 4 GB | 최대 10 Gbps |

| Standard | s2v2m8 | 2 vCore | 8 GB | 최대 10 Gbps |

| Standard | s2v2m16 | 2 vCore | 16 GB | 최대 10 Gbps |

| Standard | s2v2m24 | 2 vCore | 24 GB | 최대 10 Gbps |

| Standard | s2v2m32 | 2 vCore | 32 GB | 최대 10 Gbps |

| Standard | s2v4m8 | 4 vCore | 8 GB | 최대 10 Gbps |

| Standard | s2v4m16 | 4 vCore | 16 GB | 최대 10 Gbps |

| Standard | s2v4m32 | 4 vCore | 32 GB | 최대 10 Gbps |

| Standard | s2v4m48 | 4 vCore | 48 GB | 최대 10 Gbps |

| Standard | s2v4m64 | 4 vCore | 64 GB | 최대 10 Gbps |

| Standard | s2v6m12 | 6 vCore | 12 GB | 최대 10 Gbps |

| Standard | s2v6m24 | 6 vCore | 24 GB | 최대 10 Gbps |

| Standard | s2v6m48 | 6 vCore | 48 GB | 최대 10 Gbps |

| Standard | s2v6m72 | 6 vCore | 72 GB | 최대 10 Gbps |

| Standard | s2v6m96 | 6 vCore | 96 GB | 최대 10 Gbps |

| Standard | s2v8m16 | 8 vCore | 16 GB | 최대 10 Gbps |

| Standard | s2v8m32 | 8 vCore | 32 GB | 최대 10 Gbps |

| Standard | s2v8m64 | 8 vCore | 64 GB | 최대 10 Gbps |

| Standard | s2v8m96 | 8 vCore | 96 GB | 최대 10 Gbps |

| Standard | s2v8m128 | 8 vCore | 128 GB | 최대 10 Gbps |

| Standard | s2v10m20 | 10 vCore | 20 GB | 최대 10 Gbps |

| Standard | s2v10m40 | 10 vCore | 40 GB | 최대 10 Gbps |

| Standard | s2v10m80 | 10 vCore | 80 GB | 최대 10 Gbps |

| Standard | s2v10m120 | 10 vCore | 120 GB | 최대 10 Gbps |

| Standard | s2v10m160 | 10 vCore | 160 GB | 최대 10 Gbps |

| Standard | s2v12m24 | 12 vCore | 24 GB | 최대 12.5 Gbps |

| Standard | s2v12m48 | 12 vCore | 48 GB | 최대 12.5 Gbps |

| Standard | s2v12m96 | 12 vCore | 96 GB | 최대 12.5 Gbps |

| Standard | s2v12m144 | 12 vCore | 144 GB | 최대 12.5 Gbps |

| Standard | s2v12m192 | 12 vCore | 192 GB | 최대 12.5 Gbps |

| Standard | s2v14m28 | 14 vCore | 28 GB | 최대 12.5 Gbps |

| Standard | s2v14m56 | 14 vCore | 56 GB | 최대 12.5 Gbps |

| Standard | s2v14m112 | 14 vCore | 112 GB | 최대 12.5 Gbps |

| Standard | s2v14m168 | 14 vCore | 168 GB | 최대 12.5 Gbps |

| Standard | s2v14m224 | 14 vCore | 224 GB | 최대 12.5 Gbps |

| Standard | s2v16m32 | 16 vCore | 32 GB | 최대 12.5 Gbps |

| Standard | s2v16m64 | 16 vCore | 64 GB | 최대 12.5 Gbps |

| Standard | s2v16m128 | 16 vCore | 128 GB | 최대 12.5 Gbps |

| Standard | s2v16m192 | 16 vCore | 192 GB | 최대 12.5 Gbps |

| Standard | s2v16m256 | 16 vCore | 256 GB | 최대 12.5 Gbps |

h2 서버 타입

Virtual Server의 h2 서버 타입은 대용량 서버 사양으로 제공하며, 대규모 데이터 처리를 위한 애플리케이션에 적합합니다.

- Samsung Cloud Platform v2의 2세대: 최대 3.2GHz의 Intel 4세대(Sapphire Rapids) Xeon Gold 6448H Processor

- 최대 128개의 vCPU 및 1,536 GB의 메모리를 지원

- 최대 25Gbps의 네트워킹 속도

| 구분 | 서버 타입 | vCPU | Memory | Network Bandwidth |

|---|---|---|---|---|

| High Capacity | h2v24m48 | 24 vCore | 48 GB | 최대 25 Gbps |

| High Capacity | h2v24m96 | 24 vCore | 96 GB | 최대 25 Gbps |

| High Capacity | h2v24m192 | 24 vCore | 192 GB | 최대 25 Gbps |

| High Capacity | h2v24m288 | 24 vCore | 288 GB | 최대 25 Gbps |

| High Capacity | h2v32m64 | 32 vCore | 64 GB | 최대 25 Gbps |

| High Capacity | h2v32m128 | 32 vCore | 128 GB | 최대 25 Gbps |

| High Capacity | h2v32m256 | 32 vCore | 256 GB | 최대 25 Gbps |

| High Capacity | h2v32m384 | 32 vCore | 384 GB | 최대 25 Gbps |

| High Capacity | h2v48m96 | 48 vCore | 96 GB | 최대 25 Gbps |

| High Capacity | h2v48m192 | 48 vCore | 192 GB | 최대 25 Gbps |

| High Capacity | h2v48m384 | 48 vCore | 384 GB | 최대 25 Gbps |

| High Capacity | h2v48m576 | 48 vCore | 576 GB | 최대 25 Gbps |

| High Capacity | h2v64m128 | 64 vCore | 128 GB | 최대 25 Gbps |

| High Capacity | h2v64m256 | 64 vCore | 256 GB | 최대 25 Gbps |

| High Capacity | h2v64m512 | 64 vCore | 512 GB | 최대 25 Gbps |

| High Capacity | h2v64m768 | 64 vCore | 768 GB | 최대 25 Gbps |

| High Capacity | h2v72m144 | 72 vCore | 144 GB | 최대 25 Gbps |

| High Capacity | h2v72m288 | 72 vCore | 288 GB | 최대 25 Gbps |

| High Capacity | h2v72m576 | 72 vCore | 576 GB | 최대 25 Gbps |

| High Capacity | h2v72m864 | 72 vCore | 864 GB | 최대 25 Gbps |

| High Capacity | h2v96m192 | 96 vCore | 192 GB | 최대 25 Gbps |

| High Capacity | h2v96m384 | 96 vCore | 384 GB | 최대 25 Gbps |

| High Capacity | h2v96m768 | 96 vCore | 768 GB | 최대 25 Gbps |

| High Capacity | h2v96m1152 | 96 vCore | 1152 GB | 최대 25 Gbps |

| High Capacity | h2v128m256 | 128 vCore | 256 GB | 최대 25 Gbps |

| High Capacity | h2v128m512 | 128 vCore | 512 GB | 최대 25 Gbps |

| High Capacity | h2v128m1024 | 128 vCore | 1024 GB | 최대 25 Gbps |

| High Capacity | h2v128m1536 | 128 vCore | 1536 GB | 최대 25 Gbps |

1.1.2 - 모니터링 지표

Virtual Server 모니터링 지표

아래 표는 Cloud Monitoring을 통해 확인할 수 있는 Virtual Server의 모니터링 지표를 나타냅니다. 자세한 Cloud Monitoring 사용 방법은 Cloud Monitoring 가이드를 참고하세요.

Agent를 설치하지 않아도 기본적인 모니터링 지표를 제공하며 아래 표. Virtual Server 모니터링 지표(기본 제공) 에서 확인해주세요. 추가로 Agent 설치를 통해 조회 가능한 지표는 아래 표. Virtual Server 추가 모니터링 지표 (Agent 설치 필요) 에서 참고하세요.

Windows OS의 경우 Memory 관련 지표는 Agent를 설치해야만 조회가 가능합니다.

| 성능 항목 | 상세 설명 | 단위 |

|---|---|---|

| Memory Total [Basic] | 사용할 수 있는 메모리의 bytes | bytes |

| Memory Used [Basic] | 현재 사용되는 메모리의 bytes | bytes |

| Memory Swap In [Basic] | 교체된 메모리의 bytes | bytes |

| Memory Swap Out [Basic] | 교체된 메모리의 bytes | bytes |

| Memory Free [Basic] | 사용하지 않은 메모리의 bytes | bytes |

| Disk Read Bytes [Basic] | 읽기 bytes | bytes |

| Disk Read Requests [Basic] | 읽기 요청 수 | cnt |

| Disk Write Bytes [Basic] | 쓰기bytes | bytes |

| Disk Write Requests [Basic] | 쓰기 요청 수 | cnt |

| CPU Usage [Basic] | 1분간 평균 시스템 CPU 사용률 | % |

| Instance State [Basic] | Instance 상태 | state |

| Network In Bytes [Basic] | 수신 bytes | bytes |

| Network In Dropped [Basic] | 수신 패킷 드롭 | cnt |

| Network In Packets [Basic] | 수신 패킷 수 | cnt |

| Network Out Bytes [Basic] | 송신 bytes | bytes |

| Network Out Dropped [Basic] | 송신 패킷 드롭 | cnt |

| Network Out Packets [Basic] | 송신 패킷 수 | cnt |

| 성능 항목 | 상세 설명 | 단위 |

|---|---|---|

| Core Usage [IO Wait] | 대기 상태로 소요된 CPU 시간의 비율(디스크 대기) | % |

| Core Usage [System] | 커널 공간에서 소요된 CPU 시간의 비율 | % |

| Core Usage [User] | 사용자 공간에서 소요된 CPU 시간의 비율 | % |

| CPU Cores | 호스트에 있는 CPU 코어의 수 | cnt |

| CPU Usage [Active] | Idle 및 IOWait 상태 이외에 사용된 CPU 시간의 백분율 | % |

| CPU Usage [Idle] | 유휴 상태로 소요된 CPU 시간의 비율입니다. | % |

| CPU Usage [IO Wait] | 대기 상태로 소요된 CPU 시간의 비율(디스크 대기)입니다. | % |

| CPU Usage [System] | 커널에서 사용한 CPU 시간의 백분율 | % |

| CPU Usage [User] | 사용자 영역에서 사용한 CPU 시간의 백분율 | % |

| CPU Usage/Core [Active] | Idle 및 IOWait 상태 이외에 사용된 CPU 시간의 백분율 | % |

| CPU Usage/Core [Idle] | 유휴 상태로 소요된 CPU 시간의 비율입니다. | % |

| CPU Usage/Core [IO Wait] | 대기 상태로 소요된 CPU 시간의 비율(디스크 대기)입니다. | % |

| CPU Usage/Core [System] | 커널에서 사용한 CPU 시간의 백분율 | % |

| CPU Usage/Core [User] | 사용자 영역에서 사용한 CPU 시간의 백분율 | % |

| DiskCPU Usage [IO Request] | 장치에 대한 입출력 요청이 실행된 CPU 시간의 비율 | % |

| Disk Queue Size [Avg] | 장치에 대해 실행된 요청의 평균 대기열 길이입니다. | num |

| Disk Read Bytes | 장치에서 읽는 초당 바이트 수입니다. | bytes |

| Disk Read Bytes [Delta Avg] | 개별 Disk들의 system.diskio.read.bytes_delta의 평균 | bytes |

| Disk Read Bytes [Delta Max] | 개별 Disk들의 system.diskio.read.bytes_delta의 최대 | bytes |

| Disk Read Bytes [Delta Min] | 개별 Disk들의 system.diskio.read.bytes_delta의 최소 | bytes |

| Disk Read Bytes [Delta Sum] | 개별 Disk들의 system.diskio.read.bytes_delta의 합 | bytes |

| Disk Read Bytes [Delta] | 개별 Disk의 system.diskio.read.bytes 값의 delta | bytes |

| Disk Read Bytes [Success] | 성공적으로 읽은 총 바이트 수 | bytes |

| Disk Read Requests | 1초동안 디스크 디바이스의 읽기 요청 수 | cnt |

| Disk Read Requests [Delta Avg] | 개별 Disk들의 system.diskio.read.count_delta의 평균 | cnt |

| Disk Read Requests [Delta Max] | 개별 Disk들의 system.diskio.read.count_delta의 최대 | cnt |

| Disk Read Requests [Delta Min] | 개별 Disk들의 system.diskio.read.count_delta의 최소 | cnt |

| Disk Read Requests [Delta Sum] | 개별 Disk들의 system.diskio.read.count_delta의 합 | cnt |

| Disk Read Requests [Success Delta] | 개별 Disk의 system.diskio.read.count 의 delta | cnt |

| Disk Read Requests [Success] | 성공적으로 완료된 총 읽기 수 | cnt |

| Disk Request Size [Avg] | 장치에 대해 실행된 요청의 평균 크기(단위: 섹터)입니다. | num |

| Disk Service Time [Avg] | 장치에 대해 실행된 입력 요청의 평균 서비스 시간(밀리초)입니다. | ms |

| Disk Wait Time [Avg] | 지원할 장치에 대해 실행된 요청에 소요된 평균 시간입니다. | ms |

| Disk Wait Time [Read] | 디스크 평균 대기 시간 | ms |

| Disk Wait Time [Write] | 디스크 평균 대기 시간 | ms |

| Disk Write Bytes [Delta Avg] | 개별 Disk들의 system.diskio.write.bytes_delta의 평균 | bytes |

| Disk Write Bytes [Delta Max] | 개별 Disk들의 system.diskio.write.bytes_delta의 최대 | bytes |

| Disk Write Bytes [Delta Min] | 개별 Disk들의 system.diskio.write.bytes_delta의 최소 | bytes |

| Disk Write Bytes [Delta Sum] | 개별 Disk들의 system.diskio.write.bytes_delta의 합 | bytes |

| Disk Write Bytes [Delta] | 개별 Disk의 system.diskio.write.bytes 값의 delta | bytes |

| Disk Write Bytes [Success] | 성공적으로 쓰여진 총 바이트 수 | bytes |

| Disk Write Requests | 1초동안 디스크 디바이스의 쓰기 요청 수 | cnt |

| Disk Write Requests [Delta Avg] | 개별 Disk들의 system.diskio.write.count_delta의 평균 | cnt |

| Disk Write Requests [Delta Max] | 개별 Disk들의 system.diskio.write.count_delta의 최대 | cnt |

| Disk Write Requests [Delta Min] | 개별 Disk들의 system.diskio.write.count_delta의 최소 | cnt |

| Disk Write Requests [Delta Sum] | 개별 Disk들의 system.diskio.write.count_delta의 합 | cnt |

| Disk Write Requests [Success Delta] | 개별 Disk의 system.diskio.write.count의 Delta | cnt |

| Disk Write Requests [Success] | 성공적으로 완료된 총 쓰기 수 | cnt |

| Disk Writes Bytes | 장치에 쓰는 초당 바이트 수 | bytes |

| Filesystem Hang Check | filesystem(local/NFS) hang 체크(정상:1, 비정상:0) | status |

| Filesystem Nodes | 파일 시스템의 총 파일 노드 수입니다. | cnt |

| Filesystem Nodes [Free] | 파일 시스템의 총 가용 파일 노드 수입니다. | cnt |

| Filesystem Size [Available] | 권한 없는 사용자가 사용할 수 있는 디스크 공간(바이트) | bytes |

| Filesystem Size [Free] | 사용 가능한 디스크 공간(bytes) | bytes |

| Filesystem Size [Total] | 총 디스크 공간(bytes) | bytes |

| Filesystem Usage | 사용한 디스크 공간 백분율 | % |

| Filesystem Usage [Avg] | 개별 filesystem.used.pct들의 평균 | % |

| Filesystem Usage [Inode] | iNode 사용률 | % |

| Filesystem Usage [Max] | 개별 filesystem.used.pct 중에 Max | % |

| Filesystem Usage [Min] | 개별 filesystem.used.pct 중에 Min | % |

| Filesystem Usage [Total] | - | % |

| Filesystem Used | 사용한 디스크 공간(bytes) | bytes |

| Filesystem Used [Inode] | iNode 사용량 | bytes |

| Memory Free | 사용 가능한 총 메모리 양(bytes) | bytes |

| Memory Free [Actual] | 실제 사용가능한 Memory(bytes) | bytes |

| Memory Free [Swap] | 사용가능한 Swap memory | bytes |

| Memory Total | 총 Memory | bytes |

| Memory Total [Swap] | 총 Swap memory. | bytes |

| Memory Usage | 사용한 Memory의 백분율 | % |

| Memory Usage [Actual] | 실제 사용된 Memory의 백분율 | % |

| Memory Usage [Cache Swap] | cache 된 swap 사용률 | % |

| Memory Usage [Swap] | 사용한 Swap memory의 백분율 | % |

| Memory Used | 사용한 Memory | bytes |

| Memory Used [Actual] | 실제 사용된 Memory(bytes) | bytes |

| Memory Used [Swap] | 사용한 Swap memory | bytes |

| Collisions | 네트워크 충돌 | cnt |

| Network In Bytes | 수신된 byte 수 | bytes |

| Network In Bytes [Delta Avg] | 개별 Network들의 system.network.in.bytes_delta의 평균 | bytes |

| Network In Bytes [Delta Max] | 개별 Network들의 system.network.in.bytes_delta의 최대 | bytes |

| Network In Bytes [Delta Min] | 개별 Network들의 system.network.in.bytes_delta의 최소 | bytes |

| Network In Bytes [Delta Sum] | 개별 network 들의 system.network.in.bytes_delta의 합 | bytes |

| Network In Bytes [Delta] | 수신된 byte 수의 delta | bytes |

| Network In Dropped | 들어온 packet 중 삭제된 패킷의 수 | cnt |

| Network In Errors | 수신 중의 error 수 | cnt |

| Network In Packets | 수신된 packet 수 | cnt |

| Network In Packets [Delta Avg] | 개별 Network들의 system.network.in.packets_delta의 평균 | cnt |

| Network In Packets [Delta Max] | 개별 Network들의 system.network.in.packets_delta의 최대 | cnt |

| Network In Packets [Delta Min] | 개별 Network들의 system.network.in.packets_delta의 최소 | cnt |

| Network In Packets [Delta Sum] | 개별 Network들의 system.network.in.packets_delta의 합 | cnt |

| Network In Packets [Delta] | 수신된 packet 수의 delta | cnt |

| Network Out Bytes | 송신된 byte 수 | bytes |

| Network Out Bytes [Delta Avg] | 개별 Network들의 system.network.out.bytes_delta의 평균 | bytes |

| Network Out Bytes [Delta Max] | 개별 Network들의 system.network.out.bytes_delta의 최대 | bytes |

| Network Out Bytes [Delta Min] | 개별 Network들의 system.network.out.bytes_delta의 최소 | bytes |

| Network Out Bytes [Delta Sum] | 개별 Network들의 system.network.out.bytes_delta의 합 | bytes |

| Network Out Bytes [Delta] | 송신된 byte 수의 delta | bytes |

| Network Out Dropped | 나가는 packet 중 삭제된 packet 수 | cnt |

| Network Out Errors | 송신 중의 error 수 | cnt |

| Network Out Packets | 송신된 packet 수 | cnt |

| Network Out Packets [Delta Avg] | 개별 Network들의 system.network.out.packets_delta의 평균 | cnt |

| Network Out Packets [Delta Max] | 개별 Network들의 system.network.out.packets_delta의 최대 | cnt |

| Network Out Packets [Delta Min] | 개별 Network들의 system.network.out.packets_delta의 최소 | cnt |

| Network Out Packets [Delta Sum] | 개별 Network들의 system.network.out.packets_delta의 합 | cnt |

| Network Out Packets [Delta] | 송신된 packet 수의 delta | cnt |

| Open Connections [TCP] | 열려 있는 모든 TCP 연결 | cnt |

| Open Connections [UDP] | 열려 있는 모든 UDP 연결 | cnt |

| Port Usage | 접속가능한 port 사용률 | % |

| SYN Sent Sockets | SYN_SENT 상태의 소켓 수 (로컬에서 원격 접속시) | cnt |

| Kernel PID Max | kernel.pid_max 값 | cnt |

| Kernel Thread Max | kernel.threads-max 값 | cnt |

| Process CPU Usage | 마지막 업데이트 후 프로세스에서 소비한 CPU 시간의 백분율 | % |

| Process CPU Usage/Core | 마지막 이벤트 이후 프로세스에서 사용한 CPU 시간의 백분율 | % |

| Process Memory Usage | main memory(RAM) 에서 프로세스가 차지하는 비율 | % |

| Process Memory Used | Resident Set 사이즈. 프로세스가 RAM 에서 차지한 메모리 양 | bytes |

| Process PID | 프로세스 pid | pid |

| Process PPID | 부모 프로세스의 pid | pid |

| Processes [Dead] | deadProcesses 수 | cnt |

| Processes [Idle] | idle Processes 수 | cnt |

| Processes [Running] | running Processes 수 | cnt |

| Processes [Sleeping] | sleeping processes 수 | cnt |

| Processes [Stopped] | stopped processes 수 | cnt |

| Processes [Total] | 총 processes 수 | cnt |

| Processes [Unknown] | 상태를 검색할 수 없거나 알 수 없는 processes 수 | cnt |

| Processes [Zombie] | 좀비 processes 수 | cnt |

| Running Process Usage | process 사용률 | % |

| Running Processes | running processes 수 | cnt |

| Running Thread Usage | thread 사용률 | % |

| Running Threads | running processes 에서 실행중인 thread 수 총합 | cnt |

| Context Switches | context switch 수 (초당) | cnt |

| Load/Core [1 min] | 마지막 1 분 동안의 로드를 코어 수로 나눈 값 | cnt |

| Load/Core [15 min] | 마지막 15 분 동안의 로드를 코어 수로 나눈 값 | cnt |

| Load/Core [5 min] | 마지막 5 분 동안의 로드를 코어 수로 나눈 값 | cnt |

| Multipaths [Active] | 외장 스토리지 연결 path status = active 카운트 | cnt |

| Multipaths [Failed] | 외장 스토리지 연결 path status = failed 카운트 | cnt |

| Multipaths [Faulty] | 외장 스토리지 연결 path status = faulty 카운트 | cnt |

| NTP Offset last | sample의 measured offset (NTP 서버와 로컬환경 간의 시간 차이) | num |

| Run Queue Length | 실행 대기열 길이 | num |

| Uptime | OS 가동시간(uptime) (milliseconds) | ms |

| Context Switchies CPU | context switch 수(초당) | cnt |

| Disk Read Bytes [Sec] | windows logical 디스크에서 1초동안 읽어들인 바이트 수

| cnt |

| Disk Read Time [Avg] | 데이터 읽기 평균 시간(초)

| sec |

| Disk Transfer Time [Avg] | 디스크 average wait time (초)

| sec |

| Disk Write Bytes [Sec] | windows logical 디스크에서 1초동안 쓰여진 바이트 수

| cnt |

| Disk Write Time [Avg] | 데이터 쓰기 평균 시간 (초)

| sec |

| Pagingfile Usage | paging file 사용률

| % |

| Pool Used [Non Paged] | 커널 메모리 중 Nonpaged Pool 사용량

| bytes |

| Pool Used [Paged] | 커널 메모리 중 Paged Pool 사용량

| bytes |

| Process [Running] | 현재 동작 중인 프로세스 수

| cnt |

| Threads [Running] | 현재 동작 중인 thread 수

| cnt |

| Threads [Waiting] | 프로세서 시간을 기다리는 thread 수

| cnt |

1.1.3 - ServiceWatch 지표

Virtual Server는 ServiceWatch로 지표를 전송합니다. 기본 모니터링으로 제공되는 지표는 5분 주기로 수집된 데이터입니다. 세부 모니터링을 활성화하면, 1분 주기로 수집된 데이터를 확인할 수 있습니다.

Virtual Server의 세부 모니터링 활성화하는 방법은 How-to guides > ServiceWatch 세부 모니터링 활성화하기를 참고하세요.

기본 지표

다음은 네임스페이스 Virtual Server에 대한 기본 지표입니다.

| 성능 항목 | 상세 설명 | 단위 | 의미있는 통계 |

|---|---|---|---|

| Instance State | 인스턴스 상태 표시 | - | - |

| CPU Usage | CPU 사용률 | Percent |

|

| Disk Read Bytes | 블록 장치에서 읽은 용량(바이트) | Bytes |

|

| Disk Read Requests | 블록 장치에서의 읽기 요청 수 | Count |

|

| Disk Write Bytes | 블록 장치에서 쓰기 용량(바이트) | Bytes |

|

| Disk Write Requests | 블록 장치에서의 쓰기 요청 수 | Count |

|

| Network In Bytes | 네트워크 인터페이스에서 수신된 용량(바이트) | Bytes |

|

| Network In Dropped | 네트워크 인터페이스에서 수신된 패킷 드롭 수 | Count |

|

| Network In Packets | 네트워크 인터페이스에서 수신된 패킷 수 | Count |

|

| Network Out Bytes | 네트워크 인터페이스에서 전송된 용량(바이트) | Bytes |

|

| Network Out Dropped | 네트워크 인터페이스에서 전송된 패킷 드롭 수 | Count |

|

| Network Out Packets | 네트워크 인터페이스에서 전송된 패킷 수 | Count |

|

1.2 - How-to guides

사용자는 Samsung Cloud Platform Console을 통해 Virtual Server의 필수 정보를 입력하고, 상세 옵션을 선택하여 해당 서비스를 생성할 수 있습니다.

Virtual Server 생성하기

Samsung Cloud Platform Console에서 Virtual Server 서비스를 생성하여 사용할 수 있습니다.

Virtual Server를 생성하려면 다음 절차를 따르세요.

- 모든 서비스 > Compute > Virtual Server 메뉴를 클릭하세요. Virtual Server의 Service Home 페이지로 이동합니다.

- Service Home 페이지에서 Virtual Server 생성 버튼을 클릭하세요. Virtual Server 생성 페이지로 이동합니다.

- Virtual Server 생성 페이지에서 서비스 생성에 필요한 정보들을 입력하고, 상세 옵션을 선택하세요.

- Image 및 버전 선택 영역에서 필요한 정보를 선택하세요.

구분 필수 여부상세 설명 Image 필수 제공하는 Image 종류 선택 - 표준: Samsung Cloud Platform 표준 제공 Image

- Alma Linux, Oracle Linux, RHEL, Rocky Linux, Ubuntu, Windows

- Custom: 사용자 생성 Image

- Kubernetes: Kubernetes용 Image

- RHEL, Ubuntu

- Marketplace: Marketplace에서 구독한 Image

Image 버전 필수 선택한 Image의 버전 선택 - 제공하는 서버 Image의 버전 리스트 제공

표. Virtual Server Image 및 버전 선택 입력 항목 - 표준: Samsung Cloud Platform 표준 제공 Image

- 서비스 정보 입력 영역에서 필요한 정보를 입력 또는 선택하세요.

구분 필수 여부상세 설명 서버 수 필수 동시 생성할 서버 수 - 숫자만 입력 가능하며 1~100 사이의 값 입력

서비스 유형 > 서버 타입 필수 Virtual Server 서버 타입 - Standard: 일반적으로 사용되는 표준 사양

- High Capacity: Standard 이상의 대용량 서버 사양

- Virtual Server에서 제공하는 서버 타입에 대한 자세한 내용은 Virtual Server 서버 타입을 참고

서비스 유형 > Planned Compute 필수 Planned Compute가 설정된 자원 현황 - 사용중: Planned Compute가 설정된 자원 중 사용 중인 개수

- 설정: Planned Compute가 설정된 자원의 개수

- Coverage 미리보기: 자원별 Planned Compute로 적용된 금액

- Planned Compute 서비스 신청: Planned Compute 서비스 생성 페이지로 이동

- 자세한 내용은 Planned Compute 신청하기를 참고

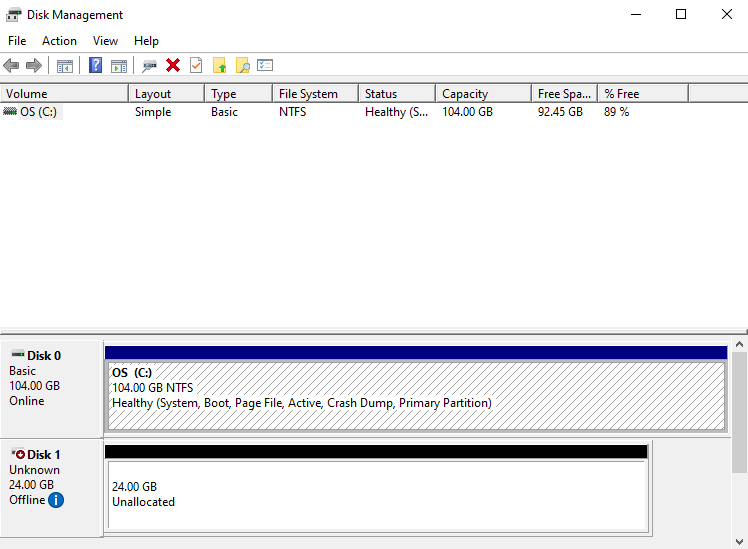

Block Storage 필수 용도에 따라 서버가 사용하는 Block Storage 설정 - 기본 OS: OS가 설치되어 사용되는 영역

- 용량은 Units 단위로 입력하며, OS Image 종류에 따라 최소 용량이 다름

- Alma Linux: 2~1,536 사이의 값을 입력

- Oracle Linux: 7~1,536 사이의 값을 입력

- RHEL: 2~1,536 사이의 값을 입력

- Rocky Linux: 2~1,536 사이의 값을 입력

- Ubuntu: 2~1,536 사이의 값을 입력

- Windows: 4~1,536 사이의 값을 입력

- SSD: 고성능 일반 볼륨

- HDD: 일반 볼륨

- SSD/HDD_KMS: Samsung Cloud Platform KMS(Key Management Service) 암호화키를 사용하는 추가 암호화 볼륨

- 암호화 적용은 최초 생성 시에만 적용 가능하고, 생성 후 변경 불가

- SSD_KMS 디스크 유형을 사용하는 경우에는 성능 저하가 발생

- 용량은 Units 단위로 입력하며, OS Image 종류에 따라 최소 용량이 다름

- 추가: OS영역 외 사용자 추가 공간 필요 시 사용

- 사용을 선택한 후, 스토리지의 유형과 용량을 입력

- 스토리지를 추가하려면 + 버튼을 클릭하고, 삭제하려면 x 버튼을 클릭(최대 25개까지 추가)

- 용량은 Units 단위로 입력하며, 1~1,536 사이의 값을 입력

- 1 Unit은 8GB이므로 8 ~ 12,288GB가 생성됨

- SSD: 고성능 일반 볼륨

- HDD: 일반 볼륨

- SSD/HDD_KMS: Samsung Cloud Platform KMS(Key Management Service) 암호화키를 사용하는 추가 암호화 볼륨

- 암호화 적용은 최초 생성 시에만 적용 가능하고, 생성 후 변경 불가

- SSD_KMS 디스크 유형을 사용하는 경우에는 성능 저하가 발생할 수 있음

- SSD_MultiAttach: 2개 이상의 서버 연결이 가능한 볼륨

- Block Storage 유형별 자세한 내용은 Block Storage 생성하기를 참고

- Delete on termination: Delete on Termination 선택 시, 서버를 해지하면 해당 Volume이 같이 해지

- Snapshot이 존재하는 볼륨은 Delete on termination이 사용 일 때도 삭제되지 않음

- Multi attach 볼륨은 삭제하려는 서버가 볼륨에 연결된 마지막 남은 서버일 때만 삭제

Server Group 선택 동일 Server Group에 소속된 서버를 Anti-Affinity(분산배치), Affinity(근접배치), Partition(Virtual Server와 Block Storage 분산배치) 설정 - 사용을 선택한 후, Server Group을 선택

- 신규 생성을 선택하여 Server Group 생성

- 동일 Server Group에 소속된 서버를 선택한 정책에 따라 Best Effort 방식으로 배치

- 정책은 Anti-Affinity(분산배치), Affinity(근접배치), Partition(Virtual Server와 Block Storage 분산배치) 중 선택

표. Virtual Server 서비스 정보 입력 항목

- Image 및 버전 선택 영역에서 필요한 정보를 선택하세요.

- Server Group 정책 중 Partition(Virtual Server와 Block Storage 분산배치) 정책을 사용할 경우, Virtual Server 생성 이후 Block Storage Volume 추가 할당이 불가하오니, Virtual Server 생성 단계에서 필요한 Block Storage를 모두 생성하세요.

* **필수 정보 입력** 영역에서 필요한 정보를 입력 또는 선택하세요.

| 구분 | 필수 여부 | 상세 설명 |

|---|---|---|

| 서버명 | 필수 | 선택한 서버 수가 1인 경우에 서버 구별을 위한 이름 입력

|

| 네트워크설정 > 신규 네트워크 포트 생성 | 필수 | Virtual Server가 설치될 네트워크를 설정

|

| 네트워크설정 > 기존 네트워크 포트 지정 | 필수 | Virtual Server가 설치될 네트워크를 설정

|

| Keypair | 필수 | 서버에 연결할 때 사용할 사용자 증명 방법

|

| 구분 | 필수 여부 | 상세 설명 |

|---|---|---|

| Lock | 선택 | Lock 사용 여부 설정

|

| Init script | 선택 | 서버 시작 시, 실행하는 스크립트

|

| 태그 | 선택 | 태그 추가

|

서버명 입력 시 공백과 특수문자 (_) 사용할 경우 OS의 hostname은 공백과 특수문자 (_)가 특수문자 (-)로 변경되어 설정됩니다. OS의 hostname 설정 시 참고하세요.

- 예시: 서버명이 ‘server name_01’ 인 경우 OS의 hostname은 ‘server-name-01’로 설정됩니다.

- Rocky Linux, Oracle Linux로 Virtual Server를 생성한 경우 시간 동기화(NTP:Network Time Protocol)를 위해 추가 설정이 필요합니다. 자세한 내용은 Linux NTP 설정하기를 참고하세요.

- 2025년 7월 이전 RHEL 및 Windows Server를 생성한 경우 RHEL Repository 및 WKMS(Windows Key Management Service) 설정 수정이 필요합니다. 자세한 내용은 RHEL Repo 및 WKMS 설정하기를 참고하세요.

Virtual Server 상세 정보 확인하기

Virtual Server 서비스는 전체 자원 목록과 상세 정보를 확인하고 수정할 수 있습니다. Virtual Server 상세 페이지에서는 상세 정보, 태그, 작업 이력 탭으로 구성되어 있습니다.

Virtual Server 서비스의 상세 정보를 확인하려면 다음 절차를 따르세요.

- 모든 서비스 > Compute > Virtual Server 메뉴를 클릭하세요. Virtual Server의 Service Home 페이지로 이동합니다.

- Service Home 페이지에서 Virtual Server 메뉴를 클릭하세요. Virtual Server 목록 페이지로 이동합니다.

- Virtual Server 목록 페이지에서 상세 정보를 확인할 자원을 클릭하세요. Virtual Server 상세 페이지로 이동합니다.

- Virtual Server 상세 페이지에는 상태 정보 및 부가 기능 정보가 표시되며, 상세 정보, 태그, 작업 이력 탭으로 구성됩니다.

- Virtual Server 부가 기능에 대한 자세한 내용은 Virtual Server 관리 부가 기능을 참고하세요.

구분 상세 설명 Virtual Server 상태 사용자가 생성한 Virtual Server의 상태 - Build: Build 명령이 전달된 상태

- Building: Build 진행중

- Networking: 서버 생성 진행중 프로세스

- Scheduling: 서버 생성 진행중 프로세스

- Block_Device_Mapping: 서버 생성시 Block Storage 연결중

- Spawning: 서버 생성 프로세스가 진행중인 상태

- Active: 사용 가능한 상태

- Powering_off: 중지 요청시 상태

- Deleting: 서버 삭제 진행중

- Reboot_Started: Reboot 진행중 상태

- Error: 에러 상태

- Migrating: 다른 호스트로 서버가 Migration 되는 상태

- Reboot: Reboot 명령이 전달된 상태

- Rebooting: 재시작 진행중

- Rebuild: Rebuild 명령이 전달된 상태

- Rebuilding: Rebuild 요청시 상태

- Rebuild_Spawning: Rebuild 프로세스가 진행중인 상태

- Resize: Resize 명령이 전달된 상태

- Resizing: Resize 진행중

- Resize_Prep: 서버 타입 수정 요청시 상태

- Resize_Migrating: 서버가 Resize 진행 동시에 다른 호스토로 이동중인 상태

- Resize_Migrated: 서버가 Resize 진행 동시에 다른 호스트로 이동 완료된 상태

- Resize_Finish: Resize가 완료됨

- Revert_Resize: 어떤 이유로 서버의 Resize 또는 마이그레이션 실패. 대상 서버가 정리되고 원래 원본 서버가 다시 시작됨

- Shutoff: Powering off 완료 시 상태

- Verity_ Resize: 서버 타입 수정 요청에 따라 Resize_Prep 진행 이후, 서버 타입 확정/서버 타입 원복 선택 가능 상태

- Resize_Reverting: 서버 타입 원복 요청 시 상태

- Resize_Confirming: 서버의 Resize 요청을 확인중인 상태

서버 제어 서버 상태를 변경할 수 있는 버튼 - 시작: 중지된 서버를 시작

- 중지: 가동 중인 서버를 중지

- 재시작: 가동 중인 서버를 재시작

Image 생성 현재 서버의 Image로 사용자 Image 생성 - 자세한 Image 생성 방법은 Image 생성하기를 참고

콘솔 로그 현재 서버의 콘솔 로그 조회 - 현재 서버에서 출력되는 콘솔 로그를 확인할 수 있음. 자세한 내용은 콘솔 로그 확인하기를 참고

Dump 생성 현재 서버의 Dump를 생성 - Dump 파일은 Virtual Server 안에 생성됨

- 자세한 Dump 생성 방법은 Dump 생성하기를 참고

Rebuild 기존 Virtual Server의 OS 영역 데이터와 설정이 삭제되고, 새로운 서버로 Rebuild하여 구성 - 자세한 내용은 Rebuild 수행하기를 참고

서비스 해지 서비스를 해지하는 버튼 표. Virtual Server 상태 정보 및 부가 기능

상세 정보

Virtual Server 목록 페이지에서 선택한 자원의 상세 정보를 확인하고, 필요한 경우 정보를 수정할 수 있습니다.

| 구분 | 상세 설명 |

|---|---|

| 서비스 | 서비스명 |

| 자원 유형 | 자원 유형 |

| SRN | Samsung Cloud Platform에서의 고유 자원 ID

|

| 자원명 | 자원 이름

|

| 자원 ID | 서비스에서의 고유 자원 ID |

| 생성자 | 서비스를 생성한 사용자 |

| 생성 일시 | 서비스를 생성한 일시 |

| 수정자 | 서비스 정보를 수정한 사용자 |

| 수정 일시 | 서비스 정보를 수정한 일시 |

| 서버명 | 서버 이름

|

| 서버 타입 | vCPU, 메모리 정보 표시

|

| Image명 | 서버의 OS Image 및 버전

|

| Lock | Lock 사용/미사용 여부 표시

|

| 서버 그룹 | 서버가 속한 서버 그룹명

|

| Keypair명 | 사용자가 설정한 서버 인증 정보

|

| Planned Compute | Planned Compute가 설정된 자원 현황

|

| LLM Endpoint | LLM 이용을 위한 URL

|

| ServiceWatch 세부 모니터링 | ServiceWatch 세부 모니터링 활성화 여부 표시

|

| 네트워크 | Virtual Server의 네트워크 정보

|

| 로컬 Subnet | Virtual Server의 로컬 Subnet 정보

|

| Block Storage | 서버에 연결된 Block Storage 정보

|

태그

Virtual Server 목록 페이지에서 선택한 자원의 태그 정보를 확인하고, 추가하거나 변경 또는 삭제할 수 있습니다.

| 구분 | 상세 설명 |

|---|---|

| 태그 목록 | 태그 목록

|

작업 이력

Virtual Server 목록 페이지에서 선택한 자원의 작업 이력을 확인할 수 있습니다.

| 구분 | 상세 설명 |

|---|---|

| 작업 이력 목록 | 자원 변경 이력

|

Virtual Server 가동 제어하기

생성된 Virtual Server 자원의 가동 제어가 필요한 경우, Virtual Server 목록 또는 Virtual Server 상세 페이지에서 작업을 수행할 수 있습니다. 가동 중인 서버의 시작, 중지, 재시작을 할 수 있습니다.

Virtual Server 시작하기

중지(Shutoff)된 Virtual Server를 시작할 수 있습니다. Virtual Server를 시작하려면 다음 절차를 따르세요.

- 모든 서비스 > Compute > Virtual Server 메뉴를 클릭하세요. Virtual Server의 Service Home 페이지로 이동합니다.

- Service Home 페이지에서 Virtual Server 메뉴를 클릭하세요. Virtual Server 목록 페이지로 이동합니다.

- Virtual Server 목록 페이지에서 중지(Shutoff)된 서버 중 시작할 자원을 클릭하여, Virtual Server 상세 페이지로 이동합니다.

- Virtual Server 목록 페이지에서 각 자원 별로 오른쪽 더보기 버튼을 통해 시작할 수 있습니다.

- 여러 대 서버를 체크 박스 선택한 후, 상단의 시작 버튼을 통해 여러 대 서버를 동시에 제어할 수 있습니다.

- Virtual Server 상세 페이지에서 상단의 시작 버튼을 클릭하여, 서버를 시작합니다. 상태 표시 항목에서 변경된 서버의 상태를 확인하세요.

- Virtual Server 시작이 완료되면 서버 상태가 Shutoff에서 Active로 변경됩니다.

- Virtual Server 상태에 대한 자세한 내용은 Virtual Server 상세 정보 확인하기를 참고하세요.

Virtual Server 중지하기

가동(Active)중인 Virtual Server를 중지할 수 있습니다. Virtual Server를 중지하려면 다음 절차를 따르세요.

- 모든 서비스 > Compute > Virtual Server 메뉴를 클릭하세요. Virtual Server의 Service Home 페이지로 이동합니다.

- Service Home 페이지에서 Virtual Server 메뉴를 클릭하세요. Virtual Server 목록 페이지로 이동합니다.

- Virtual Server 목록 페이지에서 가동(Active) 중인 서버 중 중지할 자원을 클릭하여, Virtual Server 상세 페이지로 이동합니다.

- Virtual Server 목록 페이지에서 각 자원 별로 오른쪽 더보기 버튼을 통해 중지할 수 있습니다.

- 여러 대 서버를 체크 박스 선택한 후, 상단의 중지 버튼을 통해 여러 대 서버를 동시에 제어할 수 있습니다.

- Virtual Server 상세 페이지에서 상단의 중지 버튼을 클릭하여, 서버를 시작합니다. 상태 표시 항목에서 변경된 서버의 상태를 확인하세요.

- Virtual Server 중지가 완료되면 서버 상태가 Active에서 Shutoff로 변경됩니다.

- Virtual Server 상태에 대한 자세한 내용은 Virtual Server 상세 정보 확인하기를 참고하세요.

Virtual Server 재시작하기

생성된 Virtual Server를 재시작할 수 있습니다. Virtual Server를 재시작하려면 다음 절차를 따르세요.

- 모든 서비스 > Compute > Virtual Server 메뉴를 클릭하세요. Virtual Server의 Service Home 페이지로 이동합니다.

- Service Home 페이지에서 Virtual Server 메뉴를 클릭하세요. Virtual Server 목록 페이지로 이동합니다.

- Virtual Server 목록 페이지에서 재시작할 자원을 클릭하여, Virtual Server 상세 페이지로 이동합니다.

- Virtual Server 목록 페이지에서 각 자원 별로 오른쪽 더보기 버튼을 통해 재시작할 수 있습니다.

- 여러 대 서버를 체크 박스 선택한 후, 상단의 재시작 버튼을 통해 여러 대 서버를 동시에 제어할 수 있습니다.

- Virtual Server 상세 페이지에서 상단의 재시작 버튼을 클릭하여, 서버를 시작합니다. 상태 표시 항목에서 변경된 서버의 상태를 확인하세요.

- Virtual Server 재시작 중에는 서버 상태가 Rebooting을 거쳐 최종 Active로 변경됩니다.

- Virtual Server 상태에 대한 자세한 내용은 Virtual Server 상세 정보 확인하기를 참고하세요.

Virtual Server 자원 관리하기

생성된 Virtual Server 자원의 서버 제어 및 관리 기능이 필요한 경우, Virtual Server 목록 또는 Virtual Server 상세 페이지에서 작업을 수행할 수 있습니다.

Image 생성하기

가동 중인 Virtual Server의 Image를 생성할 수 있습니다.

해당 내용은 가동 중인 Virtual Server로 사용자 Image를 생성하는 방법을 안내하고 있습니다.

- Virtual Server 목록 또는 Virtual Server 상세 페이지에서 Image 생성 버튼을 클릭하여 사용자 Image를 생성합니다.

- 사용자의 보유한 Image 파일을 업로드하여 Image 생성하는 방식은 Image 상세 가이드 내 Image 생성하기를 참고하세요.

Virtual Server의 Image를 생성하려면 다음 절차를 따르세요.

모든 서비스 > Compute > Virtual Server 메뉴를 클릭하세요. Virtual Server의 Service Home 페이지로 이동합니다.

Service Home 페이지에서 Virtual Server 메뉴를 클릭하세요. Virtual Server 목록 페이지로 이동합니다.

Virtual Server 목록 페이지에서 Image 생성할 자원을 클릭하세요. Virtual Server 상세 페이지로 이동합니다.

Virtual Server 상세 페이지에서 Image 생성 버튼을 클릭하세요. Image 생성 페이지로 이동합니다.

- 서비스 정보 입력 영역에서 필요한 정보를 입력하세요.

구분 필수 여부상세 설명 Image명 필수 생성할 Image의 이름 - 영문, 숫자, 공백과 특수문자(

-,_)를 사용하여 200자 이내로 입력

표. Image 서비스 정보 입력 항목 - 영문, 숫자, 공백과 특수문자(

- 서비스 정보 입력 영역에서 필요한 정보를 입력하세요.

입력 정보를 확인하고, 완료 버튼을 클릭하세요.

- 생성이 완료되면, 모든 서비스 > Compute > Virtual Server > Image 목록 페이지에서 생성한 자원을 확인하세요.

- Image를 생성하면 생성된 Image를 내부 저장소로 사용되는 Object Storage에 저장하게 됩니다. 따라서 Image 저장에 대한 사용 요금이 부과됩니다.

- Active 상태인 Virtual Server로부터 생성된 Image의 파일 시스템은 무결성을 보장할 수 없으므로 서버 정지 후 Image 생성을 권장합니다.

서버 타입 수정하기

Virtual Server 서버의 서버 타입을 수정할 수 있습니다.

Virtual Server의 서버 타입 수정을 하려면 다음 절차를 따르세요.

- 모든 서비스 > Compute > Virtual Server 메뉴를 클릭하세요. Virtual Server의 Service Home 페이지로 이동합니다.

- Service Home 페이지에서 Virtual Server 메뉴를 클릭하세요. Virtual Server 목록 페이지로 이동합니다.

- Virtual Server 목록 페이지에서 가동 제어할 자원을 클릭하세요. Virtual Server 상세 페이지로 이동합니다.

- Virtual Server 상세 페이지에서 서버 상태를 확인하고, 서버 타입 수정 버튼을 클릭하세요. 서버 타입 수정 팝업창이 열립니다.

- 서버 타입 수정 팝업창에서 서버 타입을 변경한 뒤, 확인 버튼을 클릭하세요.

- Virtual Server 서버 타입을 수정하면, Virtual Server 상태가 Resize 수행 관련 상태로 변경됩니다.

- Virtual Server 상태에 대한 자세한 내용은 Virtual Server 상세 정보 확인하기를 참고하세요.

IP 변경하기

IP 변경하는 방법은 IP 변경하기를 참고하세요.

- IP 변경을 진행하면 더 이상 해당 IP로 통신할 수 없으며, 진행 중에는 IP 변경을 취소할 수 없습니다.

- 변경된 IP를 적용하기 위해 서버가 재부팅 됩니다.

- Load Balancer 서비스 중인 서버일 경우, LB 서버 그룹에서 기존 IP를 삭제하고 변경된 IP를 LB 서버 그룹의 멤버로 직접 추가해야 합니다.

- Public NAT/Private NAT를 사용 중인 서버는 IP 변경 후, Public NAT/Private NAT의 사용을 해제하고 다시 설정해야 합니다.

- Public NAT/Private NAT를 사용 중인 경우에는 먼저 Public NAT/Private NAT의 사용을 해제하고 IP 변경을 완료한 후, 다시 설정하세요.

- Public NAT/Private NAT의 사용 여부는 Virtual Server 상세 페이지에서 Public NAT IP/Private NAT IP의 수정 버튼을 클릭하여 변경할 수 있습니다.

ServiceWatch 세부 모니터링 활성화하기

기본적으로 Virtual Server는 ServiceWatch와 기본 모니터링으로 연계되어 있습니다. 필요에 따라 세부 모니터링을 활성화하여 운영 문제를 보다 신속하게 식별하고 조치를 취할 수 있습니다. ServiceWatch에 대한 자세한 내용은 ServiceWatch 개요를 참조하세요.

Virtual Server의 ServiceWatch 세부 모니터링 활성화하려면 다음 절차를 따르세요.

- 모든 서비스 > Compute > Virtual Server 메뉴를 클릭하세요. Virtual Server의 Service Home 페이지로 이동합니다.

- Service Home 페이지에서 Virtual Server 메뉴를 클릭하세요. Virtual Server 목록 페이지로 이동합니다.

- Virtual Server 목록 페이지에서 ServiceWatch 세부 모니터링 활성화할 자원을 클릭하세요. Virtual Server 상세 페이지로 이동합니다.

- Virtual Server 상세 페이지에서 ServiceWatch 세부 모니터링 수정 버튼을 클릭하세요. ServiceWatch 세부 모니터링 수정 팝업창으로 이동합니다.

- ServiceWatch 세부 모니터링 수정 팝업창에서 활성화 선택한 후, 안내 문구를 확인하고 확인 버튼을 클릭하세요.

- Virtual Server 상세 페이지에서 ServiceWatch 세부 모니터링 항목을 확인하세요.

ServiceWatch 세부 모니터링 비활성화 하기

Virtual Server의 ServiceWatch 세부 모니터링 비활성화하려면 다음 절차를 따르세요.

- 모든 서비스 > Compute > Virtual Server 메뉴를 클릭하세요. Virtual Server의 Service Home 페이지로 이동합니다.

- Service Home 페이지에서 Virtual Server 메뉴를 클릭하세요. Virtual Server 목록 페이지로 이동합니다.

- Virtual Server 목록 페이지에서 ServiceWatch 세부 모니터링 비활성화할 자원을 클릭하세요. Virtual Server 상세 페이지로 이동합니다.

- Virtual Server 상세 페이지에서 ServiceWatch 세부 모니터링 수정 버튼을 클릭하세요. ServiceWatch 세부 모니터링 수정 팝업창으로 이동합니다.

- ServiceWatch 세부 모니터링 수정 팝업창에서 활성화 선택 해제한 후, 안내 문구를 확인하고 확인 버튼을 클릭하세요.

- Virtual Server 상세 페이지에서 ServiceWatch 세부 모니터링 항목을 확인하세요.

Virtual Server 관리 부가 기능

Virtual Server 서버 관리를 위해 콘솔 로그 조회, Dump 생성, Rebuild를 할 수 있습니다. Virtual Server의 콘솔 로그 조회, Dump 생성, Rebuild를 하려면 다음 절차를 따르세요.

콘솔 로그 확인하기

Virtual Server의 현재 콘솔 로그를 확인할 수 있습니다.

Virtual Server의 콘솔 로그 확인하려면 다음 절차를 따르세요.

- 모든 서비스 > Compute > Virtual Server 메뉴를 클릭하세요. Virtual Server의 Service Home 페이지로 이동합니다.

- Service Home 페이지에서 Virtual Server 메뉴를 클릭하세요. Virtual Server 목록 페이지로 이동합니다.

- Virtual Server 목록 페이지에서 콘솔 로그를 확인할 자원을 클릭하세요. Virtual Server 상세 페이지로 이동합니다.

- Virtual Server 상세 페이지에서 콘솔 로그 버튼을 클릭하세요. 콘솔 로그 팝업창으로 이동합니다.

- 콘솔 로그 팝업창에서 출력된 콘솔 로그를 확인합니다.

Dump 생성하기

Virtual Server의 Dump 파일을 생성하려면 다음 절차를 따르세요.

- 모든 서비스 > Compute > Virtual Server 메뉴를 클릭하세요. Virtual Server의 Service Home 페이지로 이동합니다.

- Service Home 페이지에서 Virtual Server 메뉴를 클릭하세요. Virtual Server 목록 페이지로 이동합니다.

- Virtual Server 목록 페이지에서 상세 정보를 확인할 자원을 클릭하세요. Virtual Server 상세 페이지로 이동합니다.

- Virtual Server 상세 페이지에서 Dump 생성 버튼을 클릭하세요.

- Dump 파일은 Virtual Server 안에 생성됩니다.

Rebuild 수행하기

기존 Virtual Server 서버의 OS영역 데이터와 설정을 삭제하고, 새로운 서버로 Rebuild하여 구성할 수 있습니다.

Virtual Server의 Rebuild를 수행하려면 다음 절차를 따르세요.

- 모든 서비스 > Compute > Virtual Server 메뉴를 클릭하세요. Virtual Server의 Service Home 페이지로 이동합니다.

- Service Home 페이지에서 Virtual Server 메뉴를 클릭하세요. Virtual Server 목록 페이지로 이동합니다.

- Virtual Server 목록 페이지에서 Rebuild를 수행할 자원을 클릭하세요. Virtual Server 상세 페이지로 이동합니다.

- Virtual Server 상세 페이지에서 Rebuild 버튼을 클릭하세요.

- Virtual Server Rebuild 중에는 서버 상태가 Rebuilding로 변경되었다가 Rebuild가 완료되면 Rebuild 수행 전 상태로 돌아옵니다.

- Virtual Server 상태에 대한 자세한 내용은 Virtual Server 상세 정보 확인하기를 참고하세요.

Virtual Server 해지하기

사용하지 않는 Virtual Server를 해지하면 운영 비용을 절감할 수 있습니다. 단, Virtual Server를 해지하면 운영 중인 서비스가 즉시 중단될 수 있으므로 서비스 중단 시 발생하는 영향을 충분히 고려한 후 해지 작업을 진행해야 합니다.

Virtual Server를 해지하려면 다음 절차를 따르세요.

- 모든 서비스 > Compute > Virtual Server 메뉴를 클릭하세요. Virtual Server의 Service Home 페이지로 이동합니다.

- Service Home 페이지에서 Virtual Server 메뉴를 클릭하세요. Virtual Server 목록 페이지로 이동합니다.

- Virtual Server 목록 페이지에서 해지할 자원을 선택하고, 서비스 해지 버튼을 클릭하세요.

- 연결된 스토리지의 해지는 Delete on termination 설정에 따라 다르오니, 해지 제약 사항을 참고하세요.

- 해지가 완료되면, Virtual Server 목록 페이지에서 자원이 해지되었는지 확인하세요.

해지 제약 사항

Virtual Server 해지 요청 시 해지가 불가한 경우에는 팝업창으로 안내합니다. 아래 케이스를 참고하세요.

- File Storage가 연결된 경우: File Storage 연결을 먼저 해지하세요.

- LB 서버 그룹이 연결된 경우: LB 서버 그룹Pool 연결을 먼저 해제하세요.

- Lock이 설정된 경우: Lock 설정을 미사용으로 변경한 후, 다시 시도하세요.

- Backup이 연결된 경우: Backup 연결을 먼저 해제하세요.

- Virtual Server에 연결된 Auto-Scaling Group이 In Service 상태가 아닌 경우: 연결된 Auto-Scaling Group의 상태를 변경한 후, 다시 시도하세요.

연결된 스토리지의 해지는 Delete on termination 설정에 따라 다르니 참고하세요.

- Delete on termination 설정 여부에 따라 볼륨 삭제 여부도 달라집니다.

- Delete on termination 미설정 시: Virtual Server를 해지해도 해당 볼륨이 삭제되지 않습니다.

- Delete on termination 설정 시: Virtual Server를 해지하면 해당 볼륨이 삭제됩니다.

- Snapshot이 존재하는 볼륨은 Delete on termination이 설정되어도 삭제되지 않습니다.

- Multi attach 볼륨은 삭제하려는 서버가 볼륨에 연결된 마지막 남은 서버일 때만 삭제됩니다.

1.2.1 - Image

사용자는 Samsung Cloud Platform Console을 통해 Virtual Server 서비스 내 Image 서비스의 필수 정보를 입력하고, 상세 옵션을 선택하여 해당 서비스를 생성할 수 있습니다.

Image 생성하기

Samsung Cloud Platform Console에서 Virtual Server 서비스를 사용하면서 Image 서비스를 생성하여 사용할 수 있습니다.

Image를 생성하려면 다음 절차를 따르세요.

모든 서비스 > Compute > Virtual Server 메뉴를 클릭하세요. Virtual Server의 Service Home 페이지로 이동합니다.

Service Home 페이지에서 Image 메뉴를 클릭하세요. Image 목록 페이지로 이동합니다.

Image 목록 페이지에서 Image 생성 버튼을 클릭하세요. Image 생성 페이지로 이동합니다.

- 서비스 정보 입력 영역에서 필요한 정보를 입력 또는 선택하세요.

구분 필수 여부상세 설명 Image명 필수 생성할 Image의 이름 - 영문, 숫자, 공백과 특수문자(

-,_)를 사용하여 255자 이내로 입력

Image 파일 > URL 필수 Object Storage 에 Image 파일을 업로드 한 후 URL 입력 - Object Storage 상세 페이지에서 URL을 복사 가능

- Image 파일을 업로드한 Object Storage의 Bucket은 생성할 서버와 동일한 존(Zone) 존재

- Image 파일은 .qcow2 확장자만 가능

- 안전한 Image 파일을 업로드하여 보안 위험을 최소화해야 함.

OS 타입 필수 업로드한 Image 파일의 OS 타입 - Alma Linux, CentOS, Oracle Linux, RHEL, Rocky Linux, Ubuntu 중 선택

최소 디스크 필수 생성할 Image의 최소 디스크 용량(GB) 0~12,288GB 사이의 값을 입력

최소 RAM 필수 생성할 Image의 최소 RAM 용량(GB) 0~2,097,151GB 사이의 값을 입력

Visibility 필수 Image에 대한 접근 권한을 표시 - Private: Account 내에서만 사용이 가능

- Shared: Account 간 공유가 가능

Protected 선택 Image 삭제 불가 여부를 선택 - 사용을 체크하면 Image를 실수로 삭제하지 않도록 방지

- 해당 설정은 Image 생성 이후 변경

표. Image 서비스 정보 입력 항목 - 영문, 숫자, 공백과 특수문자(

- 추가 정보 입력 영역에서 필요한 정보를 입력 또는 선택하세요.

구분 필수 여부상세 설명 태그 선택 태그 추가 - 자원 당 최대 50개까지 추가 가능

- 태그 추가 버튼을 클릭한 후 Key, Value 값을 입력 또는 선택

표. Image 추가 정보 입력 항목

- 서비스 정보 입력 영역에서 필요한 정보를 입력 또는 선택하세요.

요약 패널에서 생성한 상세 정보와 예상 청구 금액을 확인하고, 완료 버튼을 클릭하세요.

- 생성이 완료되면, Image 목록 페이지에서 생성한 자원을 확인하세요.

Image 상세 정보 확인하기

Image 서비스는 전체 자원 목록과 상세 정보를 확인하고 수정할 수 있습니다. Image 상세 페이지에서는 상세 정보, 태그, 작업 이력 탭으로 구성되어 있습니다.

Image 서비스의 상세 정보를 확인하려면 다음 절차를 따르세요.

- 모든 서비스 > Compute > Virtual Server 메뉴를 클릭하세요. Virtual Server의 Service Home 페이지로 이동합니다.

- Service Home 페이지에서 Image 메뉴를 클릭하세요. Image 목록 페이지로 이동합니다.

- Image 목록 페이지에서 상세 정보를 확인할 자원을 클릭하세요. Image 상세 페이지로 이동합니다.

- Image 상세 페이지에는 상태 정보 및 부가 기능 정보가 표시되며, 상세 정보, 태그, 작업 이력 탭으로 구성됩니다.

구분 상세 설명 Image 상태 사용자가 생성한 Image의 상태 - Active: 사용 가능한 상태

- Queued: Image 생성 요청 시, Image가 업로드 되어 처리 대기 중인 상태

- Importing: Image 생성 요청 시, Image가 업로드 되어 처리 중인 상태

공유용 Image 생성 다른 Account로 공유할 Image 생성 - Image의 Visibility가 private 상태이고 Image에 스냅샷 정보가 있는 경우에만 생성 가능

다른 Account로 공유 Image를 다른 Account로 공유 가능 - Image의 Visibility가 Shared 상태일 경우 다른 Account로 공유 가능

- 공유용 Image 생성 또는 qcow2 확장자 파일을 업로드하여 생성한 Image에만 표시

Image 삭제 Image를 삭제하는 버튼 - Image를 삭제하면 복구 불가

표. Image 상태 정보 및 부가 기능

- Image 상세 페이지에는 상태 정보 및 부가 기능 정보가 표시되며, 상세 정보, 태그, 작업 이력 탭으로 구성됩니다.

상세 정보

Image 목록 페이지에서 선택한 자원의 상세 정보를 확인하고, 필요한 경우 정보를 수정할 수 있습니다.

| 구분 | 상세 설명 |

|---|---|

| 서비스 | 서비스명 |

| 자원 유형 | 자원 유형 |

| SRN | Samsung Cloud Platform에서의 고유 자원 ID

|

| 자원명 | Image 이름 |

| 자원 ID | Image의 고유 자원 ID |

| 생성자 | Image를 생성한 사용자 |

| 생성 일시 | Image를 생성한 일시 |

| 수정자 | Image 정보를 수정한 사용자 |

| 수정 일시 | Image 정보를 수정한 일시 |

| Image명 | Image 이름 |

| 최소 디스크 | Image의 최소 디스크 용량(GB)

|

| 최소 RAM | Image의 최소 RAM 용량(GB) |

| OS 타입 | Image의 OS 타입

|

| OS hash algorithm | OS hash algorithm 방식 |

| Visibility | Image에 대한 접근 권한을 표시

|

| Protected | Image 삭제 불가 여부를 선택

|

| Image 크기 | Image의 크기

|

| Image 유형 | Image 생성 방법에 따른 구분

|

| Image 파일 URL | Image 생성 시 Object Storage에 업로드 한 Image 파일 URL

|

| 공유 현황 | 다른 Account로 Image를 공유하고 있는 현황

|

태그

Image 목록 페이지에서 선택한 자원의 태그 정보를 확인하고, 추가하거나 변경 또는 삭제할 수 있습니다.

| 구분 | 상세 설명 |

|---|---|

| 태그 목록 | 태그 목록

|

작업 이력

Image 목록 페이지에서 선택한 자원의 작업 이력을 확인할 수 있습니다.

| 구분 | 상세 설명 |

|---|---|

| 작업 이력 목록 | 자원 변경 이력

|

Image 자원 관리하기

생성된 Image 의 제어 및 관리 기능을 설명합니다.

공유용 Image 생성하기

다른 Account로 공유할 Image 생성합니다.

- Image의 Visibility가 private 상태이고 Image에 스냅샷 정보가 있는 경우에만 공유용 Image를 생성할 수 있습니다.

- 공유용 Image는 OS영역 디스크 볼륨 1개만 이미지화 대상에 포함됩니다. 추가로 연결된 데이터 볼륨은 Image에 포함되지 않으므로, 필요한 경우 별도의 볼륨으로 데이터 복사 후 볼륨 이전 기능을 활용해주세요.

공유용 Image를 생성하려면 다음 절차를 따르세요.

- 공유할 Account에 접속하여 모든 서비스 > Compute > Virtual Server 메뉴를 클릭하세요. Virtual Server의 Service Home 페이지로 이동합니다.

- Service Home 페이지에서 Image 메뉴를 클릭하세요. Image 목록 페이지로 이동합니다.

- Image 목록 페이지에서 공유용 Image를 생성할 Image를 클릭하세요. Image 상세 페이지로 이동합니다.

- 공유용 Image 생성 버튼을 클릭하세요. 공유용 Image 생성을 알리는 팝업창이 열립니다.

- 알림 내용을 확인한 후, 완료 버튼을 클릭하세요.

다른 Account로 Image 공유하기

다른 Account로 공유할 Image 생성합니다.

- .qcow2 확장자 파일을 업로드하여 생성하거나 Image 상세 페이지에서 공유용 Image 생성으로 생성한 Image만 다른 Account로 공유할 수 있습니다.

- 공유할 Image의 Visibility가 Shared이어야 합니다.

Image를 다른 Account로 공유하려면 다음 절차를 따르세요.

공유할 Account에 접속하여 모든 서비스 > Compute > Virtual Server 메뉴를 클릭하세요. Virtual Server의 Service Home 페이지로 이동합니다.

Service Home 페이지에서 Image 메뉴를 클릭하세요. Image 목록 페이지로 이동합니다.

Image 목록 페이지에서 다른 Account로 공유할 Image를 클릭하세요. Image 상세 페이지로 이동합니다.

다른 Account로 공유 버튼을 클릭하세요. Image 공유를 알리는 팝업창이 열립니다.

알림 내용을 확인한 후, 확인 버튼을 클릭하세요. 다른 Account로 Image 공유 페이지로 이동합니다.

다른 Account로 Image 공유 페이지에서 공유 Account ID를 입력하고 완료 버튼을 클릭하세요. Image 공유를 알리는 팝업창이 열립니다.

구분 필수 여부상세 설명 Image명 - 공유할 Image의 이름 - 입력 불가

Image ID - 공유할 Image ID - 입력 불가

공유 Account ID 필수 공유할 다른 Account ID 입력 - 영문, 숫자, 특수문자

-를 사용하여 64자 이내로 입력

표. 다른 Account로 Image 공유 항목알림 내용을 확인한 후, 확인 버튼을 클릭하세요. Image 상세 페이지의 공유 현황에서 정보를 확인할 수 있습니다.

- 최초 요청 시에는 상태가 Pending 이고, 공유 받을 Account에서 승인이 완료되면 Accepted, 승인이 거부되면 Rejected로 변경됩니다.

다른 Account에서 공유한 Image 공유받기

Image를 다른 Account로부터 공유 받으려면 다음 절차를 따르세요.

공유 받을 Account에 접속하여 모든 서비스 > Compute > Virtual Server 메뉴를 클릭하세요. Virtual Server의 Service Home 페이지로 이동합니다.

Service Home 페이지에서 Image 메뉴를 클릭하세요. Image 목록 페이지로 이동합니다.

Image 목록 페이지에서 더보기 > Image 공유 요청 목록 버튼을 클릭하세요. Image 공유 요청 목록 팝업창이 열립니다.

Image 공유 요청 목록 팝업창에서 공유 받을 Image의 승인 또는 거부 버튼을 클릭하세요.

구분 상세 설명 Image명 공유 Image의 이름 OS 타입 공유 Image의 OS 타입 Owner Account ID 공유 Image의 Owner Account ID 생성 일시 공유 Image의 생성 일시 승인 해당 공유 Image를 승인 처리 거부 해당 공유 Image를 거부 처리 표. Image 공유 요청 목록 항목알림 내용을 확인한 후, 확인 버튼을 클릭하세요. Image 목록에서 공유받은 Image를 확인할 수 있습니다.

Image 삭제하기

사용하지 않는 Image를 삭제할 수 있습니다. 단, Image를 삭제하면 복구할 수 없으므로 Image 삭제 시에는 발생하는 영향을 충분히 고려한 후 삭제 작업을 진행해야 합니다.

Image를 삭제하려면 다음 절차를 따르세요.

- 모든 서비스 > Compute > Virtual Server 메뉴를 클릭하세요. Virtual Server의 Service Home 페이지로 이동합니다.

- Service Home 페이지에서 Image 메뉴를 클릭하세요. Image 목록 페이지로 이동합니다.

- Image 목록 페이지에서 삭제할 자원을 선택하고, 삭제 버튼을 클릭하세요.

- Image 목록 페이지에서 다수의 Image 체크 박스를 선택하고, 자원 목록 상단의 삭제 버튼을 클릭하세요.

- 삭제가 완료되면 Image 목록 페이지에서 자원이 삭제되었는지 확인하세요.

1.2.2 - Keypair

사용자는 Samsung Cloud Platform Console을 통해 Virtual Server 서비스 내 Keypair의 필수 정보를 입력하고, 상세 옵션을 선택하여 해당 서비스를 생성할 수 있습니다.

Keypair 생성하기

Samsung Cloud Platform Console에서 Virtual Server 서비스를 사용하면서 Keypair 서비스를 생성하여 사용할 수 있습니다.

Keypair 생성하려면 다음 절차를 따르세요.

- 모든 서비스 > Compute > Virtual Server 메뉴를 클릭하세요. Virtual Server의 Service Home 페이지로 이동합니다.

- Service Home 페이지에서 Keypair 메뉴를 클릭하세요. Keypair 목록 페이지로 이동합니다.

- Keypair 목록 페이지에서 Keypair 생성 버튼을 클릭하세요. Keypair 생성 페이지로 이동합니다.

- 서비스 정보 입력 영역에서 필요한 정보를 입력하세요.

구분 필수 여부상세 설명 Keypair명 필수 생성할 Keypair의 이름 - 영문, 숫자, 공백과 특수문자(

-,_)를 사용하여 255자 이내로 입력

Keypair 유형 필수 ssh 표. Keypair 서비스 정보 입력 항목 - 영문, 숫자, 공백과 특수문자(

- 추가 정보 입력 영역에서 필요한 정보를 입력 또는 선택하세요.

구분 필수 여부상세 설명 태그 선택 태그 추가 - 자원 당 최대 50개까지 추가 가능

- 태그 추가 버튼을 클릭한 후 Key, Value 값을 입력 또는 선택

표. Keypair 추가 정보 입력 항목주의- 생성 완료 후 최초 1회에 한해서 Key를 다운로드할 수 있습니다. 재발급이 불가능하므로, 다운로드 되었는지 확인하세요.

- 다운로드 받은 Private Key는 안전한 곳에 저장하세요.

- 서비스 정보 입력 영역에서 필요한 정보를 입력하세요.

- 입력 정보를 확인하고, 완료 버튼을 클릭하세요.

- 생성이 완료되면, Keypair 목록 페이지에서 생성한 자원을 확인하세요.

Keypair 상세 정보 확인하기

Keypair 서비스는 전체 자원 목록과 상세 정보를 확인하고 수정할 수 있습니다. Keypair 상세 페이지에서는 상세 정보, 태그, 작업 이력 탭으로 구성되어 있습니다.

Keypair 상세 정보를 확인하려면 다음 절차를 따르세요.

- 모든 서비스 > Compute > Virtual Server 메뉴를 클릭하세요. Virtual Server의 Service Home 페이지로 이동합니다.

- Service Home 페이지에서 Keypair 메뉴를 클릭하세요. Keypair 목록 페이지로 이동합니다.

- Keypair 목록 페이지에서 상세 정보를 확인할 자원을 클릭하세요. Keypair 상세 페이지로 이동합니다.

- Keypair 상세 페이지에는 상태 정보 및 부가 기능 정보가 표시되며, 상세 정보, 태그, 작업 이력 탭으로 구성됩니다.

상세 정보

Keypair 목록 페이지에서 선택한 자원의 상세 정보를 확인하고, 필요한 경우 정보를 수정할 수 있습니다.

| 구분 | 상세 설명 |

|---|---|

| 서비스 | 서비스명 |

| 자원 유형 | 자원 유형 |

| SRN | Samsung Cloud Platform에서의 고유 자원 ID

|

| 자원명 | Keypair 이름 |

| 자원 ID | Keypair의 고유 자원 ID |

| 생성자 | Keypair를 생성한 사용자 |

| 생성 일시 | Keypair를 생성한 일시 |

| 수정자 | Keypair 정보를 수정한 사용자 |

| 수정 일시 | Keypair정보를 수정한 일시 |

| Keypair명 | Keypair 이름 |

| Fingerprint | Key를 식별하기 위한 고유한 값 |

| 사용자 ID | Keypair 생성한 사용자 ID |

| 공개 키 | 공개 키 정보 |

태그

Keypair 목록 페이지에서 선택한 자원의 태그 정보를 확인하고, 추가하거나 변경 또는 삭제할 수 있습니다.

| 구분 | 상세 설명 |

|---|---|

| 태그 목록 | 태그 목록

|

작업 이력

Keypair 목록 페이지에서 선택한 자원의 작업 이력을 확인할 수 있습니다.

| 구분 | 상세 설명 |

|---|---|

| 작업 이력 목록 | 자원 변경 이력

|

Keypair 자원 관리하기

Keypair의 제어 및 관리 기능을 설명합니다.

공개 키 가져오기

공개 키 가져오기를 하려면 다음 절차를 따르세요.

모든 서비스 > Compute > Virtual Server 메뉴를 클릭하세요. Virtual Server의 Service Home 페이지로 이동합니다.

Service Home 페이지에서 Keypair 메뉴를 클릭하세요. Keypair 목록 페이지로 이동합니다.

Keypair 목록 페이지에서 상단의 더보기 버튼을 클릭하여 공개 키 가져오기 버튼을 클릭하세요. 공개 키 가져오기 페이지로 이동합니다.

- 필수 정보 입력 영역에 필요한 정보를 입력 또는 선택하세요.

구분 필수 여부상세 설명 Keypair명 필수 생성할 Keypair 이름 Keypair 유형 필수 ssh 공개 키 필수 공개 키 입력 - 파일 불러오기: 파일 첨부 버튼을 선택하여 공개 키 파일을 첨부

- 첨부 파일은 다음의 확장자 파일(.pem)만 가능

- 공개 키 입력: 복사한 공개 키 값을 붙여넣기

- Keypair 상세 페이지에서 공개 키 값을 복사 가능

표. 공개 키 가져오기 필수 입력 항목 - 파일 불러오기: 파일 첨부 버튼을 선택하여 공개 키 파일을 첨부

- 필수 정보 입력 영역에 필요한 정보를 입력 또는 선택하세요.

입력한 정보를 확인하고, 완료 버튼을 클릭하세요.

- 생성이 완료되면, Keypair 목록 페이지에서 생성한 자원을 확인하세요.

Keypair 삭제하기

사용하지 않는 Keypair를 삭제할 수 있습니다. 단, Keypair를 삭제하면 복구할 수 없으므로 사전에 충분한 영향도 검토 후 삭제를 진행하시기 바랍니다.

Keypair를 삭제하려면 다음 절차를 따르세요.

- 모든 서비스 > Compute > Virtual Server 메뉴를 클릭하세요. Virtual Server의 Service Home 페이지로 이동합니다.

- Service Home 페이지에서 Keypair 메뉴를 클릭하세요. Keypair 목록 페이지로 이동합니다.

- Keypair 목록 페이지에서 삭제할 자원을 선택하고, 삭제 버튼을 클릭하세요.

- Keypair 목록 페이지에서 다수의 Keypair 체크 박스를 선택하고, 자원 목록 상단의 삭제 버튼을 클릭하세요.

- 삭제가 완료되면 Keypair 목록 페이지에서 자원이 삭제되었는지 확인하세요.

1.2.3 - Server Group

사용자는 Samsung Cloud Platform Console을 통해 Virtual Server 서비스 내 Server Group의 필수 정보를 입력하고, 상세 옵션을 선택하여 해당 서비스를 생성할 수 있습니다.

Server Group 생성하기

Samsung Cloud Platform Console에서 Virtual Server 서비스를 사용하면서 Server Group 서비스를 생성하여 사용할 수 있습니다.

Server Group 생성하려면 다음 절차를 따르세요.

- 모든 서비스 > Compute > Virtual Server 메뉴를 클릭하세요. Virtual Server의 Service Home 페이지로 이동합니다.

- Server Group 페이지에서 Server Group 메뉴를 클릭하세요. Server Group 목록 페이지로 이동합니다.

- Server Group 목록 페이지에서 Server Group 생성 버튼을 클릭하세요. Server Group 생성 페이지로 이동합니다.

- 서비스 정보 입력 영역에서 필요한 정보를 입력 또는 선택하세요.

구분 필수 여부상세 설명 Server Group 명 필수 생성할 Server Group의 이름 - 영문, 숫자, 공백과 특수문자(

-,_)를 사용하여 255자 이내로 입력

정책 필수 동일 Server Group 에 소속된 Virtual Server를 Anti-Affinity(분산배치), Affinity(근접배치), Partition(Virtual Server와 Block Storage 분산배치) 설정 - Anti-Affinity(분산배치) 및 Affinity(근접배치) 정책은 동일 Server Group에 소속된 Virtual Server를 선택한 정책에 기반하여 Best Effort 방식으로 배치되나, 절대적으로 보장되지는 않음.

- Anti-Affinity(분산배치): 하나의 Server Group에 속한 서버들을 가급적 다른 랙 및 호스트에 배치시키는 정책

- Affinity(근접배치): 하나의 Server Group에 속한 서버들을 가급적 같은 랙 및 호스트 내에 근접하게 배치시키는 정책

- Partition(Virtual Server와 Block Storage 분산배치): 하나의 Server Group에 속한 Virtual Server와 해당 서버에 연결된 Block Storage를 서로 다른 분산 단위(Partition)에 배치시키는 정책

- Partition(Virtual Server와 Block Storage 분산배치) 정책은 각 Virtual Server와 해당 서버에 속한 Block Storage가 어느 Partition에 속해 있는지 명확히 확인할 수 있도록 Partition 번호를 함께 표시합니다.

- Partition 번호는 해당 Server Group에 설정된 Partition Size(최대 3)를 기준으로 부여됩니다.

표. Server Group 서비스 정보 입력 항목 - 영문, 숫자, 공백과 특수문자(

- 추가 정보 입력 영역에서 필요한 정보를 입력 또는 선택하세요.

구분 필수 여부상세 설명 태그 선택 태그 추가 - 자원 당 최대 50개까지 추가 가능

- 태그 추가 버튼을 클릭한 후 Key, Value 값을 입력 또는 선택

표. Server Group 추가 정보 입력 항목

- 서비스 정보 입력 영역에서 필요한 정보를 입력 또는 선택하세요.

- 입력 정보를 확인하고, 완료 버튼을 클릭하세요.

- 생성이 완료되면, Server Group 목록 페이지에서 생성한 자원을 확인하세요.

Server Group 상세 정보 확인하기

Server Group 서비스는 전체 자원 목록과 상세 정보를 확인하고 수정할 수 있습니다. Server Group 상세 페이지에서는 상세 정보, 태그, 작업 이력 탭으로 구성되어 있습니다.

Server Group 상세 정보를 확인하려면 다음 절차를 따르세요.

- 모든 서비스 > Compute > Virtual Server 메뉴를 클릭하세요. Virtual Server의 Service Home 페이지로 이동합니다.

- Service Home 페이지에서 Server Group 메뉴를 클릭하세요. Server Group 목록 페이지로 이동합니다.

- Server Group 목록 페이지에서 상세 정보를 확인할 자원을 클릭하세요. Server Group 상세 페이지로 이동합니다.

- Server Group 상세 페이지에는 상태 정보 및 부가 기능 정보가 표시되며, 상세 정보, 태그, 작업 이력 탭으로 구성됩니다.

상세 정보

Server Group 목록 페이지에서 선택한 자원의 상세 정보를 확인하고, 필요한 경우 정보를 수정할 수 있습니다.

| 구분 | 상세 설명 |

|---|---|

| 서비스 | 서비스명 |

| 자원 유형 | 자원 유형 |

| SRN | Samsung Cloud Platform에서의 고유 자원 ID

|

| 자원명 | Server Group 이름 |

| 자원 ID | Server Group의 고유 자원 ID |

| 생성자 | Server Group을 생성한 사용자 |

| 생성 일시 | Server Group을 생성한 일시 |

| Server Group명 | Server Group 이름 |

| 정책 | Anti-Affinity(분산배치), Affinity(근접배치), Partition(Virtual Server와 Block Storage 분산배치) |

| Server Group 멤버 | Server Group에 속한 Virtual Server 목록

|

태그

Server Group 목록 페이지에서 선택한 자원의 태그 정보를 확인하고, 추가하거나 변경 또는 삭제할 수 있습니다.

| 구분 | 상세 설명 |

|---|---|

| 태그 목록 | 태그 목록

|

작업 이력

Server Group 목록 페이지에서 선택한 자원의 작업 이력을 확인할 수 있습니다.

| 구분 | 상세 설명 |

|---|---|

| 작업 이력 목록 | 자원 변경 이력

|

Server Group 삭제하기

사용하지 않는 Server Group을 삭제할 수 있습니다. 단, Server Group을 삭제하면 복구할 수 없으므로 사전에 충분한 영향도 검토 후 삭제를 진행하시기 바랍니다.

Server Group을 삭제하려면 다음 절차를 따르세요.

- 모든 서비스 > Compute > Virtual Server 메뉴를 클릭하세요. Virtual Server의 Service Home 페이지로 이동합니다.

- Service Home 페이지에서 Server Group 메뉴를 클릭하세요. Server Group 목록 페이지로 이동합니다.

- Server Group 목록 페이지에서 삭제할 자원을 선택하고, 삭제 버튼을 클릭하세요.

- Server Group 목록 페이지에서 다수의 Server Group 체크 박스를 선택하고, 자원 목록 상단의 삭제 버튼을 클릭하세요.

- 삭제가 완료되면 Server Group 목록 페이지에서 자원이 삭제되었는지 확인하세요.

1.2.4 - IP 변경하기

Virtual Server의 IP를 변경하고 Virtual Server의 네트워크 포트를 추가하여 IP 설정할 수 있습니다.

IP 변경하기

Virtual Server의 IP를 변경할 수 있습니다.

- IP 변경을 진행하면 더 이상 해당 IP로 통신할 수 없으며, 진행 중에는 IP 변경을 취소할 수 없습니다.

- 변경된 IP를 적용하기 위해 서버가 재부팅 됩니다.

- Load Balancer 서비스 중인 서버일 경우, LB 서버 그룹에서 기존 IP를 삭제하고 변경된 IP를 LB 서버 그룹의 멤버로 직접 추가해야 합니다.

- Public NAT/Private NAT를 사용 중인 서버는 IP 변경 후, Public NAT/Private NAT의 사용을 해제하고 다시 설정해야 합니다.

- Public NAT/Private NAT를 사용 중인 경우에는 먼저 Public NAT/Private NAT의 사용을 해제하고 IP 변경을 완료한 후, 다시 설정하세요.

- Public NAT/Private NAT의 사용 여부는 Virtual Server 상세 페이지에서 Public NAT IP/Private NAT IP의 수정 버튼을 클릭하여 변경할 수 있습니다.

IP를 변경하려면 다음 절차를 따르세요.

- 모든 서비스 > Compute > Virtual Server 메뉴를 클릭하세요. Virtual Server의 Service Home 페이지로 이동합니다.

- Service Home 페이지에서 Virtual Server 메뉴를 클릭하세요. Virtual Server 목록 페이지로 이동합니다.

- Virtual Server 목록 페이지에서 IP를 변경할 자원을 클릭하세요. Virtual Server 상세 페이지로 이동합니다.

- Virtual Server 상세 페이지에서 IP를 변경할 IP 항목의 수정 버튼을 클릭하세요. IP 수정 팝업창이 열립니다.

- IP 수정 팝업창에서 Subnet을 선택한 후, 변경할 IP를 설정하세요.

- 입력: 변경할 IP를 직접 입력합니다.

- 자동 생성: IP를 자동으로 생성하여 적용합니다.

- 설정이 완료되면 확인 버튼을 클릭하세요.

- IP 수정을 알리는 팝업창이 열리면 확인 버튼을 클릭하세요.

네트워크 포트 추가 후 서버에서 IP 설정하기

Ubuntu Linux로 Virtual Server를 생성한 경우 Samsung Cloud Platform에서 네트워크 포트 추가 후 서버에서 IP 설정이 추가로 필요합니다.

Virtual Server의 OS의 root 사용자로 ip 명령어를 사용하여 할당된 네트워크 인터페이스명을 확인하세요.

배경색 변경ip aip a코드블록. ip 명령어 - 네트워크 인터페이스 확인 명령어 - 추가된 인터페이스가 있는 경우 다음과 같은 결과가 표시됩니다.

배경색 변경[root@scp-test-vm-01 ~] # ip a 3: ens7: <BROADCAST,MULTICAST> mtu 9000 qdisc noop state DOWN group default qlen 1000 link/ether fa:16:3e:98:b6:64 brd ff:ff:ff:ff:ff:ff altname enp0s7[root@scp-test-vm-01 ~] # ip a 3: ens7: <BROADCAST,MULTICAST> mtu 9000 qdisc noop state DOWN group default qlen 1000 link/ether fa:16:3e:98:b6:64 brd ff:ff:ff:ff:ff:ff altname enp0s7코드블록. ip 명령어 - 네트워크 인터페이스 확인 결과 텍스트 편집기(예시:vim)을 사용하여 /etc/netplan/50-cloud-init.yaml 파일을 불러오세요.

/etc/netplan/50-cloud-init.yaml 파일에 아래 내용을 추가하고 저장하세요.

배경색 변경network: version: 2 ethernets: ens7: match: macaddress: "fa:16:3e:98:b6:64" dhcp4: true set-name: "ens7" mtu: 9000network: version: 2 ethernets: ens7: match: macaddress: "fa:16:3e:98:b6:64" dhcp4: true set-name: "ens7" mtu: 9000코드블록. YAML 파일 편집

netplan 명령어를 사용하여 추가된 네트워크 DEVICE에 IP를 설정하세요.

배경색 변경netplan --debug applynetplan --debug apply코드블록. netplan 적용 ip 명령어를 사용하여 정상적으로 IP가 설정되었는지 확인하세요.

배경색 변경[root@scp-test-vm-01 ~] # ip a 3: ens7: <BROADCAST,MULTICAST> mtu 9000 qdisc noop state DOWN group default qlen 1000 link/ether fa:16:3e:98:b6:64 brd ff:ff:ff:ff:ff:ff altname enp0s7 inet 10.10.10.10/24 metric 100 brd 10.10.10.255 scope global dynamic ens7 valid_lft 43197sec preferred_lft 43197sec inet6 fe80::f816:3eff:fe0a:96bf/64 scope link valid_lft forever preferred_lft forever[root@scp-test-vm-01 ~] # ip a 3: ens7: <BROADCAST,MULTICAST> mtu 9000 qdisc noop state DOWN group default qlen 1000 link/ether fa:16:3e:98:b6:64 brd ff:ff:ff:ff:ff:ff altname enp0s7 inet 10.10.10.10/24 metric 100 brd 10.10.10.255 scope global dynamic ens7 valid_lft 43197sec preferred_lft 43197sec inet6 fe80::f816:3eff:fe0a:96bf/64 scope link valid_lft forever preferred_lft forever코드블록. IP 설정 확인

1.2.5 - Linux NTP 설정하기

사용자는 Samsung Cloud Platform Console을 통해 Rocky Linux, Oracle Linux로 Virtual Server를 생성한 경우 시간 동기화(NTP:Network Time Protocol)를 위해 추가적인 설정이 필요합니다. 그 외 OS 표준 Linux Image(RHEL, Alma Linux, Ubuntu) 는 NTP 설정이 되어 있어 추가 설정 불필요합니다.

NTP Daemon 설치하기

chrony daemon을 설치하여 NTP를 설정할 수 있습니다. chrony daemon을 설치하려면 다음 절차를 따르세요.

Virtual Server의 OS의 root 사용자로 dnf 명령어를 사용하여 chrony 패키지가 설치되었는지 확인합니다.

배경색 변경dnf list chronydnf list chrony코드블록. dnf 명령어 - chrony 패키지 설치 확인 명령어 - chrony 패키지가 설치되어 있는 경우 다음과 같은 결과가 표시됩니다.

배경색 변경[root@scp-test-vm-01 ~] # dnf list chrony Last metadata expiration check: 1:47:29 ago on Wed 19 Feb 2025 05:55:57 PM KST. Installed Packages chrony.x86_64 3.5-1.0.1.el8 @anaconda[root@scp-test-vm-01 ~] # dnf list chrony Last metadata expiration check: 1:47:29 ago on Wed 19 Feb 2025 05:55:57 PM KST. Installed Packages chrony.x86_64 3.5-1.0.1.el8 @anaconda코드블록. dnf 명령어 - chrony 패키지 설치 확인 결과 chrony 패키지가 설치되지 않은 경우 dnf 명령어를 사용하여 chrony 패키지를 설치합니다.

배경색 변경dnf install chrony -ydnf install chrony -y코드블록. dnf 명령 - chrony 패키지 설치 확인 명령어

NTP Daemon 설정하기

chrony daemon을 설정하려면 다음 절차를 따르세요.

텍스트 편집기(예시: vim)를 사용하여 /etc/chrony.conf 파일을 불러오세요.

/etc/chrony.conf 파일에 아래 내용을 추가하고 저장하세요.

배경색 변경server 198.19.0.54 iburstserver 198.19.0.54 iburst코드블록. /etc/chrony.conf 편집 systemctl 명령어를 사용하여 chrony daemon을 자동으로 시작하도록 설정하세요.

배경색 변경systemctl enable chronydsystemctl enable chronyd코드블록. systemctl 명령어 - chrony daemon 자동 시작 설정 systemctl 명령어를 사용하여 chrony daemon을 재시작하세요.

배경색 변경systemctl restart chronydsystemctl restart chronyd코드블록. systemctl 명령어 - chrony daemon 재시작 chronyc sources명령어를 “v” 옵션(상세 정보 표시)과 함께 실행하여 설정한 NTP 서버의 IP 주소를 확인하고 동기화가 진행 중인지 확인하세요.

배경색 변경chronyc sources -vchronyc sources -v코드블록. chronyc sources 명령어 - NTP 동기화 확인 - chronyc sources 명령어를 실행할 경우, 다음과 같은 결과가 표시됩니다.

배경색 변경[root@scp-test-vm-01 ~] # chronyc sources -v 210 Number of sources = 1 .-- Source mode '^' = server, '=' = peer, '#' = local clock. / .- Source state '*' = current synced, '+' = combined , '-' = not combined, | / '?' = unreachable, 'x' = time may be in error, '~' = time too variable. || .- xxxx [ yyyy ] +/- zzzz || Reachability register (octal) -. | xxxx = adjusted offset, || Log2(Polling interval) --. | | yyyy = measured offset, || \ | | zzzz = estimated error. || | | \ MS Name/IP address Stratum Poll Reach LastRx Last sample ========================================================================= ^* 198.19.0.54 2 6 377 52 -129us[ -128us] +/- 14ms[root@scp-test-vm-01 ~] # chronyc sources -v 210 Number of sources = 1 .-- Source mode '^' = server, '=' = peer, '#' = local clock. / .- Source state '*' = current synced, '+' = combined , '-' = not combined, | / '?' = unreachable, 'x' = time may be in error, '~' = time too variable. || .- xxxx [ yyyy ] +/- zzzz || Reachability register (octal) -. | xxxx = adjusted offset, || Log2(Polling interval) --. | | yyyy = measured offset, || \ | | zzzz = estimated error. || | | \ MS Name/IP address Stratum Poll Reach LastRx Last sample ========================================================================= ^* 198.19.0.54 2 6 377 52 -129us[ -128us] +/- 14ms코드블록. chronyc sources 명령어 - NTP 동기화 확인 chronyc tracking 명령어를 실행하여 동기화 지표를 확인하세요.

배경색 변경[root@scp-test-vm-01 ~] # chronyc tracking Reference ID : A9FEA9FE (198.19.0.54) Stratum : 3 Ref time (UTC) : Wed Feb 19 18:48:41 2025 System time : 0.000000039 seconds fast of NTP time Last offset : -0.000084246 seconds RMS offset : 0.000084246 seconds Frequency : 21.667 ppm slow Residual freq : +4.723 ppm Skew : 0.410 ppm Root delay : 0.000564836 seconds Root dispersion : 0.027399288 seconds Update interval : 2.0 seconds Leap status : Normal[root@scp-test-vm-01 ~] # chronyc tracking Reference ID : A9FEA9FE (198.19.0.54) Stratum : 3 Ref time (UTC) : Wed Feb 19 18:48:41 2025 System time : 0.000000039 seconds fast of NTP time Last offset : -0.000084246 seconds RMS offset : 0.000084246 seconds Frequency : 21.667 ppm slow Residual freq : +4.723 ppm Skew : 0.410 ppm Root delay : 0.000564836 seconds Root dispersion : 0.027399288 seconds Update interval : 2.0 seconds Leap status : Normal코드블록. chronyc tracking 명령어 - NTP 동기화 지표

1.2.6 - RHEL Repo 및 WKMS 설정하기

- 사용자는 Samsung Cloud Platform Console을 통해 2025년 8월 이전 RHEL 및 Windows Server를 생성한 경우 RHEL Repository 및 WKMS(Windows Key Management Service) 설정 수정이 필요합니다.

- SCP RHEL Repository는 외부 접속이 제한되는 VPC Private Subnet 등 사용자 환경을 지원하기 위해 SCP에서 제공하는 리포지토리입니다.

SCP RHEL Repository는 내부 스케줄에 따라 각 Region Local Repository와 동기화되므로, 최신 패치를 빠르게 적용하려면 외부 Public Mirror 사이트로 변경하는 것을 권장합니다.

RHEL Repository 설정 가이드

Samsung Cloud Platform에서는 RHEL을 사용 시 SCP에서 제공하는 RHEL Repository를 활용하여 공식 RHEL Repository와 동일한 Package를 설치 및 Download 할 수 있습니다.

SCP에서는 기본적으로 해당 Major 버전의 가장 최신 버전 Repository를 제공합니다. RHEL Repository 설정을 하려면 다음 절차를 따르세요.

Virtual Server의 OS의 root 사용자로 cat 명령어를 사용하여

/etc/yum.repos.d/scp.rhel8.repo또는/etc/yum.repos.d/scp.rhel9.repo설정을 확인하세요.배경색 변경cat /etc/yum.repos.d/scp.rhel8.repocat /etc/yum.repos.d/scp.rhel8.repo코드블록. repo 설정 확인(RHEL8) 배경색 변경cat /etc/yum.repos.d/scp.rhel9.repocat /etc/yum.repos.d/scp.rhel9.repo코드블록. repo 설정 확인(RHEL9) - 설정 파일 확인 시 다음과 같은 결과가 표시됩니다.배경색 변경

[rhel-8-baseos] name=rhel-8-baseos gpgcheck=0 enabled=1 baseurl=http://scp-rhel8-ip/rhel/8/baseos [rhel-8-baseos-debug] name=rhel-8-baseos-debug gpgcheck=0 enabled=1 baseurl=http://scp-rhel8-ip/rhel/8/baseos-debug [rhel-8-appstream] name=rhel-8-appstream gpgcheck=0 enabled=1 baseurl=http://scp-rhel8-ip/rhel/8/appstream[rhel-8-baseos] name=rhel-8-baseos gpgcheck=0 enabled=1 baseurl=http://scp-rhel8-ip/rhel/8/baseos [rhel-8-baseos-debug] name=rhel-8-baseos-debug gpgcheck=0 enabled=1 baseurl=http://scp-rhel8-ip/rhel/8/baseos-debug [rhel-8-appstream] name=rhel-8-appstream gpgcheck=0 enabled=1 baseurl=http://scp-rhel8-ip/rhel/8/appstream코드블록. repo 설정 확인(RHEL8) 배경색 변경[rhel-9-for-x86_64-baseos-rpms] name=rhel-9-for-x86_64-baseos-rpms baseurl=http://scp-rhel9-ip/rhel/$releasever/x86_64/baseos gpgcheck=0 enabled=1 [rhel-9-for-x86_64-appstream-rpms] name=rhel-9-for-x86_64-appstream-rpms baseurl=http://scp-rhel9-ip/rhel/$releasever/x86_64/appstream gpgcheck=0 enabled=1 [codeready-builder-for-rhel-9-x86_64-rpms] name=codeready-builder-for-rhel-9-x86_64-rpms baseurl=http://scp-rhel9-ip/rhel/$releasever/x86_64/codeready-builder gpgcheck=0 enabled=1 [rhel-9-for-x86_64-highavailability-rpms] name=rhel-9-for-x86_64-highavailability-rpms baseurl=http://scp-rhel9-ip/rhel/$releasever/x86_64/ha gpgcheck=0 enabled=1 [rhel-9-for-x86_64-supplementary-rpms] name=rhel-9-for-x86_64-supplementary-rpms baseurl=http://scp-rhel9-ip/rhel/$releasever/x86_64/supplementary gpgcheck=0 enabled=1[rhel-9-for-x86_64-baseos-rpms] name=rhel-9-for-x86_64-baseos-rpms baseurl=http://scp-rhel9-ip/rhel/$releasever/x86_64/baseos gpgcheck=0 enabled=1 [rhel-9-for-x86_64-appstream-rpms] name=rhel-9-for-x86_64-appstream-rpms baseurl=http://scp-rhel9-ip/rhel/$releasever/x86_64/appstream gpgcheck=0 enabled=1 [codeready-builder-for-rhel-9-x86_64-rpms] name=codeready-builder-for-rhel-9-x86_64-rpms baseurl=http://scp-rhel9-ip/rhel/$releasever/x86_64/codeready-builder gpgcheck=0 enabled=1 [rhel-9-for-x86_64-highavailability-rpms] name=rhel-9-for-x86_64-highavailability-rpms baseurl=http://scp-rhel9-ip/rhel/$releasever/x86_64/ha gpgcheck=0 enabled=1 [rhel-9-for-x86_64-supplementary-rpms] name=rhel-9-for-x86_64-supplementary-rpms baseurl=http://scp-rhel9-ip/rhel/$releasever/x86_64/supplementary gpgcheck=0 enabled=1코드블록. repo 설정 확인(RHEL9)

- 설정 파일 확인 시 다음과 같은 결과가 표시됩니다.

텍스트 편집기(예시: vim)를 사용하여

/etc/hosts파일을 불러오세요./etc/hosts파일에 아래 내용으로 수정하고 저장하세요.배경색 변경198.19.2.13 scp-rhel8-ip scp-rhel9-ip scp-rhel-ip198.19.2.13 scp-rhel8-ip scp-rhel9-ip scp-rhel-ip코드블록. /etc/hosts 파일 설정 변경 yum 명령어를 사용하여 서버에 설정된 RHEL Repository 연결을 확인하세요.

배경색 변경yum repolist –vyum repolist –v코드블록. repository 연결 설정 확인 - RHEL Repository가 성공적으로 연결 되었을 경우 Repository list를 확인할 수 있습니다.배경색 변경

Repo-id : rhel-8-appstream Repo-name : rhel-8-appstream Repo-revision : 1718903734 Repo-updated : Fri 21 Jun 2024 02:15:34 AM KST Repo-pkgs : 38,260 Repo-available-pkgs: 25,799 Repo-size : 122 G Repo-baseurl : http://scp-rhel8-ip/rhel/8/appstream Repo-expire : 172,800 second(s) (last: Thu 08 Aug 2024 07:27:57 AM KST) Repo-filename : /etc/yum.repos.d/scp.rhel8.repo Repo-id : rhel-8-baseos Repo-name : rhel-8-baseos Repo-revision : 1718029433 Repo-updated : Mon 10 Jun 2024 11:23:52 PM KST Repo-pkgs : 17,487 Repo-available-pkgs: 17,487 Repo-size : 32 G Repo-baseurl : http://scp-rhel8-ip/rhel/8/baseos Repo-expire : 172,800 second(s) (last: Thu 08 Aug 2024 07:27:57 AM KST) Repo-filename : /etc/yum.repos.d/scp.rhel8.repo Repo-id : rhel-8-baseos-debug Repo-name : rhel-8-baseos-debug Repo-revision : 1717662461 Repo-updated : Thu 06 Jun 2024 05:27:41 PM KST Repo-pkgs : 17,078 Repo-available-pkgs: 17,078 Repo-size : 100 G Repo-baseurl : http://scp-rhel8-ip/rhel/8/baseos-debug Repo-expire : 172,800 second(s) (last: Thu 08 Aug 2024 07:27:57 AM KST) Repo-filename : /etc/yum.repos.d/scp.rhel8.repoRepo-id : rhel-8-appstream Repo-name : rhel-8-appstream Repo-revision : 1718903734 Repo-updated : Fri 21 Jun 2024 02:15:34 AM KST Repo-pkgs : 38,260 Repo-available-pkgs: 25,799 Repo-size : 122 G Repo-baseurl : http://scp-rhel8-ip/rhel/8/appstream Repo-expire : 172,800 second(s) (last: Thu 08 Aug 2024 07:27:57 AM KST) Repo-filename : /etc/yum.repos.d/scp.rhel8.repo Repo-id : rhel-8-baseos Repo-name : rhel-8-baseos Repo-revision : 1718029433 Repo-updated : Mon 10 Jun 2024 11:23:52 PM KST Repo-pkgs : 17,487 Repo-available-pkgs: 17,487 Repo-size : 32 G Repo-baseurl : http://scp-rhel8-ip/rhel/8/baseos Repo-expire : 172,800 second(s) (last: Thu 08 Aug 2024 07:27:57 AM KST) Repo-filename : /etc/yum.repos.d/scp.rhel8.repo Repo-id : rhel-8-baseos-debug Repo-name : rhel-8-baseos-debug Repo-revision : 1717662461 Repo-updated : Thu 06 Jun 2024 05:27:41 PM KST Repo-pkgs : 17,078 Repo-available-pkgs: 17,078 Repo-size : 100 G Repo-baseurl : http://scp-rhel8-ip/rhel/8/baseos-debug Repo-expire : 172,800 second(s) (last: Thu 08 Aug 2024 07:27:57 AM KST) Repo-filename : /etc/yum.repos.d/scp.rhel8.repo코드블록. Repository list 확인

- RHEL Repository가 성공적으로 연결 되었을 경우 Repository list를 확인할 수 있습니다.

Windows Key Management Service 설정 가이드

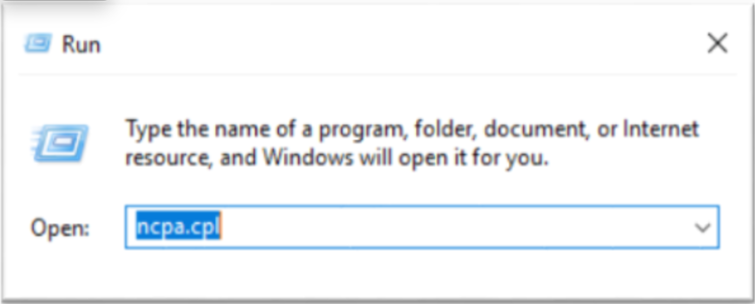

Samsung Cloud Platform에서는 Windows Server를 사용할 경우 SCP 에서 제공하는 Key Management Service를 활용하여 정품 인증할 수 있습니다. 다음 절차를 따르세요.

Windows 시작 아이콘을 우클릭한 후, Windows PowerShell(관리자) 혹은 Windows 실행 메뉴에서 cmd를 실행해주세요.

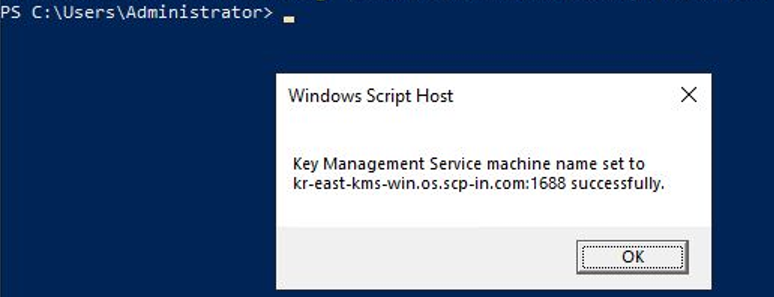

Windows PowerShell(관리자) 혹은 cmd에서 아래 명령어를 수행하여 KMS Server를 등록해주세요.

배경색 변경slmgr /skms 198.19.2.23:1688slmgr /skms 198.19.2.23:1688코드블록. WKMS 설정 KMS Server 등록 명령어를 수행한 후, 성공적으로 등록되었다는 알림 팝업을 확인한 후 OK를 클릭하세요.

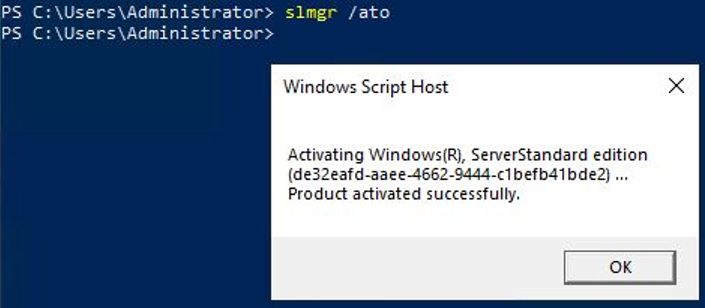

그림. WKMS 설정 확인 Windows PowerShell(관리자) 혹은 cmd에서 아래 명령어를 수행하여 정품 인증을 수행해주세요.

배경색 변경slmgr /atoslmgr /ato코드블록. Windows Server 정품인증 설정 정품 인증이 성공적으로 수행되었다는 알림 팝업을 확인한 후, OK를 클릭하세요.

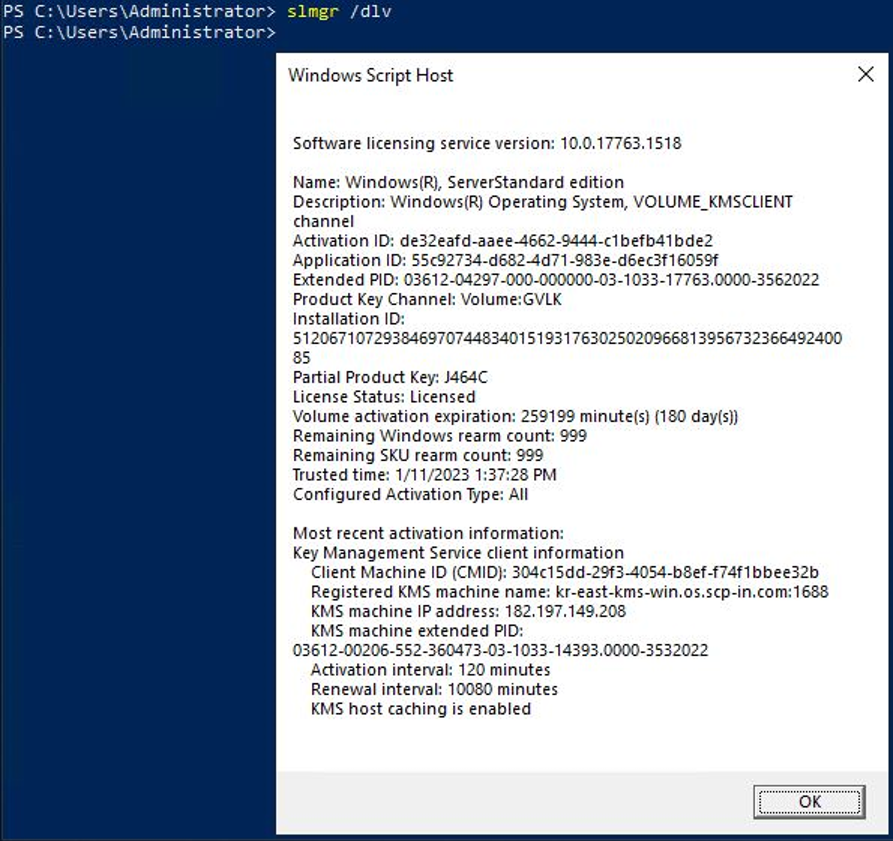

그림. Windows Server 정품 인증 수행 확인 Windows PowerShell(관리자) 혹은 cmd에서 아래 명령어를 수행하여 정품 인증이 되었는지 확인해주세요.

배경색 변경slmgr /dlvslmgr /dlv코드블록. Windows Server 정품 인증 확인 정품 인증이 성공적으로 수행되었다는 알림 팝업을 확인한 후, OK를 클릭하세요.

그림. Windows Server 정품 인증 확인

1.2.7 - ServiceWatch Agent 설치하기

사용자는 Virtual Server에 ServiceWatch Agent를 설치하여 사용자 정의 지표와 로그를 수집할 수 있습니다.

ServiceWatch Agent

Virtual Server에 ServiceWatch의 사용자 정의 지표 및 로그 수집을 위해 설치해야 하는 Agent는 크게 2가지로 나눌 수 있습니다. Prometheus Exporter와 Open Telemetry Collector 입니다.

| 구분 | 상세 설명 | |

|---|---|---|

| Prometheus Exporter | 특정 애플리케이션이나 서비스의 메트릭을 Prometheus가 스크랩(scrape)할 수 있는 형식으로 제공

| |

| Open Telemetry Collector | 분산 시스템의 메트릭, 로그와 같은 텔레메트리 데이터를 수집하고, 처리(필터링, 샘플링 등)한 후, 여러 백엔드(예: Prometheus, Jaeger, Elasticsearch 등)로 내보내는 중앙 집중식 수집기 역할

|

Virtual Server를 위한 Prometheus Exporter 설치 (for Linux)

Linux 서버에서 사용하기 위해 Prometheus Exporter를 아래의 순서에 따라 설치합니다.

Node Exporter 설치

아래의 순서에 따라 Node Exporter를 설치합니다.

Node Exporter User 생성

Node Exporter 프로세스를 안전하게 격리하기 위한 전용 사용자를 생성합니다.

sudo useradd --no-create-home --shell /bin/false node_exportersudo useradd --no-create-home --shell /bin/false node_exporterNode Exporter 설정

- Node Exporter 설치를 위해 다운로드합니다.

해당 가이드에서는 아래 버전으로 안내합니다.

- 다운로드 경로: /tmp

- 설치 버전: 1.7.0배경색 변경

cd /tmp wget https://github.com/prometheus/node_exporter/releases/download/v1.7.0/node_exporter-1.7.0.linux-amd64.tar.gzcd /tmp wget https://github.com/prometheus/node_exporter/releases/download/v1.7.0/node_exporter-1.7.0.linux-amd64.tar.gz코드블록. Node Exporter 다운로드 명령어

다운로드 받은 Node Exporter 설치하고 실행 파일에 권한을 부여합니다.

배경색 변경cd /tmp sudo tar -xvf node_exporter-1.7.0.linux-amd64.tar.gz -C /usr/local/bin --strip-components=1 node_exporter-1.7.0.linux-amd64/node_exportercd /tmp sudo tar -xvf node_exporter-1.7.0.linux-amd64.tar.gz -C /usr/local/bin --strip-components=1 node_exporter-1.7.0.linux-amd64/node_exporter코드블록. Node Exporter 설치 명령어 배경색 변경sudo chown node_exporter:node_exporter /usr/local/bin/node_exportersudo chown node_exporter:node_exporter /usr/local/bin/node_exporter코드블록. Node Exporter 권한 설정 명령어 서비스 파일 생성 Node Exporter를 메모리 메트릭(meminfo) 또는 블록 스토리지 메트릭(filesystem) 수집하도록 설정합니다.

배경색 변경sudo vi /etc/systemd/system/node_exporter.servicesudo vi /etc/systemd/system/node_exporter.service코드블록. Node Exporter 서비스 파일 열기 명령어 배경색 변경[Unit] Description=Prometheus Node Exporter (meminfo only) Wants=network-online.target After=network-online.target [Service] User=node_exporter Group=node_exporter Type=simple ExecStart=/usr/local/bin/node_exporter \ --collector.disable-defaults \ # 기본 제공 메트릭 비활성화 --collector.meminfo \ # 메모리 메트릭 활성화 --collector.filesystem # Block Storage 파일 시스템 메트릭 활성화 Restart=on-failure [Install] WantedBy=multi-user.target[Unit] Description=Prometheus Node Exporter (meminfo only) Wants=network-online.target After=network-online.target [Service] User=node_exporter Group=node_exporter Type=simple ExecStart=/usr/local/bin/node_exporter \ --collector.disable-defaults \ # 기본 제공 메트릭 비활성화 --collector.meminfo \ # 메모리 메트릭 활성화 --collector.filesystem # Block Storage 파일 시스템 메트릭 활성화 Restart=on-failure [Install] WantedBy=multi-user.target코드블록. Node Exporter 서비스 파일 열기 결과

collector는 플래그를 사용하여 활성화/비활성화 설정할 수 있습니다.

–collector.{name}: 특정 메트릭을 활성화할 때 사용합니다.–no-collector.{name}: 특정 메트릭을 비활성화할 수 있습니다.- 기본적으로 제공하는 메트릭을 모두 비활성화하고 특정 수집기만 활성화하려면

–collector.disable-defaults –collector.{name} …와 같이 사용할 수 있습니다.

아래는 주요 collector 설명입니다.

| Collector | 설명 | 라벨 |

|---|---|---|

| meminfo | 메모리 통계 제공 | - |

| filesystem | 사용된 디스크 공간과 같은 파일 시스템 통계 제공 |

|

- Node Exporter 지표에서 Node Exporter에서 제공하는 주요 지표와 Node Exporter Collector 설정 방법을 확인할 수 있습니다.

- 수집 가능한 메트릭과 설정 방법에 대한 자세한 내용은 Node Exporter > Collector에서 확인할 수 있습니다.

- 사용하는 Node Exporter의 버전에 따라 제공 가능한 메트릭이 상이할 수 있습니다. Node Exporter을 참고하세요.

- 서비스 활성화 및 시작

Node Exporter 서비스를 등록하고 등록된 서비스와 설정한 메트릭을 확인합니다.배경색 변경

sudo systemctl daemon-reload sudo systemctl enable --now node_exportersudo systemctl daemon-reload sudo systemctl enable --now node_exporter코드블록. Node Exporter 서비스 활성화 및 시작 명령어 배경색 변경sudo systemctl status node_exportersudo systemctl status node_exporter코드블록. Node Exporter 서비스 확인 명령어 배경색 변경curl http://localhost:9100/metrics | grep node_memorycurl http://localhost:9100/metrics | grep node_memory코드블록. Node Exporter 메트릭 정보 확인 명령어

자세한 내용은 ServiceWatch > ServiceWatch Agent 사용하기 참고하세요.

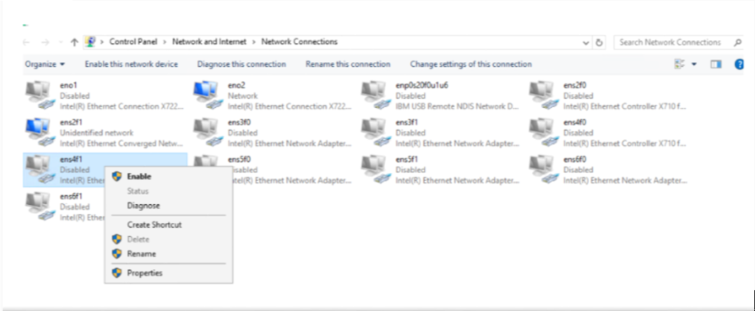

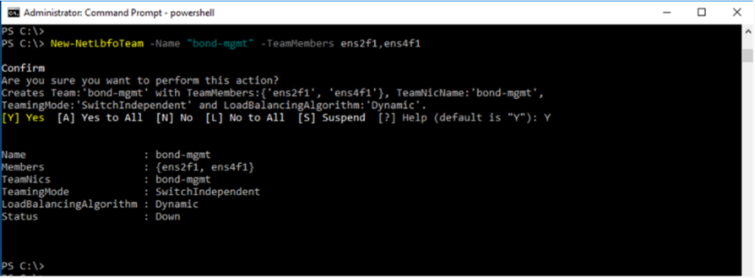

Virtual Server를 위한 Prometheus Exporter 설치 (for Windows)

Windows 서버에서 Prometheus Exporter를 사용하기 위해 아래의 순서에 따라 설치합니다.

Windows Exporter 설치