API별 지원되는 SDK

AIOS의 모델은 OpenAI 및 Cohere의 API와 호환되므로 OpenAI, Cohere의 SDK와도 호환됩니다. Samsung Cloud Platform AIOS 서비스에서 지원하는 OpenAI, Cohere 호환 API 목록은 다음과 같습니다.

| API명 | API | 상세 설명 | 지원 SDK |

|---|---|---|---|

| 텍스트 완성 API | 입력값으로 주어진 문자열에 이어지는 자연스러운 문장을 생성합니다. |

| |

| 대화 완성 API | 대화 내용에 뒤이은 답변을 생성합니다. |

| |

| Embeddings API | 텍스트를 고차원 벡터(임베딩)로 변환하여 텍스트 간 유사도 계산, 클러스터링, 검색 등 다양한 자연어 처리(NLP) 작업에 활용할 수 있습니다. |

| |

| Rerank API | 임베딩 모델이나 크로스 인코더 모델을 적용하여 단일 쿼리와 문서 목록의 각 항목 간 관련성을 예측합니다. |

|

- Request Examples 가이드는 Python/NodeJS/Go 런타임 환경이 구성된 Virtual Server 환경을 기준으로 설명합니다.

- 실제 실행 시 토큰 수, 메시지 내용이 예시와 다를 수 있습니다.

패키지 설치

사용 중인 실행 환경에 따라 AIOS 모델의 API 요청을 지원하는 SDK 패키지를 설치할 수 있습니다.

pip install requests openai cohere \

langchain langchain-openai langchain-cohere langchain-togetherpip install requests openai cohere \

langchain langchain-openai langchain-cohere langchain-togethernpm install openai cohere-ai langchain \

@langchain/core @langchain/openai @langchain/coherenpm install openai cohere-ai langchain \

@langchain/core @langchain/openai @langchain/coherego get github.com/openai/openai-go \

github.com/cohere-ai/cohere-go/v2go get github.com/openai/openai-go \

github.com/cohere-ai/cohere-go/v2텍스트 완성 API

텍스트 완성 API는 입력값으로 주어진 문자열에 바로 이어지는 자연스러운 문장을 생성합니다.

non-stream 요청

Request

import json

import requests

from urllib.parse import urljoin

aios_base_url = "<<aios endpoint-url>>" # AIOS 모델 호출을 위한 aios endpoint-url을 입력합니다.

model = "<<model>>" # AIOS 모델 호출을 위한 모델 ID를 입력합니다.

# 요청 데이터를 구성합니다.

# 여기에는 사용할 모델 ID와 프롬프트(prompt)가 포함됩니다.

data = {

"model": model,

"prompt": "Hi"

}

# AIOS API의 v1/completions 엔드포인트로 POST 요청을 보냅니다.

# urljoin 함수를 사용하여 기본 URL과 엔드포인트 경로를 결합합니다.

response = requests.post(urljoin(aios_base_url, "v1/completions"), json=data)

# 응답 본문을 JSON 형식으로 파싱합니다.

body = json.loads(response.text)

# 응답 본문의 choices[0].text는 AI 모델이 생성한 응답 텍스트입니다.

print(body["choices"][0]["text"])import json

import requests

from urllib.parse import urljoin

aios_base_url = "<<aios endpoint-url>>" # AIOS 모델 호출을 위한 aios endpoint-url을 입력합니다.

model = "<<model>>" # AIOS 모델 호출을 위한 모델 ID를 입력합니다.

# 요청 데이터를 구성합니다.

# 여기에는 사용할 모델 ID와 프롬프트(prompt)가 포함됩니다.

data = {

"model": model,

"prompt": "Hi"

}

# AIOS API의 v1/completions 엔드포인트로 POST 요청을 보냅니다.

# urljoin 함수를 사용하여 기본 URL과 엔드포인트 경로를 결합합니다.

response = requests.post(urljoin(aios_base_url, "v1/completions"), json=data)

# 응답 본문을 JSON 형식으로 파싱합니다.

body = json.loads(response.text)

# 응답 본문의 choices[0].text는 AI 모델이 생성한 응답 텍스트입니다.

print(body["choices"][0]["text"])from openai import OpenAI

from urllib.parse import urljoin

aios_base_url = "<<aios endpoint-url>>" # AIOS 모델 호출을 위한 aios endpoint-url을 입력합니다.

model = "<<model>>" # AIOS 모델 호출을 위한 모델 ID를 입력합니다.

# OpenAI 클라이언트를 생성합니다.

# base_url은 AIOS API의 v1 엔드포인트를 가리키며,

# api_key는 AIOS에서 요구하는 키로, 일반적으로 "EMPTY_KEY"로 설정됩니다.

client = OpenAI(base_url=urljoin(aios_base_url, "v1"), api_key="EMPTY_KEY")

# AIOS 모델을 사용하여 completion을 생성합니다.

# model 매개변수는 사용할 모델 ID를 지정하고,

# prompt 매개변수는 AI에게 제공할 입력 텍스트입니다.

response = client.completions.create(

model=model,

prompt="Hi"

)

# response.choices[0].text는 AI 모델이 생성한 응답 텍스트입니다.

print(response.choices[0].text)from openai import OpenAI

from urllib.parse import urljoin

aios_base_url = "<<aios endpoint-url>>" # AIOS 모델 호출을 위한 aios endpoint-url을 입력합니다.

model = "<<model>>" # AIOS 모델 호출을 위한 모델 ID를 입력합니다.

# OpenAI 클라이언트를 생성합니다.

# base_url은 AIOS API의 v1 엔드포인트를 가리키며,

# api_key는 AIOS에서 요구하는 키로, 일반적으로 "EMPTY_KEY"로 설정됩니다.

client = OpenAI(base_url=urljoin(aios_base_url, "v1"), api_key="EMPTY_KEY")

# AIOS 모델을 사용하여 completion을 생성합니다.

# model 매개변수는 사용할 모델 ID를 지정하고,

# prompt 매개변수는 AI에게 제공할 입력 텍스트입니다.

response = client.completions.create(

model=model,

prompt="Hi"

)

# response.choices[0].text는 AI 모델이 생성한 응답 텍스트입니다.

print(response.choices[0].text)from langchain_openai import OpenAI

from urllib.parse import urljoin

aios_base_url = "<<aios endpoint-url>>" # AIOS 모델 호출을 위한 aios endpoint-url을 입력합니다.

model = "<<model>>" # AIOS 모델 호출을 위한 모델 ID를 입력합니다.

# LangChain의 OpenAI 클래스를 사용하여 LLM(대형 언어 모델) 인스턴스를 생성합니다.

# base_url은 AIOS API의 v1 엔드포인트를 가리키며,

# api_key는 AIOS에서 요구하는 키로, 일반적으로 "EMPTY_KEY"로 설정됩니다.

# model 매개변수는 사용할 모델 ID를 지정합니다.

llm = OpenAI(

base_url=urljoin(aios_base_url, "v1"),

api_key="EMPTY_KEY",

model=model

)

# LLM에 "Hi"라는 프롬프트를 전달하여 응답을 받습니다.

# invoke 메서드는 모델의 출력을 반환합니다.

print(llm.invoke("Hi"))from langchain_openai import OpenAI

from urllib.parse import urljoin

aios_base_url = "<<aios endpoint-url>>" # AIOS 모델 호출을 위한 aios endpoint-url을 입력합니다.

model = "<<model>>" # AIOS 모델 호출을 위한 모델 ID를 입력합니다.

# LangChain의 OpenAI 클래스를 사용하여 LLM(대형 언어 모델) 인스턴스를 생성합니다.

# base_url은 AIOS API의 v1 엔드포인트를 가리키며,

# api_key는 AIOS에서 요구하는 키로, 일반적으로 "EMPTY_KEY"로 설정됩니다.

# model 매개변수는 사용할 모델 ID를 지정합니다.

llm = OpenAI(

base_url=urljoin(aios_base_url, "v1"),

api_key="EMPTY_KEY",

model=model

)

# LLM에 "Hi"라는 프롬프트를 전달하여 응답을 받습니다.

# invoke 메서드는 모델의 출력을 반환합니다.

print(llm.invoke("Hi"))const aios_base_url = "<<aios endpoint-url>>" // AIOS 모델 호출을 위한 aios endpoint-url을 입력합니다.

const model = "<<model>>" // AIOS 모델 호출을 위한 모델 ID를 입력합니다.

// 요청 데이터를 구성합니다.

// 여기에는 사용할 모델 ID와 프롬프트(prompt)가 포함됩니다.

const data = {

model: model,

prompt: "Hi",

};

// AIOS API의 v1/completions 엔드포인트 URL을 생성합니다.

let url = new URL("/v1/completions", aios_base_url);

// AIOS API에 POST 요청을 보냅니다.

const response = await fetch(url, {

method: "POST",

headers: {

"Content-Type": "application/json",

},

body: JSON.stringify(data),

});

// 응답 본문을 JSON 형식으로 파싱합니다.

const body = await response.json();

// 응답 본문의 choices[0].text는 AI 모델이 생성한 응답 텍스트입니다.

console.log(body.choices[0].text);const aios_base_url = "<<aios endpoint-url>>" // AIOS 모델 호출을 위한 aios endpoint-url을 입력합니다.

const model = "<<model>>" // AIOS 모델 호출을 위한 모델 ID를 입력합니다.

// 요청 데이터를 구성합니다.

// 여기에는 사용할 모델 ID와 프롬프트(prompt)가 포함됩니다.

const data = {

model: model,

prompt: "Hi",

};

// AIOS API의 v1/completions 엔드포인트 URL을 생성합니다.

let url = new URL("/v1/completions", aios_base_url);

// AIOS API에 POST 요청을 보냅니다.

const response = await fetch(url, {

method: "POST",

headers: {

"Content-Type": "application/json",

},

body: JSON.stringify(data),

});

// 응답 본문을 JSON 형식으로 파싱합니다.

const body = await response.json();

// 응답 본문의 choices[0].text는 AI 모델이 생성한 응답 텍스트입니다.

console.log(body.choices[0].text);import OpenAI from "openai";

const aios_base_url = "<<aios endpoint-url>>" // AIOS 모델 호출을 위한 aios endpoint-url을 입력합니다.

const model = "<<model>>" // AIOS 모델 호출을 위한 모델 ID를 입력합니다.

// OpenAI 클라이언트를 생성합니다.

// apiKey는 AIOS에서 요구하는 키로, 일반적으로 "EMPTY_KEY"로 설정됩니다.

// baseURL은 AIOS API의 v1 엔드포인트를 가리킵니다.

const client = new OpenAI({

apiKey: "EMPTY_KEY",

baseURL: new URL("v1", aios_base_url).href,

});

// AIOS 모델을 사용하여 completion을 생성합니다.

// model 매개변수는 사용할 모델 ID를 지정하고,

// prompt 매개변수는 AI에게 제공할 입력 텍스트입니다

const completions = await client.completions.create({

model: model,

prompt: "Hi",

});

// 응답 본문의 choices[0].text는 AI 모델이 생성한 응답 텍스트입니다.

console.log(completions.choices[0].text);import OpenAI from "openai";

const aios_base_url = "<<aios endpoint-url>>" // AIOS 모델 호출을 위한 aios endpoint-url을 입력합니다.

const model = "<<model>>" // AIOS 모델 호출을 위한 모델 ID를 입력합니다.

// OpenAI 클라이언트를 생성합니다.

// apiKey는 AIOS에서 요구하는 키로, 일반적으로 "EMPTY_KEY"로 설정됩니다.

// baseURL은 AIOS API의 v1 엔드포인트를 가리킵니다.

const client = new OpenAI({

apiKey: "EMPTY_KEY",

baseURL: new URL("v1", aios_base_url).href,

});

// AIOS 모델을 사용하여 completion을 생성합니다.

// model 매개변수는 사용할 모델 ID를 지정하고,

// prompt 매개변수는 AI에게 제공할 입력 텍스트입니다

const completions = await client.completions.create({

model: model,

prompt: "Hi",

});

// 응답 본문의 choices[0].text는 AI 모델이 생성한 응답 텍스트입니다.

console.log(completions.choices[0].text);import { OpenAI } from "@langchain/openai";

const aios_base_url = "<<aios endpoint-url>>" // AIOS 모델 호출을 위한 aios endpoint-url을 입력합니다.

const model = "<<model>>" // AIOS 모델 호출을 위한 모델 ID를 입력합니다.

// LangChain의 OpenAI 클래스를 사용하여 LLM(대형 언어 모델) 인스턴스를 생성합니다.

// model 매개변수는 사용할 모델 ID를 지정합니다.

// apiKey는 AIOS에서 요구하는 키로, 일반적으로 "EMPTY_KEY"로 설정됩니다.

// configuration.baseURL은 AIOS API의 v1 엔드포인트를 가리킵니다.

const llm = new OpenAI({

model: model,

apiKey: "EMPTY_KEY",

configuration: {

baseURL: new URL("v1", aios_base_url).href,

},

});

// LLM에 "Hi"라는 프롬프트를 전달하여 응답을 받습니다.

// invoke 메서드는 모델의 출력을 반환합니다.

const completion = await llm.invoke("Hi");

// 생성된 응답을 출력합니다.

// 이 텍스트는 AI 모델이 생성한 응답입니다.

console.log(completion);import { OpenAI } from "@langchain/openai";

const aios_base_url = "<<aios endpoint-url>>" // AIOS 모델 호출을 위한 aios endpoint-url을 입력합니다.

const model = "<<model>>" // AIOS 모델 호출을 위한 모델 ID를 입력합니다.

// LangChain의 OpenAI 클래스를 사용하여 LLM(대형 언어 모델) 인스턴스를 생성합니다.

// model 매개변수는 사용할 모델 ID를 지정합니다.

// apiKey는 AIOS에서 요구하는 키로, 일반적으로 "EMPTY_KEY"로 설정됩니다.

// configuration.baseURL은 AIOS API의 v1 엔드포인트를 가리킵니다.

const llm = new OpenAI({

model: model,

apiKey: "EMPTY_KEY",

configuration: {

baseURL: new URL("v1", aios_base_url).href,

},

});

// LLM에 "Hi"라는 프롬프트를 전달하여 응답을 받습니다.

// invoke 메서드는 모델의 출력을 반환합니다.

const completion = await llm.invoke("Hi");

// 생성된 응답을 출력합니다.

// 이 텍스트는 AI 모델이 생성한 응답입니다.

console.log(completion);package main

import (

"bytes"

"encoding/json"

"fmt"

"io"

"net/http"

)

const (

aiosBaseUrl = "<<aios endpoint-url>>" // AIOS 모델 호출을 위한 aios endpoint-url을 입력합니다.

model = "<<model>>" // AIOS 모델 호출을 위한 모델 ID를 입력합니다.

)

// POST 요청에 사용될 데이터 구조를 정의합니다.

// Model: 사용할 모델 ID

// Prompt: AI에게 제공할 입력 텍스트

// Stream: 스트리밍 응답 여부 (옵션)

type PostData struct {

Model string `json:"model"`

Prompt string `json:"prompt"`

Stream bool `json:"stream,omitempty"`

}

func main() {

// 요청 데이터를 생성합니다.

data := PostData{

Model: model,

Prompt: "Hi",

}

// 데이터를 JSON 형식으로 마샬링합니다.

jsonData, err := json.Marshal(data)

if err != nil {

panic(err)

}

// AIOS API의 v1/completions 엔드포인트로 POST 요청을 보냅니다.

response, err := http.Post(aiosBaseUrl + "/v1/completions", "application/json", bytes.NewBuffer(jsonData))

if err != nil {

panic(err)

}

defer response.Body.Close()

// 응답 본문을 모두 읽습니다.

body, err := io.ReadAll(response.Body)

if err != nil {

panic(err)

}

var v map[string]interface{}

json.Unmarshal(body, &v)

// 응답에서 choices 배열을 추출합니다.

choices := v["choices"].([]interface{})

// 첫 번째 데이터의 text를 추출합니다.

choice := choices[0].(map[string]interface{})

text := choice["text"]

// AI 모델이 생성한 응답 텍스트를 출력합니다.

fmt.Println(text)

}package main

import (

"bytes"

"encoding/json"

"fmt"

"io"

"net/http"

)

const (

aiosBaseUrl = "<<aios endpoint-url>>" // AIOS 모델 호출을 위한 aios endpoint-url을 입력합니다.

model = "<<model>>" // AIOS 모델 호출을 위한 모델 ID를 입력합니다.

)

// POST 요청에 사용될 데이터 구조를 정의합니다.

// Model: 사용할 모델 ID

// Prompt: AI에게 제공할 입력 텍스트

// Stream: 스트리밍 응답 여부 (옵션)

type PostData struct {

Model string `json:"model"`

Prompt string `json:"prompt"`

Stream bool `json:"stream,omitempty"`

}

func main() {

// 요청 데이터를 생성합니다.

data := PostData{

Model: model,

Prompt: "Hi",

}

// 데이터를 JSON 형식으로 마샬링합니다.

jsonData, err := json.Marshal(data)

if err != nil {

panic(err)

}

// AIOS API의 v1/completions 엔드포인트로 POST 요청을 보냅니다.

response, err := http.Post(aiosBaseUrl + "/v1/completions", "application/json", bytes.NewBuffer(jsonData))

if err != nil {

panic(err)

}

defer response.Body.Close()

// 응답 본문을 모두 읽습니다.

body, err := io.ReadAll(response.Body)

if err != nil {

panic(err)

}

var v map[string]interface{}

json.Unmarshal(body, &v)

// 응답에서 choices 배열을 추출합니다.

choices := v["choices"].([]interface{})

// 첫 번째 데이터의 text를 추출합니다.

choice := choices[0].(map[string]interface{})

text := choice["text"]

// AI 모델이 생성한 응답 텍스트를 출력합니다.

fmt.Println(text)

}package main

import (

"context"

"fmt"

"github.com/openai/openai-go"

"github.com/openai/openai-go/option"

"github.com/openai/openai-go/packages/param"

)

const (

aiosBaseUrl = "<<aios endpoint-url>>" // AIOS 모델 호출을 위한 aios endpoint-url을 입력합니다.

model = "<<model>>" // AIOS 모델 호출을 위한 모델 ID를 입력합니다.

)

func main() {

// OpenAI 클라이언트를 생성합니다.

// option.WithBaseURL을 사용하여 AIOS API의 v1 엔드포인트를 설정합니다.

client := openai.NewClient(

option.WithBaseURL(aiosBaseUrl+"/v1"),

)

// AIOS 모델을 사용하여 completion을 생성합니다.

// openai.CompletionNewParams를 사용하여 모델과 프롬프트를 설정합니다.

completion, err := client.Completions.New(context.TODO(), openai.CompletionNewParams{

Model: openai.CompletionNewParamsModel(model),

Prompt: openai.CompletionNewParamsPromptUnion{OfString: param.Opt[string]{Value: "Hi"}},

})

if err != nil {

panic(err)

}

// 응답 본문의 choices[0].text는 AI 모델이 생성한 응답 텍스트입니다.

fmt.Println(completion.Choices[0].Text)

}package main

import (

"context"

"fmt"

"github.com/openai/openai-go"

"github.com/openai/openai-go/option"

"github.com/openai/openai-go/packages/param"

)

const (

aiosBaseUrl = "<<aios endpoint-url>>" // AIOS 모델 호출을 위한 aios endpoint-url을 입력합니다.

model = "<<model>>" // AIOS 모델 호출을 위한 모델 ID를 입력합니다.

)

func main() {

// OpenAI 클라이언트를 생성합니다.

// option.WithBaseURL을 사용하여 AIOS API의 v1 엔드포인트를 설정합니다.

client := openai.NewClient(

option.WithBaseURL(aiosBaseUrl+"/v1"),

)

// AIOS 모델을 사용하여 completion을 생성합니다.

// openai.CompletionNewParams를 사용하여 모델과 프롬프트를 설정합니다.

completion, err := client.Completions.New(context.TODO(), openai.CompletionNewParams{

Model: openai.CompletionNewParamsModel(model),

Prompt: openai.CompletionNewParamsPromptUnion{OfString: param.Opt[string]{Value: "Hi"}},

})

if err != nil {

panic(err)

}

// 응답 본문의 choices[0].text는 AI 모델이 생성한 응답 텍스트입니다.

fmt.Println(completion.Choices[0].Text)

}Response

choices의 text 필드에 모델의 답변이 포함되어 있는 것을 확인할 수 있습니다.

future president of the United States, I hope you’re doing well. As a

stream 요청

stream 기능을 이용하면 모델이 답변을 전부 완성할 때까지 기다리지 않고, 모델이 토큰을 생성할 때마다 토큰 단위로 답변을 받을 수 있습니다.

Request

stream 파라미터값을 True로 입력합니다.

import json

import requests

from urllib.parse import urljoin

aios_base_url = "<<aios endpoint-url>>" # AIOS 모델 호출을 위한 aios endpoint-url을 입력합니다.

model = "<<model>>" # AIOS 모델 호출을 위한 모델 ID를 입력합니다.

# 요청 데이터를 구성합니다.

# 여기에는 사용할 모델 ID, 프롬프트(prompt), 그리고 스트리밍 여부(stream)가 포함됩니다.

data = {

"model": model,

"prompt": "Hi",

"stream": True

}

# AIOS API의 v1/completions 엔드포인트로 POST 요청을 보냅니다.

# stream=True를 설정하여 실시간 스트리밍 응답을 받습니다.

response = requests.post(urljoin(aios_base_url, "v1/completions"), json=data, stream=True)

# 모델이 토큰을 생성할 때마다 응답으로 받을 수 있습니다.

# 응답은 각 줄(line)로 분리되어 전송되므로 iter_lines()로 처리합니다.

for line in response.iter_lines():

if line:

try:

# 'data: ' 접두사를 제거하고 JSON 데이터를 파싱합니다.

body = json.loads(line[len("data: "):])

# 응답 본문의 choices[0].text는 AI 모델이 생성한 응답 텍스트입니다.

print(body["choices"][0]["text"])

except:

passimport json

import requests

from urllib.parse import urljoin

aios_base_url = "<<aios endpoint-url>>" # AIOS 모델 호출을 위한 aios endpoint-url을 입력합니다.

model = "<<model>>" # AIOS 모델 호출을 위한 모델 ID를 입력합니다.

# 요청 데이터를 구성합니다.

# 여기에는 사용할 모델 ID, 프롬프트(prompt), 그리고 스트리밍 여부(stream)가 포함됩니다.

data = {

"model": model,

"prompt": "Hi",

"stream": True

}

# AIOS API의 v1/completions 엔드포인트로 POST 요청을 보냅니다.

# stream=True를 설정하여 실시간 스트리밍 응답을 받습니다.

response = requests.post(urljoin(aios_base_url, "v1/completions"), json=data, stream=True)

# 모델이 토큰을 생성할 때마다 응답으로 받을 수 있습니다.

# 응답은 각 줄(line)로 분리되어 전송되므로 iter_lines()로 처리합니다.

for line in response.iter_lines():

if line:

try:

# 'data: ' 접두사를 제거하고 JSON 데이터를 파싱합니다.

body = json.loads(line[len("data: "):])

# 응답 본문의 choices[0].text는 AI 모델이 생성한 응답 텍스트입니다.

print(body["choices"][0]["text"])

except:

passfrom openai import OpenAI

from urllib.parse import urljoin

aios_base_url = "<<aios endpoint-url>>" # AIOS 모델 호출을 위한 aios endpoint-url을 입력합니다.

model = "<<model>>" # AIOS 모델 호출을 위한 모델 ID를 입력합니다.

# OpenAI 클라이언트를 생성합니다.

# base_url은 AIOS API의 v1 엔드포인트를 가리키며,

# api_key는 AIOS에서 요구하는 키로, 일반적으로 "EMPTY_KEY"로 설정됩니다.

client = OpenAI(base_url=urljoin(aios_base_url, "v1"), api_key="EMPTY_KEY")

# AIOS 모델을 사용하여 completion을 생성합니다.

# model 매개변수는 사용할 모델 ID를 지정하고,

# prompt 매개변수는 AI에게 제공할 입력 텍스트입니다.

# stream=True를 설정하여 실시간 스트리밍 응답을 받습니다.

response = client.completions.create(

model=model,

prompt="Hi",

stream=True

)

# 모델이 토큰을 생성할 때마다 응답으로 받을 수 있습니다.

# response는 스트림 형태로 전송되므로 반복하여 처리할 수 있습니다.

for chunk in response:

# 각 청크에서 choices[0].text는 AI 모델이 생성한 응답 텍스트입니다.

print(chunk.choices[0].text)from openai import OpenAI

from urllib.parse import urljoin

aios_base_url = "<<aios endpoint-url>>" # AIOS 모델 호출을 위한 aios endpoint-url을 입력합니다.

model = "<<model>>" # AIOS 모델 호출을 위한 모델 ID를 입력합니다.

# OpenAI 클라이언트를 생성합니다.

# base_url은 AIOS API의 v1 엔드포인트를 가리키며,

# api_key는 AIOS에서 요구하는 키로, 일반적으로 "EMPTY_KEY"로 설정됩니다.

client = OpenAI(base_url=urljoin(aios_base_url, "v1"), api_key="EMPTY_KEY")

# AIOS 모델을 사용하여 completion을 생성합니다.

# model 매개변수는 사용할 모델 ID를 지정하고,

# prompt 매개변수는 AI에게 제공할 입력 텍스트입니다.

# stream=True를 설정하여 실시간 스트리밍 응답을 받습니다.

response = client.completions.create(

model=model,

prompt="Hi",

stream=True

)

# 모델이 토큰을 생성할 때마다 응답으로 받을 수 있습니다.

# response는 스트림 형태로 전송되므로 반복하여 처리할 수 있습니다.

for chunk in response:

# 각 청크에서 choices[0].text는 AI 모델이 생성한 응답 텍스트입니다.

print(chunk.choices[0].text)from langchain_openai import OpenAI

from urllib.parse import urljoin

aios_base_url = "<<aios endpoint-url>>" # AIOS 모델 호출을 위한 aios endpoint-url을 입력합니다.

model = "<<model>>" # AIOS 모델 호출을 위한 모델 ID를 입력합니다.

# LangChain의 OpenAI 클래스를 사용하여 LLM(대형 언어 모델) 인스턴스를 생성합니다.

# base_url은 AIOS API의 v1 엔드포인트를 가리키며,

# api_key는 AIOS에서 요구하는 키로, 일반적으로 "EMPTY_KEY"로 설정됩니다.

# model 매개변수는 사용할 모델 ID를 지정합니다.

llm = OpenAI(

base_url=urljoin(aios_base_url, "v1"),

api_key="EMPTY_KEY",

model=model

)

# LLM에 "Hi"라는 프롬프트를 전달하여 스트리밍 응답을 받습니다.

# stream 메서드는 실시간으로 토큰을 생성하는 스트림을 반환합니다.

response = llm.stream("Hi")

# 모델이 토큰을 생성할 때마다 응답으로 받을 수 있습니다.

# response는 스트림 형태로 전송되므로 반복하여 처리할 수 있습니다.

for chunk in response:

# 각 청크를 출력합니다.

# 이 청크는 AI 모델이 생성한 응답 토큰입니다.

print(chunk)from langchain_openai import OpenAI

from urllib.parse import urljoin

aios_base_url = "<<aios endpoint-url>>" # AIOS 모델 호출을 위한 aios endpoint-url을 입력합니다.

model = "<<model>>" # AIOS 모델 호출을 위한 모델 ID를 입력합니다.

# LangChain의 OpenAI 클래스를 사용하여 LLM(대형 언어 모델) 인스턴스를 생성합니다.

# base_url은 AIOS API의 v1 엔드포인트를 가리키며,

# api_key는 AIOS에서 요구하는 키로, 일반적으로 "EMPTY_KEY"로 설정됩니다.

# model 매개변수는 사용할 모델 ID를 지정합니다.

llm = OpenAI(

base_url=urljoin(aios_base_url, "v1"),

api_key="EMPTY_KEY",

model=model

)

# LLM에 "Hi"라는 프롬프트를 전달하여 스트리밍 응답을 받습니다.

# stream 메서드는 실시간으로 토큰을 생성하는 스트림을 반환합니다.

response = llm.stream("Hi")

# 모델이 토큰을 생성할 때마다 응답으로 받을 수 있습니다.

# response는 스트림 형태로 전송되므로 반복하여 처리할 수 있습니다.

for chunk in response:

# 각 청크를 출력합니다.

# 이 청크는 AI 모델이 생성한 응답 토큰입니다.

print(chunk)const aios_base_url = "<<aios endpoint-url>>" // AIOS 모델 호출을 위한 aios endpoint-url을 입력합니다.

const model = "<<model>>" // AIOS 모델 호출을 위한 모델 ID를 입력합니다.

// 요청 데이터를 구성합니다.

// 여기에는 사용할 모델 ID, 프롬프트(prompt), 그리고 스트리밍 여부(stream)가 포함됩니다.

const data = {

model: model,

prompt: "Hi",

stream: true,

};

// AIOS API의 v1/completions 엔드포인트 URL을 생성합니다.

let url = new URL("/v1/completions", aios_base_url);

// AIOS API에 POST 요청을 보냅니다.

// stream: true를 설정하여 실시간 스트리밍 응답을 받습니다.

const response = await fetch(url, {

method: "POST",

headers: {

"Content-Type": "application/json",

},

body: JSON.stringify(data),

});

// 모델이 토큰을 생성할 때마다 응답으로 받을 수 있습니다.

// 응답 본문을 텍스트 디코더 스트림으로 변환하여 읽습니다.

const reader = response.body.pipeThrough(new TextDecoderStream()).getReader();

let buf = "";

while (true) {

const { value, done } = await reader.read();

if (done) break;

// 받은 데이터를 버퍼에 추가합니다.

buf += value;

let sep;

// 버퍼에서 줄바꿈 문자(\n\n)를 찾아서 데이터를 분리합니다.

while ((sep = buf.indexOf("\n\n")) >= 0) {

const data = buf.slice(0, sep);

buf = buf.slice(sep + 2);

// 각 줄을 처리합니다.

for (const rawLine of data.split("\n")) {

const line = rawLine.trim();

if (!line.startsWith("data: ")) continue;

// "data: " 접두사를 제거하고 JSON 데이터를 추출합니다.

const payload = line.slice("data: ".length).trim();

if (payload === "[DONE]") break;

// JSON 데이터를 파싱합니다.

const json = JSON.parse(payload);

// choices[0].text는 AI 모델이 생성한 응답 텍스트입니다.

console.log(json.choices[0].text);

}

}

}const aios_base_url = "<<aios endpoint-url>>" // AIOS 모델 호출을 위한 aios endpoint-url을 입력합니다.

const model = "<<model>>" // AIOS 모델 호출을 위한 모델 ID를 입력합니다.

// 요청 데이터를 구성합니다.

// 여기에는 사용할 모델 ID, 프롬프트(prompt), 그리고 스트리밍 여부(stream)가 포함됩니다.

const data = {

model: model,

prompt: "Hi",

stream: true,

};

// AIOS API의 v1/completions 엔드포인트 URL을 생성합니다.

let url = new URL("/v1/completions", aios_base_url);

// AIOS API에 POST 요청을 보냅니다.

// stream: true를 설정하여 실시간 스트리밍 응답을 받습니다.

const response = await fetch(url, {

method: "POST",

headers: {

"Content-Type": "application/json",

},

body: JSON.stringify(data),

});

// 모델이 토큰을 생성할 때마다 응답으로 받을 수 있습니다.

// 응답 본문을 텍스트 디코더 스트림으로 변환하여 읽습니다.

const reader = response.body.pipeThrough(new TextDecoderStream()).getReader();

let buf = "";

while (true) {

const { value, done } = await reader.read();

if (done) break;

// 받은 데이터를 버퍼에 추가합니다.

buf += value;

let sep;

// 버퍼에서 줄바꿈 문자(\n\n)를 찾아서 데이터를 분리합니다.

while ((sep = buf.indexOf("\n\n")) >= 0) {

const data = buf.slice(0, sep);

buf = buf.slice(sep + 2);

// 각 줄을 처리합니다.

for (const rawLine of data.split("\n")) {

const line = rawLine.trim();

if (!line.startsWith("data: ")) continue;

// "data: " 접두사를 제거하고 JSON 데이터를 추출합니다.

const payload = line.slice("data: ".length).trim();

if (payload === "[DONE]") break;

// JSON 데이터를 파싱합니다.

const json = JSON.parse(payload);

// choices[0].text는 AI 모델이 생성한 응답 텍스트입니다.

console.log(json.choices[0].text);

}

}

}import OpenAI from "openai";

const aios_base_url = "<<aios endpoint-url>>" // AIOS 모델 호출을 위한 aios endpoint-url을 입력합니다.

const model = "<<model>>" // AIOS 모델 호출을 위한 모델 ID를 입력합니다.

// OpenAI 클라이언트를 생성합니다.

// apiKey는 AIOS에서 요구하는 키로, 일반적으로 "EMPTY_KEY"로 설정됩니다.

// baseURL은 AIOS API의 v1 엔드포인트를 가리킵니다.

const client = new OpenAI({

apiKey: "EMPTY_KEY",

baseURL: new URL("v1", aios_base_url).href,

});

// AIOS 모델을 사용하여 completion을 생성합니다.

// model 매개변수는 사용할 모델 ID를 지정하고,

// prompt 매개변수는 AI에게 제공할 입력 텍스트입니다.

// stream: true를 설정하여 실시간 스트리밍 응답을 받습니다.

const completions = await client.completions.create({

model: model,

prompt: "Hi",

stream: true,

});

// 모델이 토큰을 생성할 때마다 응답으로 받을 수 있습니다.

// for await...of 루프를 사용하여 스트림 이벤트를 순차적으로 처리합니다.

for await (const event of completions) {

// 각 이벤트의 choices[0].text는 AI 모델이 생성한 응답 텍스트입니다.

console.log(event.choices[0].text);

}import OpenAI from "openai";

const aios_base_url = "<<aios endpoint-url>>" // AIOS 모델 호출을 위한 aios endpoint-url을 입력합니다.

const model = "<<model>>" // AIOS 모델 호출을 위한 모델 ID를 입력합니다.

// OpenAI 클라이언트를 생성합니다.

// apiKey는 AIOS에서 요구하는 키로, 일반적으로 "EMPTY_KEY"로 설정됩니다.

// baseURL은 AIOS API의 v1 엔드포인트를 가리킵니다.

const client = new OpenAI({

apiKey: "EMPTY_KEY",

baseURL: new URL("v1", aios_base_url).href,

});

// AIOS 모델을 사용하여 completion을 생성합니다.

// model 매개변수는 사용할 모델 ID를 지정하고,

// prompt 매개변수는 AI에게 제공할 입력 텍스트입니다.

// stream: true를 설정하여 실시간 스트리밍 응답을 받습니다.

const completions = await client.completions.create({

model: model,

prompt: "Hi",

stream: true,

});

// 모델이 토큰을 생성할 때마다 응답으로 받을 수 있습니다.

// for await...of 루프를 사용하여 스트림 이벤트를 순차적으로 처리합니다.

for await (const event of completions) {

// 각 이벤트의 choices[0].text는 AI 모델이 생성한 응답 텍스트입니다.

console.log(event.choices[0].text);

}import { OpenAI } from "@langchain/openai";

const aios_base_url = "<<aios endpoint-url>>" // AIOS 모델 호출을 위한 aios endpoint-url을 입력합니다.

const model = "<<model>>" // AIOS 모델 호출을 위한 모델 ID를 입력합니다.

// LangChain의 OpenAI 클래스를 사용하여 LLM(대형 언어 모델) 인스턴스를 생성합니다.

// model 매개변수는 사용할 모델 ID를 지정합니다.

// apiKey는 AIOS에서 요구하는 키로, 일반적으로 "EMPTY_KEY"로 설정됩니다.

// configuration.baseURL은 AIOS API의 v1 엔드포인트를 가리킵니다.

const llm = new OpenAI({

model: model,

apiKey: "EMPTY_KEY",

configuration: {

baseURL: new URL("v1", aios_base_url).href,

},

});

// LLM에 "Hi"라는 프롬프트를 전달하여 스트리밍 응답을 받습니다.

// stream 메서드는 실시간으로 토큰을 생성하는 스트림을 반환합니다.

const completion = await llm.stream("Hi");

// 모델이 토큰을 생성할 때마다 응답으로 받을 수 있습니다.

// for await...of 루프를 사용하여 스트림 청크를 순차적으로 처리합니다.

for await (const chunk of completion) {

// 각 청크를 출력합니다.

// 이 청크는 AI 모델이 생성한 응답 토큰입니다.

console.log(chunk);

}import { OpenAI } from "@langchain/openai";

const aios_base_url = "<<aios endpoint-url>>" // AIOS 모델 호출을 위한 aios endpoint-url을 입력합니다.

const model = "<<model>>" // AIOS 모델 호출을 위한 모델 ID를 입력합니다.

// LangChain의 OpenAI 클래스를 사용하여 LLM(대형 언어 모델) 인스턴스를 생성합니다.

// model 매개변수는 사용할 모델 ID를 지정합니다.

// apiKey는 AIOS에서 요구하는 키로, 일반적으로 "EMPTY_KEY"로 설정됩니다.

// configuration.baseURL은 AIOS API의 v1 엔드포인트를 가리킵니다.

const llm = new OpenAI({

model: model,

apiKey: "EMPTY_KEY",

configuration: {

baseURL: new URL("v1", aios_base_url).href,

},

});

// LLM에 "Hi"라는 프롬프트를 전달하여 스트리밍 응답을 받습니다.

// stream 메서드는 실시간으로 토큰을 생성하는 스트림을 반환합니다.

const completion = await llm.stream("Hi");

// 모델이 토큰을 생성할 때마다 응답으로 받을 수 있습니다.

// for await...of 루프를 사용하여 스트림 청크를 순차적으로 처리합니다.

for await (const chunk of completion) {

// 각 청크를 출력합니다.

// 이 청크는 AI 모델이 생성한 응답 토큰입니다.

console.log(chunk);

}package main

import (

"bufio"

"bytes"

"encoding/json"

"fmt"

"net/http"

)

const (

aiosBaseUrl = "<<aios endpoint-url>>" // AIOS 모델 호출을 위한 aios endpoint-url을 입력합니다.

model = "<<model>>" // AIOS 모델 호출을 위한 모델 ID를 입력합니다.

)

// POST 요청에 사용될 데이터 구조를 정의합니다.

// Model: 사용할 모델 ID

// Prompt: AI에게 제공할 입력 텍스트

// Stream: 스트리밍 응답 여부 (옵션)

type PostData struct {

Model string `json:"model"`

Prompt string `json:"prompt"`

Stream bool `json:"stream,omitempty"`

}

func main() {

// 요청 데이터를 생성합니다.

// Stream: true를 설정하여 실시간 스트리밍 응답을 받습니다.

data := PostData{

Model: model,

Prompt: "Hi",

Stream: true,

}

// 데이터를 JSON 형식으로 마샬링합니다.

jsonData, err := json.Marshal(data)

if err != nil {

panic(err)

}

// AIOS API의 v1/completions 엔드포인트로 POST 요청을 보냅니다.

response, err := http.Post(aiosBaseUrl+"/v1/completions", "application/json", bytes.NewBuffer(jsonData))

if err != nil {

panic(err)

}

defer response.Body.Close()

// 모델이 토큰을 생성할 때마다 응답으로 받을 수 있습니다.

// HTTP 응답 본문을 스캔하여 줄 단위로 처리합니다.

var v map[string]interface{}

scanner := bufio.NewScanner(response.Body)

for scanner.Scan() {

line := bytes.TrimSpace(scanner.Bytes())

// 줄이 "data: "로 시작하지 않으면 건너뜁니다.

if !bytes.HasPrefix(line, []byte("data: ")) {

continue

}

// "data: " 접두사를 제거합니다.

payload := bytes.TrimPrefix(line, []byte("data: "))

// payload가 "[DONE]"이라면 스트리밍을 종료합니다.

if bytes.Equal(payload, []byte("[DONE]")) {

break

}

// JSON 데이터를 파싱합니다.

json.Unmarshal(payload, &v)

// 응답에서 choices 배열을 추출합니다.

choices := v["choices"].([]interface{})

// 첫 번째 데이터를 추출합니다.

choice := choices[0].(map[string]interface{})

// AI 모델이 생성한 응답 토큰을 추출합니다.

text := choice["text"]

fmt.Println(text)

}

}package main

import (

"bufio"

"bytes"

"encoding/json"

"fmt"

"net/http"

)

const (

aiosBaseUrl = "<<aios endpoint-url>>" // AIOS 모델 호출을 위한 aios endpoint-url을 입력합니다.

model = "<<model>>" // AIOS 모델 호출을 위한 모델 ID를 입력합니다.

)

// POST 요청에 사용될 데이터 구조를 정의합니다.

// Model: 사용할 모델 ID

// Prompt: AI에게 제공할 입력 텍스트

// Stream: 스트리밍 응답 여부 (옵션)

type PostData struct {

Model string `json:"model"`

Prompt string `json:"prompt"`

Stream bool `json:"stream,omitempty"`

}

func main() {

// 요청 데이터를 생성합니다.

// Stream: true를 설정하여 실시간 스트리밍 응답을 받습니다.

data := PostData{

Model: model,

Prompt: "Hi",

Stream: true,

}

// 데이터를 JSON 형식으로 마샬링합니다.

jsonData, err := json.Marshal(data)

if err != nil {

panic(err)

}

// AIOS API의 v1/completions 엔드포인트로 POST 요청을 보냅니다.

response, err := http.Post(aiosBaseUrl+"/v1/completions", "application/json", bytes.NewBuffer(jsonData))

if err != nil {

panic(err)

}

defer response.Body.Close()

// 모델이 토큰을 생성할 때마다 응답으로 받을 수 있습니다.

// HTTP 응답 본문을 스캔하여 줄 단위로 처리합니다.

var v map[string]interface{}

scanner := bufio.NewScanner(response.Body)

for scanner.Scan() {

line := bytes.TrimSpace(scanner.Bytes())

// 줄이 "data: "로 시작하지 않으면 건너뜁니다.

if !bytes.HasPrefix(line, []byte("data: ")) {

continue

}

// "data: " 접두사를 제거합니다.

payload := bytes.TrimPrefix(line, []byte("data: "))

// payload가 "[DONE]"이라면 스트리밍을 종료합니다.

if bytes.Equal(payload, []byte("[DONE]")) {

break

}

// JSON 데이터를 파싱합니다.

json.Unmarshal(payload, &v)

// 응답에서 choices 배열을 추출합니다.

choices := v["choices"].([]interface{})

// 첫 번째 데이터를 추출합니다.

choice := choices[0].(map[string]interface{})

// AI 모델이 생성한 응답 토큰을 추출합니다.

text := choice["text"]

fmt.Println(text)

}

}package main

import (

"context"

"fmt"

"github.com/openai/openai-go"

"github.com/openai/openai-go/option"

"github.com/openai/openai-go/packages/param"

)

const (

aiosBaseUrl = "<<aios endpoint-url>>" // AIOS 모델 호출을 위한 aios endpoint-url을 입력합니다.

model = "<<model>>" // AIOS 모델 호출을 위한 모델 ID를 입력합니다.

)

func main() {

// OpenAI 클라이언트를 생성합니다.

// option.WithBaseURL을 사용하여 AIOS API의 v1 엔드포인트를 설정합니다.

client := openai.NewClient(

option.WithBaseURL(aiosBaseUrl + "/v1"),

)

// AIOS 모델을 사용하여 스트리밍 completion을 생성합니다.

// openai.CompletionNewParams를 사용하여 모델과 프롬프트를 설정합니다.

completion := client.Completions.NewStreaming(context.TODO(), openai.CompletionNewParams{

Model: openai.CompletionNewParamsModel(model),

Prompt: openai.CompletionNewParamsPromptUnion{OfString: param.Opt[string]{Value: "Hi"}},

})

// 모델이 토큰을 생성할 때마다 응답으로 받을 수 있습니다.

// Next() 메서드는 다음 청크가 있을 때 true를 반환합니다.

for completion.Next() {

// 현재 청크의 choices 슬라이스를 가져옵니다.

chunk := completion.Current().Choices

// choices[0].text는 AI 모델이 생성한 응답 텍스트입니다.

fmt.Println(chunk[0].Text)

}

}package main

import (

"context"

"fmt"

"github.com/openai/openai-go"

"github.com/openai/openai-go/option"

"github.com/openai/openai-go/packages/param"

)

const (

aiosBaseUrl = "<<aios endpoint-url>>" // AIOS 모델 호출을 위한 aios endpoint-url을 입력합니다.

model = "<<model>>" // AIOS 모델 호출을 위한 모델 ID를 입력합니다.

)

func main() {

// OpenAI 클라이언트를 생성합니다.

// option.WithBaseURL을 사용하여 AIOS API의 v1 엔드포인트를 설정합니다.

client := openai.NewClient(

option.WithBaseURL(aiosBaseUrl + "/v1"),

)

// AIOS 모델을 사용하여 스트리밍 completion을 생성합니다.

// openai.CompletionNewParams를 사용하여 모델과 프롬프트를 설정합니다.

completion := client.Completions.NewStreaming(context.TODO(), openai.CompletionNewParams{

Model: openai.CompletionNewParamsModel(model),

Prompt: openai.CompletionNewParamsPromptUnion{OfString: param.Opt[string]{Value: "Hi"}},

})

// 모델이 토큰을 생성할 때마다 응답으로 받을 수 있습니다.

// Next() 메서드는 다음 청크가 있을 때 true를 반환합니다.

for completion.Next() {

// 현재 청크의 choices 슬라이스를 가져옵니다.

chunk := completion.Current().Choices

// choices[0].text는 AI 모델이 생성한 응답 텍스트입니다.

fmt.Println(chunk[0].Text)

}

}Response

토큰마다 답변이 생성되고, 각 토큰은 choices의 text 필드에서 확인할 수 있습니다.

I

'm

looking

for

a

way

to

check

if

a

specific

process

is

running

on

대화 완성 API

대화 완성 API는 순서대로 나열된 메시지 목록(맥락)을 입력받으면 모델이 다음 순서로 적합한 메시지를 생성하여 응답합니다.

non-stream 요청

Request

텍스트 메시지로만 이루어진 경우, 다음과 같이 호출할 수 있습니다.

import json

import requests

from urllib.parse import urljoin

aios_base_url = "<<aios endpoint-url>>" # AIOS 모델 호출을 위한 aios endpoint-url을 입력합니다.

model = "<<model>>" # AIOS 모델 호출을 위한 모델 ID를 입력합니다.

# 요청 데이터를 구성합니다.

# 여기에는 사용할 모델 ID와 메시지 목록(messages)가 포함됩니다.

# 메시지 목록은 시스템 메시지와 사용자 메시지를 포함합니다.

data = {

"model": model,

"messages": [

{"role": "system", "content": "You are a helpful assistant."},

{"role": "user", "content": "Hi"}

]

}

# AIOS API의 v1/chat/completions 엔드포인트로 POST 요청을 보냅니다.

response = requests.post(urljoin(aios_base_url, "v1/chat/completions"), json=data)

# 응답 본문을 JSON 형식으로 파싱합니다.

body = json.loads(response.text)

# choices[0].message는 AI 모델이 생성한 응답입니다.

print(body["choices"][0]["message"])import json

import requests

from urllib.parse import urljoin

aios_base_url = "<<aios endpoint-url>>" # AIOS 모델 호출을 위한 aios endpoint-url을 입력합니다.

model = "<<model>>" # AIOS 모델 호출을 위한 모델 ID를 입력합니다.

# 요청 데이터를 구성합니다.

# 여기에는 사용할 모델 ID와 메시지 목록(messages)가 포함됩니다.

# 메시지 목록은 시스템 메시지와 사용자 메시지를 포함합니다.

data = {

"model": model,

"messages": [

{"role": "system", "content": "You are a helpful assistant."},

{"role": "user", "content": "Hi"}

]

}

# AIOS API의 v1/chat/completions 엔드포인트로 POST 요청을 보냅니다.

response = requests.post(urljoin(aios_base_url, "v1/chat/completions"), json=data)

# 응답 본문을 JSON 형식으로 파싱합니다.

body = json.loads(response.text)

# choices[0].message는 AI 모델이 생성한 응답입니다.

print(body["choices"][0]["message"])from openai import OpenAI

from urllib.parse import urljoin

aios_base_url = "<<aios endpoint-url>>" # AIOS 모델 호출을 위한 aios endpoint-url을 입력합니다.

model = "<<model>>" # AIOS 모델 호출을 위한 모델 ID를 입력합니다.

# OpenAI 클라이언트를 생성합니다.

# base_url은 AIOS API의 v1 엔드포인트를 가리키며,

# api_key는 AIOS에서 요구하는 키로, 일반적으로 "EMPTY_KEY"로 설정됩니다.

client = OpenAI(base_url=urljoin(aios_base_url, "v1"), api_key="EMPTY_KEY")

# AIOS 모델을 사용하여 채팅 completion을 생성합니다.

# model 매개변수는 사용할 모델 ID를 지정합니다.

# messages 매개변수는 시스템 메시지와 사용자 메시지를 포함하는 메시지 목록입니다.

response = client.chat.completions.create(

model=model,

messages=[

{"role": "system", "content": "You are a helpful assistant."},

{"role": "user", "content": "Hi"}

]

)

# 생성된 응답에서 choices[0].message를 출력합니다.

print(response.choices[0].message.model_dump())from openai import OpenAI

from urllib.parse import urljoin

aios_base_url = "<<aios endpoint-url>>" # AIOS 모델 호출을 위한 aios endpoint-url을 입력합니다.

model = "<<model>>" # AIOS 모델 호출을 위한 모델 ID를 입력합니다.

# OpenAI 클라이언트를 생성합니다.

# base_url은 AIOS API의 v1 엔드포인트를 가리키며,

# api_key는 AIOS에서 요구하는 키로, 일반적으로 "EMPTY_KEY"로 설정됩니다.

client = OpenAI(base_url=urljoin(aios_base_url, "v1"), api_key="EMPTY_KEY")

# AIOS 모델을 사용하여 채팅 completion을 생성합니다.

# model 매개변수는 사용할 모델 ID를 지정합니다.

# messages 매개변수는 시스템 메시지와 사용자 메시지를 포함하는 메시지 목록입니다.

response = client.chat.completions.create(

model=model,

messages=[

{"role": "system", "content": "You are a helpful assistant."},

{"role": "user", "content": "Hi"}

]

)

# 생성된 응답에서 choices[0].message를 출력합니다.

print(response.choices[0].message.model_dump())from langchain_openai import ChatOpenAI

from urllib.parse import urljoin

aios_base_url = "<<aios endpoint-url>>" # AIOS 모델 호출을 위한 aios endpoint-url을 입력합니다.

model = "<<model>>" # AIOS 모델 호출을 위한 모델 ID를 입력합니다.

# LangChain의 ChatOpenAI 클래스를 사용하여 채팅 LLM(대형 언어 모델) 인스턴스를 생성합니다.

# base_url은 AIOS API의 v1 엔드포인트를 가리키며,

# api_key는 AIOS에서 요구하는 키로, 일반적으로 "EMPTY_KEY"로 설정됩니다.

# model 매개변수는 사용할 모델 ID를 지정합니다.

chat_llm = ChatOpenAI(

base_url=urljoin(aios_base_url, "v1"),

api_key="EMPTY_KEY",

model=model

)

# 채팅 메시지 목록을 구성합니다.

# 시스템 메시지와 사용자 메시지를 포함합니다.

messages = [

("system", "You are a helpful assistant."),

("human", "Hi"),

]

# 채팅 LLM에 메시지 목록을 전달하여 응답을 받습니다.

# invoke 메서드는 모델의 출력을 반환합니다.

chat_completion = chat_llm.invoke(messages)

# 생성된 응답을 출력합니다.

print(chat_completion.model_dump())from langchain_openai import ChatOpenAI

from urllib.parse import urljoin

aios_base_url = "<<aios endpoint-url>>" # AIOS 모델 호출을 위한 aios endpoint-url을 입력합니다.

model = "<<model>>" # AIOS 모델 호출을 위한 모델 ID를 입력합니다.

# LangChain의 ChatOpenAI 클래스를 사용하여 채팅 LLM(대형 언어 모델) 인스턴스를 생성합니다.

# base_url은 AIOS API의 v1 엔드포인트를 가리키며,

# api_key는 AIOS에서 요구하는 키로, 일반적으로 "EMPTY_KEY"로 설정됩니다.

# model 매개변수는 사용할 모델 ID를 지정합니다.

chat_llm = ChatOpenAI(

base_url=urljoin(aios_base_url, "v1"),

api_key="EMPTY_KEY",

model=model

)

# 채팅 메시지 목록을 구성합니다.

# 시스템 메시지와 사용자 메시지를 포함합니다.

messages = [

("system", "You are a helpful assistant."),

("human", "Hi"),

]

# 채팅 LLM에 메시지 목록을 전달하여 응답을 받습니다.

# invoke 메서드는 모델의 출력을 반환합니다.

chat_completion = chat_llm.invoke(messages)

# 생성된 응답을 출력합니다.

print(chat_completion.model_dump())const aios_base_url = "<<aios endpoint-url>>"; // AIOS 모델 호출을 위한 aios endpoint-url을 입력합니다.

const model = "<<model>>"; // AIOS 모델 호출을 위한 모델 ID를 입력합니다.

// 요청 데이터를 구성합니다.

// 여기에는 사용할 모델 ID와 메시지 목록(messages)가 포함됩니다.

// 메시지 목록은 시스템 메시지와 사용자 메시지를 포함합니다.

const data = {

model: model,

messages: [

{ role: "system", content: "You are a helpful assistant." },

{ role: "user", content: "Hi" },

],

};

// AIOS API의 v1/chat/completions 엔드포인트 URL을 생성합니다.

let url = new URL("/v1/chat/completions", aios_base_url);

// AIOS API에 POST 요청을 보냅니다.

const response = await fetch(url, {

method: "POST",

headers: {

"Content-Type": "application/json",

},

body: JSON.stringify(data),

});

// 응답 본문을 JSON 형식으로 파싱합니다.

const body = await response.json();

// 생성된 응답에서 choices[0].message를 출력합니다.

console.log(body.choices[0].message);const aios_base_url = "<<aios endpoint-url>>"; // AIOS 모델 호출을 위한 aios endpoint-url을 입력합니다.

const model = "<<model>>"; // AIOS 모델 호출을 위한 모델 ID를 입력합니다.

// 요청 데이터를 구성합니다.

// 여기에는 사용할 모델 ID와 메시지 목록(messages)가 포함됩니다.

// 메시지 목록은 시스템 메시지와 사용자 메시지를 포함합니다.

const data = {

model: model,

messages: [

{ role: "system", content: "You are a helpful assistant." },

{ role: "user", content: "Hi" },

],

};

// AIOS API의 v1/chat/completions 엔드포인트 URL을 생성합니다.

let url = new URL("/v1/chat/completions", aios_base_url);

// AIOS API에 POST 요청을 보냅니다.

const response = await fetch(url, {

method: "POST",

headers: {

"Content-Type": "application/json",

},

body: JSON.stringify(data),

});

// 응답 본문을 JSON 형식으로 파싱합니다.

const body = await response.json();

// 생성된 응답에서 choices[0].message를 출력합니다.

console.log(body.choices[0].message);import OpenAI from "openai";

const aios_base_url = "<<aios endpoint-url>>"; // AIOS 모델 호출을 위한 aios endpoint-url을 입력합니다.

const model = "<<model>>"; // AIOS 모델 호출을 위한 모델 ID를 입력합니다.

// OpenAI 클라이언트를 생성합니다.

// apiKey는 AIOS에서 요구하는 키로, 일반적으로 "EMPTY_KEY"로 설정됩니다.

// baseURL은 AIOS API의 v1 엔드포인트를 가리킵니다.

const client = new OpenAI({

apiKey: "EMPTY_KEY",

baseURL: new URL("v1", aios_base_url).href,

});

// AIOS 모델을 사용하여 채팅 completion을 생성합니다.

// model 매개변수는 사용할 모델 ID를 지정합니다.

// messages 매개변수는 시스템 메시지와 사용자 메시지를 포함하는 메시지 목록입니다.

const response = await client.chat.completions.create({

model: model,

messages: [

{ role: "system", content: "You are a helpful assistant." },

{ role: "user", content: "Hi" },

],

});

// 생성된 응답에서 choices[0].message를 출력합니다.

console.log(response.choices[0].message);import OpenAI from "openai";

const aios_base_url = "<<aios endpoint-url>>"; // AIOS 모델 호출을 위한 aios endpoint-url을 입력합니다.

const model = "<<model>>"; // AIOS 모델 호출을 위한 모델 ID를 입력합니다.

// OpenAI 클라이언트를 생성합니다.

// apiKey는 AIOS에서 요구하는 키로, 일반적으로 "EMPTY_KEY"로 설정됩니다.

// baseURL은 AIOS API의 v1 엔드포인트를 가리킵니다.

const client = new OpenAI({

apiKey: "EMPTY_KEY",

baseURL: new URL("v1", aios_base_url).href,

});

// AIOS 모델을 사용하여 채팅 completion을 생성합니다.

// model 매개변수는 사용할 모델 ID를 지정합니다.

// messages 매개변수는 시스템 메시지와 사용자 메시지를 포함하는 메시지 목록입니다.

const response = await client.chat.completions.create({

model: model,

messages: [

{ role: "system", content: "You are a helpful assistant." },

{ role: "user", content: "Hi" },

],

});

// 생성된 응답에서 choices[0].message를 출력합니다.

console.log(response.choices[0].message);import { HumanMessage, SystemMessage } from "@langchain/core/messages";

import { ChatOpenAI } from "@langchain/openai";

const aios_base_url = "<<aios endpoint-url>>"; // AIOS 모델 호출을 위한 aios endpoint-url을 입력합니다.

const model = "<<model>>"; // AIOS 모델 호출을 위한 모델 ID를 입력합니다.

// LangChain의 ChatOpenAI 클래스를 사용하여 채팅 LLM(대형 언어 모델) 인스턴스를 생성합니다.

// model 매개변수는 사용할 모델 ID를 지정합니다.

// apiKey는 AIOS에서 요구하는 키로, 일반적으로 "EMPTY_KEY"로 설정됩니다.

// configuration.baseURL은 AIOS API의 v1 엔드포인트를 가리킵니다.

const llm = new ChatOpenAI({

model: model,

apiKey: "EMPTY_KEY",

configuration: {

baseURL: new URL("v1", aios_base_url).href,

},

});

// 채팅 메시지 목록을 구성합니다.

// SystemMessage와 HumanMessage 객체를 사용하여 시스템 메시지와 사용자 메시지를 포함합니다.

const messages = [

new SystemMessage("You are a helpful assistant."),

new HumanMessage("Hi"),

];

// 채팅 LLM에 메시지 목록을 전달하여 응답을 받습니다.

// invoke 메서드는 모델의 출력을 반환합니다.

const response = await llm.invoke(messages);

// 생성된 응답의 내용(content)을 출력합니다.

// 이 내용은 AI 모델이 생성한 응답 텍스트입니다.

console.log(response.content);import { HumanMessage, SystemMessage } from "@langchain/core/messages";

import { ChatOpenAI } from "@langchain/openai";

const aios_base_url = "<<aios endpoint-url>>"; // AIOS 모델 호출을 위한 aios endpoint-url을 입력합니다.

const model = "<<model>>"; // AIOS 모델 호출을 위한 모델 ID를 입력합니다.

// LangChain의 ChatOpenAI 클래스를 사용하여 채팅 LLM(대형 언어 모델) 인스턴스를 생성합니다.

// model 매개변수는 사용할 모델 ID를 지정합니다.

// apiKey는 AIOS에서 요구하는 키로, 일반적으로 "EMPTY_KEY"로 설정됩니다.

// configuration.baseURL은 AIOS API의 v1 엔드포인트를 가리킵니다.

const llm = new ChatOpenAI({

model: model,

apiKey: "EMPTY_KEY",

configuration: {

baseURL: new URL("v1", aios_base_url).href,

},

});

// 채팅 메시지 목록을 구성합니다.

// SystemMessage와 HumanMessage 객체를 사용하여 시스템 메시지와 사용자 메시지를 포함합니다.

const messages = [

new SystemMessage("You are a helpful assistant."),

new HumanMessage("Hi"),

];

// 채팅 LLM에 메시지 목록을 전달하여 응답을 받습니다.

// invoke 메서드는 모델의 출력을 반환합니다.

const response = await llm.invoke(messages);

// 생성된 응답의 내용(content)을 출력합니다.

// 이 내용은 AI 모델이 생성한 응답 텍스트입니다.

console.log(response.content);package main

import (

"bytes"

"encoding/json"

"fmt"

"io"

"net/http"

)

const (

aiosBaseUrl = "<<aios endpoint-url>>" // AIOS 모델 호출을 위한 aios endpoint-url을 입력합니다.

model = "<<model>>" // AIOS 모델 호출을 위한 모델 ID를 입력합니다.

)

// 메시지 구조를 정의합니다.

// Role: 메시지 역할 (예: system, user)

// Content: 메시지 내용

type Message struct {

Role string `json:"role"`

Content string `json:"content"`

}

// POST 요청에 사용될 데이터 구조를 정의합니다.

// Model: 사용할 모델 ID

// Messages: 메시지 목록

// Stream: 스트리밍 응답 여부 (옵션)

type PostData struct {

Model string `json:"model"`

Messages []Message `json:"messages"`

Stream bool `json:"stream,omitempty"`

}

func main() {

// 요청 데이터를 생성합니다.

// 메시지 목록에는 시스템 메시지와 사용자 메시지가 포함됩니다.

data := PostData{

Model: model,

Messages: []Message{

{

Role: "system",

Content: "You are a helpful assistant.",

},

{

Role: "user",

Content: "Hi",

},

},

}

// 데이터를 JSON 형식으로 마샬링합니다.

jsonData, err := json.Marshal(data)

if err != nil {

panic(err)

}

// AIOS API의 v1/chat/completions 엔드포인트로 POST 요청을 보냅니다.

response, err := http.Post(aiosBaseUrl+"/v1/chat/completions", "application/json", bytes.NewBuffer(jsonData))

if err != nil {

panic(err)

}

defer response.Body.Close()

// 응답 본문을 모두 읽습니다.

body, err := io.ReadAll(response.Body)

if err != nil {

panic(err)

}

// 응답 본문을 맵 형식으로 언마샬링합니다.

var v map[string]interface{}

json.Unmarshal(body, &v)

// 응답에서 choices 배열을 추출합니다.

choices := v["choices"].([]interface{})

// 첫 번째 데이터를 추출합니다.

choice := choices[0].(map[string]interface{})

// AI 모델이 생성한 응답 메시지를 JSON 형식으로 포맷하여 출력합니다.

message, err := json.MarshalIndent(choice["message"], "", " ")

if err != nil {

panic(err)

}

fmt.Println(string(message))

}package main

import (

"bytes"

"encoding/json"

"fmt"

"io"

"net/http"

)

const (

aiosBaseUrl = "<<aios endpoint-url>>" // AIOS 모델 호출을 위한 aios endpoint-url을 입력합니다.

model = "<<model>>" // AIOS 모델 호출을 위한 모델 ID를 입력합니다.

)

// 메시지 구조를 정의합니다.

// Role: 메시지 역할 (예: system, user)

// Content: 메시지 내용

type Message struct {

Role string `json:"role"`

Content string `json:"content"`

}

// POST 요청에 사용될 데이터 구조를 정의합니다.

// Model: 사용할 모델 ID

// Messages: 메시지 목록

// Stream: 스트리밍 응답 여부 (옵션)

type PostData struct {

Model string `json:"model"`

Messages []Message `json:"messages"`

Stream bool `json:"stream,omitempty"`

}

func main() {

// 요청 데이터를 생성합니다.

// 메시지 목록에는 시스템 메시지와 사용자 메시지가 포함됩니다.

data := PostData{

Model: model,

Messages: []Message{

{

Role: "system",

Content: "You are a helpful assistant.",

},

{

Role: "user",

Content: "Hi",

},

},

}

// 데이터를 JSON 형식으로 마샬링합니다.

jsonData, err := json.Marshal(data)

if err != nil {

panic(err)

}

// AIOS API의 v1/chat/completions 엔드포인트로 POST 요청을 보냅니다.

response, err := http.Post(aiosBaseUrl+"/v1/chat/completions", "application/json", bytes.NewBuffer(jsonData))

if err != nil {

panic(err)

}

defer response.Body.Close()

// 응답 본문을 모두 읽습니다.

body, err := io.ReadAll(response.Body)

if err != nil {

panic(err)

}

// 응답 본문을 맵 형식으로 언마샬링합니다.

var v map[string]interface{}

json.Unmarshal(body, &v)

// 응답에서 choices 배열을 추출합니다.

choices := v["choices"].([]interface{})

// 첫 번째 데이터를 추출합니다.

choice := choices[0].(map[string]interface{})

// AI 모델이 생성한 응답 메시지를 JSON 형식으로 포맷하여 출력합니다.

message, err := json.MarshalIndent(choice["message"], "", " ")

if err != nil {

panic(err)

}

fmt.Println(string(message))

}package main

import (

"context"

"fmt"

"github.com/openai/openai-go"

"github.com/openai/openai-go/option"

)

const (

aiosBaseUrl = "<<aios endpoint-url>>" // AIOS 모델 호출을 위한 aios endpoint-url을 입력합니다.

model = "<<model>>" // AIOS 모델 호출을 위한 모델 ID를 입력합니다.

)

func main() {

// OpenAI 클라이언트를 생성합니다.

// option.WithBaseURL을 사용하여 AIOS API의 v1 엔드포인트를 설정합니다.

client := openai.NewClient(

option.WithBaseURL(aiosBaseUrl + "/v1"),

)

// AIOS 모델을 사용하여 채팅 completion을 생성합니다.

// openai.ChatCompletionNewParams를 사용하여 모델과 메시지 목록을 설정합니다.

// 메시지 목록에는 시스템 메시지와 사용자 메시지가 포함됩니다.

response, err := client.Chat.Completions.New(context.TODO(), openai.ChatCompletionNewParams{

Model: model,

Messages: []openai.ChatCompletionMessageParamUnion{

openai.SystemMessage("You are a helpful assistant."),

openai.UserMessage("Hi"),

},

})

if err != nil {

panic(err)

}

// AI 모델이 생성한 응답 메시지를 JSON 형식으로 포맷하여 출력합니다.

fmt.Println(response.Choices[0].Message.RawJSON())

}package main

import (

"context"

"fmt"

"github.com/openai/openai-go"

"github.com/openai/openai-go/option"

)

const (

aiosBaseUrl = "<<aios endpoint-url>>" // AIOS 모델 호출을 위한 aios endpoint-url을 입력합니다.

model = "<<model>>" // AIOS 모델 호출을 위한 모델 ID를 입력합니다.

)

func main() {

// OpenAI 클라이언트를 생성합니다.

// option.WithBaseURL을 사용하여 AIOS API의 v1 엔드포인트를 설정합니다.

client := openai.NewClient(

option.WithBaseURL(aiosBaseUrl + "/v1"),

)

// AIOS 모델을 사용하여 채팅 completion을 생성합니다.

// openai.ChatCompletionNewParams를 사용하여 모델과 메시지 목록을 설정합니다.

// 메시지 목록에는 시스템 메시지와 사용자 메시지가 포함됩니다.

response, err := client.Chat.Completions.New(context.TODO(), openai.ChatCompletionNewParams{

Model: model,

Messages: []openai.ChatCompletionMessageParamUnion{

openai.SystemMessage("You are a helpful assistant."),

openai.UserMessage("Hi"),

},

})

if err != nil {

panic(err)

}

// AI 모델이 생성한 응답 메시지를 JSON 형식으로 포맷하여 출력합니다.

fmt.Println(response.Choices[0].Message.RawJSON())

}Response

choices의 message에서 모델의 답변 내용을 확인할 수 있습니다.

{

'annotations': None,

'audio': None,

'content': 'Hello! How can I help you today?',

'function_call': None,

'reasoning_content': 'The user says "Hi". We respond politely.',

'refusal': None,

'role': 'assistant',

'tool_calls': []

}

stream 요청

stream을 이용하여 모델이 모든 답변을 생성할 때까지 기다렸다가 한번에 응답을 받지 않고, 모델이 생성하는 토큰마다 응답을 받아 처리할 수 있습니다.

Request

stream 파라미터값을 True로 입력합니다.

import json

import requests

from urllib.parse import urljoin

aios_base_url = "<<aios endpoint-url>>" # AIOS 모델 호출을 위한 aios endpoint-url을 입력합니다.

model = "<<model>>" # AIOS 모델 호출을 위한 모델 ID를 입력합니다.

# 요청 데이터를 구성합니다.

# 여기에는 사용할 모델 ID, 메시지 목록(messages), 그리고 스트리밍 여부(stream)가 포함됩니다.

# 메시지 목록은 시스템 메시지와 사용자 메시지를 포함합니다.

data = {

"model": model,

"messages": [

{"role": "system", "content": "You are a helpful assistant."},

{"role": "user", "content": "Hi"}

],

"stream": True

}

# AIOS API의 v1/chat/completions 엔드포인트로 POST 요청을 보냅니다.

# stream=True를 설정하여 실시간 스트리밍 응답을 받습니다.

response = requests.post(urljoin(aios_base_url, "v1/chat/completions"), json=data, stream=True)

# 모델이 토큰을 생성할 때마다 응답으로 받을 수 있습니다.

# 응답은 각 줄(line)로 분리되어 전송되므로 iter_lines()로 처리합니다.

for line in response.iter_lines():

if line:

try:

# 'data: ' 접두사를 제거하고 JSON 데이터를 파싱합니다.

body = json.loads(line[len("data: "):])

# 델타(choices[0].delta)를 출력합니다.

# 델타는 AI 모델이 생성한 응답 토큰입니다.

print(body["choices"][0]["delta"])

except:

passimport json

import requests

from urllib.parse import urljoin

aios_base_url = "<<aios endpoint-url>>" # AIOS 모델 호출을 위한 aios endpoint-url을 입력합니다.

model = "<<model>>" # AIOS 모델 호출을 위한 모델 ID를 입력합니다.

# 요청 데이터를 구성합니다.

# 여기에는 사용할 모델 ID, 메시지 목록(messages), 그리고 스트리밍 여부(stream)가 포함됩니다.

# 메시지 목록은 시스템 메시지와 사용자 메시지를 포함합니다.

data = {

"model": model,

"messages": [

{"role": "system", "content": "You are a helpful assistant."},

{"role": "user", "content": "Hi"}

],

"stream": True

}

# AIOS API의 v1/chat/completions 엔드포인트로 POST 요청을 보냅니다.

# stream=True를 설정하여 실시간 스트리밍 응답을 받습니다.

response = requests.post(urljoin(aios_base_url, "v1/chat/completions"), json=data, stream=True)

# 모델이 토큰을 생성할 때마다 응답으로 받을 수 있습니다.

# 응답은 각 줄(line)로 분리되어 전송되므로 iter_lines()로 처리합니다.

for line in response.iter_lines():

if line:

try:

# 'data: ' 접두사를 제거하고 JSON 데이터를 파싱합니다.

body = json.loads(line[len("data: "):])

# 델타(choices[0].delta)를 출력합니다.

# 델타는 AI 모델이 생성한 응답 토큰입니다.

print(body["choices"][0]["delta"])

except:

passfrom openai import OpenAI

from urllib.parse import urljoin

aios_base_url = "<<aios endpoint-url>>" # AIOS 모델 호출을 위한 aios endpoint-url을 입력합니다.

model = "<<model>>" # AIOS 모델 호출을 위한 모델 ID를 입력합니다.

# OpenAI 클라이언트를 생성합니다.

# base_url은 AIOS API의 v1 엔드포인트를 가리키며,

# api_key는 AIOS에서 요구하는 키로, 일반적으로 "EMPTY_KEY"로 설정됩니다.

client = OpenAI(base_url=urljoin(aios_base_url, "v1"), api_key="EMPTY_KEY")

# AIOS 모델을 사용하여 채팅 completion을 생성합니다.

# model 매개변수는 사용할 모델 ID를 지정합니다.

# messages 매개변수는 시스템 메시지와 사용자 메시지를 포함하는 메시지 목록입니다.

# stream=True를 설정하여 실시간 스트리밍 응답을 받습니다.

response = client.chat.completions.create(

model=model,

messages=[

{"role": "system", "content": "You are a helpful assistant."},

{"role": "user", "content": "Hi"}

],

stream=True

)

# 모델이 토큰을 생성할 때마다 응답으로 받을 수 있습니다.

# response는 스트림 형태로 전송되므로 반복하여 처리할 수 있습니다.

for chunk in response:

# 델타(choices[0].delta)를 출력합니다.

# 델타는 AI 모델이 생성한 응답 토큰입니다.

print(chunk.choices[0].delta.model_dump())from openai import OpenAI

from urllib.parse import urljoin

aios_base_url = "<<aios endpoint-url>>" # AIOS 모델 호출을 위한 aios endpoint-url을 입력합니다.

model = "<<model>>" # AIOS 모델 호출을 위한 모델 ID를 입력합니다.

# OpenAI 클라이언트를 생성합니다.

# base_url은 AIOS API의 v1 엔드포인트를 가리키며,

# api_key는 AIOS에서 요구하는 키로, 일반적으로 "EMPTY_KEY"로 설정됩니다.

client = OpenAI(base_url=urljoin(aios_base_url, "v1"), api_key="EMPTY_KEY")

# AIOS 모델을 사용하여 채팅 completion을 생성합니다.

# model 매개변수는 사용할 모델 ID를 지정합니다.

# messages 매개변수는 시스템 메시지와 사용자 메시지를 포함하는 메시지 목록입니다.

# stream=True를 설정하여 실시간 스트리밍 응답을 받습니다.

response = client.chat.completions.create(

model=model,

messages=[

{"role": "system", "content": "You are a helpful assistant."},

{"role": "user", "content": "Hi"}

],

stream=True

)

# 모델이 토큰을 생성할 때마다 응답으로 받을 수 있습니다.

# response는 스트림 형태로 전송되므로 반복하여 처리할 수 있습니다.

for chunk in response:

# 델타(choices[0].delta)를 출력합니다.

# 델타는 AI 모델이 생성한 응답 토큰입니다.

print(chunk.choices[0].delta.model_dump())from langchain_openai import ChatOpenAI

from urllib.parse import urljoin

aios_base_url = "<<aios endpoint-url>>" # AIOS 모델 호출을 위한 aios endpoint-url을 입력합니다.

model = "<<model>>" # AIOS 모델 호출을 위한 모델 ID를 입력합니다.

# LangChain의 ChatOpenAI 클래스를 사용하여 채팅 LLM(대형 언어 모델) 인스턴스를 생성합니다.

# base_url은 AIOS API의 v1 엔드포인트를 가리키며,

# api_key는 AIOS에서 요구하는 키로, 일반적으로 "EMPTY_KEY"로 설정됩니다.

# model 매개변수는 사용할 모델 ID를 지정합니다.

llm = ChatOpenAI(

base_url=urljoin(aios_base_url, "v1"),

api_key="EMPTY_KEY",

model=model

)

# 채팅 메시지 목록을 구성합니다.

# 시스템 메시지와 사용자 메시지를 포함합니다.

messages = [

("system", "You are a helpful assistant."),

("human", "Hi"),

]

# 모델이 토큰을 생성할 때마다 응답으로 받을 수 있습니다.

# llm.stream 메서드는 실시간으로 토큰을 생성하는 스트림을 반환합니다.

for chunk in llm.stream(messages):

# 각 청크를 출력합니다.

# 이 청크는 AI 모델이 생성한 응답 토큰입니다.

print(chunk)from langchain_openai import ChatOpenAI

from urllib.parse import urljoin

aios_base_url = "<<aios endpoint-url>>" # AIOS 모델 호출을 위한 aios endpoint-url을 입력합니다.

model = "<<model>>" # AIOS 모델 호출을 위한 모델 ID를 입력합니다.

# LangChain의 ChatOpenAI 클래스를 사용하여 채팅 LLM(대형 언어 모델) 인스턴스를 생성합니다.

# base_url은 AIOS API의 v1 엔드포인트를 가리키며,

# api_key는 AIOS에서 요구하는 키로, 일반적으로 "EMPTY_KEY"로 설정됩니다.

# model 매개변수는 사용할 모델 ID를 지정합니다.

llm = ChatOpenAI(

base_url=urljoin(aios_base_url, "v1"),

api_key="EMPTY_KEY",

model=model

)

# 채팅 메시지 목록을 구성합니다.

# 시스템 메시지와 사용자 메시지를 포함합니다.

messages = [

("system", "You are a helpful assistant."),

("human", "Hi"),

]

# 모델이 토큰을 생성할 때마다 응답으로 받을 수 있습니다.

# llm.stream 메서드는 실시간으로 토큰을 생성하는 스트림을 반환합니다.

for chunk in llm.stream(messages):

# 각 청크를 출력합니다.

# 이 청크는 AI 모델이 생성한 응답 토큰입니다.

print(chunk)const aios_base_url = "<<aios endpoint-url>>"; // AIOS 모델 호출을 위한 aios endpoint-url을 입력합니다.

const model = "<<model>>"; // AIOS 모델 호출을 위한 모델 ID를 입력합니다.

// 요청 데이터를 구성합니다.

// 여기에는 사용할 모델 ID, 메시지 목록(messages), 그리고 스트리밍 여부(stream)가 포함됩니다.

// 메시지 목록은 시스템 메시지와 사용자 메시지를 포함합니다.

const data = {

model: model,

messages: [

{ role: "system", content: "You are a helpful assistant." },

{ role: "user", content: "Hi" },

],

stream: true,

};

// AIOS API의 v1/chat/completions 엔드포인트 URL을 생성합니다.

let url = new URL("/v1/chat/completions", aios_base_url);

// AIOS API에 POST 요청을 보냅니다.

const response = await fetch(url, {

method: "POST",

headers: {

"Content-Type": "application/json",

},

body: JSON.stringify(data),

});

// 모델이 토큰을 생성할 때마다 응답으로 받을 수 있습니다.

// 응답 본문을 텍스트 디코더 스트림으로 변환하여 읽습니다.

const reader = response.body.pipeThrough(new TextDecoderStream()).getReader();

let buf = "";

while (true) {

const { value, done } = await reader.read();

if (done) break;

// 받은 데이터를 버퍼에 추가합니다.

buf += value;

let sep;

// 버퍼에서 줄바꿈 문자(\n\n)를 찾아서 데이터를 분리합니다.

while ((sep = buf.indexOf("\n\n")) >= 0) {

const data = buf.slice(0, sep);

buf = buf.slice(sep + 2);

// 각 줄을 처리합니다.

for (const rawLine of data.split("\n")) {

const line = rawLine.trim();

if (!line.startsWith("data: ")) continue;

// "data: " 접두사를 제거하고 JSON 데이터를 추출합니다.

const payload = line.slice("data: ".length).trim();

if (payload === "[DONE]") break;

// JSON 데이터를 파싱합니다.

const json = JSON.parse(payload);

// 델타(choices[0].delta)를 출력합니다.

// 델타는 AI 모델이 생성한 응답 토큰입니다.

console.log(json.choices[0].delta);

}

}

}const aios_base_url = "<<aios endpoint-url>>"; // AIOS 모델 호출을 위한 aios endpoint-url을 입력합니다.

const model = "<<model>>"; // AIOS 모델 호출을 위한 모델 ID를 입력합니다.

// 요청 데이터를 구성합니다.

// 여기에는 사용할 모델 ID, 메시지 목록(messages), 그리고 스트리밍 여부(stream)가 포함됩니다.

// 메시지 목록은 시스템 메시지와 사용자 메시지를 포함합니다.

const data = {

model: model,

messages: [

{ role: "system", content: "You are a helpful assistant." },

{ role: "user", content: "Hi" },

],

stream: true,

};

// AIOS API의 v1/chat/completions 엔드포인트 URL을 생성합니다.

let url = new URL("/v1/chat/completions", aios_base_url);

// AIOS API에 POST 요청을 보냅니다.

const response = await fetch(url, {

method: "POST",

headers: {

"Content-Type": "application/json",

},

body: JSON.stringify(data),

});

// 모델이 토큰을 생성할 때마다 응답으로 받을 수 있습니다.

// 응답 본문을 텍스트 디코더 스트림으로 변환하여 읽습니다.

const reader = response.body.pipeThrough(new TextDecoderStream()).getReader();

let buf = "";

while (true) {

const { value, done } = await reader.read();

if (done) break;

// 받은 데이터를 버퍼에 추가합니다.

buf += value;

let sep;

// 버퍼에서 줄바꿈 문자(\n\n)를 찾아서 데이터를 분리합니다.

while ((sep = buf.indexOf("\n\n")) >= 0) {

const data = buf.slice(0, sep);

buf = buf.slice(sep + 2);

// 각 줄을 처리합니다.

for (const rawLine of data.split("\n")) {

const line = rawLine.trim();

if (!line.startsWith("data: ")) continue;

// "data: " 접두사를 제거하고 JSON 데이터를 추출합니다.

const payload = line.slice("data: ".length).trim();

if (payload === "[DONE]") break;

// JSON 데이터를 파싱합니다.

const json = JSON.parse(payload);

// 델타(choices[0].delta)를 출력합니다.

// 델타는 AI 모델이 생성한 응답 토큰입니다.

console.log(json.choices[0].delta);

}

}

}import OpenAI from "openai";

const aios_base_url = "<<aios endpoint-url>>"; // AIOS 모델 호출을 위한 aios endpoint-url을 입력합니다.

const model = "<<model>>"; // AIOS 모델 호출을 위한 모델 ID를 입력합니다.

// OpenAI 클라이언트를 생성합니다.

// apiKey는 AIOS에서 요구하는 키로, 일반적으로 "EMPTY_KEY"로 설정됩니다.

// baseURL은 AIOS API의 v1 엔드포인트를 가리킵니다.

const client = new OpenAI({

apiKey: "EMPTY_KEY",

baseURL: new URL("v1", aios_base_url).href,

});

// AIOS 모델을 사용하여 채팅 completion을 생성합니다.

// model 매개변수는 사용할 모델 ID를 지정합니다.

// messages 매개변수는 시스템 메시지와 사용자 메시지를 포함하는 메시지 목록입니다.

// stream: true를 설정하여 실시간 스트리밍 응답을 받습니다.

const response = await client.chat.completions.create({

model: model,

messages: [

{ role: "system", content: "You are a helpful assistant." },

{ role: "user", content: "Hi" },

],

stream: true,

});

// 모델이 토큰을 생성할 때마다 응답으로 받을 수 있습니다.

// for await...of 루프를 사용하여 스트림 이벤트를 순차적으로 처리합니다.

for await (const event of response) {

// 델타(choices[0].delta)를 출력합니다.

// 델타는 AI 모델이 생성한 응답 토큰입니다.

console.log(event.choices[0].delta);

}import OpenAI from "openai";

const aios_base_url = "<<aios endpoint-url>>"; // AIOS 모델 호출을 위한 aios endpoint-url을 입력합니다.

const model = "<<model>>"; // AIOS 모델 호출을 위한 모델 ID를 입력합니다.

// OpenAI 클라이언트를 생성합니다.

// apiKey는 AIOS에서 요구하는 키로, 일반적으로 "EMPTY_KEY"로 설정됩니다.

// baseURL은 AIOS API의 v1 엔드포인트를 가리킵니다.

const client = new OpenAI({

apiKey: "EMPTY_KEY",

baseURL: new URL("v1", aios_base_url).href,

});

// AIOS 모델을 사용하여 채팅 completion을 생성합니다.

// model 매개변수는 사용할 모델 ID를 지정합니다.

// messages 매개변수는 시스템 메시지와 사용자 메시지를 포함하는 메시지 목록입니다.

// stream: true를 설정하여 실시간 스트리밍 응답을 받습니다.

const response = await client.chat.completions.create({

model: model,

messages: [

{ role: "system", content: "You are a helpful assistant." },

{ role: "user", content: "Hi" },

],

stream: true,

});

// 모델이 토큰을 생성할 때마다 응답으로 받을 수 있습니다.

// for await...of 루프를 사용하여 스트림 이벤트를 순차적으로 처리합니다.

for await (const event of response) {

// 델타(choices[0].delta)를 출력합니다.

// 델타는 AI 모델이 생성한 응답 토큰입니다.

console.log(event.choices[0].delta);

}import { ChatOpenAI } from "@langchain/openai";

const aios_base_url = "<<aios endpoint-url>>"; // AIOS 모델 호출을 위한 aios endpoint-url을 입력합니다.

const model = "<<model>>"; // AIOS 모델 호출을 위한 모델 ID를 입력합니다.

// LangChain의 ChatOpenAI 클래스를 사용하여 채팅 LLM(대형 언어 모델) 인스턴스를 생성합니다.

// model 매개변수는 사용할 모델 ID를 지정합니다.

// apiKey는 AIOS에서 요구하는 키로, 일반적으로 "EMPTY_KEY"로 설정됩니다.

// configuration.baseURL은 AIOS API의 v1 엔드포인트를 가리킵니다.

const llm = new ChatOpenAI({

model: model,

apiKey: "EMPTY_KEY",

configuration: {

baseURL: new URL("v1", aios_base_url).href,

},

});

// 채팅 메시지 목록을 구성합니다.

// 시스템 메시지와 사용자 메시지를 포함합니다.

const messages = [

{ role: "system", content: "You are a helpful assistant." },

{ role: "user", content: "Hi" },

];

// 모델이 토큰을 생성할 때마다 응답으로 받을 수 있습니다.

// llm.stream 메서드는 실시간으로 토큰을 생성하는 스트림을 반환합니다.

const completion = await llm.stream(messages);

for await (const chunk of completion) {

// 각 청크의 내용(content)을 출력합니다.

// 이 내용은 AI 모델이 생성한 응답 토큰입니다.

console.log(chunk.content);

}import { ChatOpenAI } from "@langchain/openai";

const aios_base_url = "<<aios endpoint-url>>"; // AIOS 모델 호출을 위한 aios endpoint-url을 입력합니다.

const model = "<<model>>"; // AIOS 모델 호출을 위한 모델 ID를 입력합니다.

// LangChain의 ChatOpenAI 클래스를 사용하여 채팅 LLM(대형 언어 모델) 인스턴스를 생성합니다.

// model 매개변수는 사용할 모델 ID를 지정합니다.

// apiKey는 AIOS에서 요구하는 키로, 일반적으로 "EMPTY_KEY"로 설정됩니다.

// configuration.baseURL은 AIOS API의 v1 엔드포인트를 가리킵니다.

const llm = new ChatOpenAI({

model: model,

apiKey: "EMPTY_KEY",

configuration: {

baseURL: new URL("v1", aios_base_url).href,

},

});

// 채팅 메시지 목록을 구성합니다.

// 시스템 메시지와 사용자 메시지를 포함합니다.

const messages = [

{ role: "system", content: "You are a helpful assistant." },

{ role: "user", content: "Hi" },

];

// 모델이 토큰을 생성할 때마다 응답으로 받을 수 있습니다.

// llm.stream 메서드는 실시간으로 토큰을 생성하는 스트림을 반환합니다.

const completion = await llm.stream(messages);

for await (const chunk of completion) {

// 각 청크의 내용(content)을 출력합니다.

// 이 내용은 AI 모델이 생성한 응답 토큰입니다.

console.log(chunk.content);

}package main

import (

"bufio"

"bytes"

"encoding/json"

"fmt"

"net/http"

)

const (

aiosBaseUrl = "<<aios endpoint-url>>" // AIOS 모델 호출을 위한 aios endpoint-url을 입력합니다.

model = "<<model>>" // AIOS 모델 호출을 위한 모델 ID를 입력합니다.

)

// 메시지 구조를 정의합니다.

// Role: 메시지 역할 (예: system, user)

// Content: 메시지 내용

type Message struct {

Role string `json:"role"`

Content string `json:"content"`

}

// POST 요청에 사용될 데이터 구조를 정의합니다.

// Model: 사용할 모델 ID

// Messages: 메시지 목록

// Stream: 스트리밍 응답 여부 (옵션)

type PostData struct {

Model string `json:"model"`

Messages []Message `json:"messages"`

Stream bool `json:"stream,omitempty"`

}

func main() {

// 요청 데이터를 생성합니다.

// 메시지 목록에는 시스템 메시지와 사용자 메시지가 포함됩니다.

// Stream: true를 설정하여 실시간 스트리밍 응답을 받습니다.

data := PostData{

Model: model,

Messages: []Message{

{

Role: "system",

Content: "You are a helpful assistant.",

},

{

Role: "user",

Content: "Hi",

},

},

Stream: true,

}

// 데이터를 JSON 형식으로 마샬링합니다.

jsonData, err := json.Marshal(data)

if err != nil {

panic(err)

}

// AIOS API의 v1/chat/completions 엔드포인트로 POST 요청을 보냅니다.

response, err := http.Post(aiosBaseUrl+"/v1/chat/completions", "application/json", bytes.NewBuffer(jsonData))

if err != nil {

panic(err)

}

defer response.Body.Close()

// 모델이 토큰을 생성할 때마다 응답으로 받을 수 있습니다.

// HTTP 응답 본문을 스캔하여 줄 단위로 처리합니다.

var v map[string]interface{}

scanner := bufio.NewScanner(response.Body)

for scanner.Scan() {

line := bytes.TrimSpace(scanner.Bytes())

// 줄이 "data: "로 시작하지 않으면 건너뜁니다.

if !bytes.HasPrefix(line, []byte("data: ")) {

continue

}

// "data: " 접두사를 제거합니다.

payload := bytes.TrimPrefix(line, []byte("data: "))

// payload가 "[DONE]"이라면 스트리밍을 종료합니다.

if bytes.Equal(payload, []byte("[DONE]")) {

break

}

// JSON 데이터를 파싱합니다.

json.Unmarshal(payload, &v)

// 응답에서 choices 배열을 추출합니다.

choices := v["choices"].([]interface{})

// 첫 번째 데이터를 추출합니다.

choice := choices[0].(map[string]interface{})

// 델타(delta)를 JSON 형식으로 직렬화하여 출력합니다.

message, err := json.Marshal(choice["delta"])

if err != nil {

panic(err)

}

fmt.Println(string(message))

}

}package main

import (

"bufio"

"bytes"

"encoding/json"

"fmt"

"net/http"

)

const (

aiosBaseUrl = "<<aios endpoint-url>>" // AIOS 모델 호출을 위한 aios endpoint-url을 입력합니다.

model = "<<model>>" // AIOS 모델 호출을 위한 모델 ID를 입력합니다.

)

// 메시지 구조를 정의합니다.

// Role: 메시지 역할 (예: system, user)

// Content: 메시지 내용

type Message struct {

Role string `json:"role"`

Content string `json:"content"`

}

// POST 요청에 사용될 데이터 구조를 정의합니다.

// Model: 사용할 모델 ID

// Messages: 메시지 목록

// Stream: 스트리밍 응답 여부 (옵션)

type PostData struct {

Model string `json:"model"`

Messages []Message `json:"messages"`

Stream bool `json:"stream,omitempty"`

}

func main() {

// 요청 데이터를 생성합니다.

// 메시지 목록에는 시스템 메시지와 사용자 메시지가 포함됩니다.

// Stream: true를 설정하여 실시간 스트리밍 응답을 받습니다.

data := PostData{

Model: model,

Messages: []Message{

{

Role: "system",

Content: "You are a helpful assistant.",

},

{

Role: "user",

Content: "Hi",

},

},

Stream: true,

}

// 데이터를 JSON 형식으로 마샬링합니다.

jsonData, err := json.Marshal(data)

if err != nil {

panic(err)

}

// AIOS API의 v1/chat/completions 엔드포인트로 POST 요청을 보냅니다.

response, err := http.Post(aiosBaseUrl+"/v1/chat/completions", "application/json", bytes.NewBuffer(jsonData))

if err != nil {

panic(err)

}

defer response.Body.Close()

// 모델이 토큰을 생성할 때마다 응답으로 받을 수 있습니다.

// HTTP 응답 본문을 스캔하여 줄 단위로 처리합니다.

var v map[string]interface{}

scanner := bufio.NewScanner(response.Body)

for scanner.Scan() {

line := bytes.TrimSpace(scanner.Bytes())

// 줄이 "data: "로 시작하지 않으면 건너뜁니다.

if !bytes.HasPrefix(line, []byte("data: ")) {

continue

}

// "data: " 접두사를 제거합니다.

payload := bytes.TrimPrefix(line, []byte("data: "))

// payload가 "[DONE]"이라면 스트리밍을 종료합니다.

if bytes.Equal(payload, []byte("[DONE]")) {

break

}

// JSON 데이터를 파싱합니다.

json.Unmarshal(payload, &v)

// 응답에서 choices 배열을 추출합니다.

choices := v["choices"].([]interface{})

// 첫 번째 데이터를 추출합니다.

choice := choices[0].(map[string]interface{})

// 델타(delta)를 JSON 형식으로 직렬화하여 출력합니다.

message, err := json.Marshal(choice["delta"])

if err != nil {

panic(err)

}

fmt.Println(string(message))

}

}package main

import (

"context"

"fmt"

"github.com/openai/openai-go"

"github.com/openai/openai-go/option"

)

const (

aiosBaseUrl = "<<aios endpoint-url>>" // AIOS 모델 호출을 위한 aios endpoint-url을 입력합니다.

model = "<<model>>" // AIOS 모델 호출을 위한 모델 ID를 입력합니다.

)

func main() {

// OpenAI 클라이언트를 생성합니다.

// option.WithBaseURL을 사용하여 AIOS API의 v1 엔드포인트를 설정합니다.

client := openai.NewClient(

option.WithBaseURL(aiosBaseUrl + "/v1"),

)

// AIOS 모델을 사용하여 스트리밍 채팅 completion을 생성합니다.

// openai.ChatCompletionNewParams를 사용하여 모델과 메시지 목록을 설정합니다.

// 메시지 목록에는 시스템 메시지와 사용자 메시지가 포함됩니다.

response := client.Chat.Completions.NewStreaming(context.TODO(), openai.ChatCompletionNewParams{

Model: model,

Messages: []openai.ChatCompletionMessageParamUnion{

openai.SystemMessage("You are a helpful assistant."),

openai.UserMessage("Hi"),

},

})

// 모델이 토큰을 생성할 때마다 응답으로 받을 수 있습니다.

// Next() 메서드는 다음 청크가 있을 때 true를 반환합니다.

for response.Next() {

// 현재 chunk의 델타(choices[0].delta)를 출력합니다.

// 델타는 AI 모델이 생성한 응답 토큰입니다.

chunk := response.Current().Choices[0].Delta

fmt.Println(chunk.RawJSON())

}

}package main

import (

"context"

"fmt"

"github.com/openai/openai-go"

"github.com/openai/openai-go/option"

)

const (

aiosBaseUrl = "<<aios endpoint-url>>" // AIOS 모델 호출을 위한 aios endpoint-url을 입력합니다.

model = "<<model>>" // AIOS 모델 호출을 위한 모델 ID를 입력합니다.

)

func main() {

// OpenAI 클라이언트를 생성합니다.

// option.WithBaseURL을 사용하여 AIOS API의 v1 엔드포인트를 설정합니다.

client := openai.NewClient(

option.WithBaseURL(aiosBaseUrl + "/v1"),

)

// AIOS 모델을 사용하여 스트리밍 채팅 completion을 생성합니다.

// openai.ChatCompletionNewParams를 사용하여 모델과 메시지 목록을 설정합니다.

// 메시지 목록에는 시스템 메시지와 사용자 메시지가 포함됩니다.

response := client.Chat.Completions.NewStreaming(context.TODO(), openai.ChatCompletionNewParams{

Model: model,

Messages: []openai.ChatCompletionMessageParamUnion{

openai.SystemMessage("You are a helpful assistant."),

openai.UserMessage("Hi"),

},

})

// 모델이 토큰을 생성할 때마다 응답으로 받을 수 있습니다.

// Next() 메서드는 다음 청크가 있을 때 true를 반환합니다.

for response.Next() {

// 현재 chunk의 델타(choices[0].delta)를 출력합니다.

// 델타는 AI 모델이 생성한 응답 토큰입니다.

chunk := response.Current().Choices[0].Delta

fmt.Println(chunk.RawJSON())

}

}Response

토큰마다 답변이 생성되고, 각 토큰은 choices의 delta 필드에서 확인할 수 있습니다.

{'role': 'assistant', 'content': ''}

{'reasoning_content': ''}

{'reasoning_content': 'The'}

{'reasoning_content': ' user'}

{'reasoning_content': ' says'}

{'reasoning_content': ' "'}

{'reasoning_content': 'Hi'}

{'reasoning_content': '".'}

{'reasoning_content': ' We'}

{'reasoning_content': ' respond'}

{'reasoning_content': ' with'}

{'reasoning_content': ' a'}

{'reasoning_content': ' greeting'}

{'reasoning_content': '.'}

{'content': ''}

{'content': 'Hello'}

{'content': '!'}

{'content': ' How'}

{'content': ' can'}

{'content': ' I'}

{'content': ' assist'}

{'content': ' you'}

{'content': ' today'}

{'content': '?'}

{}

tool calling

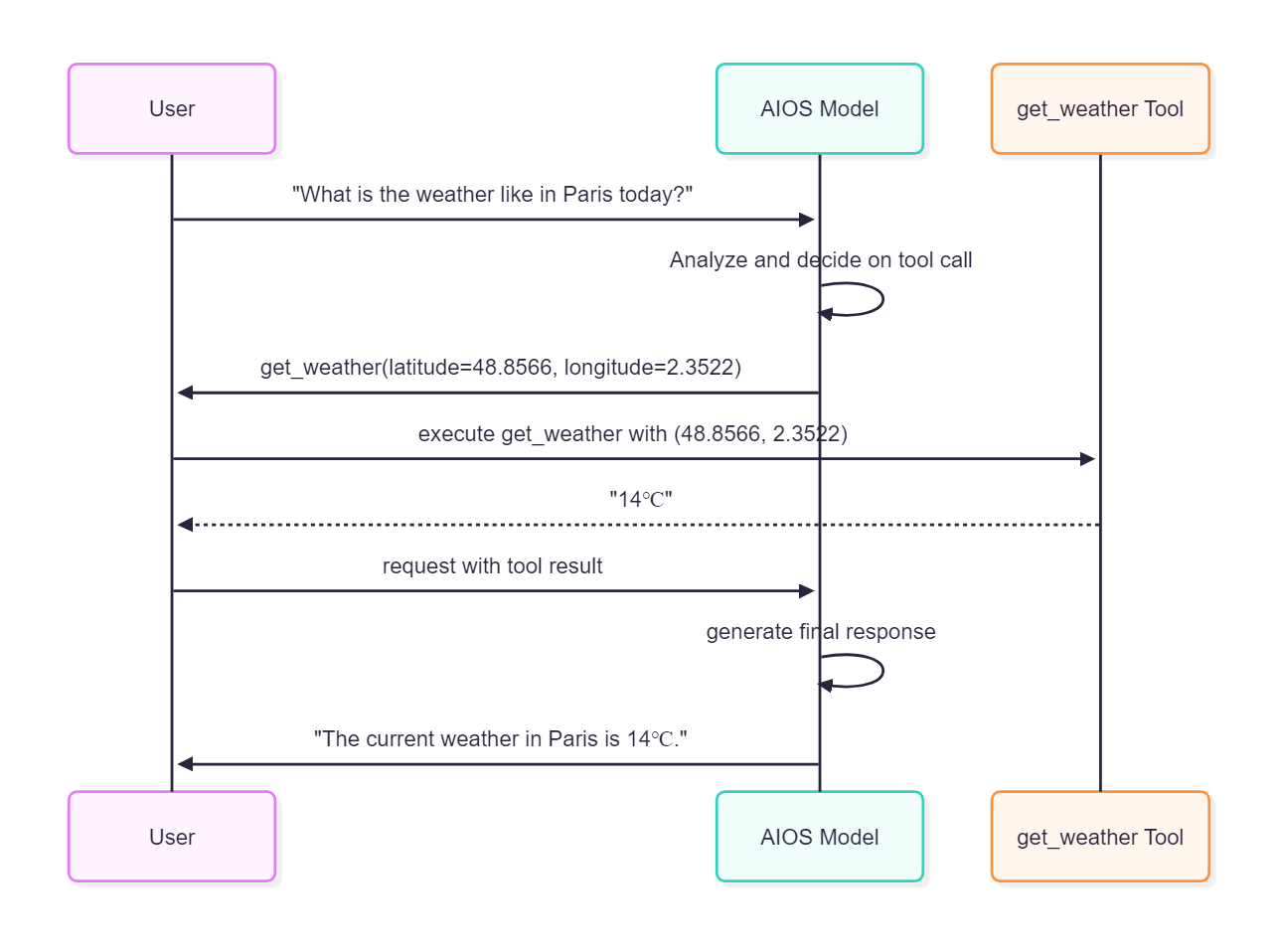

Tool Calling 기능은 모델이 특정 작업을 수행하기 위해 외부 함수를 호출할 수 있게 해줍니다.

모델은 사용자의 요청을 분석하여 필요한 도구를 선택하고, 해당 도구를 호출하기 위한 인수를 응답으로 생성합니다.

모델이 생성한 tool call 메시지를 활용하여 실제 도구를 실행한 다음 그 결과를 tool message로 구성하여 모델에게 다시 요청하면,

도구 실행 결과를 바탕으로 사용자에게 자연스러운 답변을 생성합니다.

- openai/gpt-oss-120b 모델은 tool calling 기능이 작동되지 않습니다.

Request

import json

import requests

from urllib.parse import urljoin

aios_base_url = "<<aios endpoint-url>>" # AIOS 모델 호출을 위한 aios endpoint-url을 입력합니다.

model = "<<model>>" # AIOS 모델 호출을 위한 모델 ID를 입력합니다.

# 날씨 정보를 알아보는 함수를 정의합니다.

# 이 함수는 제공된 좌표에 대한 현재 온도를 섭씨로 반환합니다.

tools = [{

"type": "function",

"function": {

"name": "get_weather",

"description": "Get current temperature for provided coordinates in celsius.",

"parameters": {

"type": "object",

"properties": {

"latitude": {"type": "number"},

"longitude": {"type": "number"}

},

"required": ["latitude", "longitude"],

"additionalProperties": False

},

"strict": True

}

}]

# 사용자 메시지를 정의합니다.

# 사용자는 파리의 오늘 날씨를 묻고 있습니다.

messages = [{"role": "user", "content": "What is the weather like in Paris today?"}]

# 요청 데이터를 구성합니다.

# 여기에는 사용할 모델 ID, 메시지 목록(messages), 및 도구 목록(tools)이 포함됩니다.

data = {

"model": model,

"messages": messages,

"tools": tools

}

# AIOS API의 v1/chat/completions 엔드포인트로 POST 요청을 보냅니다.

# 이 요청은 모델에게 사용자 질문을 처리하고 필요한 도구 호출을 결정하도록 합니다.

response = requests.post(urljoin(aios_base_url, "v1/chat/completions"), json=data)

# 응답 본문을 JSON 형식으로 파싱합니다.

body = json.loads(response.text)

# AI 모델이 생성한 응답에서 도구 호출 정보를 출력합니다.

# 이 정보는 모델이 어떤 도구를 호출해야 하는지를 나타냅니다.

print(body["choices"][0]["message"]["tool_calls"])

# 날씨 함수의 구현체, 항상 14도를 응답합니다.

def get_weather(latitude, longitude):

return "14℃"

# 첫 번째 응답에서 도구 호출 정보를 추출합니다.

# 이는 모델이 요청한 도구 호출 정보를 가져옵니다.

tool_call = body["choices"][0]["message"]["tool_calls"][0]

# json 문자열 형식의 도구 호출의 인수를 dict 포맷으로 파싱합니다.

args = json.loads(tool_call["function"]["arguments"])

# 실제 함수를 호출하여 결과를 얻습니다. (예: "14℃")

# 이 단계에서는 실제 날씨 정보 조회 로직이 실행됩니다.

result = get_weather(args["latitude"], args["longitude"]) # "14℃"

# 함수의 호출 결과값을 **tool** 메시지로 대화 맥락에 추가하고 다시 모델을 호출하면

# 함수의 호출 결과값을 이용하여 모델이 적절한 답변을 생성합니다.

# 모델의 tool call 메시지를 messages에 추가하여 대화 맥락을 유지합니다.

messages.append(body["choices"][0]["message"])

# 실제 함수를 호출한 결과를 messages에 추가합니다.

# 이는 모델이 도구 호출 결과를 기반으로 최종 답변을 생성할 수 있도록 합니다.

messages.append({

"role": "tool",

"tool_call_id": tool_call["id"],

"content": str(result)

})

# 두 번째 요청 데이터를 구성합니다.