쉽고 편리하게 ML/DL(Machine Learning/Deep Learning) 모델 개발 및 학습 환경을 구축할 수 있는 AI/ML 서비스를 제공합니다.

이 섹션의 다중 페이지 출력 화면임. 여기를 클릭하여 프린트.

AI-ML

- 1: AIOS

- 1.1: Overview

- 1.2: How-to Guides

- 1.3: References

- 1.3.1: API Reference

- 1.3.2: Tutorial

- 1.3.2.1: Chat Playground

- 1.3.2.2: RAG

- 1.3.2.3: Autogen

- 1.3.3: Request Examples

- 1.4: Release Note

- 1.5: Licenses

- 1.5.1: Llama-4-Scout

- 1.5.2: Llama-Guard-4-12B

- 1.5.3: bge-m3

- 1.5.4: bge-reranker-v2-m3

- 1.5.5: Qwen3-Coder-30B-A3B

- 1.5.6: gpt-oss-120b

- 1.5.7: Qwen3-30B-A3B-Thinking

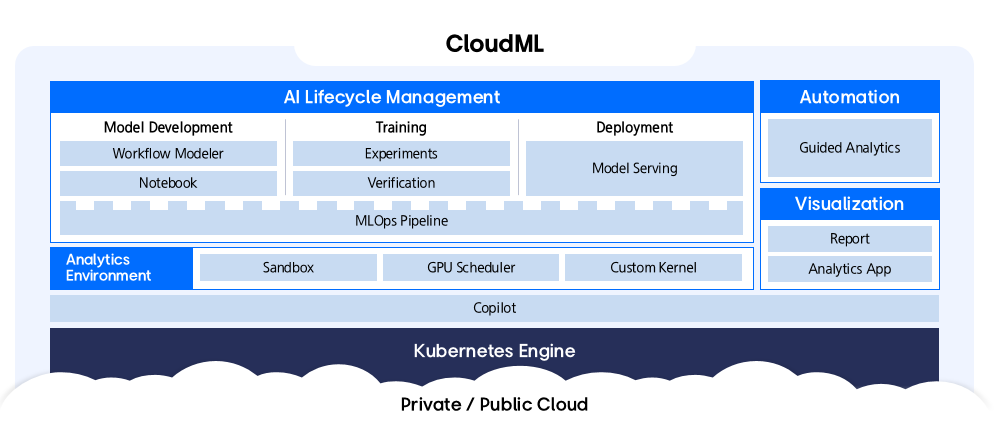

- 2: CloudML

- 2.1: Overview

- 2.2: How-to guides

- 2.2.1: Kubernetes 클러스터 구성

- 2.3: API Reference

- 2.4: CLI Reference

- 2.5: Release Note

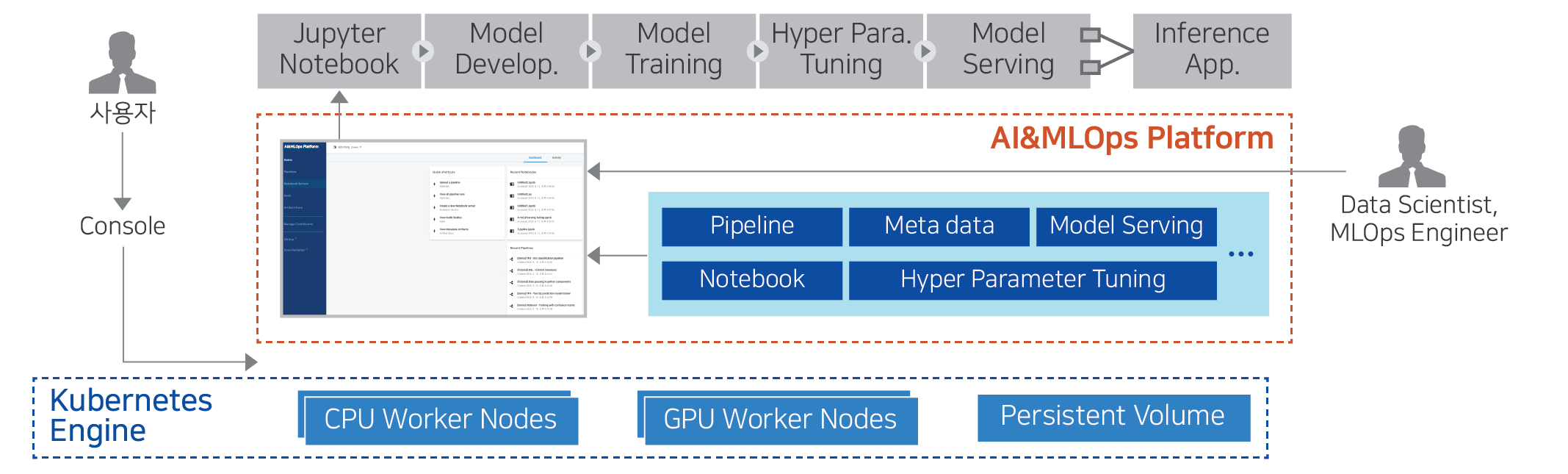

- 3: AI&MLOps Platform

- 3.1: Overview

- 3.2: How-to guides

- 3.2.1: 클러스터 배포

- 3.2.2: Kubeflow 사용 가이드

- 3.3: API Reference

- 3.4: CLI Reference

- 3.5: Release Note

1 - AIOS

1.1 - Overview

서비스 개요

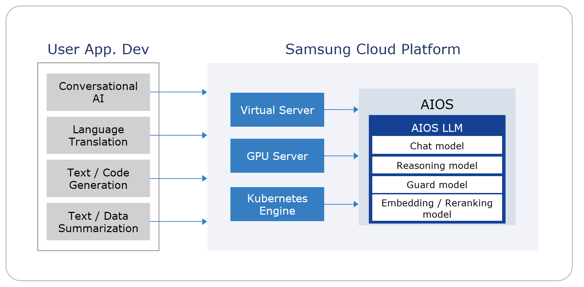

AIOS는 Samsung Cloud Platform에서 Virtual Server, GPU Server, Kubernetes Engine 자원을 생성한 후, 별도의 LLM 서비스 설치나 설정 없이 해당 자원에서 LLM을 사용하여 AI 애플리케이션의 개발을 할 수 있는 환경을 제공합니다.

특장점

- 편리한 LLM 사용 Samsung Cloud Platform에서 Virtual Server, GPU Server, Kubernetes Engine 자원에서 바로 LLM을 이용할 수 있는 LLM Endpoint를 기본으로 제공합니다.

- AI 개발 생산성 향상 : AI 개발자는 다양한 모델에 대해서 동일한 API로 사용이 가능하며, OpenAI 및 LangChain SDK와 호환성을 지원하여 기존 개발 환경과 프레임워크에 쉽게 연동할 수 있습니다.

서비스 구성도

제공 기능

다음과 같은 기능을 제공하고 있습니다.

- AIOS LLM Endpoint 제공: Virtual Server, GPU Server, Kubernetes Engine 서비스를 신청하면 생성된 자원의 상세 페이지에서 LLM Endpoint 정보 및 이용 가이드가 제공되며 이용 가이드에 따라 해당 자원에서 LLM에 접속하여 사용 할 수 있습니다.

- AIOS Report 제공: 유형별, 리소스별, 모델별 호출 횟수와 Token 사용량 및 LLM별 전체 사용량을 확인할 수 있습니다.

제공 모델

AIOS에서 제공하는 LLM 모델은 다음과 같습니다.

| 모델명 | 모델 타입 | 소개 | 주요 활용처 | 특징 |

|---|---|---|---|---|

| gpt-oss-120b | Chat+Reasoning | 1,200억 파라미터 기반 GPT 계열 오픈소스 최신 모델 | 연구·실험, 대규모 언어 이해, 복잡한 추론/분석이 필요한 AI 서비스, 에이전트형 시스템 구축 |

|

| Qwen3-Coder-30B-A3B-Instruct | Code | 코드 생성과 디버깅에 최적화된 Qwen3 시리즈 코드 모델 | 소프트웨어 개발, AI 코드 어시스턴트, 긴 문서/저장소 분석 |

|

| Qwen3-30B-A3B-Thinking-2507 | Chat+Reasoning | 장문 추론과 심층적 사고(Thinking)에 강화된 Qwen3 모델 | 리서치, 분석 보고서, 논리적 글쓰기, 수학, 과학, 코딩 |

|

| Llama-4-Scout | Chat+Vision | 멀티모달 가능한 최신 Llama 모델 | 문서 분석·요약, 고객 지원·챗봇 |

|

| Llama-Guard-4-12B | moderation | 최신 대형 언어모델 및 멀티모달 AI 서비스에서 신뢰성과 안전성을 높이기 위한 핵심 보안 및 모더레이션 모델 | 사용자 입력과 모델의 응답의 유해성 자동 필터링에 활용 |

|

| bge-m3 | embedding | 다기능, 다국어, 대용량 입력 지원이라는 세 가지 특성을 지닌 핵심 임베딩 모델 | 생성형 AI에서 외부 지식 검색 및 정답 근거 제공에 사용 Dense와 Sparse 검색을 결합해 정확도와 일반화 성능을 모두 확보할 때 활용 |

|

| bge-reranker-v2-m3 | rerank | 다국어 환경에서 빠르고 정확한 검색 결과 재정렬이 필요한 다양한 정보 검색, 질의응답, 챗봇 시스템의 핵심 컴포넌트 | 질문에 대한 후보 답변이나 문서를 관련도 순으로 재정렬 |

|

리전별 제공 현황

AIOS는 아래의 환경에서 제공 가능합니다.

| 리전 | 제공 여부 |

|---|---|

| 한국 서부(kr-west1) | 제공 |

| 한국 동부(kr-east1) | 미제공 |

| 한국 남부1(kr-south1) | 미제공 |

| 한국 남부2(kr-south2) | 미제공 |

| 한국 남부3(kr-south3) | 미제공 |

선행 서비스

해당 서비스를 생성하기 전에 미리 구성되어 있어야 하는 서비스 목록입니다. 자세한 내용은 각 서비스 별로 제공되는 가이드를 참고하여 사전에 준비하세요.

| 서비스 카테고리 | 서비스 | 상세 설명 |

|---|---|---|

| Compute | Virtual Server | 클라우드 컴퓨팅에 최적화된 가상 서버 |

| Compute | GPU Server | 클라우드 환경에서 AI모델 실험, 예측, 추론 등 빠른 연산 속도를 필요로 하는 업무에 적합한 가상 서버 |

| Compute | Cloud Functions | 서버리스 컴퓨팅 기반의 Faas (Function as a Service) |

| Container | Kubernetes Engine | 경량화된 가상 컴퓨팅과 컨테이너와 이를 관리하기 위한 Kubernetes 클러스터 제공 서비스 |

1.2 - How-to Guides

AIOS 사용하기

AIOS는 Virtual Server, GPU Server, Kubernetes Engine 서비스를 생성하면 각 자원 내에서 기본적으로 LLM을 사용할 수 있는 환경을 제공합니다.

각 서비스 생성에 대한 자세한 내용은 아래 표를 참고하세요.

| 서비스 | 가이드 |

|---|---|

| Virtual Server | Virtual Server 생성하기 |

| GPU Server | GPU Server 생성하기 |

| Cloud Functions | Cloud Functions 생성하기 |

| Kubernetes Engine | 클러스터 생성하기 |

LLM 사용하기

LLM은 Samsung Cloud Platform 에서 생성된 Virtual Server, GPU Server, Cloud Functions, Kubernetes Engine 서비스 자원 내부에서 LLM Endpoint 를 활용하여 사용할 수 있습니다. LLM Endpoint는 서비스의 상세 페이지에서 LLM Endpoint에 대한 이용 가이드를 통해 확인할 수 있습니다.

Virtual Server의 LLM Endpoint 확인하기

생성한 Virtual Server의 Virtual Server 상세 페이지에서 LLM Endpoint의 이용 가이드를 확인할 수 있습니다.

LLM Endpoint의 이용 가이드를 확인하려면 다음 절차를 따르세요.

- 모든 서비스 > Compute > Virtual Server 메뉴를 클릭하세요. Virtual Server의 Service Home 페이지로 이동합니다.

- Service Home 페이지에서 Virtual Server 메뉴를 클릭하세요. Virtual Server 목록 페이지로 이동합니다.

- Virtual Server 목록 페이지에서 LLM Endpoint에 연결할 자원을 클릭하세요. Virtual Server 상세 페이지로 이동합니다.

- Virtual Server 상세 페이지에서 LLM Endpoint 항목의 이용 가이드 링크를 클릭하세요. LLM 이용 가이드 팝업창으로 이동합니다.

GPU Server의 LLM Endpoint 확인하기

생성한 GPU Server의 GPU Server 상세 페이지에서 LLM Endpoint의 이용 가이드를 확인할 수 있습니다.

LLM Endpoint의 이용 가이드를 확인하려면 다음 절차를 따르세요.

- 모든 서비스 > Compute > GPU Server 메뉴를 클릭하세요. GPU Server의 Service Home 페이지로 이동합니다.

- Service Home 페이지에서 GPU Server 메뉴를 클릭하세요. GPU Server 목록 페이지로 이동합니다.

- GPU Server 목록 페이지에서 LLM Endpoint에 연결할 자원을 클릭하세요. GPU Server 상세 페이지로 이동합니다.

- GPU Server 상세 페이지에서 LLM Endpoint 항목의 이용 가이드 링크를 클릭하세요. LLM 이용 가이드 팝업창으로 이동합니다.

Cloud Functions의 LLM Endpoint 확인하기

생성한 Cloud Functions의 Cloud Functions 상세 페이지에서 LLM Endpoint의 이용 가이드를 확인할 수 있습니다.

LLM Endpoint의 이용 가이드를 확인하려면 다음 절차를 따르세요.

- 모든 서비스 > Compute > Cloud Functions 메뉴를 클릭하세요. Cloud Functions의 Service Home 페이지로 이동합니다.

- Service Home 페이지에서 Functions 메뉴를 클릭하세요. Functions 목록 페이지로 이동합니다.

- Functions 목록 페이지에서 LLM Endpoint에 연결할 자원을 클릭하세요. Functions 상세 페이지로 이동합니다.

- Functions 상세 페이지에서 LLM Endpoint 항목의 이용 가이드 링크를 클릭하세요. LLM 이용 가이드 팝업창으로 이동합니다.

Kubernetes Engine 클러스터의 LLM Endpoint 확인하기

생성한 Kubernetes Engine 클러스터의 클러스터 상세 페이지에서 LLM Endpoint의 이용 가이드를 확인할 수 있습니다.

LLM Endpoint의 이용 가이드를 확인하려면 다음 절차를 따르세요.

- 모든 서비스 > Container > Kubernetes Engine 메뉴를 클릭하세요. Kubernetes Engine의 Service Home 페이지로 이동합니다.

- Service Home 페이지에서 클러스터 메뉴를 클릭하세요. 클러스터 목록 페이지로 이동합니다.

- 클러스터 목록 페이지에서 LLM Endpoint에 연결할 자원을 클릭하세요. 클러스터 상세 페이지로 이동합니다.

- 클러스터 상세 페이지에서 LLM Endpoint 항목의 이용 가이드 링크를 클릭하세요. LLM 이용 가이드 팝업창으로 이동합니다.

LLM 이용 가이드

LLM Endpoint의 이용 가이드에서는 AIOS LLM 프라이빗 엔드포인트와 제공 모델, 샘플 코드 예시를 확인할 수 있습니다.

AIOS LLM 프라이빗 엔드포인트

AIOS LLM 프라이빗 엔드포인트의 URL이 표시됩니다. URL을 확인하여 Virtual Server, GPU Server, Kubernetes Engine 서비스의 생성된 자원 내부에서 사용할 수 있습니다.

AIOS LLM 제공 모델

AIOS LLM 제공 모델은 다음과 같습니다.

| 모델명 | 모델ID | 컨텍스트 크기 | RPM (Request per minute) | TPM (Token per minute) | 용도 | 라이선스 | 사용중단일 |

|---|---|---|---|---|---|---|---|

| gpt-oss-120b | openai/gpt-oss-120b | 131,072 | 50 RPM | 200K | 연구, 실험, 고급 언어 이해 | Apache 2.0 | 계획없음 |

| Qwen3-Coder-30B-A3B-Instruct | Qwen/Qwen3-Coder-30B-A3B-Instruct | 65,536 | 20 RPM | 30K | 코드 생성, 분석, 디버깅 지원 | Apache 2.0 | 계획없음 |

| Qwen3-30B-A3B-Thinking-2507 | Qwen/Qwen3-30B-A3B-Thinking-2507 | 32,768 | 10 RPM | 30K | 심층적 추론, 장문 분석, 에세이 작성 | Apache 2.0 | 계획없음 |

| Llama-4-Scout | meta-llama/Llama-4-Scout | 32,768 | 20 RPM | 35K | 멀티모달 가능한 최신 Llama 모델 | llama4 | 계획없음 |

| Llama-Guard-4-12B | meta-llama/Llama-Guard-4-12B | 32,768 | 20 RPM | 200K | 최신 대형 언어모델 및 멀티모달 AI 서비스에서 신뢰성과 안전성을 높이기 위한 핵심 보안 및 모더레이션 모델 | llama4 | 계획없음 |

| bge-m3 | sds/bge-m3 | 8,192 | 100 RPM | 200K | 다국어 임베딩 모델로, 다국어 언어를 지원합니다. | Samsung SDS | 계획없음 |

| bge-reranker-v2-m3 | sds/bge-reranker-v2-m3 | 8,192 | 100 RPM | 200K | 경량화된 다국어 리랭커로 빠른 연산과 높은 성능을 제공합니다. | Samsung SDS | 계획없음 |

샘플 코드

AIOS LLM 샘플 코드 예시는 다음을 참조하세요.

curl -H "Content-Type: application/json" \

-d '{

"model": "openai/gpt-oss-120b"

, "prompt" : "Write a haiku about recursion in programming."

, "temperature": 0

, "max_tokens": 100

, "stream": false

}' \

{AIOS LLM 프라이빗 엔드포인트}/{API}curl -H "Content-Type: application/json" \

-d '{

"model": "openai/gpt-oss-120b"

, "prompt" : "Write a haiku about recursion in programming."

, "temperature": 0

, "max_tokens": 100

, "stream": false

}' \

{AIOS LLM 프라이빗 엔드포인트}/{API}LLM 모델별 사용량 확인하기

AIOS의 Service Home 페이지에서 LLM 목록과 모델별 Token 사용량을 확인할 수 있습니다.

- 모든 서비스 > AI-ML > AIOS 메뉴를 클릭하세요. AIOS의 Service Home 페이지로 이동합니다.

- LLM 모델별 사용량 목록에서 LLM의 모델명과 모델 타입, 사용 토큰량(1week)을 확인하세요.

구분 상세 설명 모델명 LLM 이름 - 이름을 클릭하면 해당 모델의 Report 페이지로 이동

모델 타입 LLM 타입 - chat, reasoning, vision, moderation, embedding, rerank

- 모델별 정보는 제공 모델 참고

사용 토큰량(1 Week) 현재일 기준으로 1주일간 사용한 토큰량 표. AIOS LLM 목록 항목

Report 확인하기

AIOS의 Report 페이지에서 일자별 LLM 호출 횟수와 토큰 사용량을 확인할 수 있습니다.

서비스 유형은 Virtual Server, GPU Server, Kubernetes Engine을 선택할 수 있고, 해당 서비스에서 실제로 생성된 자원들 중에서 자원명을 선택하여 조회할 수있고, 사용한 LLM 모델별로도 조회 할 수 있습니다.

- 모든 서비스 > AI-ML > AIOS 메뉴를 클릭하세요. AIOS의 Service Home 페이지로 이동합니다.

- Service Home 페이지에서 Report 메뉴를 클릭하세요. AIOS의 Report 페이지로 이동합니다.

- LLM 모델별 사용량 목록에서 LLM 모델명을 클릭하면 해당 LLM의 Report 페이지로 바로 이동할 수 있습니다.

- Report 페이지에서 Report를 확인할 LLM 모델을 선택한 후, 조회 버튼을 클릭하세요. 해당 LLM 모델의 Report 정보가 표시됩니다.

구분 상세 설명 서비스 유형 LLM을 사용하는 서비스 유형 선택 - Virtual Server, GPU Server, Kubernetes Engine

자원명 서비스 이름 선택 - 서비스 유형을 선택하지 않으면 전체만 선택 가능하고, 서비스 유형에서 특정 상품을 선택하면 특정 자원명 선택 가능

Model LLM 모델 종류 선택 - 모델별 정보는 제공 모델 참고

조회 기간 Report를 확인할 기간 선택 - 일주일 단위로 선택 가능

- 이전 기간은 최대 3개월까지 조회 가능

- 조회하는 데이터는 현재시간 기준 최대 30분 전까지의 데이터를 기준으로 제공

호출 횟수 조회 기간 동안 일자별 호출 횟수 - 일자별로 총 횟수, 성공 횟수, 실패 횟수로 표시

- 전체 호출 횟수: 해당 기간동안의 전체 호출 횟수를 모델별로 제공

Token 사용량 조회 기간 동안 일자별 Token 입력량과 출력량 - 전체 Token 수: 조회 기간 동안 전체 Token 사용량

- Request 당 평균 Token 수: 조회 기간 동안 LLM 호출 시 사용한 평균 Token량

표. AIOS Report 항목

1.3 - References

References

AIOS에서 지원하는 API, SDK reference를 확인할 수 있고, AIOS를 활용해볼 수 있는 Tutorial를 제공합니다.

| 구분 | 설명 |

|---|---|

| API Reference | AIOS에서 지원하는 API 목록

|

| SDK Reference | OpenAI의 SDK 등 AIOS와 호환되는 SDK 정보

|

| Tutorial | AIOS를 활용해볼 수 있는 Tutorial을 제공

|

1.3.1 - API Reference

API Reference 개요

AIOS에서 지원하는 API Reference는 다음과 같습니다.

| API명 | API | 상세 설명 |

|---|---|---|

| Rerank API | POST /rerank, /v1/rerank, /v2/rerank | 임베딩 모델이나 크로스 인코더 모델을 적용하여 단일 쿼리와 문서 목록의 각 항목 간 관련성을 예측합니다. |

| Score API | POST /score, /v1/score | 두 문장의 유사도를 예측합니다. |

| Chat Completions API | POST /v1/chat/completions | OpenAI의 Completions API와 호환되며 OpenAI Python client에서 사용할 수 있습니다. |

| Completions API | POST /v1/completions | OpenAI의 Completions API와 호환되며 OpenAI Python client에서 사용할 수 있습니다. |

| Embedding API | POST /v1/embeddings | 텍스트를 고차원 벡터(임베딩)로 변환하여, 텍스트 간 유사도 계산, 클러스터링, 검색 등 다양한 자연어 처리(NLP) 작업에 활용할 수 있습니다. |

Rerank API

POST /rerank, /v1/rerank, /v2/rerank

개요

Rerank API는 임베딩 모델이나 크로스 인코더 모델을 적용하여 단일 쿼리와 문서 목록의 각 항목 간 관련성을 예측합니다. 일반적으로 문장 쌍의 점수는 두 문장 간 유사도를 0에서 1 사이의 범위로 나타냅니다.

- Embedding 기반 모델: Query와 문서를 각각 벡터로 바꾼 뒤, 벡터간의 유사도(예시: 코사인 유사도)를 측정하여 점수를 계산합니다.

- Reranker(Cross-Encoder) 기반 모델: Query와 문서를 한쌍으로 모델에 넣어서 평가합니다.

Request

Context

| Key | Type | Description | Example |

|---|---|---|---|

| Base URL | string | API 요청을 위한 AIOS URL | AIOS LLM 프라이빗 엔드포인트 |

| Request Method | string | API 요청에 사용되는 HTTP 메서드 | POST |

| Headers | object | 요청 시 필요한 헤더 정보 | { “Content-Type”: “application/json” } |

| Body Parameters | object | 요청 본문에 포함되는 파라미터 | { “model”: “sds/bge-m3”, “query”: …, “documents”: […] } |

Path Parameters

| Name | type | Required | Description | Default value | Boundary value | Example |

|---|---|---|---|---|---|---|

| None |

Query Parameters

| Name | type | Required | Description | Default value | Boundary value | Example |

|---|---|---|---|---|---|---|

| None |

Body Parameters

| Name | Name Sub | type | Required | Description | Default value | Boundary value | Example |

|---|---|---|---|---|---|---|---|

| model | - | string | ✅ | 응답 생성에 사용할 모델을 지정 | “sds/bge-reranker-v2-m3” | ||

| query | - | string | ✅ | 사용자의 검색 질의 또는 질문 | “What is the capital of France?" | ||

| documents | - | array | ✅ | 재정렬 대상인 문서 목록 | 최대 모델 입력 길이 제한 | [“The capital of France is Paris.”] | |

| top_n | - | integer | ❌ | 반환할 상위 문서 개수를 지정(0이면 전체 반환) | 0 | > 0 | 5 |

| truncate_prompt_tokens | - | integer | ❌ | 입력 토큰 수를 제한 | > 0 | 100 |

Example

curl -X "POST" \

{AIOS LLM 프라이빗 엔드포인트}/rerank \

-H "Content-Type: application/json" \

-d '{

"model": "sds/bge-reranker-v2-m3",

"query": "What is the capital of France?",

"documents": [

"The capital of France is Paris.",

"France capital city is known for the Eiffel Tower.",

"Paris is located in the north-central part of France."

],

"top_n": 2,

"truncate_prompt_tokens": 512

}'curl -X "POST" \

{AIOS LLM 프라이빗 엔드포인트}/rerank \

-H "Content-Type: application/json" \

-d '{

"model": "sds/bge-reranker-v2-m3",

"query": "What is the capital of France?",

"documents": [

"The capital of France is Paris.",

"France capital city is known for the Eiffel Tower.",

"Paris is located in the north-central part of France."

],

"top_n": 2,

"truncate_prompt_tokens": 512

}'Response

200 OK

| Name | Type | Description |

|---|---|---|

| id | string | API 응답의 고유 식별자(UUID 형식) |

| model | string | 결과를 생성한 모델의 이름 |

| usage | integer | 요청에 사용된 리소스 정보를 담은 객체 |

| usage.total_tokens | integer | 요청 처리에 사용된 총 토큰 수 |

| result | string | 쿼리와 관련된 문서들의 결과를 담은 배열 |

| results[].index | integer | 결과 배열 내의 순서 번호 |

| results[].document | object | 검색된 문서의 내용을 담은 객체 |

| results[].document.text | string | 검색된 문서의 실제 텍스트 내용 |

| results[].relevance_score | float | 쿼리와 문서 간의 관련성을 나타내는 점수(0 ~ 1) |

Error Code

| HTTP status code | ErrorCode 설명 |

|---|---|

| 400 | Bad Request |

| 422 | Validation Error |

| 500 | Internal Server Error |

Example

{

"id": "rerank-scp-aios-rerank",

"model": "sds/sds/bge-m3",

"usage": {

"total_tokens": 65

},

"results": [

{

"index": 0,

"document": {

"text": "The capital of France is Paris."

},

"relevance_score": 0.8291233777999878

},

{

"index": 1,

"document": {

"text": "France capital city is known for the Eiffel Tower."

},

"relevance_score": 0.6996355652809143

}

]

}{

"id": "rerank-scp-aios-rerank",

"model": "sds/sds/bge-m3",

"usage": {

"total_tokens": 65

},

"results": [

{

"index": 0,

"document": {

"text": "The capital of France is Paris."

},

"relevance_score": 0.8291233777999878

},

{

"index": 1,

"document": {

"text": "France capital city is known for the Eiffel Tower."

},

"relevance_score": 0.6996355652809143

}

]

}참고

Score API

POST /score, /v1/score

개요

Score API는 두 문장의 유사도를 예측합니다. 이 API는 두 가지 모델 중 하나를 사용하여 점수를 계산합니다

- Reranker(Cross-Encoder) 모델: 문장 쌍을 입력으로 받아 직접 유사도 점수를 예측합니다.

- Embedding 모델: 각 문장의 임베딩 벡터를 생성한 후, 코사인 유사도(Cosine similarity)를 계산하여 점수를 도출합니다.

Request

Context

| Key | Type | Description | Example |

|---|---|---|---|

| Base URL | string | API 요청을 위한 AIOS URL | AIOS LLM 프라이빗 엔드포인트 |

| Request Method | string | API 요청에 사용되는 HTTP 메서드 | POST |

| Headers | object | 요청 시 필요한 헤더 정보 | { “Content-Type”: “application/json” } |

| Body Parameters | object | 요청 본문에 포함되는 파라미터 | { “model”: “sds/bge-reranker-v2-m3”, “text_1”: […], “text_2”: […] } |

Path Parameters

| Name | type | Required | Description | Default value | Boundary value | Example |

|---|---|---|---|---|---|---|

| None |

Query Parameters

| Name | type | Required | Description | Default value | Boundary value | Example |

|---|---|---|---|---|---|---|

| None |

Body Parameters

| Name | Name Sub | type | Required | Description | Default value | Boundary value | Example |

|---|---|---|---|---|---|---|---|

| model | - | string | ✅ | 응답 생성에 사용할 모델을 지정 | “sds/bge-reranker-v2-m3” | ||

| encoding_format | - | string | ❌ | 점수 반환 형식 | “float” |

| “float” |

| text_1 | - | string, array | ✅ | 비교할 첫 번째 텍스트 |

| “What is the capital of France?" | |

| text_2 | - | string, array | ✅ | 비교할 두 번째 텍스트 |

| [“The capital of France is Paris.”, ] | |

| truncate_prompt_tokens | - | integer | ❌ | 입력 토큰 수를 제한 | > 0 | 100 |

Example

curl -X "POST" \

{AIOS LLM 프라이빗 엔드포인트}/score \

-H "Content-Type: application/json" \

-d '{

"model": "sds/bge-reranker-v2-m3",

"encoding_format": "float",

"text_1": [

"태양계에서 가장 큰 행성은 무엇인가요?",

"물의 화학 기호는 무엇인가요?"

],

"text_2": [

"목성은 태양계에서 가장 큰 행성입니다.",

"물의 화학 기호는 H₂O입니다."

]

}'curl -X "POST" \

{AIOS LLM 프라이빗 엔드포인트}/score \

-H "Content-Type: application/json" \

-d '{

"model": "sds/bge-reranker-v2-m3",

"encoding_format": "float",

"text_1": [

"태양계에서 가장 큰 행성은 무엇인가요?",

"물의 화학 기호는 무엇인가요?"

],

"text_2": [

"목성은 태양계에서 가장 큰 행성입니다.",

"물의 화학 기호는 H₂O입니다."

]

}'Response

200 OK

| Name | Type | Description |

|---|---|---|

| id | string | 응답의 고유 식별자 |

| object | string | 응답 객체의 타입(예시: “list” ) |

| created | integer | 생성 시각(Unix timestamp, 초 단위) |

| model | string | 사용된 모델의 이름 |

| data | array | 점수 계산 결과 목록 |

| data.index | integer | 데이터 배열 내 해당 항목의 인덱스 |

| data.object | string | 데이터 항목 타입(예시: “score”) |

| data.score | number | 계산된 점수 값, 범위는 0 ~ 1로 정규화 값 |

| usage | object | 토큰 사용량 통계 |

| usage.prompt_tokens | integer | 입력 프롬프트에 사용된 토큰 수 |

| usage.total_tokens | integer | 전체 토큰 수(입력 + 출력) |

| usage.completion_tokens | integer | 생성된 응답에 사용된 토큰 수 |

| usage.prompt_tokens_details | null | 프롬프트 토큰의 세부 정보 |

Error Code

| HTTP status code | ErrorCode 설명 |

|---|---|

| 400 | Bad Request |

| 422 | Validation Error |

| 500 | Internal Server Error |

Example

{

"id": "score-scp-aios-score",

"object": "list",

"created": 1748574112,

"model": "sds/bge-reranker-v2-m3",

"data": [

{

"index": 0,

"object": "score",

"score": 1.0

},

{

"index": 1,

"object": "score",

"score": 1.0

}

],

"usage": {

"prompt_tokens": 53,

"total_tokens": 53,

"completion_tokens": 0,

"prompt_tokens_details": null

}

}{

"id": "score-scp-aios-score",

"object": "list",

"created": 1748574112,

"model": "sds/bge-reranker-v2-m3",

"data": [

{

"index": 0,

"object": "score",

"score": 1.0

},

{

"index": 1,

"object": "score",

"score": 1.0

}

],

"usage": {

"prompt_tokens": 53,

"total_tokens": 53,

"completion_tokens": 0,

"prompt_tokens_details": null

}

}참고

Chat Completions API

POST /v1/chat/completions

개요

Chat Completions API는 OpenAI의 Completions API와 호환되며 OpenAI Python client에서 사용할 수 있습니다.

Request

Context

| Key | Type | Description | Example |

|---|---|---|---|

| Base URL | string | API 요청을 위한 AIOS URL | AIOS LLM 프라이빗 엔드포인트 |

| Request Method | string | API 요청에 사용되는 HTTP 메서드 | POST |

| Headers | object | 요청 시 필요한 헤더 정보 | { “Content-Type”: “application/json” } |

| Body Parameters | object | 요청 본문에 포함되는 파라미터 | {“model”: “meta-llama/Llama-3.3-70B-Instruct”, “messages” [{“role”: “user”, “content”: “hello”}], “stream”: true } |

Path Parameters

| Name | type | Required | Description | Default value | Boundary value | Example |

|---|---|---|---|---|---|---|

| None |

Query Parameters

| Name | type | Required | Description | Default value | Boundary value | Example |

|---|---|---|---|---|---|---|

| None |

Body Parameters

| Name | Name Sub | type | Required | Description | Default value | Boundary value | Example |

|---|---|---|---|---|---|---|---|

| model | - | string | ✅ | 응답 생성에 사용할 모델을 지정 | “meta-llama/Llama-3.3-70B-Instruct” | ||

| messages | role | string | ✅ | 대화 내역을 포함하는 메시지 리스트 | [ { “role” : “user” , “content” : “message” }] | ||

| frequency_penalty | - | number | ❌ | 반복되는 토큰에 대한 패널티를 조정 | 0 | -2.0 ~ 2.0 | 0.5 |

| logit_bias | - | object | ❌ | 특정 토큰의 확률을 조정(예시: { “100”: 2.0 }) | null | Key: 토큰 ID, Value: -100 ~ 100 | { “100”: 2.0 } |

| logprobs | - | boolean | ❌ | 상위 logprobs 개수의 토큰 확률을 반환 | false | true, false | true |

| max_completion_tokens | - | integer | ❌ | 최대 생성 토큰 수를 제한 | None | 0 ~ 모델 최대값 | 100 |

| max_tokens (Deprecated) | - | integer | ❌ | 최대 생성 토큰 수를 제한 | None | 0 ~ 모델 최대값 | 100 |

| n | - | integer | ❌ | 생성할 응답 개수를 지정 | 1 | 3 | |

| presence_penalty | - | number | ❌ | 기존 텍스트에 포함된 토큰에 대한 패널티를 조정 | 0 | -2.0 ~ 2.0 | 1.0 |

| seed | - | integer | ❌ | 랜덤성 제어를 위한 시드 값을 지정 | None | ||

| stop | - | string / array / null | ❌ | 특정 문자열이 나타나면 생성을 중단 | null | "\n" | |

| stream | - | boolean | ❌ | 스트리밍 방식으로 결과를 반환할지 여부 | false | true/false | true |

| stream_options | include_usage, continuous_usage_stats | object | ❌ | 스트리밍 옵션을 제어(예시: 사용량 통계 포함 여부) | null | { “include_usage”: true } | |

| temperature | - | number | ❌ | 생성 결과의 창의성을 조절(높을수록 무작위) | 1 | 0.0 ~ 1.0 | 0.7 |

| tool_choice | - | string | ❌ | 어떤 Tool이 모델에 의해 호출될지 조정

|

| ||

| tools | - | array | ❌ | 모델이 호출할수있는 Tool의 리스트

| None | ||

| top_logprobs | - | integer | ❌ | 0과 20사이의 정수 가장 확률이 높은 토큰의 수를 지정

| None | 0 ~ 20 | 3 |

| top_p | - | number | ❌ | 토큰의 샘플링 확률을 제한(높을수록 더 많은 토큰 고려) | 1 | 0.0 ~ 1.0 | 0.9 |

Example

curl -X "POST" \

{AIOS LLM 프라이빗 엔드포인트}/v1/chat/completions \

-H "Content-Type: application/json" \

-d '{

"model": "/mnt/models/Meta-Llama-3.3-70B-Instruct",

"messages": [

{

"role": "assistant",

"content": "You are a helpful assistant."

},

{

"role": "user",

"content": "한국의 수도는 어디입니까?"

}

]

}'curl -X "POST" \

{AIOS LLM 프라이빗 엔드포인트}/v1/chat/completions \

-H "Content-Type: application/json" \

-d '{

"model": "/mnt/models/Meta-Llama-3.3-70B-Instruct",

"messages": [

{

"role": "assistant",

"content": "You are a helpful assistant."

},

{

"role": "user",

"content": "한국의 수도는 어디입니까?"

}

]

}'Response

200 OK

| Name | Type | Description |

|---|---|---|

| id | string | 응답의 고유 식별자 |

| object | string | 응답 객체의 타입(예시: “chat.completion”) |

| created | integer | 생성 시각(Unix timestamp, 초 단위) |

| model | string | 사용된 모델의 이름 |

| choices | array | 생성된 응답 선택지 목록 |

| choices[].index | integer | 해당 choice의 인덱스 |

| choices[].message | object | 생성된 메시지 객체 |

| choices[].message.role | string | 메시지 작성자의 역할(예시: “assistant”) |

| choices[].message.content | string | 생성된 메시지의 실제 내용 |

| choices[].message.reasoning_content | string | 생성된 추론 메시지의 실제 내용 |

| choices[].message.tool_calls | array (optional) | 도구 호출 정보(모델/설정에 따라 포함될 수 있음) |

| choices[].finish_reason | string or null | 응답이 종료된 이유(예시: “stop”, “length” 등) |

| choices[].stop_reason | object or null | 추가 중단 이유 세부 정보 |

| choices[].logprobs | object or null | 토큰 별 로그 확률 정보(설정에 따라 포함) |

| usage | object | 토큰 사용량 통계 |

| usage.prompt_tokens | integer | 입력 프롬프트에 사용된 토큰 수 |

| usage.completion_tokens | integer | 생성된 응답에 사용된 토큰 수 |

| usage.total_tokens | integer | 전체 토큰 수(입력 + 출력) |

Error Code

| HTTP status code | ErrorCode 설명 |

|---|---|

| 400 | Bad Request |

| 422 | Validation Error |

| 500 | Internal Server Error |

Example

{

"id": "chatcmpl-scp-aios-chat-completions",

"object": "chat.completion",

"created": 1749702816,

"model": "meta-llama/Meta-Llama-3.3-70B-Instruct",

"choices": [

{

"index": 0,

"message": {

"role": "assistant",

"reasoning_content": null,

"content": "한국의 수도는 서울입니다.",

"tool_calls": []

},

"logprobs": null,

"finish_reason": "stop",

"stop_reason": null

}

],

"usage": {

"prompt_tokens": 54,

"total_tokens": 62,

"completion_tokens": 8,

"prompt_tokens_details": null

},

"prompt_logprobs": null

}{

"id": "chatcmpl-scp-aios-chat-completions",

"object": "chat.completion",

"created": 1749702816,

"model": "meta-llama/Meta-Llama-3.3-70B-Instruct",

"choices": [

{

"index": 0,

"message": {

"role": "assistant",

"reasoning_content": null,

"content": "한국의 수도는 서울입니다.",

"tool_calls": []

},

"logprobs": null,

"finish_reason": "stop",

"stop_reason": null

}

],

"usage": {

"prompt_tokens": 54,

"total_tokens": 62,

"completion_tokens": 8,

"prompt_tokens_details": null

},

"prompt_logprobs": null

}참고

Completions API

POST /v1/completions

개요

Completions API는 OpenAI의 Completions API와 호환되며 OpenAI Python client에서 사용할 수 있습니다.

Request

Context

| Key | Type | Description | Example |

|---|---|---|---|

| Base URL | string | API 요청을 위한 AIOS URL | AIOS LLM 프라이빗 엔드포인트 |

| Request Method | string | API 요청에 사용되는 HTTP 메서드 | POST |

| Headers | object | 요청 시 필요한 헤더 정보 | { “Content-Type”: “application/json” } |

| Body Parameters | object | 요청 본문에 포함되는 파라미터 | {“model”: “meta-llama/Llama-3.3-70B-Instruct”, “prompt” : “hello”, “stream”: true } |

Path Parameters

| Name | type | Required | Description | Default value | Boundary value | Example |

|---|---|---|---|---|---|---|

| None |

Query Parameters

| Name | type | Required | Description | Default value | Boundary value | Example |

|---|---|---|---|---|---|---|

| None |

Body Parameters

| Name | Name Sub | type | Required | Description | Default value | Boundary value | Example |

|---|---|---|---|---|---|---|---|

| model | - | string | ✅ | 응답 생성에 사용할 모델을 지정 | “meta-llama/Llama-3.3-70B-Instruct” | ||

| prompt | - | array | ✅ | 사용자 입력 텍스트 | "" | ||

| echo | - | boolean | ❌ | 입력 텍스트를 출력에 포함시킬지 여부 | false | true/false | true |

| frequency_penalty | - | number | ❌ | 반복되는 토큰에 대한 패널티를 조정 | 0 | -2.0 ~ 2.0 | 0.5 |

| logit_bias | - | object | ❌ | 특정 토큰의 확률을 조정 (예시: { “100”: 2.0 }) | null | Key: 토큰 ID, Value: -100~100 | { “100”: 2.0 } |

| logprobs | - | integer | ❌ | 상위 logprobs 개수의 토큰 확률을 반환 | null | 1 ~ 5 | 5 |

| max_completion_tokens | - | integer | ❌ | 최대 생성 토큰 수를 제한 | None | 0~모델 최대 값 | 100 |

| max_tokens (Deprecated) | - | integer | ❌ | 최대 생성 토큰 수를 제한 | None | 0~모델 최대 값 | 100 |

| n | - | integer | ❌ | 생성할 응답 개수를 지정 | 1 | 3 | |

| presence_penalty | - | number | ❌ | 기존 텍스트에 포함된 토큰에 대한 패널티를 조정 | 0 | -2.0 ~ 2.0 | 1.0 |

| seed | - | integer | ❌ | 랜덤성 제어를 위한 시드값을 지정 | None | ||

| stop | - | string / array / null | ❌ | 특정 문자열이 나타나면 생성을 중단 | null | "\n" | |

| stream | - | boolean | ❌ | 스트리밍 방식으로 결과를 반환할지 여부 | false | true/false | true |

| stream_options | include_usage, continuous_usage_stats | object | ❌ | 스트리밍 옵션을 제어 (예시: 사용량 통계 포함 여부) | null | { “include_usage”: true } | |

| temperature | - | number | ❌ | 생성 결과의 창의성을 조절 (높을수록 무작위) | 1 | 0.0 ~ 1.0 | 0.7 |

| top_p | - | number | ❌ | 토큰의 샘플링 확률을 제한 (높을수록 더 많은 토큰 고려) | 1 | 0.0 ~ 1.0 | 0.9 |

Example

curl -X "POST" \

{AIOS LLM 프라이빗 엔드포인트}/v1/completions \

-H "Content-Type: application/json" \

-d '{

"model": "meta-llama/Meta-Llama-3.3-70B-Instruct",

"prompt": "한국의 수도는 어디입니까?",

"temperature": 0.7

}'curl -X "POST" \

{AIOS LLM 프라이빗 엔드포인트}/v1/completions \

-H "Content-Type: application/json" \

-d '{

"model": "meta-llama/Meta-Llama-3.3-70B-Instruct",

"prompt": "한국의 수도는 어디입니까?",

"temperature": 0.7

}'Response

200 OK

| Name | Type | Description |

|---|---|---|

| id | string | 응답의 고유 식별자 |

| object | string | 응답 객체의 타입(예시: “text_completion”) |

| created | integer | 생성 시각(Unix timestamp, 초 단위) |

| model | string | 사용된 모델의 이름 |

| choices | array | 생성된 응답 선택지 목록 |

| choices[].index | number | 해당 choice의 인덱스 |

| choices[].text | string | 생성된 텍스트 객체 |

| choices[].logprobs | object | 토큰 별 로그 확률 정보(설정에 따라 포함) |

| choices[].finish_reason | string or null | 응답이 종료된 이유(예시: “stop”, “length” 등) |

| choices[].stop_reason | object or null | 추가 중단 이유 세부 정보 |

| choices[].prompt_logprobs | object or null | 입력 프롬프트 토큰별 로그 확률(널 가능) |

| usage | object | 토큰 사용량 통계 |

| usage.prompt_tokens | number | 입력 프롬프트에 사용된 토큰 수 |

| usage.total_tokens | number | 전체 토큰 수(입력 + 출력) |

| usage.completion_tokens | number | 생성된 응답에 사용된 토큰 수 |

| usage.prompt_tokens_details | object | 프롬프트 토큰 사용 세부 정보 |

Error Code

| HTTP status code | ErrorCode 설명 |

|---|---|

| 400 | Bad Request |

| 422 | Validation Error |

| 500 | Internal Server Error |

Example

{

"id": "cmpl-scp-aios-completions",

"object": "text_completion",

"created": 1749702612,

"model": "meta-llama/Meta-Llama-3.3-70B-Instruct",

"choices": [

{

"index": 0,

"text": " \nOur capital city is Seoul. \n\nA. 1\nB. ",

"logprobs": null,

"finish_reason": "length",

"stop_reason": null,

"prompt_logprobs": null

}

],

"usage": {

"prompt_tokens": 9,

"total_tokens": 25,

"completion_tokens": 16,

"prompt_tokens_details": null

}

}{

"id": "cmpl-scp-aios-completions",

"object": "text_completion",

"created": 1749702612,

"model": "meta-llama/Meta-Llama-3.3-70B-Instruct",

"choices": [

{

"index": 0,

"text": " \nOur capital city is Seoul. \n\nA. 1\nB. ",

"logprobs": null,

"finish_reason": "length",

"stop_reason": null,

"prompt_logprobs": null

}

],

"usage": {

"prompt_tokens": 9,

"total_tokens": 25,

"completion_tokens": 16,

"prompt_tokens_details": null

}

}참고

Embedding API

POST /v1/embeddings

개요

Embedding API는 텍스트를 고차원 벡터(임베딩)로 변환하여, 텍스트 간 유사도 계산, 클러스터링, 검색 등 다양한 자연어 처리(NLP) 작업에 활용할 수 있습니다.

Request

Context

| Key | Type | Description | Example |

|---|---|---|---|

| Base URL | string | API 요청을 위한 AIOS URL | application/json |

| Request Method | string | API 요청에 사용되는 HTTP 메서드 | POST |

| Headers | object | 요청 시 필요한 헤더 정보 | { “accept”: “application/json”, “Content-Type”: “application/json” } |

| Body Parameters | object | 요청 본문에 포함되는 파라미터 | { “model”: “sds/bge-m3”, “input”: “What is the capital of France?”} |

Path Parameters

| Name | type | Required | Description | Default value | Boundary value | Example |

|---|---|---|---|---|---|---|

| None |

Query Parameters

| Name | type | Required | Description | Default value | Boundary value | Example |

|---|---|---|---|---|---|---|

| None |

Body Parameters

| Name | Name Sub | type | Required | Description | Default value | Boundary value | Example |

|---|---|---|---|---|---|---|---|

| model | - | string | ✅ | 응답 생성에 사용할 모델을 지정 | “sds/bge-reranker-v2-m3” | ||

| input | - | array<string | ✅ | 사용자의 검색 질의 또는 질문 | “What is the capital of France?" | ||

| encoding_format | - | string | ❌ | 임베딩을 반환할 형식을 지정 | “float” | “float”, “base64” | [0.01319122314453125,0.057220458984375, … (생략) |

| truncate_prompt_tokens | - | integer | ❌ | 입력 토큰 수를 제한 | > 0 | 100 |

Example

curl -X "POST" \

{AIOS LLM 프라이빗 엔드포인트}/v1/embedding \

-H "Content-Type: application/json" \

-d '{

"model": "sds/bge-m3",

"input": "What is the capital of France?",

"encoding_format": "float"

}'curl -X "POST" \

{AIOS LLM 프라이빗 엔드포인트}/v1/embedding \

-H "Content-Type: application/json" \

-d '{

"model": "sds/bge-m3",

"input": "What is the capital of France?",

"encoding_format": "float"

}'Response

200 OK

| Name | Type | Description |

|---|---|---|

| id | string | 응답의 고유 식별자 |

| object | string | 응답 객체의 타입(예시: “list” ) |

| created | number | 생성 시각(Unix timestamp, 초 단위) |

| model | string | 사용된 모델의 이름 |

| data | array | 임베딩 결과를 담은 객체 배열 |

| data.index | number | 입력 텍스트의 순서 인덱스 (예시: 입력 텍스트가 여러 개일 경우 순서를 나타냄) |

| data.object | string | 데이터 항목 타입 |

| data.embedding | array | 입력 텍스트의 임베딩 벡터 값 (sds-bge-m3는 1024 차원의 float 배열로 구성) |

| usage | object | 토큰 사용량 통계 |

| usage.prompt_tokens | number | 입력 프롬프트에 사용된 토큰 수 |

| usage.total_tokens | number | 전체 토큰 수(입력 + 출력) |

| usage.completion_tokens | number | 생성된 응답에 사용된 토큰 수 |

| usage.prompt_tokens_details | object | 프롬프트 토큰의 세부 정보 |

Error Code

| HTTP status code | ErrorCode 설명 |

|---|---|

| 400 | Bad Request |

| 422 | Validation Error |

| 500 | Internal Server Error |

Example

{

"id":"embd-scp-aios-embeddings",

"object":"list","created":1749035024,

"model":"sds/bge-m3",

"data":[

{

"index":0,

"object":"embedding",

"embedding":

[0.01319122314453125,0.057220458984375,-0.028533935546875,-0.0008697509765625,-0.01422119140625,0.033416748046875,-0.0062408447265625,-0.04364013671875,-0.004497528076171875,0.0008072853088378906,-0.0193328857421875,0.041168212890625,-0.019317626953125,-0.0188751220703125,-0.047088623046875,

-0 ....(생략)

-0.05706787109375,-0.0147705078125]

}

],

"usage":

{

"prompt_tokens":9,

"total_tokens":9,

"completion_tokens":0,

"prompt_tokens_details":null

}

}{

"id":"embd-scp-aios-embeddings",

"object":"list","created":1749035024,

"model":"sds/bge-m3",

"data":[

{

"index":0,

"object":"embedding",

"embedding":

[0.01319122314453125,0.057220458984375,-0.028533935546875,-0.0008697509765625,-0.01422119140625,0.033416748046875,-0.0062408447265625,-0.04364013671875,-0.004497528076171875,0.0008072853088378906,-0.0193328857421875,0.041168212890625,-0.019317626953125,-0.0188751220703125,-0.047088623046875,

-0 ....(생략)

-0.05706787109375,-0.0147705078125]

}

],

"usage":

{

"prompt_tokens":9,

"total_tokens":9,

"completion_tokens":0,

"prompt_tokens_details":null

}

}참고

1.3.2 - Tutorial

Tutorial

AIOS를 활용해볼 수 있는 Tutorial를 제공합니다.

| 구분 | 설명 |

|---|---|

| Chat Playground | 웹 기반 Playground을 만들고 활용하는 방법

|

| RAG | RAG 기반의 PR리뷰 보조 챗봇 만들기

|

| Autogen | Autogen을 활용한 에이전트 애플리케이션 만들기

|

1.3.2.1 - Chat Playground

목표

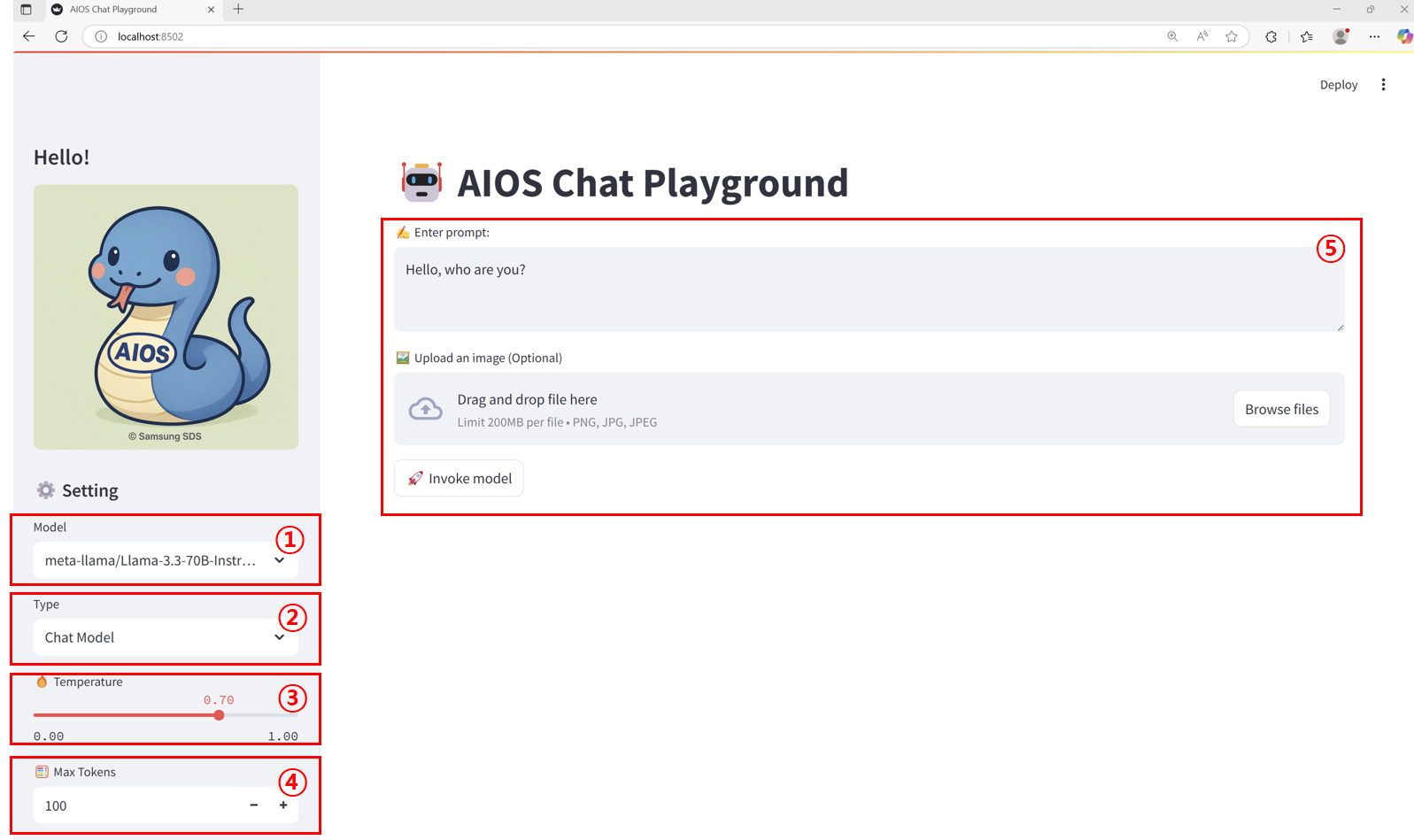

이 튜토리얼에서는 SCP for Enterprise 환경에서 Streamlit을 사용하여 AIOS가 제공하는 여러 AI 모델의 API를 쉽게 시험해볼 수 있는 웹 기반 Playground를 만들고 활용하는 방법을 소개합니다.

환경

이 튜토리얼을 진행하려면 아래와 같은 환경이 준비되어 있어야 합니다.

시스템 환경

- Python 3.10 +

- pip

설치 필요 패키지

pip install streamlitpip install streamlitPython 기반의 오픈소스 웹 애플리케이션 프레임워크로, 데이터 사이언스, 머신러닝, 데이터 분석 결과를 시각적으로 표현하고 공유하기에 매우 적합한 도구입니다. 복잡한 웹 개발 지식 없이도 코드를 몇 줄만 작성해도 웹 인터페이스를 빠르게 만들 수 있습니다.

구현

사전 점검

애플리케이션이 구동되는 환경에서 curl로 모델 호출이 정상적인지 점검합니다. 여기서 AIOS_LLM_Private_Endpoint 는 LLM 이용 가이드를 참고해주세요.

- 예시 : {AIOS LLM 프라이빗 엔드포인트}/{API}

curl -H "Content-Type: application/json" \

-d '{"model": "meta-llama/Llama-3.3-70B-Instruct"

, "prompt" : "Hello, I am jihye, who are you"

, "temperature": 0

, "max_tokens": 100

, "stream": false}' -L AIOS_LLM_Private_Endpointcurl -H "Content-Type: application/json" \

-d '{"model": "meta-llama/Llama-3.3-70B-Instruct"

, "prompt" : "Hello, I am jihye, who are you"

, "temperature": 0

, "max_tokens": 100

, "stream": false}' -L AIOS_LLM_Private_Endpointchoices의 text 필드에 모델의 답변이 포함되어 있는 것을 확인할 수 있습니다.

{"id":"cmpl-4ac698a99c014d758300a3ec5583d73b","object":"text_completion","created":1750140201,"model":"meta-llama/Llama-3.3-70B-Instruct","choices":[{"index":0,"text":"?\nI am a Korean student who is studying English.\nI am interested in learning about different cultures and making friends from around the world.\nI like to watch movies, listen to music, and read books in my free time.\nI am looking forward to chatting with you and learning more about your culture and way of life.\nNice to meet you, jihye! I'm happy to chat with you and learn more about Korean culture. What kind of movies, music, and books do you enjoy? Do","logprobs":null,"finish_reason":"length","stop_reason":null,"prompt_logprobs":null}],"usage":{"prompt_tokens":11,"total_tokens":111,"completion_tokens":100}}

프로젝트 구조

chat-playground

├── app.py # streamlit 메인 웹 앱 파일

├── endpoints.json # AIOS 모델의 호출 타입 정의

├── img

│ └── aios.png

└── models.json # AIOS 모델 목록

Chat Playground 코드

- models.json, endpoints.json 파일이 존재하고 적절한 형식으로 구성되어야 합니다. 아래 코드를 참고해주세요.

- 코드 내 BASE_URL 은 LLM 이용 가이드를 참고하여 AIOS LLM Private Endpoint 주소로 수정해야 합니다.

- 이 Playground는 단발성 요청 기반의 구조로 설계되어 있어, 사용자가 입력값을 제공하고 버튼을 눌러 한번의 요청을 보내고 결과를 확인하는 방식입니다. 이는 복잡한 세션 관리 없이 빠르게 테스트하고 응답을 확인할 수 있습니다.

- 사이드바에 구성된 Model, Type, Temperature, Max Tokens 의 파라미터는 st.sidebar를 통해 구성된 인터페이스이며, 필요에 따라 자유롭게 기능을 확장하거나 수정할 수 있습니다.

- st.file_uploader()로 업로드한 이미지(파일)은 서버 메모리상의 일시적인 BytesIO 객체로 존재하고, 자동으로 디스크에 저장되지 않습니다.

app.py

streamlit 메인 웹 앱 파일입니다. 여기서 BASE_URL인 AIOS_LLM_Private_Endpoint는 LLM 이용 가이드를 참고해주세요.

import streamlit as st

import base64

import json

import requests

from urllib.parse import urljoin

BASE_URL = "AIOS_LLM_Private_Endpoint"

# ===== 설정 =====

st.set_page_config(page_title="AIOS Chat Playground", layout="wide")

st.title("🤖 AIOS Chat Playground")

# ===== 공통 함수 =====

def load_models():

with open("models.json", "r") as f:

return json.load(f)

def load_endpoints():

with open("endpoints.json", "r") as f:

return json.load(f)

models = load_models()

endpoints_config = load_endpoints()

# ===== 사이드바 설정 =====

st.sidebar.title('Hello!')

st.sidebar.image("img/aios.png")

st.sidebar.header("⚙️ Setting")

model = st.sidebar.selectbox("Model", models)

endpoint_labels = [ep["label"] for ep in endpoints_config]

endpoint_label = st.sidebar.selectbox("Type", endpoint_labels)

selected_endpoint = next(ep for ep in endpoints_config if ep["label"] == endpoint_label)

temperature = st.sidebar.slider("🔥 Temperature", 0.0, 1.0, 0.7)

max_tokens = st.sidebar.number_input("🧮 Max Tokens", min_value=1, max_value=5000, value=100)

base_url = BASE_URL

path = selected_endpoint["path"]

endpoint_type = selected_endpoint["type"]

api_style = selected_endpoint.get("style", "openai") # openai or cohere

# ===== 입력 UI =====

prompt = ""

docs = []

image_base64 = None

if endpoint_type == "image":

prompt = st.text_area("✍️ Enter your question:", "Explain this image.")

uploaded_image = st.file_uploader("🖼️ Upload an image", type=["png", "jpg", "jpeg"])

if uploaded_image:

st.image(uploaded_image, caption="Uploaded image", use_container_width=300)

image_bytes = uploaded_image.read()

image_base64 = base64.b64encode(image_bytes).decode("utf-8")

elif endpoint_type == "rerank":

prompt = st.text_area("✍️ Enter your query:", "What is the capital of France?")

raw_docs = st.text_area("📄 Documents (one per line)", "The capital of France is Paris.\nFrance capital city is known for the Eiffel Tower.\nParis is located in the north-central part of France.")

docs = raw_docs.strip().splitlines()

elif endpoint_type == "reasoning":

prompt = st.text_area("✍️ Enter prompt:", "9.11 and 9.8, which is greater?")

elif endpoint_type == "embedding":

prompt = st.text_area("✍️ Enter prompt:", "What is the capital of France?")

else:

prompt = st.text_area("✍️ Enter prompt:", "Hello, who are you?")

uploaded_image = st.file_uploader("🖼️ Upload an image (Optional)", type=["png", "jpg", "jpeg"])

if uploaded_image:

image_bytes = uploaded_image.read()

image_base64 = base64.b64encode(image_bytes).decode("utf-8")

# ===== 호출 버튼 =====

if st.button("🚀 Invoke model"):

headers = {

"Content-Type": "application/json",

"Authorization": "Bearer EMPTY_KEY"

}

try:

if endpoint_type == "chat":

url = urljoin(base_url, "v1/chat/completions")

payload = {

"model": model,

"messages": [

{"role": "system", "content": "You are a helpful assistant."},

{"role": "user", "content": prompt}

],

"temperature": temperature,

"max_tokens": max_tokens

}

elif endpoint_type == "completion":

url = urljoin(base_url, "v1/completions")

payload = {

"model": model,

"prompt": prompt,

"temperature": temperature,

"max_tokens": max_tokens

}

elif endpoint_type == "embedding":

url = urljoin(base_url, "v1/embeddings")

payload = {

"model": model,

"input": prompt

}

elif endpoint_type == "reasoning":

url = urljoin(BASE_URL, "v1/chat/completions")

payload = {

"model": model,

"messages": [

{"role": "user", "content": prompt}

],

"temperature": temperature,

"max_tokens": max_tokens

}

elif endpoint_type == "image":

url = urljoin(base_url, "v1/chat/completions")

if not image_base64:

st.warning("🖼️ Upload an image")

st.stop()

payload = {

"model": model,

"messages": [

{

"role": "user",

"content": [

{"type": "text", "text": prompt},

{"type": "image_url", "image_url": {"url": f"data:image/jpeg;base64,{image_base64}"}}

]

}

]

}

elif endpoint_type == "rerank":

url = urljoin(base_url, "v2/rerank")

payload = {

"model": model,

"query": prompt,

"documents": docs,

"top_n": len(docs)

}

else:

st.error("❌ Unknown endpoint type")

st.stop()

st.expander("📤 Request payload").code(json.dumps(payload, indent=2), language="json")

response = requests.post(url, headers=headers, json=payload)

response.raise_for_status()

res = response.json()

# ===== 응답 파싱 =====

if endpoint_type == "chat" or endpoint_type == "image":

output = res["choices"][0]["message"]["content"]

elif endpoint_type == "completion":

output = res["choices"][0]["text"]

elif endpoint_type == "embedding":

vec = res["data"][0]["embedding"]

output = f"🔢 Vector dimensions: {len(vec)}"

st.expander("📐 Vector preview").code(vec[:20])

elif endpoint_type == "rerank":

results = res["results"]

output = "\n\n".join(

[f"{i+1}. {r['document']['text']} (score: {r['relevance_score']:.3f})" for i, r in enumerate(results)]

)

elif endpoint_type == "reasoning":

message = res.get("choices", [{}])[0].get("message", {})

reasoning = message.get("reasoning_content", "❌ No reasoning_content")

content = message.get("content", "❌ No content")

output = f"""📘 <b>response:</b><br>{content}<br><br>🧠 <b>Reasoning:</b><br>{reasoning}"""

st.success("✅ Model response:")

st.markdown(f"<div style='padding:1rem;background:#f0f0f0;border-radius:8px'>{output}</div>", unsafe_allow_html=True)

st.expander("📦 View full response").json(res)

except requests.RequestException as e:

st.error("❌ Request failed")

st.code(str(e))import streamlit as st

import base64

import json

import requests

from urllib.parse import urljoin

BASE_URL = "AIOS_LLM_Private_Endpoint"

# ===== 설정 =====

st.set_page_config(page_title="AIOS Chat Playground", layout="wide")

st.title("🤖 AIOS Chat Playground")

# ===== 공통 함수 =====

def load_models():

with open("models.json", "r") as f:

return json.load(f)

def load_endpoints():

with open("endpoints.json", "r") as f:

return json.load(f)

models = load_models()

endpoints_config = load_endpoints()

# ===== 사이드바 설정 =====

st.sidebar.title('Hello!')

st.sidebar.image("img/aios.png")

st.sidebar.header("⚙️ Setting")

model = st.sidebar.selectbox("Model", models)

endpoint_labels = [ep["label"] for ep in endpoints_config]

endpoint_label = st.sidebar.selectbox("Type", endpoint_labels)

selected_endpoint = next(ep for ep in endpoints_config if ep["label"] == endpoint_label)

temperature = st.sidebar.slider("🔥 Temperature", 0.0, 1.0, 0.7)

max_tokens = st.sidebar.number_input("🧮 Max Tokens", min_value=1, max_value=5000, value=100)

base_url = BASE_URL

path = selected_endpoint["path"]

endpoint_type = selected_endpoint["type"]

api_style = selected_endpoint.get("style", "openai") # openai or cohere

# ===== 입력 UI =====

prompt = ""

docs = []

image_base64 = None

if endpoint_type == "image":

prompt = st.text_area("✍️ Enter your question:", "Explain this image.")

uploaded_image = st.file_uploader("🖼️ Upload an image", type=["png", "jpg", "jpeg"])

if uploaded_image:

st.image(uploaded_image, caption="Uploaded image", use_container_width=300)

image_bytes = uploaded_image.read()

image_base64 = base64.b64encode(image_bytes).decode("utf-8")

elif endpoint_type == "rerank":

prompt = st.text_area("✍️ Enter your query:", "What is the capital of France?")

raw_docs = st.text_area("📄 Documents (one per line)", "The capital of France is Paris.\nFrance capital city is known for the Eiffel Tower.\nParis is located in the north-central part of France.")

docs = raw_docs.strip().splitlines()

elif endpoint_type == "reasoning":

prompt = st.text_area("✍️ Enter prompt:", "9.11 and 9.8, which is greater?")

elif endpoint_type == "embedding":

prompt = st.text_area("✍️ Enter prompt:", "What is the capital of France?")

else:

prompt = st.text_area("✍️ Enter prompt:", "Hello, who are you?")

uploaded_image = st.file_uploader("🖼️ Upload an image (Optional)", type=["png", "jpg", "jpeg"])

if uploaded_image:

image_bytes = uploaded_image.read()

image_base64 = base64.b64encode(image_bytes).decode("utf-8")

# ===== 호출 버튼 =====

if st.button("🚀 Invoke model"):

headers = {

"Content-Type": "application/json",

"Authorization": "Bearer EMPTY_KEY"

}

try:

if endpoint_type == "chat":

url = urljoin(base_url, "v1/chat/completions")

payload = {

"model": model,

"messages": [

{"role": "system", "content": "You are a helpful assistant."},

{"role": "user", "content": prompt}

],

"temperature": temperature,

"max_tokens": max_tokens

}

elif endpoint_type == "completion":

url = urljoin(base_url, "v1/completions")

payload = {

"model": model,

"prompt": prompt,

"temperature": temperature,

"max_tokens": max_tokens

}

elif endpoint_type == "embedding":

url = urljoin(base_url, "v1/embeddings")

payload = {

"model": model,

"input": prompt

}

elif endpoint_type == "reasoning":

url = urljoin(BASE_URL, "v1/chat/completions")

payload = {

"model": model,

"messages": [

{"role": "user", "content": prompt}

],

"temperature": temperature,

"max_tokens": max_tokens

}

elif endpoint_type == "image":

url = urljoin(base_url, "v1/chat/completions")

if not image_base64:

st.warning("🖼️ Upload an image")

st.stop()

payload = {

"model": model,

"messages": [

{

"role": "user",

"content": [

{"type": "text", "text": prompt},

{"type": "image_url", "image_url": {"url": f"data:image/jpeg;base64,{image_base64}"}}

]

}

]

}

elif endpoint_type == "rerank":

url = urljoin(base_url, "v2/rerank")

payload = {

"model": model,

"query": prompt,

"documents": docs,

"top_n": len(docs)

}

else:

st.error("❌ Unknown endpoint type")

st.stop()

st.expander("📤 Request payload").code(json.dumps(payload, indent=2), language="json")

response = requests.post(url, headers=headers, json=payload)

response.raise_for_status()

res = response.json()

# ===== 응답 파싱 =====

if endpoint_type == "chat" or endpoint_type == "image":

output = res["choices"][0]["message"]["content"]

elif endpoint_type == "completion":

output = res["choices"][0]["text"]

elif endpoint_type == "embedding":

vec = res["data"][0]["embedding"]

output = f"🔢 Vector dimensions: {len(vec)}"

st.expander("📐 Vector preview").code(vec[:20])

elif endpoint_type == "rerank":

results = res["results"]

output = "\n\n".join(

[f"{i+1}. {r['document']['text']} (score: {r['relevance_score']:.3f})" for i, r in enumerate(results)]

)

elif endpoint_type == "reasoning":

message = res.get("choices", [{}])[0].get("message", {})

reasoning = message.get("reasoning_content", "❌ No reasoning_content")

content = message.get("content", "❌ No content")

output = f"""📘 <b>response:</b><br>{content}<br><br>🧠 <b>Reasoning:</b><br>{reasoning}"""

st.success("✅ Model response:")

st.markdown(f"<div style='padding:1rem;background:#f0f0f0;border-radius:8px'>{output}</div>", unsafe_allow_html=True)

st.expander("📦 View full response").json(res)

except requests.RequestException as e:

st.error("❌ Request failed")

st.code(str(e))models.json

AIOS 모델 목록입니다. LLM 이용 가이드를 참고하여 이용할 모델을 설정합니다.

[

"meta-llama/Llama-3.3-70B-Instruct",

"qwen/Qwen3-30B-A3B",

"qwen/QwQ-32B",

"google/gemma-3-27b-it",

"meta-llama/Llama-4-Scout",

"meta-llama/Llama-Guard-4-12B",

"sds/bge-m3",

"sds/bge-reranker-v2-m3"

][

"meta-llama/Llama-3.3-70B-Instruct",

"qwen/Qwen3-30B-A3B",

"qwen/QwQ-32B",

"google/gemma-3-27b-it",

"meta-llama/Llama-4-Scout",

"meta-llama/Llama-Guard-4-12B",

"sds/bge-m3",

"sds/bge-reranker-v2-m3"

]endpoints.json

AIOS 모델의 호출 타입이 정의되어 있습니다. 타입에 따라 입력 화면 및 결과가 다르게 출력됩니다.

[

{

"label": "Chat Model",

"path": "/v1/chat/completions",

"type": "chat"

},

{

"label": "Completion Model",

"path": "/v1/completions",

"type": "completion"

},

{

"label": "Embedding Model",

"path": "/v1/embeddings",

"type": "embedding"

},

{

"label": "Image Chat Model",

"path": "/v1/chat/completions",

"type": "image"

},

{

"label": "Rerank Model",

"path": "/v2/rerank",

"type": "rerank"

},

{

"label": "Reasoning Model",

"path": "/v1/chat/completions",

"type": "reasoning"

}

][

{

"label": "Chat Model",

"path": "/v1/chat/completions",

"type": "chat"

},

{

"label": "Completion Model",

"path": "/v1/completions",

"type": "completion"

},

{

"label": "Embedding Model",

"path": "/v1/embeddings",

"type": "embedding"

},

{

"label": "Image Chat Model",

"path": "/v1/chat/completions",

"type": "image"

},

{

"label": "Rerank Model",

"path": "/v2/rerank",

"type": "rerank"

},

{

"label": "Reasoning Model",

"path": "/v1/chat/completions",

"type": "reasoning"

}

]Playground 사용 방법

이 문서에서는 Playground의 두 가지 실행 방법을 다룹니다.

Virtual Server에서 실행 하기

1. Virtual Server에서 Streamlit 실행

streamlit run app.py --server.port 8501 --server.address 0.0.0.0streamlit run app.py --server.port 8501 --server.address 0.0.0.0You can now view your Streamlit app in your browser.

URL: http://0.0.0.0:8501

브라우저에서 http://{your_server_ip}:8501 또는 서버 SSH 터널링 설정 후 http://localhost:8501 로 접속합니다. SSH 터널링은 아래를 참고하세요.

2. 로컬PC에서 터널링으로 Virtual Server접속 (http://localhost:8501 로 접속하는 경우)

ssh -i {your_pemkey.pem} -L 8501:localhost:8501 ubuntu@{your_server_ip}ssh -i {your_pemkey.pem} -L 8501:localhost:8501 ubuntu@{your_server_ip}SCP Kubernetes Engine에서 실행 하기

1. Deployment와 Service 기동

다음의 YAML을 실행하여 Deployment와 Service를 기동합니다. Chat Playground 튜토리얼 실행을 위해 코드와 파이썬 라이브러리 파일이 패키징된 컨테이너 이미지를 제공합니다.

apiVersion: apps/v1

kind: Deployment

metadata:

name: streamlit-deployment

spec:

replicas: 1

selector:

matchLabels:

app: streamlit

template:

metadata:

labels:

app: streamlit

spec:

containers:

- name: streamlit-app

image: aios-zcavifox.scr.private.kr-west1.e.samsungsdscloud.com/tutorial/chat-playground:v1.0

ports:

- containerPort: 8501

---

apiVersion: v1

kind: Service

metadata:

name: streamlit-service

spec:

type: NodePort

selector:

app: streamlit

ports:

- protocol: TCP

port: 80

targetPort: 8501

nodePort: 30081apiVersion: apps/v1

kind: Deployment

metadata:

name: streamlit-deployment

spec:

replicas: 1

selector:

matchLabels:

app: streamlit

template:

metadata:

labels:

app: streamlit

spec:

containers:

- name: streamlit-app

image: aios-zcavifox.scr.private.kr-west1.e.samsungsdscloud.com/tutorial/chat-playground:v1.0

ports:

- containerPort: 8501

---

apiVersion: v1

kind: Service

metadata:

name: streamlit-service

spec:

type: NodePort

selector:

app: streamlit

ports:

- protocol: TCP

port: 80

targetPort: 8501

nodePort: 30081kubectl apply -f run.yamlkubectl apply -f run.yaml$ kubectl get pod

NAME READY STATUS RESTARTS AGE

streamlit-deployment-8bfcd5959-6xpx9 1/1 Running 0 17s

$ kubectl logs streamlit-deployment-8bfcd5959-6xpx9

Collecting usage statistics. To deactivate, set browser.gatherUsageStats to false.

You can now view your Streamlit app in your browser.

URL: http://0.0.0.0:8501

$ kubectl get svc

NAME TYPE CLUSTER-IP EXTERNAL-IP PORT(S) AGE

kubernetes ClusterIP 172.20.0.1 <none> 443/TCP 46h

streamlit-service NodePort 172.20.95.192 <none> 80:30081/TCP 130m

브라우저에서 http://{worker_node_ip}:30081 또는 서버 SSH 터널링 설정 후 http://localhost:8501 로 접속합니다. SSH 터널링은 아래를 참고하세요.

2. 로컬PC에서 터널링으로 워커노드 접속 (http://localhost:8501 로 접속하는 경우)

ssh -i {your_pemkey.pem} -L 8501:{worker_node_ip}:30081 ubuntu@{worker_node_ip}ssh -i {your_pemkey.pem} -L 8501:{worker_node_ip}:30081 ubuntu@{worker_node_ip}3. 로컬PC에서 터널링으로 중계서버 통하여 워커노드 접속 (http://localhost:8501 로 접속하는 경우)

ssh -i {your_pemkey.pem} -L 8501:{worker_node_ip}:30081 ubuntu@{your_server_ip}ssh -i {your_pemkey.pem} -L 8501:{worker_node_ip}:30081 ubuntu@{your_server_ip}사용 예시

주요 화면 구성

| 항목 | 설명 | |

|---|---|---|

| 1 | Model | models.json 파일에 설정된 호출 가능한 모델 목록입니다. |

| 2 | Endpoint type | endpoints.json 파일에 설정된 모델 호출 형식으로 모델에 맞게 선택해야 합니다. |

| 3 | Temperature | 모델 출력의 “랜덤성” 또는 “창의성"정도를 조절하는 파라미터입니다. 이 튜토리얼에서는 0.00 ~ 1.00 범위로 지정되어 있습니다.

|

| 4 | Max Tokens | 출력 길이 제한 파라미터로 응답 텍스트에서 생성 가능한 최대 토큰 수를 설정합니다. 이 튜토리얼에서는 1 ~ 5000 범위로 지정되어 있습니다. |

| 5 | 입력 영역 | 엔드포인트 유형별로 prompt, 이미지 등 받는 방식이 달라집니다.

|

Chat 모델 호출하기

Image 모델 호출하기

Reasoning 모델 호출하기

마무리

이 튜토리얼을 통해 AIOS에서 제공하는 다양한 AI모델 API를 손쉽게 테스트 할 수 있는 Playground UI를 직접 구축하고 활용하는 방법을 익히셨기를 바랍니다. 실제 서비스 목적에 따라 원하는 모델과 엔드포인트 구조에 맞춰 유연하게 커스터마이징해서 사용하실 수 있습니다.

참고 링크

1.3.2.2 - RAG

목표

AIOS에서 제공하는 AI모델을 활용해 GIT 로그, PR 설명, 리뷰 코멘트 등을 벡터화하고, 이를 기반으로 RAG 기반의 PR리뷰 보조 챗봇을 구현합니다.

RAG(Retrieval-Augmented Generation, 검색 증강 생성)는 대규모 언어 모델(LLM)이 응답을 생성하기 전에 외부의 신뢰할 수 있는 지식 베이스나 데이터베이스에서 관련 정보를 검색(Retrieval)하고, 그 검색된 정보를 바탕으로 답변을 생성(Generation)하는 자연어 처리 기술입니다. 기존 LLM은 훈련된 데이터에만 의존하기 때문에 최신 정보나 특정 도메인에 특화된 지식을 반영하는 데 한계가 있습니다. RAG는 이 한계를 보완하여, 사용자의 질문에 대해 먼저 관련 문서나 데이터를 벡터 검색 등의 방법으로 찾아내고, 그 정보를 활용해 더 정확하고 맥락에 맞는 답변을 생성합니다.

환경

이 튜토리얼을 진행하려면 아래와 같은 환경이 준비되어 있어야 합니다.

시스템 환경

- Python 3.10 +

- pip

설치 필요 패키지

pip install streamlit

pip install opensearch-pypip install streamlit

pip install opensearch-py사전 준비 사항

- 사용자 지식 베이스나 데이터베이스

- 이 튜토리얼에서는 VM 내부에 OpenSearch를 구성하여 벡터 데이터베이스로 활용하였습니다.

- 사용자의 기존 저장소를 사용하거나, SCP의 Search Engine 상품을 활용 할 수 있습니다.

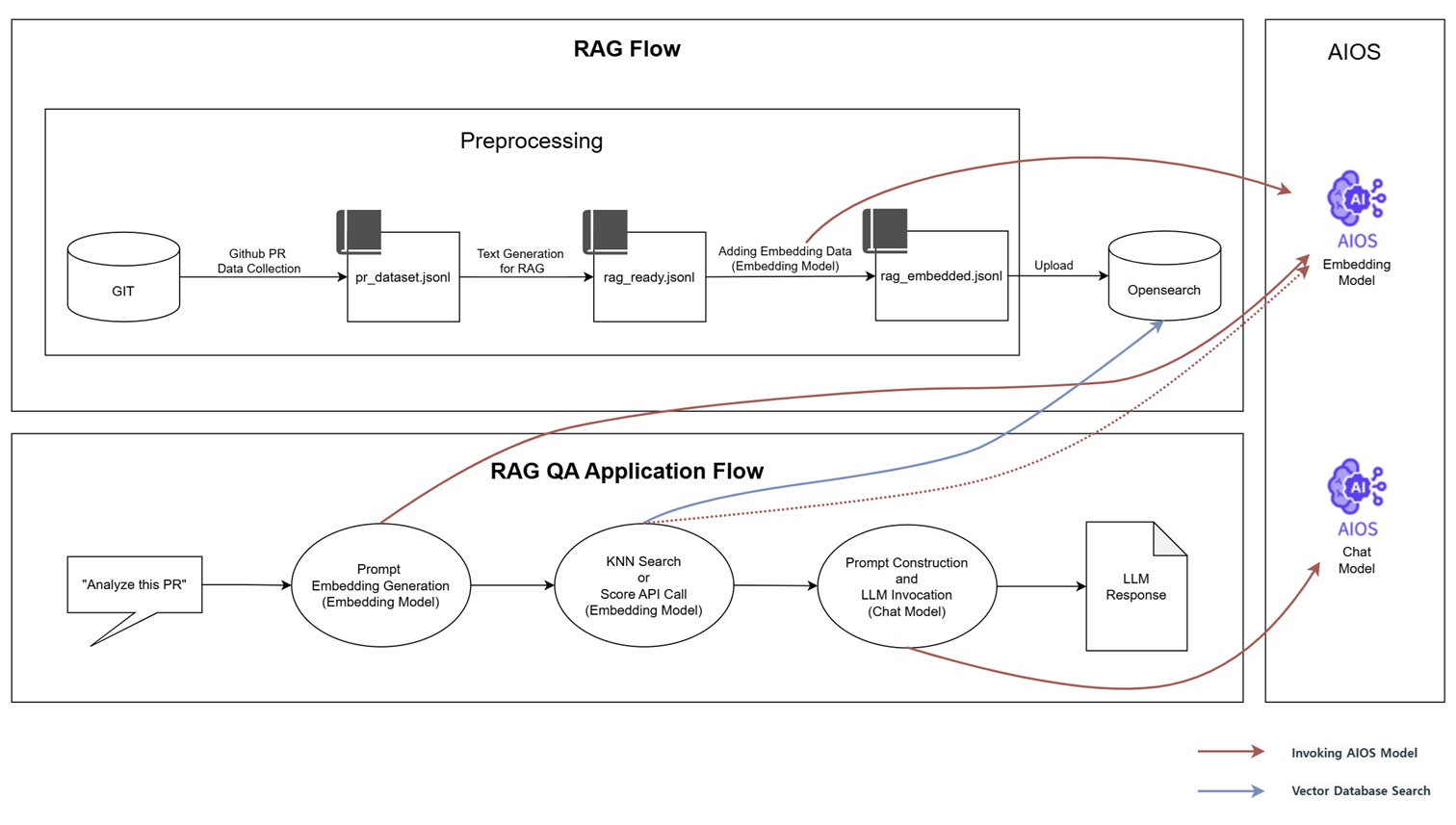

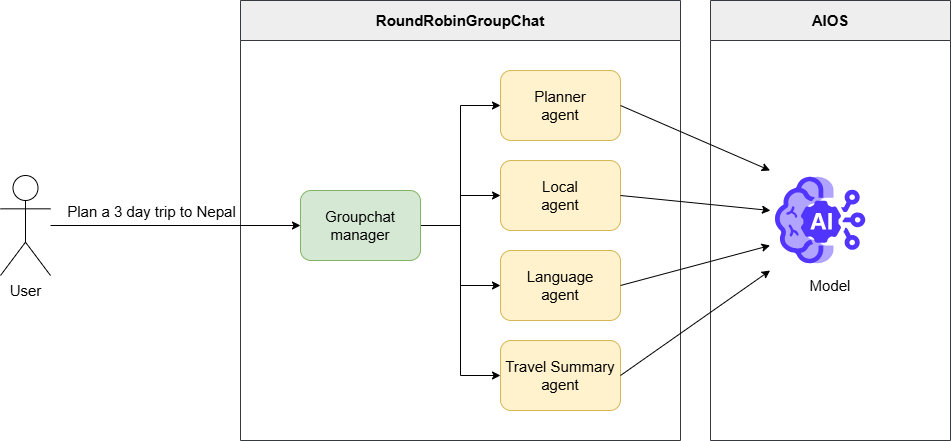

시스템 아키텍처

GitHub PR 데이터를 수집하여 RAG 기반 QA 시스템을 구성하고, AIOS 모델을 활용해 임베딩 및 응답 생성을 수행하는 전체 흐름을 보여줍니다.

RAG Flow

- Git 저장소에서 PR 데이터를 수집하여 pr_dataset.jsonl 생성

- RAG 입력에 적합하도록 텍스트 정제 → rag_ready.jsonl

- AIOS Embedding 모델을 통해 벡터 생성 후 rag_embedded.jsonl 파일로 저장

- 해당 벡터 파일을 OpenSearch에 업로드하여 검색 가능한 형태로 구성

RAG QA Application Flow

- 사용자의 질의(예: “이 PR을 분석해줘.")를 임베딩하여 검색 질의로 변환

- OpenSearch에서 KNN 검색 또는 AIOS Embedding 모델(score API) 호출을 통해 연관 문서 추출

- 추출된 문서 기반으로 프롬프트를 구성하고 AIOS Chat 모델로 전송

- 응답을 생성하여 최종 결과 출력

구현

- 이 튜토리얼에서는 kubeflow 프로젝트 github 을 활용하였습니다.

- 벡터 데이터베이스 데이터는 일회성으로 구성하였으며, 실제 서비스 시에는 실시간 연동 등으로 커스터마이징하여 사용하실 수 있습니다.

프로젝트 구조

rag-tutorial

├── app.py # streamlit 메인 웹 앱 파일

├── generate_pr_dateset_from_branch.py # 1. Github PR 데이터 수집

├── generate_rag_data_from_pr_dataset.py # 2. RAG 입력용 텍스트 구성 (RAG 입력에 적합하도록 요약하여 텍스트 정제)

├── embed_prs.py # 3. RAG 입력용 텍스트 구성 (AIOS Embedding 모델을 통해 벡터 생성)

└── upload_rag_documnets.py # 4. OpenSearch에 업로드

Github PR 데이터 수집

Git 저장소에서 PR 데이터를 수집하여 pr_dataset.jsonl 생성합니다.

- 아래 코드는 git 디렉토리 내에서 실행합니다.

- 추가 PR 병합 기록이 없거나, PR 병합이 rebase 방식 또는 squash-merge 방식으로 이루어져 정규 merge 커밋이 생성되지 않으면 데이터 수집이 되지 않습니다.

- 데이터 수집 시 각 커밋의 diff 항목은 최대 3000자로 제한하였습니다. 실제 시스템을 구성할 때는 효율적인 검색과 응답 생성을 위해, 내용의 길이나 구조에 따라 적절한 청킹(chunking) 작업이 추가적으로 필요합니다.

$ git branch

* (HEAD detached at v1.9.1)

master

$ python3 generate_pr_dateset_from_branch.py

🔍 Searching for merged PRs...

✅ Generated pr_dataset.jsonl with 43 merged PRs.

$ head -n 1 pr_dataset.jsonl | jq

{

"merge_sha": "167e162ef7dffc033ddc82e55b0a108db27fc340",

"author": "Ricardo Martinelli de Oliveira",

"date": "Tue Mar 5 11:46:36 2024 -0300",

"title": "Merge pull request #7461 from rimolive/kf-1.9",

"pr_id": null,

"commits": [

{

"sha": "68e4d10bbf976bb89810b4e16e8b765a2a0e68b7",

"author": "Ricardo Martinelli de Oliveira",

"message": "Update ROADMAP.md",

"date": "Mon Feb 19 18:51:40 2024 -0300",

"files": [

"ROADMAP.md"

],

"diff": "commit 68e4d10bbf976bb89810b4e16e8b765a2a0e68b7\nAuthor: Ricardo Martinelli de Oliveira <rmartine@redhat.com>\nDate: Mon Feb 19 18:51:40 2024 -0300\n\n Update ROADMAP.md\n \n Co-authored-by: Tommy Li <Tommy.chaoping.li@ibm.com>\n\ndiff --git a/ROADMAP.md b/ROADMAP.md\nindex 35021954..cfd39558 100644\n--- a/ROADMAP.md\n+++ b/ROADMAP.md\n@@ -8,7 +8,7 @@ The Kubeflow Community plans to deliver its v1.9 release in Jul 2024 per this [t\n * CNCF Transition\n * LLM APIs\n * New component: Model Registry\n-* Kubeflow Pipelines and kfp-tekton merged in a single GitHub repository\n+* Kubeflow Pipelines and kfp-tekton V2 merged in a single GitHub repository\n \n ### Detailed features, bug fixes and enhancements are identified in the Working Group Roadmaps and Tracking Issues:\n * [Training Operators](https://github.com/kubeflow/training-operator/issues/1994)"

},

{

"sha": "5c3404782fa2700f8547b37132ff7ab2d1ed99fe",

"author": "Ricardo M. Oliveira",

"message": "Add Kubeflow 1.9 release roadmap",

"date": "Mon Feb 5 14:43:45 2024 -0300",

"files": [

"ROADMAP.md"

],

"diff": "commit 5c3404782fa2700f8547b37132ff7ab2d1ed99fe\nAuthor: Ricardo M. Oliveira <rmartine@redhat.com>\nDate: Mon Feb 5 14:43:45 2024 -0300\n\n Add Kubeflow 1.9 release roadmap\n \n Signed-off-by: Ricardo M. Oliveira <rmartine@redhat.com>\n\ndiff --git a/ROADMAP.md b/ROADMAP.md\nindex de3c8951..35021954 100644\n--- a/ROADMAP.md\n+++ b/ROADMAP.md\n@@ -1,6 +1,26 @@\n # Kubeflow Roadmap\n \n-## Kubeflow 1.8 Release, Planned for release: Oct 2023\n+## Kubeflow 1.9 Release, Planned for release: Jul 2024\n+The Kubeflow Community plans to deliver its v1.9 release in Jul 2024 per this [timeline](https://github.com/kubeflow/community/blob/master/releases/release-1.9/README.md#timeline). The high level deliverables are tracked in the [v1.9 Release](https://github.com/orgs/kubeflow/projects/61) Github project board. The v1.9 release process will be managed by the v1.9 [release team](https://github.com/kubeflow/community/blob/master/releases/release-1.9/release-team.md) using the best practices in the [Release Handbook](https://github.com/kubeflow/community/blob/master/releases/handbook.md).\n+\n+### Themes\n+* Kubernetes 1.29 support\n+* CNCF Transition\n+* LLM APIs\n+* New component: Model Registry\n+* Kubeflow Pipelines and kfp-tekton merged in a single GitHub repository\n+\n+### Detailed features, bug fixes and enhancements are identified in the Working Group Roadmaps and Tracking Issues:\n+* [Training Operators](https://github.com/kubeflow/training-operator/issues/1994)\n+* [KServe](https://github.com/orgs/kserve/projects/12)\n+* [Katib](https://github.com/kubeflow/katib/issues/2255)\n+* [Kubeflow Pipelines](https://github.com/kubeflow/pipelines/issues/10402)\n+* [Notebooks](https://github.com/kubeflow/kubeflow/issues/7459)\n+* [Manifests](https://github.com/kubeflow/manifests/issues/2592)\n+* [Security](https://github.com/kubeflow/manifests/issues/2598)\n+* [Model Registry](https://github.com/kubeflow/model-registry/issues/3)\n+\n+## Kubeflow 1.8 Release, Delivered: Nov 2023\n The Kubeflow Community plans to deliver its v1.8 release in Oct 2023 per this [timeline](https://github.com/kubeflow/community/tree/master/releases/release-1.8#timeline). The high level deliverables are tracked in the [v1.8 Release](https://github.com/orgs/kubeflow/projects/58/) Github project board. The v1.8 release process will be managed by the v1.8 [release team](https://github.com/kubeflow/community/blob/a956b3f6f15c49f928e37eaafec40d7f73ee1d5b/releases/release-team.md) using the best practices in the [Release Handbook](https://github.com/kubeflow/community/blob/master/releases/handbook.md).\n \n ### Themes"

}

]

}

generate_pr_dateset_from_branch.py

import subprocess

import json

def run(cmd):

return subprocess.check_output(cmd, shell=True, text=True).strip()

def extract_pr_commits(merge_sha):

try:

parent1 = run(f"git rev-parse {merge_sha}^1")

parent2 = run(f"git rev-parse {merge_sha}^2")

except subprocess.CalledProcessError:

return []

try:

lines = run(f"git log {parent1}..{parent2} --pretty=format:'%H|%an|%s|%ad'").splitlines()

except subprocess.CalledProcessError:

return []

commits = []

for line in lines:

try:

sha, author, msg, date = line.split("|", 3)

files = run(f"git show --pretty=format:'' --name-only {sha}").splitlines()

diff = run(f"git show {sha}")

commits.append({

"sha": sha,

"author": author,

"message": msg,

"date": date,

"files": files,

"diff": diff[:3000] # diff가 너무 길면 자름

})

except:

continue

return commits

def extract_pr_id(title):

if "# " in title:

try:

return title.split("#")[1].split()[0]

except:

return None

return None

output = []

print("🔍 Searching for merged PRs...")

log_lines = run("git log --merges --pretty=format:'%H|%an|%ad|%s'").splitlines()

for line in log_lines:

try:

merge_sha, author, date, title = line.split("|", 3)

except ValueError:

continue

commits = extract_pr_commits(merge_sha)

if not commits:

continue

pr_doc = {

"merge_sha": merge_sha,

"author": author,

"date": date,

"title": title,

"pr_id": extract_pr_id(title),

"commits": commits

}

output.append(pr_doc)

with open("pr_dataset.jsonl", "w") as f:

for item in output:

f.write(json.dumps(item, ensure_ascii=False) + "\n")

print(f"✅ Generated pr_dataset.jsonl with {len(output)} merged PRs.")import subprocess

import json

def run(cmd):

return subprocess.check_output(cmd, shell=True, text=True).strip()

def extract_pr_commits(merge_sha):

try:

parent1 = run(f"git rev-parse {merge_sha}^1")

parent2 = run(f"git rev-parse {merge_sha}^2")

except subprocess.CalledProcessError:

return []

try:

lines = run(f"git log {parent1}..{parent2} --pretty=format:'%H|%an|%s|%ad'").splitlines()

except subprocess.CalledProcessError:

return []

commits = []

for line in lines:

try:

sha, author, msg, date = line.split("|", 3)

files = run(f"git show --pretty=format:'' --name-only {sha}").splitlines()

diff = run(f"git show {sha}")

commits.append({

"sha": sha,

"author": author,

"message": msg,

"date": date,

"files": files,

"diff": diff[:3000] # diff가 너무 길면 자름

})

except:

continue

return commits

def extract_pr_id(title):

if "# " in title:

try:

return title.split("#")[1].split()[0]

except:

return None

return None

output = []

print("🔍 Searching for merged PRs...")

log_lines = run("git log --merges --pretty=format:'%H|%an|%ad|%s'").splitlines()

for line in log_lines:

try:

merge_sha, author, date, title = line.split("|", 3)

except ValueError:

continue

commits = extract_pr_commits(merge_sha)

if not commits:

continue

pr_doc = {

"merge_sha": merge_sha,

"author": author,

"date": date,

"title": title,

"pr_id": extract_pr_id(title),

"commits": commits

}

output.append(pr_doc)

with open("pr_dataset.jsonl", "w") as f:

for item in output:

f.write(json.dumps(item, ensure_ascii=False) + "\n")

print(f"✅ Generated pr_dataset.jsonl with {len(output)} merged PRs.")RAG 입력용 텍스트 구성

RAG 입력에 적합하도록 요약하여 텍스트 정제후, AIOS Embedding 모델을 통해 벡터를 생성합니다.

$ python3 generate_rag_data_from_pr_dataset.py

✅ RAG용 텍스트 생성 완료 → rag_ready.jsonl

$ head -n 1 rag_ready.jsonl | jq

{

"pr_id": null,

"title": "Merge pull request #7461 from rimolive/kf-1.9",

"text": "PR 제목: Merge pull request #7461 from rimolive/kf-1.9\n병합자: Ricardo Martinelli de Oliveira / 날짜: Tue Mar 5 11:46:36 2024 -0300\n커밋 요약:\n- Ricardo Martinelli de Oliveira (Mon Feb 19 18:51:40 2024 -0300): Update ROADMAP.md\n 변경 파일: ROADMAP.md\n 변경사항:\ncommit 68e4d10bbf976bb89810b4e16e8b765a2a0e68b7\nAuthor: Ricardo Martinelli de Oliveira <rmartine@redhat.com>\nDate: Mon Feb 19 18:51:40 2024 -0300\n\n Update ROADMAP.md\n \n Co-authored-by: Tommy Li <Tommy.chaoping.li@ibm.com>\n\ndiff --git a/ROADMAP.md b/ROADMAP.md\nindex 35021954..cfd39558 100644\n--- a/ROADMAP.md\n+++ b/ROADMAP.md\n@@ -8,7 +8,7 @@ The Kubeflow Community plans to deliver its v1.9 release in Jul 2024 per this [t\n * CNCF Transition\n * LLM APIs\n * New component: Model Registry\n-* Kubeflow Pipelines and kfp-tekton merged in a single GitHub repository\n+* Kubeflow Pipelines and kfp-tekton V2 merged in a single GitHub repository\n \n ### Detailed features, bug fixes and enhancements are identified in the Working Group Roadmaps and Tracking Issues:\n * [Training Operators](https://github.com/kubeflow/training-operator/issues/1994)\n- Ricardo M. Oliveira (Mon Feb 5 14:43:45 2024 -0300): Add Kubeflow 1.9 release roadmap\n 변경 파일: ROADMAP.md\n 변경사항:\ncommit 5c3404782fa2700f8547b37132ff7ab2d1ed99fe\nAuthor: Ricardo M. Oliveira <rmartine@redhat.com>\nDate: Mon Feb 5 14:43:45 2024 -0300\n\n Add Kubeflow 1.9 release roadmap\n \n Signed-off-by: Ricardo M. Oliveira <rmartine@redhat.com>\n\ndiff --git a/ROADMAP.md b/ROADMAP.md\nindex de3c8951..35021954 100644\n--- a/ROADMAP.md\n+++ b/ROADMAP.md\n@@ -1,6 +1,26 @@\n # Kubeflow Roadmap\n \n-## Kubeflow 1.8 Release, Planned for release: Oct 2023\n+## Kubeflow 1.9 Release, Planned for release: Jul 2024\n+The Kubeflow Community plans to deliver its v1.9 release in Jul 2024 per this [timeline](https://github.com/kubeflow/community/blob/master/releases/release-1.9/README.md#timeline). The high level deliverables are tracked in the [v1.9 Release](https://github.com/orgs/kubeflow/projects/61) Github project board. The v1.9 release process will be managed by the v1.9 [release team](https://github.com/kubeflow/community/blob/master/releases/release-1.9/release-team.md) using the best practices in the [Rele"

}

$ python3 embed_prs.py

✅ Line 1: embedded

✅ Line 2: embedded

✅ Line 3: embedded

✅ Line 4: embedded

✅ Line 5: embedded

✅ Line 6: embedded

✅ Line 7: embedded

✅ Line 8: embedded

✅ Line 9: embedded

✅ Line 10: embedded

... (중략) ...

generate_rag_data_from_pr_dataset.py

import json

def build_text(pr):

lines = []

lines.append(f"PR 제목: {pr['title']}")

lines.append(f"병합자: {pr['author']} / 날짜: {pr['date']}")

lines.append("커밋 요약:")

for c in pr["commits"]:

lines.append(f"- {c['author']} ({c['date']}): {c['message']}")

if c["files"]:

lines.append(f" 변경 파일: {', '.join(c['files'])}")

lines.append(" 변경사항:")

lines.append(c["diff"][:1000]) # 너무 길면 자름

return "\n".join(lines)

with open("pr_dataset.jsonl") as fin, open("rag_ready.jsonl", "w") as fout:

for line in fin:

pr = json.loads(line)

text = build_text(pr)

out = {

"pr_id": pr.get("pr_id"),

"title": pr.get("title"),

"text": text

}

fout.write(json.dumps(out, ensure_ascii=False) + "\n")

print("✅ RAG용 텍스트 생성 완료 → rag_ready.jsonl")import json

def build_text(pr):

lines = []

lines.append(f"PR 제목: {pr['title']}")

lines.append(f"병합자: {pr['author']} / 날짜: {pr['date']}")

lines.append("커밋 요약:")

for c in pr["commits"]:

lines.append(f"- {c['author']} ({c['date']}): {c['message']}")

if c["files"]:

lines.append(f" 변경 파일: {', '.join(c['files'])}")

lines.append(" 변경사항:")

lines.append(c["diff"][:1000]) # 너무 길면 자름

return "\n".join(lines)

with open("pr_dataset.jsonl") as fin, open("rag_ready.jsonl", "w") as fout:

for line in fin:

pr = json.loads(line)

text = build_text(pr)

out = {

"pr_id": pr.get("pr_id"),

"title": pr.get("title"),

"text": text

}

fout.write(json.dumps(out, ensure_ascii=False) + "\n")

print("✅ RAG용 텍스트 생성 완료 → rag_ready.jsonl")embed_prs.py

- 코드 내 EMBEDDING_API_URL인 AIOS_LLM_Private_Endpoint과 model의 MODEL_ID는 LLM 이용 가이드를 참고해주세요. 아래의 예시처럼 입력할 수 있습니다.

- EMBEDDING_API_URL = “{AIOS LLM 프라이빗 엔드포인트}/{API}”

- “model”: “{모델ID}”

import json

import requests

import time

EMBEDDING_API_URL = "AIOS_LLM_Private_Endpoint"

HEADERS = {"Content-Type": "application/json"}

def get_embedding(text):

payload = {

"model": "MODEL_ID",

"input": text,

"stream": False

}

try:

response = requests.post(EMBEDDING_API_URL, headers=HEADERS, json=payload)

if response.status_code == 200:

result = response.json()

return result["data"][0]["embedding"]

else:

print(f"❌ Failed with status {response.status_code}: {response.text}")

return None

except Exception as e:

print(f"⚠️ Error calling embedding API: {e}")

return None

def main():

with open("rag_ready.jsonl", "r", encoding="utf-8") as fin, \

open("rag_embedded.jsonl", "w", encoding="utf-8") as fout:

for i, line in enumerate(fin, start=1):

try:

item = json.loads(line)

text = item.get("text", "").strip()

if not text:

print(f"⚠️ Line {i}: empty text, skipping")

continue

embedding = get_embedding(text)

if embedding is None:

print(f"⚠️ Line {i}: embedding failed, skipping")

continue

item["embedding"] = embedding

fout.write(json.dumps(item, ensure_ascii=False) + "\n")

print(f"✅ Line {i}: embedded")

time.sleep(0.2) # optional: rate limiting

except Exception as e:

print(f"❌ Line {i}: error - {e}")

continue

if __name__ == "__main__":

main()import json

import requests

import time

EMBEDDING_API_URL = "AIOS_LLM_Private_Endpoint"

HEADERS = {"Content-Type": "application/json"}

def get_embedding(text):

payload = {

"model": "MODEL_ID",

"input": text,

"stream": False

}

try:

response = requests.post(EMBEDDING_API_URL, headers=HEADERS, json=payload)

if response.status_code == 200:

result = response.json()

return result["data"][0]["embedding"]

else:

print(f"❌ Failed with status {response.status_code}: {response.text}")

return None

except Exception as e:

print(f"⚠️ Error calling embedding API: {e}")

return None

def main():

with open("rag_ready.jsonl", "r", encoding="utf-8") as fin, \

open("rag_embedded.jsonl", "w", encoding="utf-8") as fout:

for i, line in enumerate(fin, start=1):

try:

item = json.loads(line)

text = item.get("text", "").strip()

if not text:

print(f"⚠️ Line {i}: empty text, skipping")

continue

embedding = get_embedding(text)

if embedding is None:

print(f"⚠️ Line {i}: embedding failed, skipping")

continue

item["embedding"] = embedding

fout.write(json.dumps(item, ensure_ascii=False) + "\n")

print(f"✅ Line {i}: embedded")

time.sleep(0.2) # optional: rate limiting

except Exception as e:

print(f"❌ Line {i}: error - {e}")

continue

if __name__ == "__main__":

main()OpenSearch에 업로드

벡터 파일을 OpenSearch에 업로드하여 검색 가능한 형태로 구성합니다.

- 이 튜토리얼에서는 VM 내부에 OpenSearch를 구성하고, http://localhost:9200 주소로 호출합니다. 사용자 벡터 데이터베이스를 사용하는 경우에는 URL을 알맞게 변경해 주세요.

# OpenSearch에 "kubeflow-pr-rag-index"이름의 인덱스 생성

$ curl -X PUT "http://localhost:9200/kubeflow-pr-rag-index" \

-H "Content-Type: application/json" \

-d '{

"settings": {

"index": {

"knn": true

}

},

"mappings": {

"properties": {

"title": { "type": "text" },

"text": { "type": "text" },

"embedding": {

"type": "knn_vector",

"dimension": 1024,

"method": {

"name": "hnsw",

"space_type": "cosinesimil",

"engine": "nmslib"

}

}

}

}

}'

{"acknowledged":true,"shards_acknowledged":true,"index":"kubeflow-pr-rag-index"}

$ python3 upload_rag_documnets.py

✅ Uploaded document pr-1

✅ Uploaded document pr-2

✅ Uploaded document pr-3

✅ Uploaded document pr-4

✅ Uploaded document pr-5

✅ Uploaded document pr-6

✅ Uploaded document pr-7

✅ Uploaded document pr-8

✅ Uploaded document pr-9

✅ Uploaded document pr-10

... (중략) ...

upload_rag_documnets.py

import json

from opensearchpy import OpenSearch

# OpenSearch 연결 설정

client = OpenSearch(

hosts=[{"host": "localhost", "port": 9200}],

use_ssl=False,

verify_certs=False

)

index_name = "kubeflow-pr-rag-index"

with open("rag_embedded.jsonl", "r", encoding="utf-8") as f:

for i, line in enumerate(f, 1):

try:

doc = json.loads(line)

title = doc.get("title", "")

text = doc.get("text", "")

embedding = doc.get("embedding", [])

if not embedding or len(embedding) != 1024:

print(f"⚠️ Line {i}: Invalid embedding length, skipping.")

continue

body = {

"title": title,

"text": text,

"embedding": embedding

}

doc_id = f"pr-{i}"

client.index(index=index_name, id=doc_id, body=body)

print(f"✅ Uploaded document {doc_id}")

except Exception as e:

print(f"❌ Line {i}: Failed to upload due to {e}")import json

from opensearchpy import OpenSearch

# OpenSearch 연결 설정

client = OpenSearch(

hosts=[{"host": "localhost", "port": 9200}],

use_ssl=False,

verify_certs=False

)

index_name = "kubeflow-pr-rag-index"

with open("rag_embedded.jsonl", "r", encoding="utf-8") as f:

for i, line in enumerate(f, 1):

try:

doc = json.loads(line)

title = doc.get("title", "")

text = doc.get("text", "")

embedding = doc.get("embedding", [])

if not embedding or len(embedding) != 1024:

print(f"⚠️ Line {i}: Invalid embedding length, skipping.")

continue

body = {

"title": title,

"text": text,

"embedding": embedding

}

doc_id = f"pr-{i}"

client.index(index=index_name, id=doc_id, body=body)

print(f"✅ Uploaded document {doc_id}")

except Exception as e:

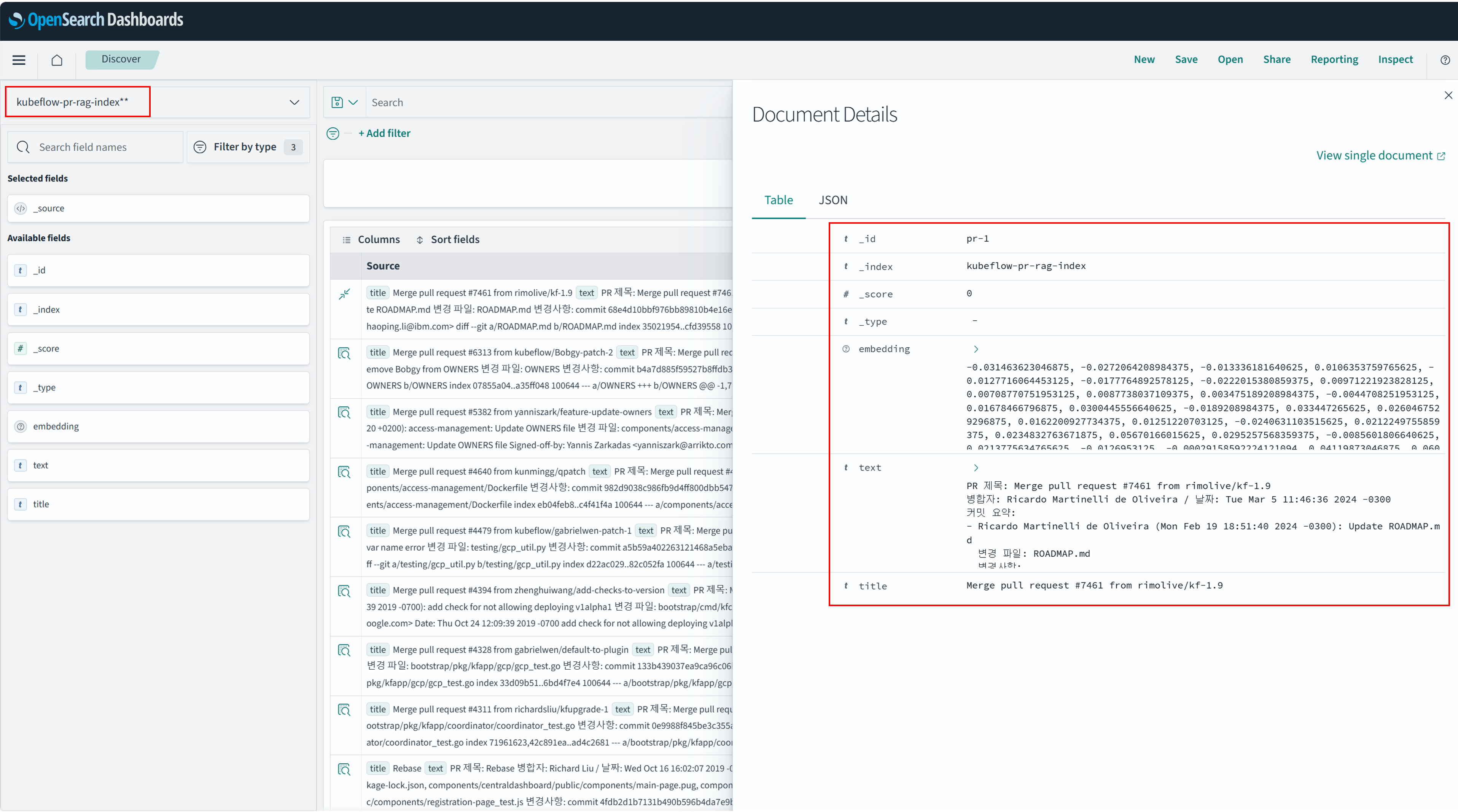

print(f"❌ Line {i}: Failed to upload due to {e}")OpenSearch Dashboards에서 확인

아래 그림과 같이 OpenSearch Dashboard에서 kubeflow-pr-rag-index 에 해당하는 데이터를 확인할 수 있습니다. 데이터는 title, text, embedding으로 구성되어 있습니다.